Clear Sky Science · de

Die Entwicklung und Bewertung von Frage‑Antwort‑Systemen für die Landwirtschaft auf Basis großer Sprachmodelle

Intelligente Antworten für wachsende Ernten

Bäuerinnen und Bauern sowie landwirtschaftliche Fachkräfte treffen täglich Entscheidungen darüber, was angebaut werden soll, wie bewässert wird und wie Feldfrüchte geschützt werden. Schnelle, verlässliche Beratung kann den Unterschied zwischen einer gesunden Ernte und einem kostspieligen Ausfall bedeuten. Dieser Artikel untersucht, wie moderne KI‑Werkzeuge—sogenannte große Sprachmodelle—Frage‑und‑Antwort‑Systeme für die Landwirtschaft antreiben können, indem sie Fragen in natürlicher Sprache in praxisnahe Empfehlungen für das Feld übersetzen.

Warum Betriebe bessere digitale Hilfe brauchen

Die Landwirtschaft wird zunehmend datengetrieben, von Satellitenbildern bis zu Bodensensoren. Viele Expertinnen und Techniker haben dennoch Schwierigkeiten, zuverlässige und leicht verständliche Informationen genau dann zu bekommen, wenn sie sie brauchen. Traditionelle KI‑Systeme erfordern oft große, gelabelte Datensätze, leistungsfähige Computer und spezialisierte Programmierer. Im Gegensatz dazu können große Sprachmodelle—trainiert an umfangreichen Textsammlungen—Fragen beantworten, Informationen zusammenfassen und über Probleme nachdenken, ohne dass viele aufgabenspezifische Daten nötig sind. Das macht sie für Landwirtinnen, Berater und Beratungsstellen attraktiv, die schnelle und kostengünstige Unterstützung benötigen.

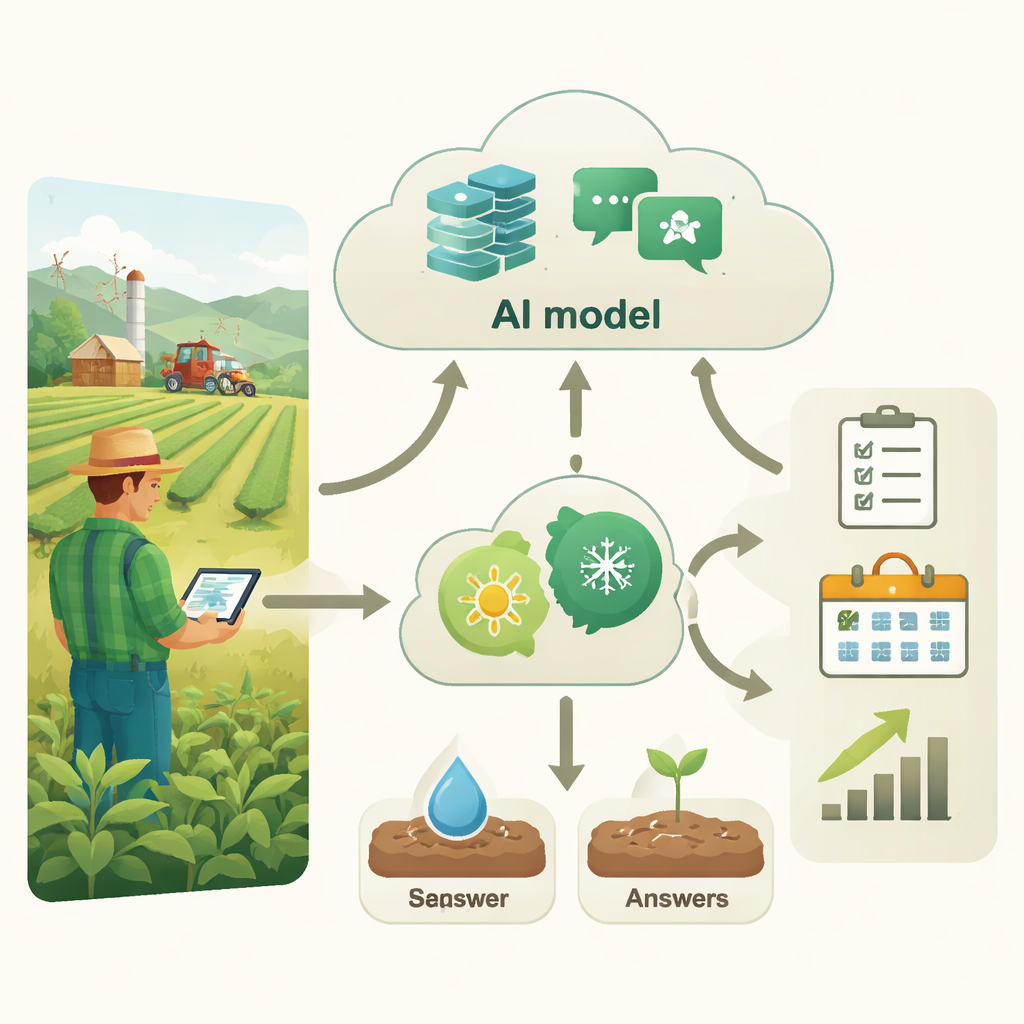

Aufbau einer landwirtschaftlichen Antwortmaschine

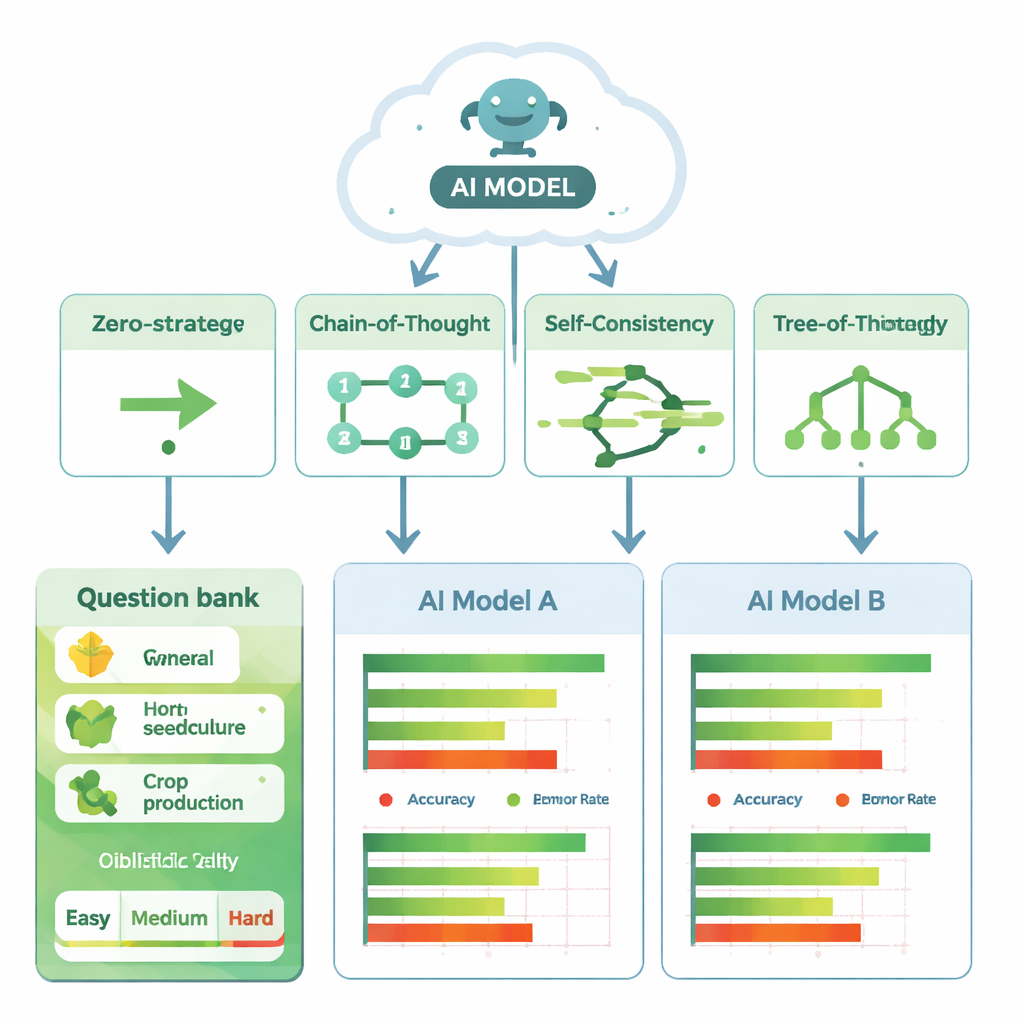

Um zu prüfen, wie gut diese Modelle in der Praxis funktionieren, entwickelten die Autorinnen und Autoren ein landwirtschaftliches Frage‑Antwort‑System namens AgriQAs. Sie sammelten 90 Multiple‑Choice‑Fragen aus verlässlichen landwirtschaftlichen Quellen, die drei Bereiche abdecken: allgemeine Landwirtschaft, Gartenbau und Pflanzenproduktion. Jeder Bereich enthielt einfache, mittlere und schwierige Fragen, von einfachen Definitionen bis zu Aufgaben, die mehrere Schritte der Schlussfolgerung erfordern. Getestet wurden zwei führende Sprachmodelle: eines von OpenAI (GPT‑4o) und eines von Google (Gemini‑2.0‑flash). Bei jeder Frage mussten beide Modelle die richtige Option aus vier Antworten wählen, so wie ein Mensch in einer Prüfung.

Die KI lehren, landwirtschaftliche Probleme durchzudenken

Ein Modell einfach nur zu fragen, liefert nicht immer die beste Antwort. Die Formulierung der Frage—der „Prompt“—kann das Ergebnis stark beeinflussen. Die Forschenden verglichen vier Prompting‑Stile. Im einfachsten, genannt Zero‑Shot, erhielt das Modell nur die Frage und die Anweisung, eine Option zu wählen. Bei Chain‑of‑Thought sollte es schrittweise Schlussfolgerungen zeigen. Self‑Consistency ließ das Modell mehrere Denkwege erzeugen und dann die konsistenteste Antwort auswählen. Tree‑of‑Thought ermutigte dazu, verschiedene Lösungswege zu erkunden, bevor eine Entscheidung getroffen wurde. Das Team nutzte außerdem ein automatisches Prompt‑Engineering‑Tool, um die Formulierung der Anweisungen zu verfeinern, die Rolle des Modells als landwirtschaftliche Expertin bzw. Experte zu stärken und klarzustellen, wie es denken sollte.

Wie gut schlugen sich die KI‑Berater?

Über alle Fragen hinweg schnitten beide Modelle überraschend gut ab, aber die Leistung hing stark von der Art des Prompts ab. GPT‑4o erreichte eine Genauigkeit von etwa 85 % bis 95 %, während Gemini‑2.0‑flash ungefähr zwischen 75 % und 88 % lag. Die schwächsten Ergebnisse zeigten sich bei beiden im einfachen Zero‑Shot‑Stil, der kaum Vorgaben zum Denken macht. Die besten Ergebnisse erzielten strukturiertere Denkweisen: Self‑Consistency brachte GPT‑4o die höchsten Werte, und Tree‑of‑Thought funktionierte am besten für Gemini‑2.0‑flash. Fehler traten am häufigsten bei den schwierigsten Fragen und im Bereich Pflanzenproduktion auf, der häufig detaillierte, mehrstufige Entscheidungen erfordert. Die Autorinnen und Autoren gingen über reine Mittelwerte hinaus und verwendeten formale statistische Tests, um zu bestätigen, dass die Unterschiede zwischen Prompting‑Methoden und Modellen echt sind und nicht nur zufällig auftreten.

Was das für die Landwirtschaft der Zukunft bedeutet

Für Nicht‑Spezialisten lautet die zentrale Botschaft: „Wie man fragt“ ist fast genauso wichtig wie „wen man fragt“, wenn man mit KI arbeitet. Mit sorgfältig gestalteten Prompts können große Sprachmodelle leistungsfähige Assistenten für landwirtschaftliche Ingenieurinnen und Techniker sein und schnelle, relativ genaue Ratschläge bieten, ohne für jedes neue Problem spezifisch trainiert werden zu müssen. Die Autorinnen und Autoren betonen jedoch, dass diese Systeme verantwortungsvoll eingesetzt werden müssen: verzerrte oder falsche Antworten könnten Landwirtinnen und Landwirte in die Irre führen und wirtschaftliche Schäden verursachen. Wenn künftige Arbeiten regionale Daten, Sensordaten und klarere Anleitung von menschlichen Expertinnen und Experten integrieren, könnten Werkzeuge wie AgriQAs zu alltäglichen Begleitern in einer nachhaltigen, high‑tech‑orientierten Landwirtschaft werden—die den Anbauenden hilft, bessere Entscheidungen zu treffen und gleichzeitig Ressourcen zu schonen.

Zitation: Eldem, A., Eldem, H. The development and evaluation of agricultural question-answering systems based on large language models. Sci Rep 16, 5357 (2026). https://doi.org/10.1038/s41598-026-35003-9

Schlüsselwörter: landwirtschaftliche KI, Fragebeantwortung, große Sprachmodelle, Prompt‑Engineering, digitale Landwirtschaft