Clear Sky Science · de

Untersuchung der menschlichen Abhängigkeit von künstlicher Intelligenz bei Entscheidungsfindung

Warum unser Vertrauen in intelligente Maschinen wichtig ist

Von Filmempfehlungen bis hin zu Bewerberauswahl und Strafrecht: Künstliche Intelligenz (KI) hilft immer häufiger bei Entscheidungen. Viele von uns gehen davon aus, dass Computer weniger voreingenommen und genauer sind als Menschen. Doch was passiert tatsächlich, wenn Menschen Ratschläge von einem KI-System erhalten — nutzen sie diese klug oder verlassen sie sich zu stark darauf? Diese Studie untersucht, wie Menschen auf KI-Empfehlungen im Vergleich zu Empfehlungen von anderen Menschen reagieren und was das für die zunehmende Rolle der KI in Alltagsentscheidungen bedeutet.

Tests mit echten Personen und echten sowie gefälschten Gesichtern

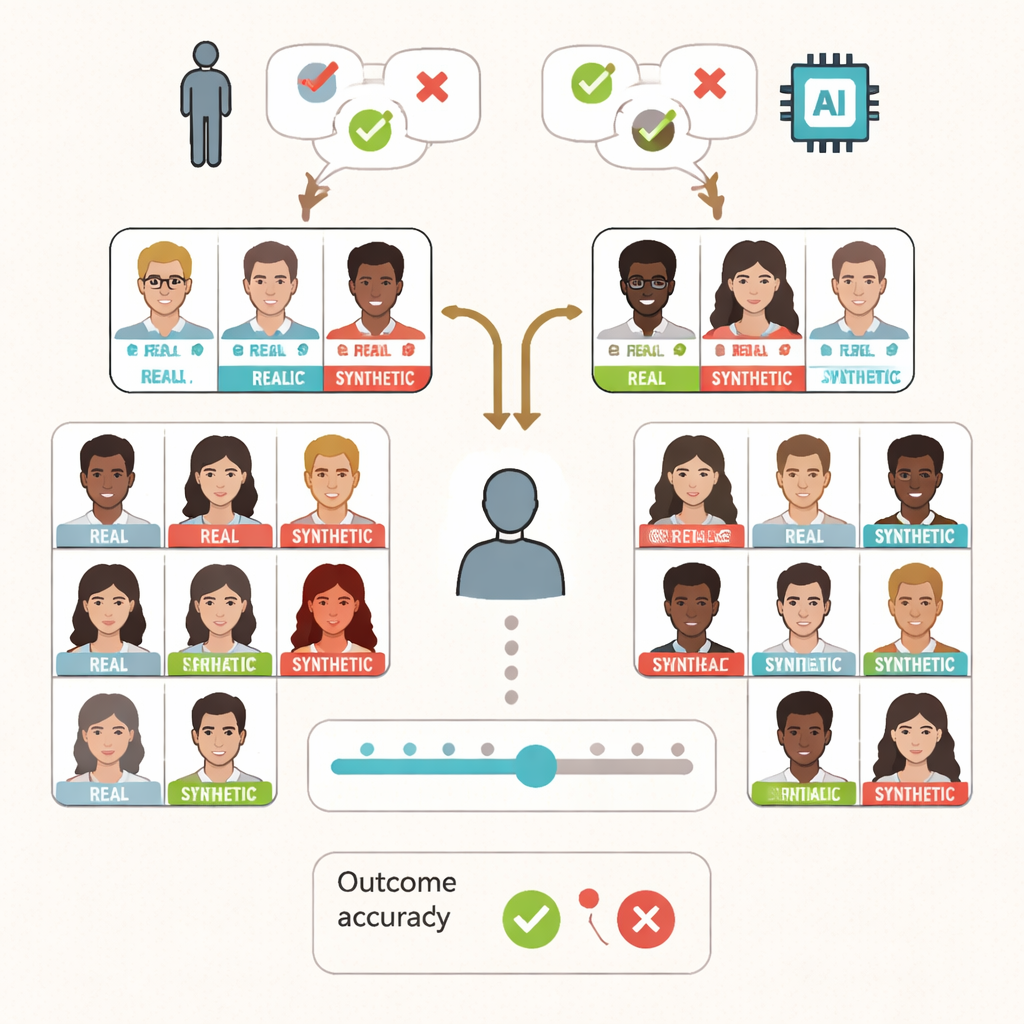

Die Forscher baten 295 Erwachsene, eine scheinbar einfache Aufgabe zu erfüllen: zu entscheiden, ob ein auf dem Bildschirm gezeigtes Gesicht ein Foto einer echten Person oder ein von KI erzeugtes Fake ist. Jeder Teilnehmende sah 80 Gesichter — zur Hälfte echte, zur Hälfte synthetische — die aus früheren Arbeiten so ausgewählt wurden, dass die meisten Menschen sie größtenteils richtig, aber nicht perfekt einordnen konnten. Neben jedem Gesicht stand ein kurzer Hinweis, der angab, ob das Gesicht „echt“ oder „synthetisch“ sei. Den Teilnehmenden wurde gesagt, dieser Rat stamme entweder von einer Gruppe menschlicher Expertinnen und Experten oder von einem KI-System; in Wirklichkeit war die gesamte Beratung vorprogrammiert und nur in der Hälfte der Fälle korrekt.

Rat nutzen, aber nicht blindlings

Zentrale Frage war, ob Menschen einfach der Empfehlung folgen oder selbst nachdenken. Die Ergebnisse zeigen, dass Teilnehmende sich nicht wie passive Knopfdruckende verhielten. Sie folgten dem Rat deutlich häufiger, wenn er zufällig korrekt war, und ignorierten ihn eher, wenn er falsch war — unabhängig davon, ob er angeblich von Menschen oder von KI stammte. Die Gesamtgenauigkeit beim Erkennen echter gegenüber synthetischen Gesichtern lag bei etwa zwei Dritteln richtig — sehr ähnlich zu einer früheren Vergleichsgruppe, die dieselbe Aufgabe ganz ohne Beratung absolvierte. Mit anderen Worten: Die Anwesenheit eines KI-„Helfers“ verbesserte oder verschlechterte die Leistung im Durchschnitt nicht dramatisch.

Wenn positive Einstellungen gegenüber KI nach hinten losgehen

Unter diesen Durchschnittswerten trat jedoch ein subtileres Muster zutage. Die Teilnehmenden füllten zudem Fragebögen aus, in denen sie angaben, wie sehr sie grundsätzlich anderen Menschen vertrauen und wie sie gegenüber KI eingestellt sind. Wer eine positivere Einstellung gegenüber KI hatte, wurde durch KI-Ratschläge tatsächlich schlechter darin, Echt von Falsch zu unterscheiden. Diese Personen waren weniger in der Lage, echte von synthetischen Gesichtern zu trennen als Teilnehmende mit vorsichtigerer oder negativerer Haltung gegenüber KI. Dieser Effekt trat nicht auf, wenn die Teilnehmenden glaubten, die Beratung käme von Menschen, was darauf hindeutet, dass KI-Ratschläge unsere Entscheidungsfindung auf besondere Weise formen — und manchmal verzerren — können. Die Studie zeigte außerdem, dass Personen, die angaben, sie würden sich immer auf die Beratung verlassen, schlechter abschnitten als jene, die sagten, sie nutzten sie nur gelegentlich oder gar nicht.

Die Menschen behalten weiterhin die Entscheiderrolle

Die Forscher untersuchten genauer, wie Menschen ihr eigenes Urteil mit der Beratung ausbalancierten. Im Durchschnitt zeigten Teilnehmende eine Tendenz, Gesichter als echt zu bewerten, und diese Tendenz stieg leicht bei denen, die angaben, anderen Menschen eher zu vertrauen. Doch die Art und Weise, wie Menschen die Hinweise nutzten, wirkte „strategisch“: Sie griffen offenbar vor allem dann auf die Hilfe zurück, wenn sie sich weniger sicher fühlten. Die Vertrauensangaben stimmten recht gut mit der Leistung überein — wenn Menschen sich sicherer fühlten, waren sie generell genauer — was darauf hindeutet, dass Teilnehmende ein vernünftiges Gespür dafür hatten, wann sie richtig oder falsch lagen, selbst wenn KI im Spiel war.

Was das für alltägliche KI-Tools bedeutet

Für eine interessierte Leserin oder einen interessierten Leser ist die Kernbotschaft: KI beseitigt nicht auf magische Weise menschliche Voreingenommenheit, und sie übernimmt auch nicht automatisch unser Urteil. Menschen behandeln KI-Ratschläge oft ähnlich wie menschliche Ratschläge und können sie ignorieren, wenn sie unbrauchbar erscheinen. Wenn jemand jedoch schon sehr positiv gegenüber KI eingestellt ist, neigt er eher dazu, sich so auf sie zu stützen, dass seine Genauigkeit sinkt. Wenn KI-Systeme in kritische Bereiche wie Gesundheitswesen, Sicherheit und Justiz vordringen, müssen Gestalterinnen und Gestalter sowie Entscheidungsträger diese menschlichen Tendenzen verstehen. Die Studie legt nahe, dass effektive KI-Nutzung nicht nur bessere Algorithmen erfordert, sondern auch informierte Anwenderinnen und Anwender, die wissen, wann sie der Maschine vertrauen sollten — und wann sie sich auf sich selbst verlassen sollten.

Zitation: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Schlüsselwörter: künstliche Intelligenz, menschliche Entscheidungsfindung, Vertrauen in KI, Automationsbias, Deepfake-Gesichter