Clear Sky Science · de

Eine Langstrecken-Kalibrierungsmethode für LiDAR–Kamera-Extrinsiken im Schienenverkehr

Züge aus der Ferne sicher halten

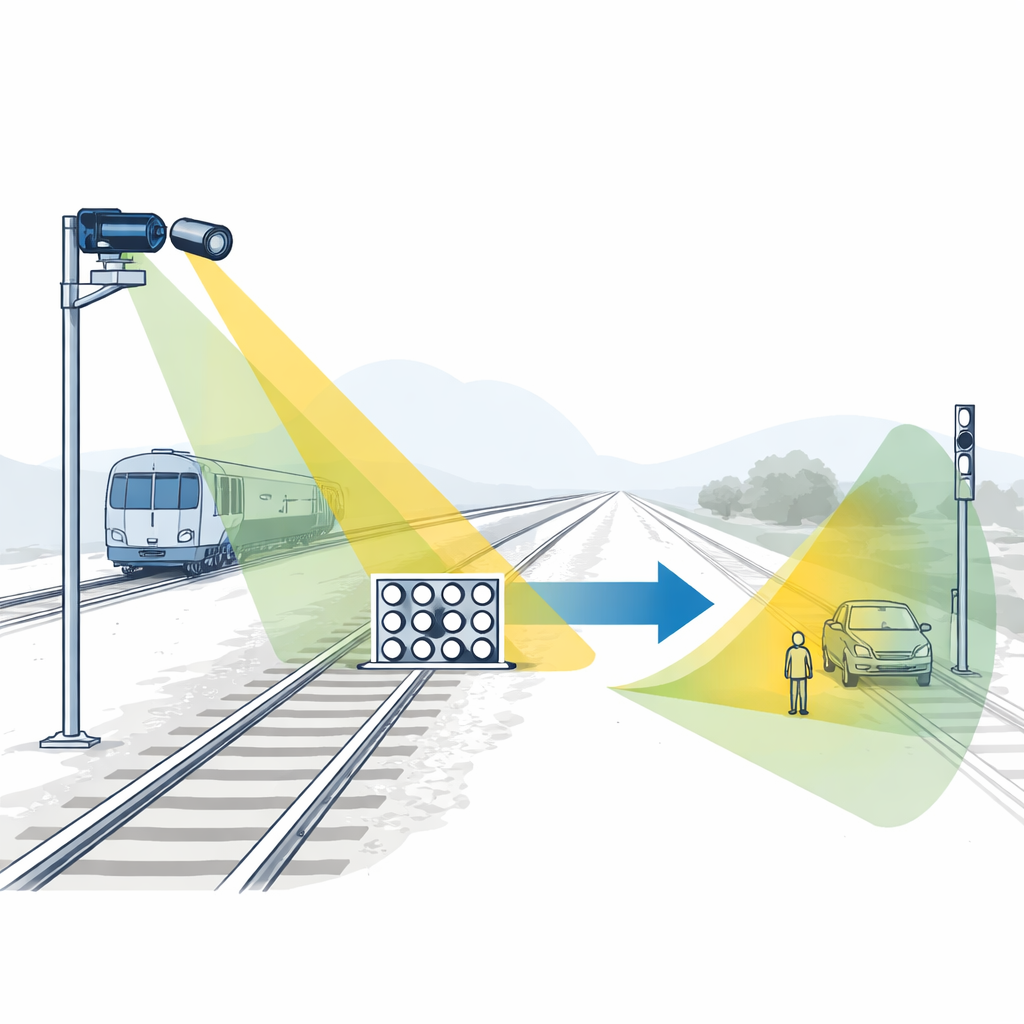

Moderne fahrerlose Züge verlassen sich auf elektronische „Augen“, um die Gleise auf Hindernisse zu überwachen—weit bevor ein Mensch sie sehen könnte. Zwei der wichtigsten Sinne sind Kameras und Laserabtaster, sogenannte LiDARs, die die Welt jeweils auf unterschiedliche Weise erfassen. Damit sie zusammenarbeiten können, müssen sie sehr genau zueinander ausgerichtet sein, eine Aufgabe, die überraschend schwierig wird, wenn die Überwachung Hunderte Meter weit reicht. Diese Studie stellt eine neue Methode vor, mit der sich diese Sensoren so anpassen lassen, dass sie das Schienensystem auch auf lange Distanz zuverlässig schützen.

Warum Sensorausrichtung wichtig ist

In einem autonomen Zug liefern Kameras detaillierte Farbbilder, während LiDAR Entfernungen misst, indem es Lichtpulse aussendet und deren Rücklaufzeit misst. Die Verschmelzung dieser beiden Sichtweisen ermöglicht es dem System, Objekte zu erkennen und zu verfolgen, die in den Gleisbereich eindringen könnten—von einem liegengebliebenen Auto an einem Bahnübergang bis zu Schutt auf den Schienen. Fusion funktioniert jedoch nur, wenn das System genau weiß, wie Kamera und LiDAR zueinander positioniert sind. Eine kleine Fehlausrichtung kann ein erkanntes Hindernis über viele Zentimeter oder sogar Meter verschieben, insbesondere auf große Entfernungen, was automatische Schutzsysteme langsamer oder weniger zuverlässig machen könnte.

Die Herausforderung, weit die Gleise hinunter zu sehen

Für Bahnanwendungen verwenden Ingenieure oft Teleobjektive, damit die Kamera Objekte in mehreren hundert Metern Entfernung klar sehen kann. In solchen Bereichen werden die LiDAR‑Rückläufe von jedem Kalibrierungsziel jedoch sehr dünn: Nur wenige Laserpunkte treffen auf die Tafel, die zur Ausrichtung der Sensoren verwendet wird. Die meisten bestehenden Ausrichtungsverfahren setzen eine dichte Punktwolke oder reichhaltige Kanten im Bild voraus—Bedingungen, die auf lange Distanz einfach nicht gegeben sind. Infolgedessen wird es schwierig, zwischen dem 2D‑Bild und der 3D‑Punktwolke passende Merkmale mit genügender Genauigkeit zu finden, um eine sichere Steuerung des Zuges zu gewährleisten.

Eine klügere Kalibrierungstafel

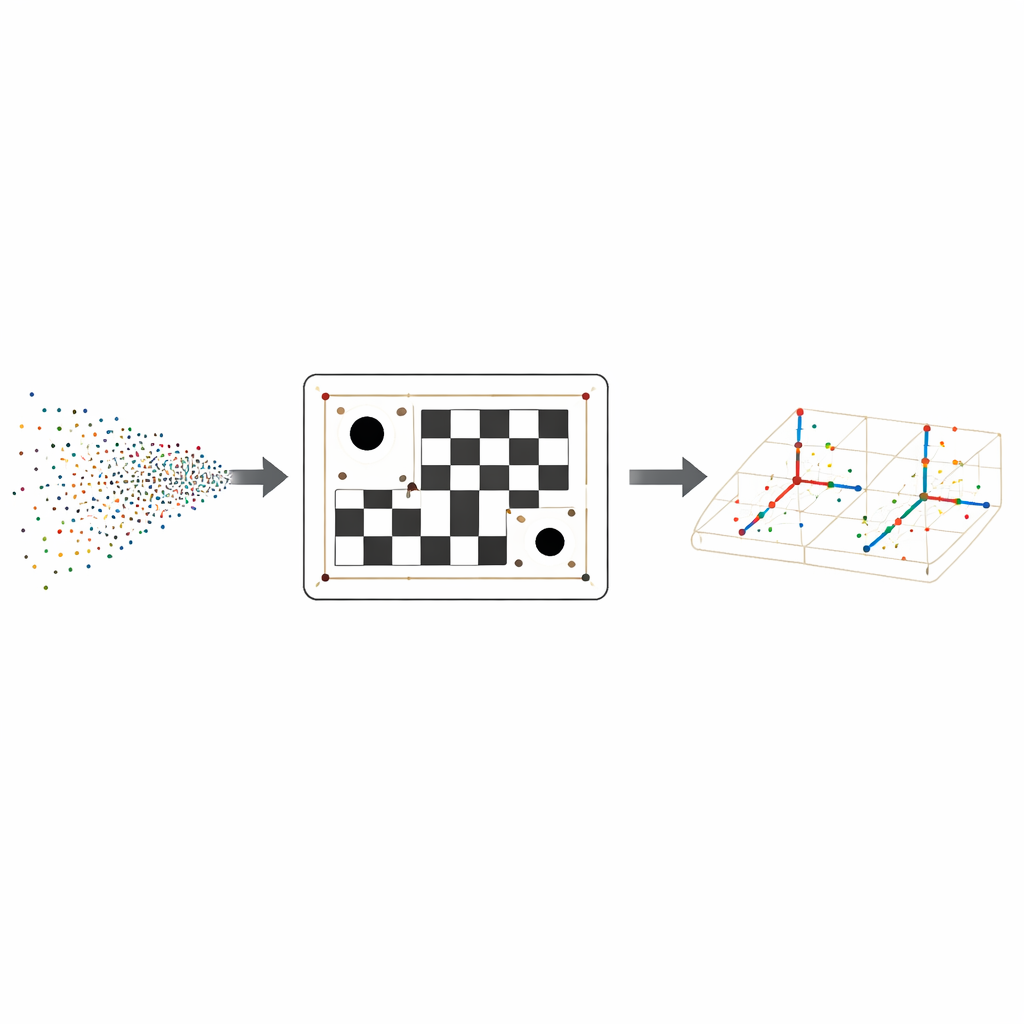

Um dem zu begegnen, entwerfen die Autoren eine spezielle Kalibrierungstafel, die ein bekanntes Schwarz‑Weiß‑Schachbrettmuster mit drei runden Löchern kombiniert, deren Mittelpunkte ein unregelmäßiges Dreieck bilden. Das Schachbrettmuster liefert viele präzise Eckpunkte im Kamerabild, während die Löcher starke geometrische Hinweise für das LiDAR erzeugen, das deren runde Kanten selbst aus großer Entfernung gut erkennen kann. Da die drei Löcher in einem asymmetrischen Dreieck angeordnet sind, lässt sich die räumliche Orientierung der Tafel eindeutig bestimmen und Verwechslungen durch spiegelverkehrte oder gedrehte Ansichten werden vermieden.

Aus spärlichen Punkten verlässliche Übereinstimmungen machen

Auf der LiDAR‑Seite bereinigt die Methode zunächst die Punktwolke und passt eine Ebene an, die die Tafel repräsentiert. Anschließend projiziert sie die Punkte auf diese Ebene und verwendet ein robustes Kreisanpassungsverfahren, um die Mittelpunkte der Löcher zu finden und deren Positionen durch Erzwingen der bekannten physischen Abstände zwischen den Löchern zu verfeinern. Mit dem etablierten Dreieck der Lochmittelpunkte baut der Algorithmus ein lokales Koordinatengitter über der Tafel auf, sagt vorher, wo sich jede Schachbrett‑Ecke in 3D befinden sollte, und prüft nahegelegene LiDAR‑Punkte auf passende Helligkeits‑ bzw. Reflektivitätswerte. Diese Kombination aus Geometrie und Reflektivität verwandelt eine Handvoll verstreuter Rückläufe in eine verlässliche Menge 3D‑Eckpunkte, die zu den 2D‑Ecken der Kamera passen.

Feinabstimmung der Sensorbeziehung

Sobald dieselben physischen Ecken sowohl im Kamerabild als auch in der LiDAR‑Wolke identifiziert sind, bestimmen die Autoren die exakte Rotation und Translation, die die beiden Sensoren verbinden. Sie verwenden eine iterative Optimierungstechnik, die diese Beziehung wiederholt anpasst, um die Lücke zwischen dem Ort, an dem LiDAR‑Punkte im Bild projiziert werden, und dem Ort, an dem die Kamera die Ecken tatsächlich sieht, zu verkleinern. Tests auf einer realen Bahnplattform mit verschiedenen Kameralinsen von moderater bis starker Telebrennweite zeigen, dass die neue Methode die Projektionsfehler konsistent auf etwa einen Pixel oder weniger begrenzt und mehrere bekannte Alternativen besonders bei den längsten Brennweiten übertrifft, bei denen die Daten am spärlichsten sind.

Was das für die Bahnsicherheit bedeutet

Vereinfacht gesagt bietet die Studie eine verlässlichere Methode, um der Kamera und dem LiDAR eines autonomen Zuges mitzuteilen: „Ihr seid hier und schaut genau in diese Richtung.“ Durch die Neugestaltung der Kalibrierungstafel und die intelligente Verarbeitung spärlicher LiDAR‑Daten erhält die Methode hohe Genauigkeit selbst dann, wenn die Sensoren Szenen Hunderte Meter entfernt überwachen. Diese engere Ausrichtung ermöglicht es dem fusionierten System, Hindernisse räumlich präziser zu platzieren, und stärkt damit die technologische Basis für sichereren Schienenverkehr und vertrauenswürdigere Multi‑Sensor‑Wahrnehmung in der Praxis.

Zitation: Liu, X., Wang, H., Ruan, S. et al. A long-range LiDAR–camera extrinsic calibration method for rail transit. Sci Rep 16, 8018 (2026). https://doi.org/10.1038/s41598-025-34547-6

Schlüsselwörter: Sicherheit im Schienenverkehr, LiDAR-Kamera-Fusion, Sensor-Kalibrierung, autonome Züge, Langstreckenwahrnehmung