Clear Sky Science · de

Einzelbild-incohäre Bildgebung mit erweitertem und entwickeltem Sichtfeld mittels codierter Phasenblenden

Warum es wichtig ist, mehr in einem einzigen Bild zu sehen

Von Smartphone-Kameras bis zu Teleskopen stehen wir oft vor demselben Kompromiss: Wenn man heranzoomt, um kleine Details zu sehen, verliert man, wie viel von der Szene ins Bild passt. Sensoren größer zu machen ist teuer und widerspricht dem Trend zu dünneren, leichteren Geräten. Diese Forschung zeigt einen Weg, diese Regel zu „biegen“: Eine Kamera kann ihre starke Vergrößerung beibehalten und zugleich digital das in einer einzelnen Aufnahme sichtbare Bildfeld erweitern.

Eine neue Art, den Bildausschnitt zu strecken

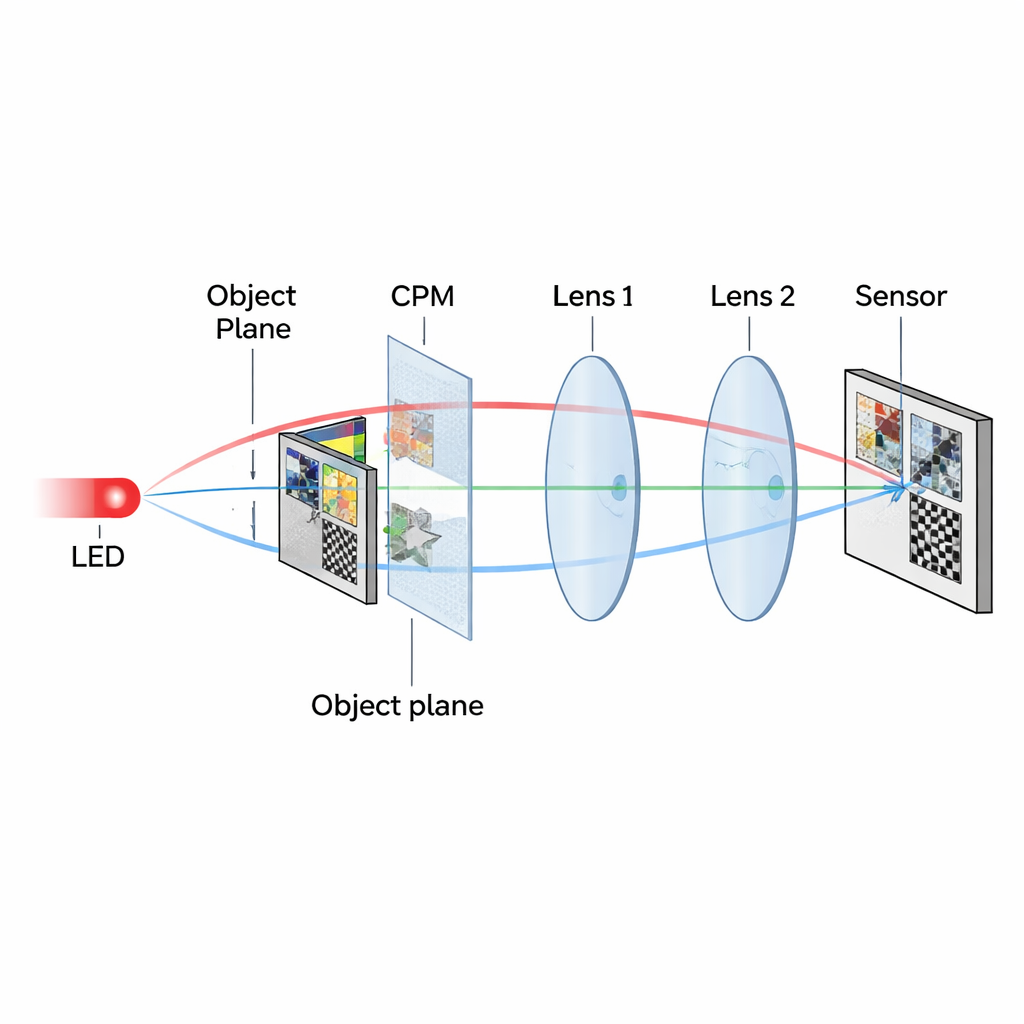

Statt die Linse oder den Sensor zu verändern, formen die Autoren die Art und Weise um, wie Licht vor dem Erreichen des Detektors codiert wird. Sie fügen in ein gewöhnliches Linsensystem ein spezielles glasähnliches Element ein, eine codierte Phasenmaske (CPM). Die CPM erzeugt für sich genommen kein Bild. Stattdessen vermischt sie das Licht auf eine sorgfältig entworfene Weise, sodass Informationen aus Szenenbereichen, die normalerweise außerhalb des Sensors lägen, in den Sensorbereich umgelenkt werden. Anschließend nutzt ein Computer dieses codierte Signal, um eine erweiterte Ansicht der ursprünglichen Szene zu rekonstruieren.

Verborgene Bereiche als punktartige Hinweise

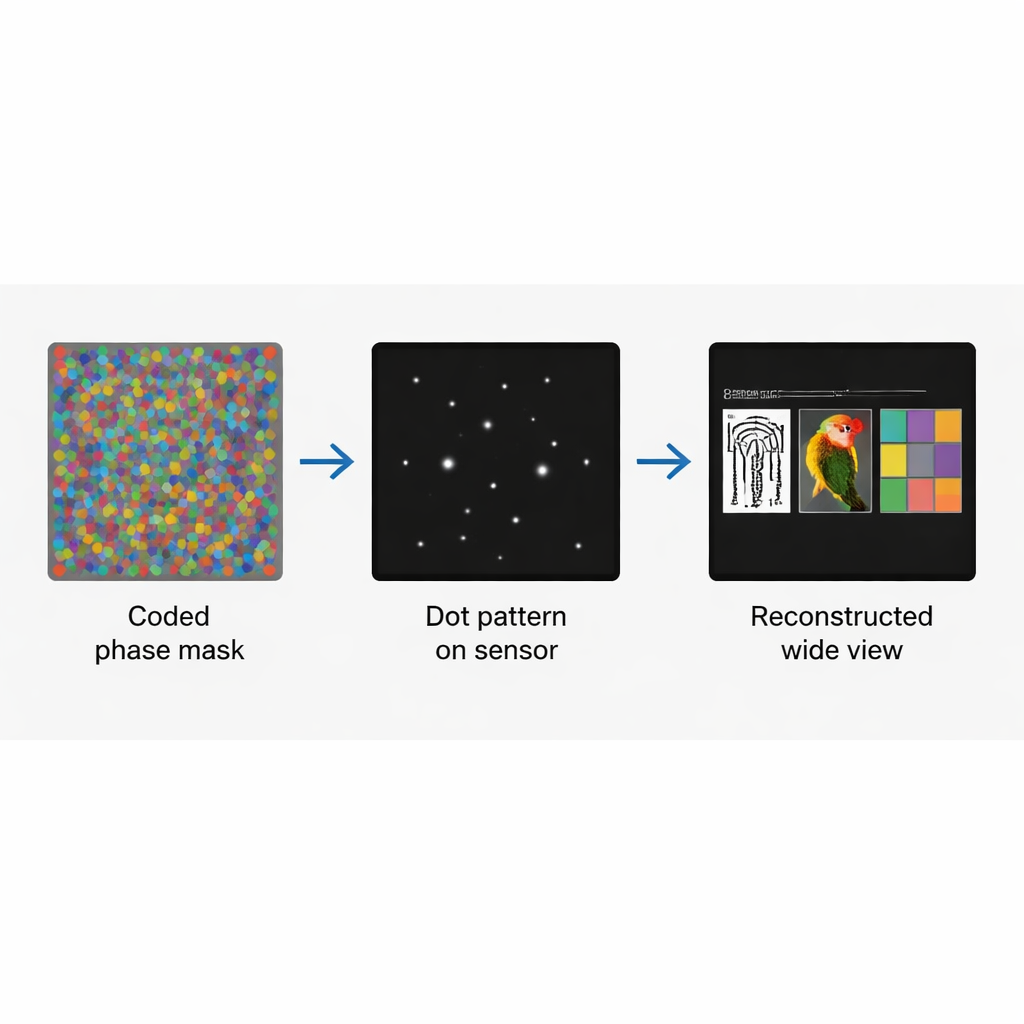

Die CPM besteht aus einer Multiplex-Anordnung mehrerer unterschiedlicher Phasenmuster, von denen jedes einer anderen Region der Objektebene zugewiesen ist. Wenn ein winziger Lichtpunkt in einer Region durch sein zugehöriges Muster fällt, erzeugt er eine charakteristische „Konstellation“ heller Punkte auf der Kamera—seine Punktspreizfunktion. Punkte aus anderen Regionen erzeugen andere Konstellationen, die sich kaum überlappen. Entscheidenderweise wird das Licht einer Region, die außerhalb des normalen Sichtfeldes liegt, von ihrem CPM-Muster so umgelenkt, dass ihr typisches Punktmuster innerhalb des Sensorbereichs erscheint. Das rohe Kamerabild ist daher kein erkennbares Foto, sondern ein Komposit aus sparsamen Punktmustern, die die gesamte erweiterte Szene codieren.

Die Szene mit intelligenter Mathematik entschlüsseln

Sobald dieses punktgefüllte Muster erfasst ist, wird das Bild durch Dekonvolution wiederhergestellt—eine mathematische Operation, die die von der Optik verursachte Unschärfe und Vermischung umkehrt. Das aufgezeichnete Objektantwortmuster wird digital aufgefüttert und zusammen mit dem zugehörigen Satz von Punktspreizfunktionen verarbeitet, je eine für jede Szenenregion. Durch entsprechendes Verschieben und Kombinieren dieser Antwortfunktionen rekonstruiert der Algorithmus alle Regionen an ihren wahren Positionen oder sogar in einem neu gewählten Layout. In diesem Sinne wird das Sichtfeld zu etwas, das „entwickelt“ werden kann: dieselbe Einzelaufnahme lässt sich so zusammensetzen, dass verschiedene Permutationen oder Anordnungen der ursprünglichen Bereiche gezeigt werden.

Die Methode auf die Probe gestellt

Die Forschenden überprüften ihre Idee sowohl durch Simulationen als auch Laborversuche. Sie verwendeten standardisierte Auflösungs-Testcharts als Objekte und eine Kamera mit einem absichtlich zu kleinen Sensor, um in einer normalen Anordnung nicht alle Objekte gleichzeitig sehen zu können. Mit der eingesetzten codierten Phasenmaske nahmen sie eine Einzelaufnahme auf und rekonstruierten anschließend Bilder, die deutlich zwei oder drei getrennte Objekte zeigten, die sonst teilweise oder vollständig außerhalb des Rahmens lägen. Durch Variieren der Anzahl heller Punkte, die jedes Muster enthielt, optimierten sie die Bildqualität anhand vertrauter Maße: Signal-Rausch-Verhältnis, strukturelle Ähnlichkeit mit einem Referenzbild und mittlere quadratische Abweichung. Sie identifizierten spezifische Punktzahlen, die für ihre Zwei- und Drei-Objekt-Experimente die beste Balance zwischen Schärfe und Hintergrundrauschen boten.

Was das für die Alltagsbildgebung bedeutet

Die Arbeit bietet einen anderen Weg zu größeren Sichtfeldern als sperrige Weitwinkelobjektive, Multi-Kamera-Arrays oder Methoden, die viele Aufnahmen und lange Berechnungen erfordern. Hier erzeugen ein einziges kompaktes optisches Element, eine Aufnahme und ein relativ einfacher digitaler Schritt eine erweiterte Ansicht, während die ursprüngliche Vergrößerung und Auflösung erhalten bleiben. Herausforderungen bleiben, vor allem Rauschen, das bei der Rekonstruktion entsteht, wenn Muster aus verschiedenen Regionen interferieren, aber die Autoren schlagen Strategien—etwa zeitmultiplexierte Masken—vor, um dies zu reduzieren. Langfristig könnte dieser Ansatz kompakten Kameras, Mikroskopen und leichten Teleskopen helfen, in einer einzigen Aufnahme mehr von der Welt zu sehen, ohne auf feine Details verzichten zu müssen.

Zitation: Sure, S.D., Desai, J.P. & Rosen, J. Single-shot incoherent imaging with extended and engineered field of view using coded phase apertures. Sci Rep 16, 7620 (2026). https://doi.org/10.1038/s41598-025-33540-3

Schlüsselwörter: Sichtfeld, computational imaging, codierte Blende, digitale Dekonvolution, Einzelbild-Bildgebung