Clear Sky Science · de

Leichtgewichtiges, skalierbares Deep‑Learning‑Framework zur Echtzeit‑Erkennung von Kartoffelblattkrankheiten

Warum es wichtig ist, kranke Blätter zu erkennen

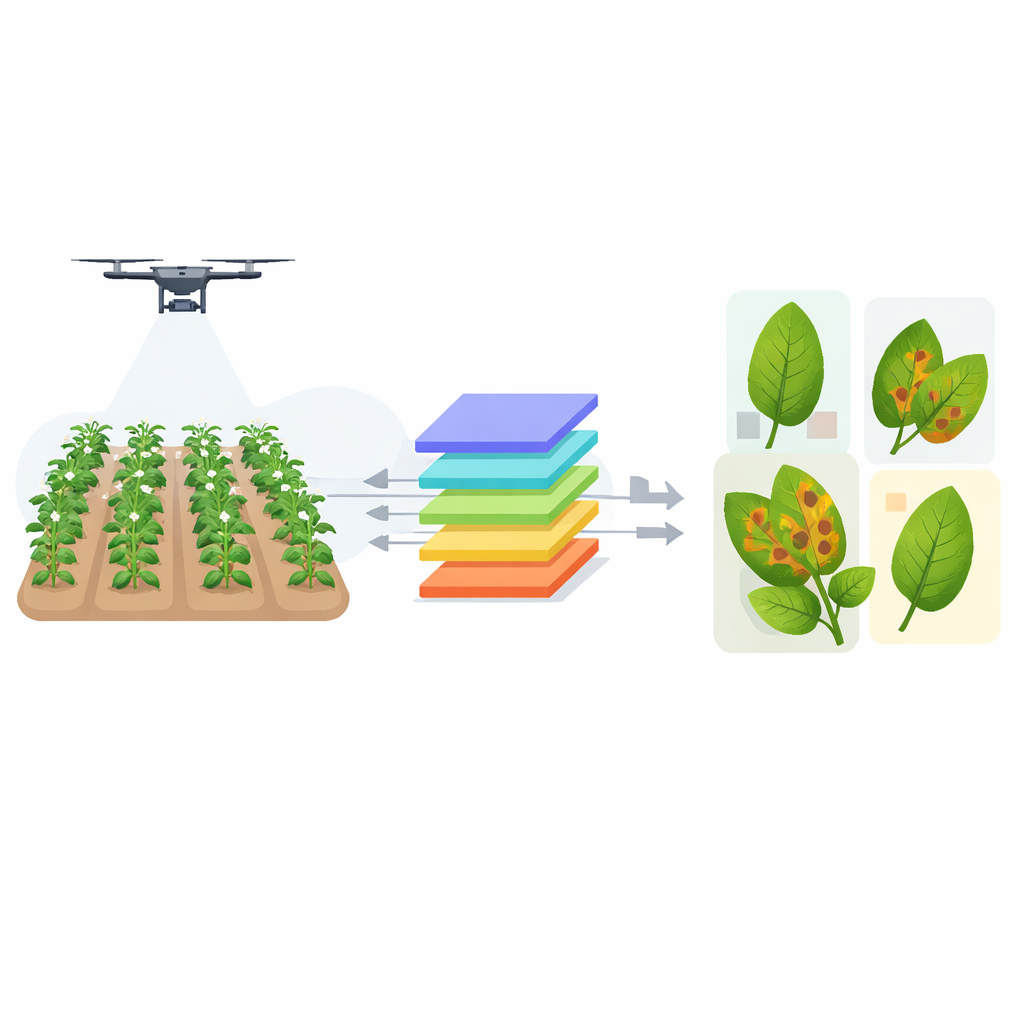

Bäuerinnen und Bauern weltweit sind auf Kartoffeln als Grundnahrungsmittel und Einkommensquelle angewiesen. Zwei häufige Blattkrankheiten, Krautfäule und Alternaria‑Blattflecken (Early Blight), können sich jedoch unbemerkt über Felder ausbreiten, Erträge mindern und zu intensivem Pestizideinsatz zwingen. Diese Studie beschreibt ein neues System der künstlichen Intelligenz, das Kartoffelpflanzen in Echtzeit scannen, kranke Blätter direkt unter unordentlichen Feldbedingungen erkennen und schnell genug laufen kann, um auf Drohnen, Robotern oder Smartphones eingesetzt zu werden. Indem es Rohbilder in sofortige Warnungen umwandelt, soll es Landwirtinnen und Landwirten helfen, früher zu handeln, weniger zu spritzen und Ernten zu schützen.

Auf Fehlersuche in realen Feldern

Die Erkennung von Krankheiten auf Blättern klingt vielleicht einfach, doch Feldaufnahmen sind visuell chaotisch. Blätter überlappen sich, das Licht wechselt von heller Sonne zu tiefem Schatten, Staub und Tau erzeugen glänzende Stellen, und Wind verwischt Fotos. Hinzu kommt, dass harmlose Probleme – wie Nährstoffmangel oder Insektenfraß – Krankheitsanzeichen sehr ähneln können. Viele frühe Computersysteme wurden mit sauberen Laborbildern und einfarbigen Hintergründen trainiert. Sie konnten sagen, ob ein Bild Krankheit enthielt, aber nicht genau lokalisieren, wo sie auf einer echten Pflanze war oder wie weit sie fortgeschritten war. Die Autorinnen und Autoren legten deshalb eine neue Bildsammlung mit 2.500 Kartoffelblättern aus Feldern in Indien und Bangladesch an, die gesunde Pflanzen und ein Spektrum an Krankheitsgraden abdecken und von Pflanzenexpertinnen und -experten sorgfältig beschriftet wurden.

Ein schlanker, kluger Detektor für winzige Flecken

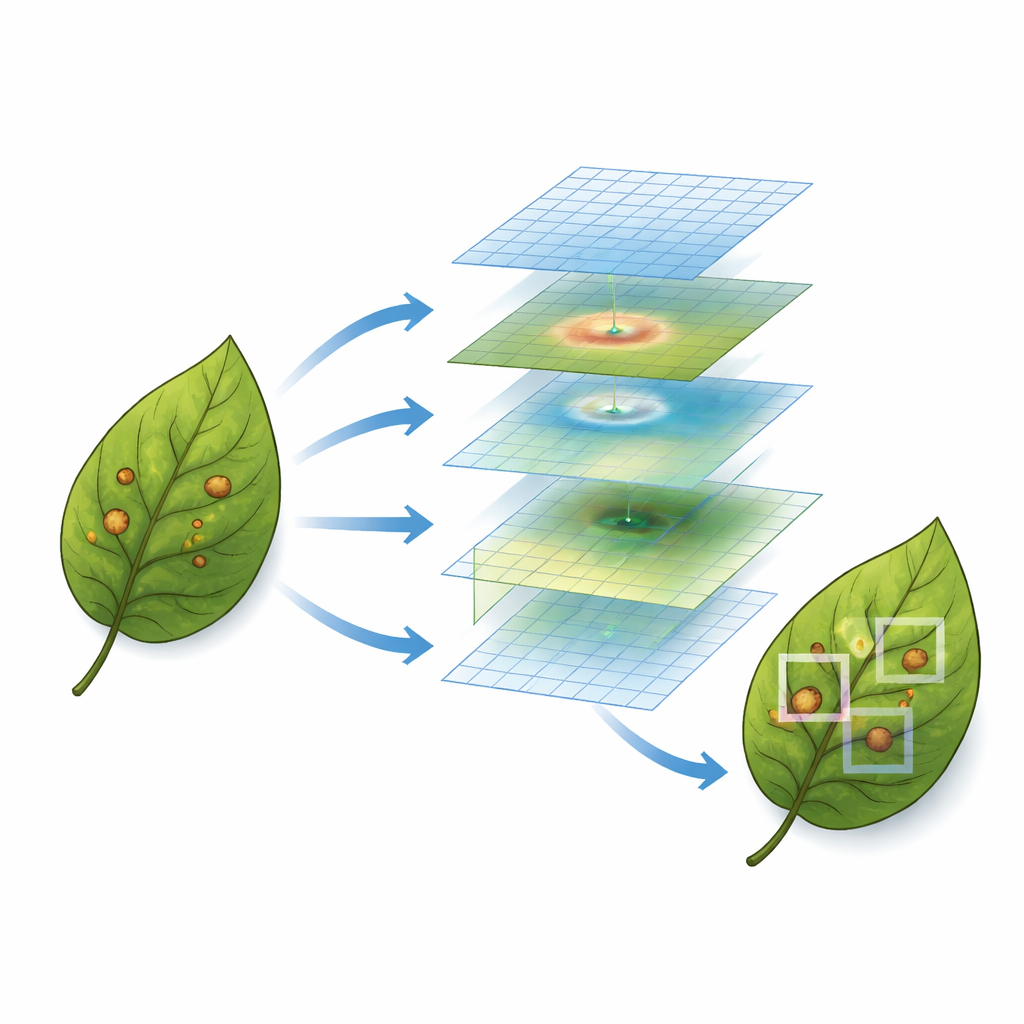

Um diese anspruchsvollen Bilder zu bewältigen, entwickelte das Team ein schlankes Erkennungsmodell namens Extended Feature Single Shot Multibox Detector, kurz EF‑SSD. Im Kern verarbeitet das System vergleichsweise große, detailreiche Bilder (512 × 512 Pixel), sodass schon frühe, stecknadelkopfgroße Flecken sichtbar bleiben. Anders als Standarddetektoren, die Merkmale nur auf wenigen Skalen untersuchen, baut EF‑SSD einen Turm aus zehn Merkmalsschichten auf. Große Schichten erfassen den breiten Kontext, etwa die Form eines ganzen Blattes, während kleinere Schichten feine Texturen und Farbveränderungen fokussieren, die auf erste Infektionsstadien hinweisen. Dieses Multi‑Scale‑Design hilft dem System, sowohl winzige neue Läsionen als auch größere, gut entwickelte Flecken in einem Durchgang zu erkennen.

Dem Modell beibringen, worauf es achten soll

Eine weitere Schlüsselergänzung ist ein Aufmerksamkeitsmechanismus, bekannt als Squeeze‑and‑Excitation. Diese kleinen Module sitzen im Netzwerk und wirken wie einstellbare Lautstärkeregler für die Farb‑ und Texturkanäle des Bildes. Wenn das Modell lernt, dass bestimmte Muster – etwa gesprenkelte braune Ringe oder wassergetränkte Randzonen – mit Krankheit verknüpft sind, erhöht es deren Gewicht, während es ablenkende Hintergrunddetails wie Boden oder benachbarte Pflanzen herunterschaltet. Experimente zeigten, dass das Einfügen dieser Aufmerksamkeitsblöcke in die Mitte des Netzwerks, wo Merkmale noch fein, aber bereits abstrahiert sind, den größten Gewinn bringt und die Erkennungswerte um etwa vier Prozentpunkte verbessert.

Wie es im Vergleich zu Konkurrenzmodellen abschneidet

Die Forscherinnen und Forscher verglichen EF‑SSD mit mehreren verbreiteten Objekterkennungssystemen, darunter YOLOv5, YOLOv8, eine neuere Variante YOLOv12, Faster R‑CNN, RetinaNet und ein transformerbasiertes Modell namens RF‑DETR. Alle Modelle wurden unter identischen Bedingungen am selben Felddatensatz trainiert und getestet. EF‑SSD landete in fast allen Messgrößen an der Spitze: Es identifizierte und lokalisierte Krankheitsregionen mit einer mean Average Precision von 97 Prozent und erreichte eine ausgewogene F1‑Score von 95 Prozent. Die erzeugten Begrenzungsrahmen stimmten zudem eng mit Expertenmarkierungen überein und wiesen hohe Überlappungswerte auf. Trotz seiner tieferen Merkmalshierarchie blieb das Modell effizient und lief auf einer Desktop‑Grafikkarte mit etwa 47 Bildern pro Sekunde, wobei es auch auf kompakten Geräten wie NVIDIA Jetson‑Boards praktikable Geschwindigkeiten beibehielt.

Vom Labor aufs Feld und darüber hinaus

Ein genauerer Blick auf die Ergebnisse zeigt, dass EF‑SSD besonders gut darin ist, kleine, fragmentierte oder teilweise verdeckte Läsionen zu erfassen – genau die Fälle, die in unübersichtlichen Szenen oft anderen Detektoren entgehen. Schalteten die Autorinnen und Autoren die Aufmerksamkeitsmodule ab oder reduzierten die Anzahl der Merkmalsschichten, sank die Leistung deutlich, was bestätigt, dass beide Designentscheidungen wichtig sind. Zwar hat das System weiterhin Schwierigkeiten bei extremen Lichtverhältnissen, starker Unschärfe oder den winzigsten Frühstadien, doch die Studie zeigt, dass ein sorgfältig zugeschnittener, leichtgewichtiger Detektor verlässliches Echtzeit‑Feedback im Feld liefern kann. Für Landwirtinnen und Landwirte ist die praktische Schlussfolgerung klar: Ein kompaktes KI‑Werkzeug, eingebettet in Telefon oder Drohne, könnte bald kranke Kartoffelpflanzen früh genug markieren, um gezielte Behandlungen zu ermöglichen, Ertragsverluste zu vermeiden und unnötigen Chemikalieneinsatz zu reduzieren.

Zitation: Bhavani, G.D., Chalapathi, M.M.V. Lightweight scalable deep learning framework for real time detection of potato leaf diseases. Sci Rep 16, 8770 (2026). https://doi.org/10.1038/s41598-025-33423-7

Schlüsselwörter: Kartoffelblattkrankheit, Pflanzenerkennung von Krankheiten, Deep Learning in der Landwirtschaft, Objekterkennung, Precision Farming