Clear Sky Science · de

CMAF-Net: Cross-Modal Attention Fusion mit informationstheoretischer Regularisierung für unausgewogene histopathologische Befunde bei Brustkrebs

Warum diese Forschung für die Versorgung von Brustkrebspatientinnen wichtig ist

Pathologinnen und Pathologen stellen die Diagnose von Brustkrebs, indem sie dünne Gewebeschnitte unter dem Mikroskop untersuchen. Das Herausfiltern seltener, bösartiger Areale aus einer Fülle gesunder Zellen ist jedoch anspruchsvoll und fehleranfällig. In dieser Studie wird CMAF-Net vorgestellt, ein neues Computersystem, das dabei helfen soll, mehr Krebsfälle in solchen Bildern zu erkennen und gleichzeitig Fehlalarme niedrig zu halten – selbst wenn bösartige Proben weit hinter gesunden zurückbleiben. Seine Fortschritte könnten automatisiertes Screening verlässlicher machen, überlastete Klinikerinnen und Kliniker entlasten und einen Leitfaden zur Erkennung vieler weiterer seltener Krankheiten liefern.

Eine Nadel im Heuhaufen der Gewebebilder finden

In realen klinischen Daten sind die meisten Brustgewebeproben harmlos; nur ein kleiner Teil enthält invasives duktales Karzinom, die häufigste Form von Brustkrebs. Dieses Ungleichgewicht veranlasst viele KI-Systeme stillschweigend dazu, vorzugsweise gesunden Gewebe zu prognostizieren, wodurch gefährliche Tumoren übersehen werden. Gleichzeitig treten Hinweise auf Malignität auf sehr unterschiedlichen Zoomstufen auf – von deformierten Zellkernen einzelner Zellen bis zu gestörten Strukturen über eine ganze Gewebezone. Herkömmliche Bildanalyse-Netze sind entweder gut in feinen Details oder in großen Mustern, vereinen aber selten beides so, dass die seltenen, lebensbedrohlichen Fälle hervorgehoben werden.

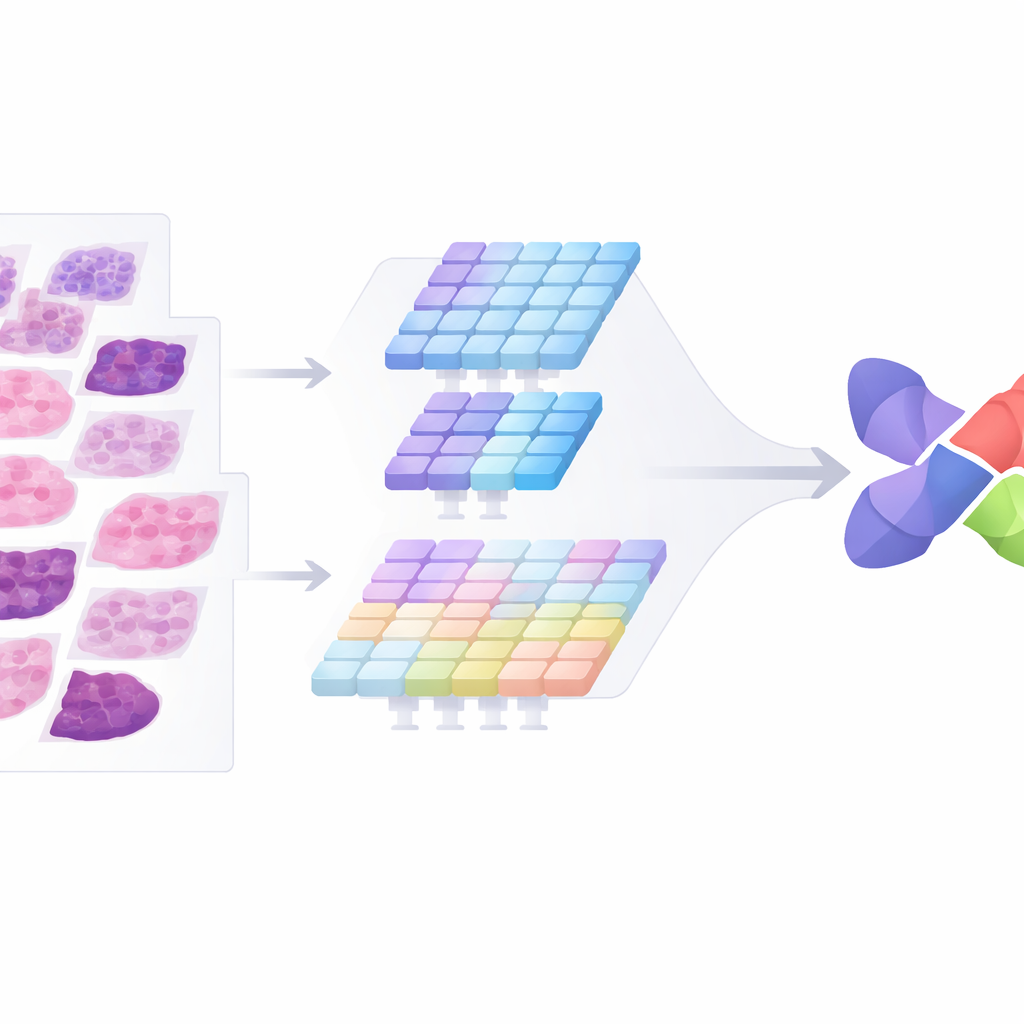

Kombination von Nahaufnahme und Gesamtbild

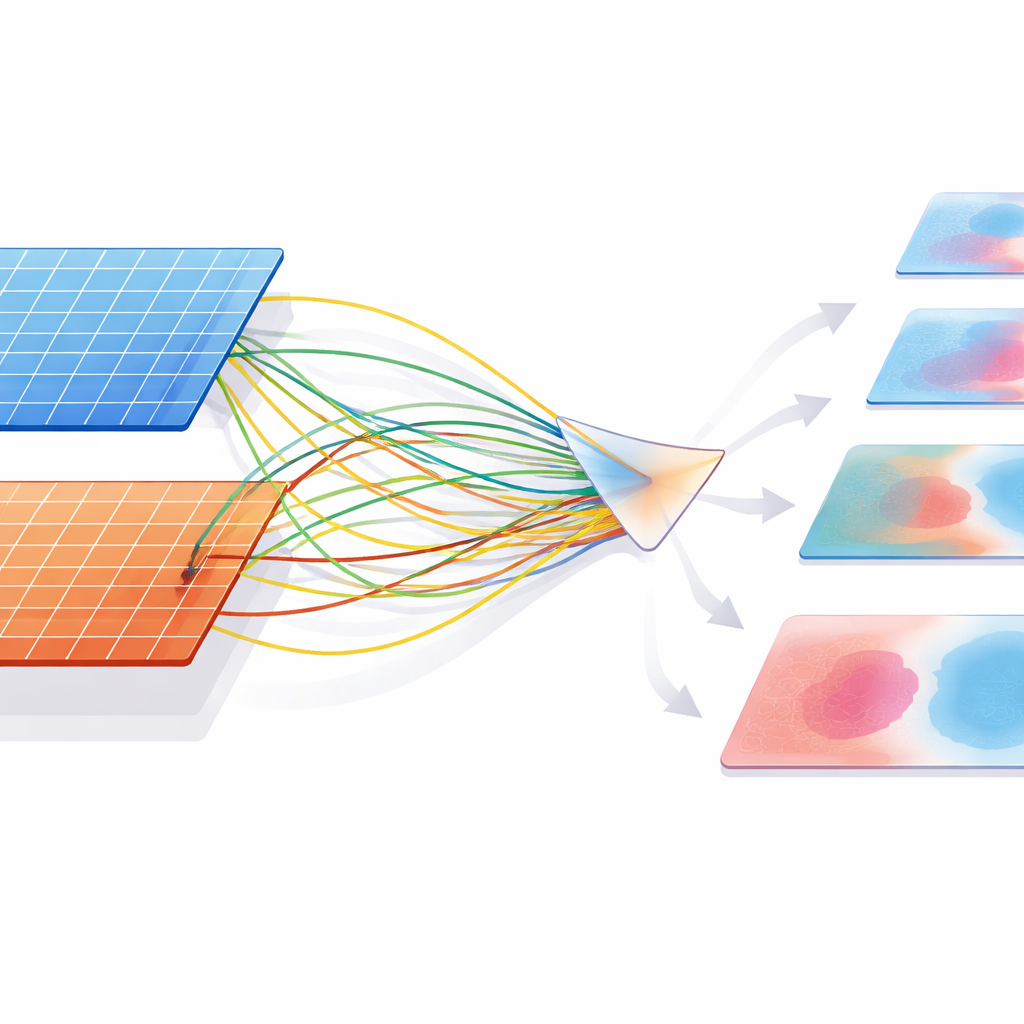

Um diese beiden Probleme anzugehen, entwarfen die Autorinnen und Autoren CMAF-Net mit zwei komplementären „Augen“ für jedes Bild. Ein Zweig agiert wie ein klassischer Mustererkennungsmechanismus, der sich auf feine Texturen spezialisiert – etwa Formen und Anordnungen von Zellen. Der zweite Zweig funktioniert eher wie ein globaler Kartenleser und erfasst größere Gewebsorganisationen mithilfe eines modernen Transformer-Designs. Anstatt diese beiden Sichtweisen einfach übereinander zu legen, leitet das System sie durch einen speziellen Fusionsblock, der den Zweigen den Informationsaustausch über mehrere Aufmerksamkeitskanäle ermöglicht. Dieser Block behält selektiv Merkmale, die neue Einsichten liefern, und unterdrückt gleichzeitig duplizierte oder ablenkende Signale, sodass die endgültige kombinierte Repräsentation sowohl reichhaltig als auch kompakt bleibt.

Dem System beibringen, seltene Krebserkrankungen wichtiger zu nehmen

Selbst eine clevere Architektur kann weiterhin die Mehrheitsklasse bevorzugen, daher überarbeiteten die Forschenden die Art und Weise, wie das System aus seinen Fehlern lernt. Aufbauend auf Ideen aus der Informationstheorie und marginbasiertem Lernen entwickelten sie eine Trainingsregel, die das Modell ausdrücklich dazu drängt, breitere „Sicherheitsabstände“ um die Minderheitsklasse der Krebsfälle zu schaffen. Praktisch bedeutet das: CMAF-Net wird stärker bestraft, wenn es einen malignen Patch übersieht, als wenn es einen benignen falsch klassifiziert, und diese Strafhöhe wird im Verlauf angepasst, während sich der Merkmalsraum entwickelt. Auch der Aufmerksamkeitsmechanismus selbst wird über eine Art „Temperatur“-Steuerung abgestimmt: Schärfere Aufmerksamkeit bewahrt bei Bedarf mehr Information, während weichere Aufmerksamkeit Rauschen herausfiltert und dem Modell eine prinzipielle Methode zur Datenkompression bietet, ohne die Signale zu verlieren, die Krebs von Nicht-Krebs trennen.

Das Verfahren auf die Probe gestellt

Das Team bewertete CMAF-Net an einem großen, natürlich unausgewogenen Datensatz von Brustgewebe-Patches, in dem etwa drei Viertel gutartig und der Rest bösartig war. Im Vergleich zu einer Reihe starker Basissysteme – darunter tiefe Faltungsnetzwerke, Vision Transformer und frühere Fusionsmodelle, die für Ungleichgewicht angepasst wurden – hob sich die neue Methode deutlich ab. Sie identifizierte rund 95 % der malignen Proben korrekt, bei ebenso hoher Spezifität, und das mit weniger Parametern als viele konkurrierende Fusionsnetzwerke. Als die Forschenden die Daten noch stärker verzerrten, bis hin zu nur einem Krebs-Patch auf 99 gutartige, sank die Leistung von CMAF-Net allmählich, blieb jedoch klinisch nützlich. Andere Methoden verloren unter diesen extremen Bedingungen den Großteil ihrer Fähigkeit, Krebs zu erkennen.

Generalisation über Mikroskope und Tumortypen hinweg

Um zu prüfen, ob CMAF-Net lediglich ein Datenset auswendig gelernt oder allgemeinere Krankheitsmuster gelernt hat, testeten die Autorinnen und Autoren das Modell an einer separaten Sammlung von Brusttumorbildern aus anderen Patientinnen und in vier verschiedenen Vergrößerungsstufen. Ohne erneutes Training behielt das Modell eine hohe Sensitivität über alle Zoomstufen und übertraf frühere Ansätze sowohl bei einfachen gutartig-vs-bösartig-Aufgaben als auch bei einer anspruchsvolleren Acht-Klassen-Aufgabe mit mehreren Tumoruntertypen. Auffällig zeigte CMAF-Net die größten Verbesserungen bei seltenen Tumorkategorien, was darauf hindeutet, dass sein Fokus auf informations-effizienter Fusion und klassenbewusstem Lernen ihm hilft, subtile, ungewöhnliche Muster zu unterscheiden und nicht nur die typischsten Fälle.

Was das künftig bedeutet

Für Nicht-Spezialistinnen und Nicht-Spezialisten ist die Kernbotschaft: CMAF-Net bietet eine intelligentere Art, wie Computer Pathologie-Schnitte lesen können – es schaut gleichzeitig nah und weit, lernt, seltene aber gefährliche Krebszeichen besonders zu beachten, und bleibt leistungsfähig, auch wenn mal wenige maligne Beispiele zur Verfügung stehen. Über Brustkrebs hinaus könnten dieselben Gestaltungsprinzipien Werkzeuge zur Erkennung seltener Erkrankungen in vielen Arten medizinischer Bilder leiten und Ärztinnen und Ärzten eine verlässlichere zweite Meinung liefern sowie möglicherweise frühere und genauere Diagnosen für die Patientinnen und Patienten bringen, die sie am dringendsten benötigen.

Zitation: Ativi, W.X., Chen, W., Kwao, L. et al. CMAF-Net: cross-modal attention fusion with information-theoretic regularization for imbalanced breast cancer histopathology. Sci Rep 16, 9607 (2026). https://doi.org/10.1038/s41598-025-32794-1

Schlüsselwörter: Brustkrebs, Histopathologie KI, Klassenungleichgewicht, Deep Learning, medizinische Bildanalyse