Clear Sky Science · de

Bewertung der Wirksamkeit der ZICOMP‑Shewhart‑Regelkarte zur Überwachung von nullaufgeblähten Prozessen

Warum viele Nullen trotzdem wichtig sind

Moderne Fabriken, Krankenhäuser und Computersysteme arbeiten oft so zuverlässig, dass Probleme selten auftreten. Qualitätsprotokolle können lange Abschnitte perfekter Einheiten — null Fehler — zeigen, unterbrochen von gelegentlichen Ausbrüchen von Störungen. Auf den ersten Blick ist das eine gute Nachricht, doch tatsächlich erschwert es die Erkennung, wann ein Prozess heimlich aus der Kontrolle gerät. Dieser Artikel behandelt diese Herausforderung, indem er ein spezialisiertes statistisches Werkzeug entwickelt und prüft — die ZICOMP‑Shewhart‑Regelkarte — die für die Überwachung von Prozessen konzipiert ist, in denen „nichts passiert“ den Großteil der Zeit, aber nicht immer.

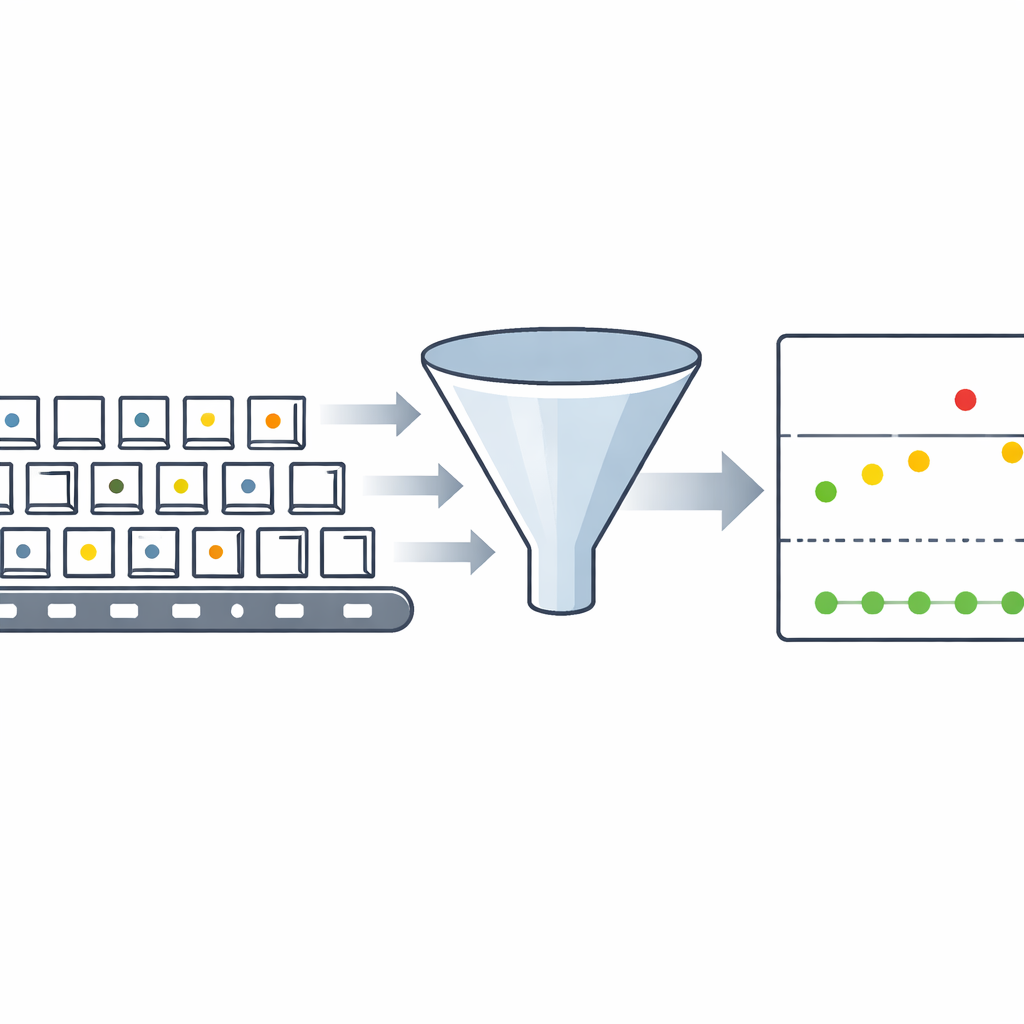

Qualität im Zeitverlauf beobachten

In der Qualitätskontrolle verwenden Ingenieure Regelkarten, um das Verhalten eines Prozesses über die Zeit nachzuverfolgen. Jede neue Charge, jedes Teil oder jeder Zeitraum wird als Punkt auf der Karte zusammengefasst. Solange die Punkte innerhalb der erwarteten Grenzen bleiben, gilt der Prozess als stabil; überschreiten sie eine Grenze, wird Alarm ausgelöst und der Prozess untersucht. Traditionelle Karten funktionieren gut, wenn die Anzahl der Fehler einfachen Mustern folgt, wie der vertrauten Poisson‑Verteilung. In vielen modernen „hochleistungsfähigen“ Prozessen — etwa in der Festplattenfertigung oder beim Fehler‑Monitoring in Rechenzentren — sind jedoch die meisten Beobachtungen genau null, nur wenige sind ungleich null. Standardmodelle unterschätzen diesen Überschuss an Nullen und verkennen häufig das Ausmaß der Variabilität, was wichtige Warnungen verzögern oder verschleiern kann.

Den Nullen ein eigenes Modell geben

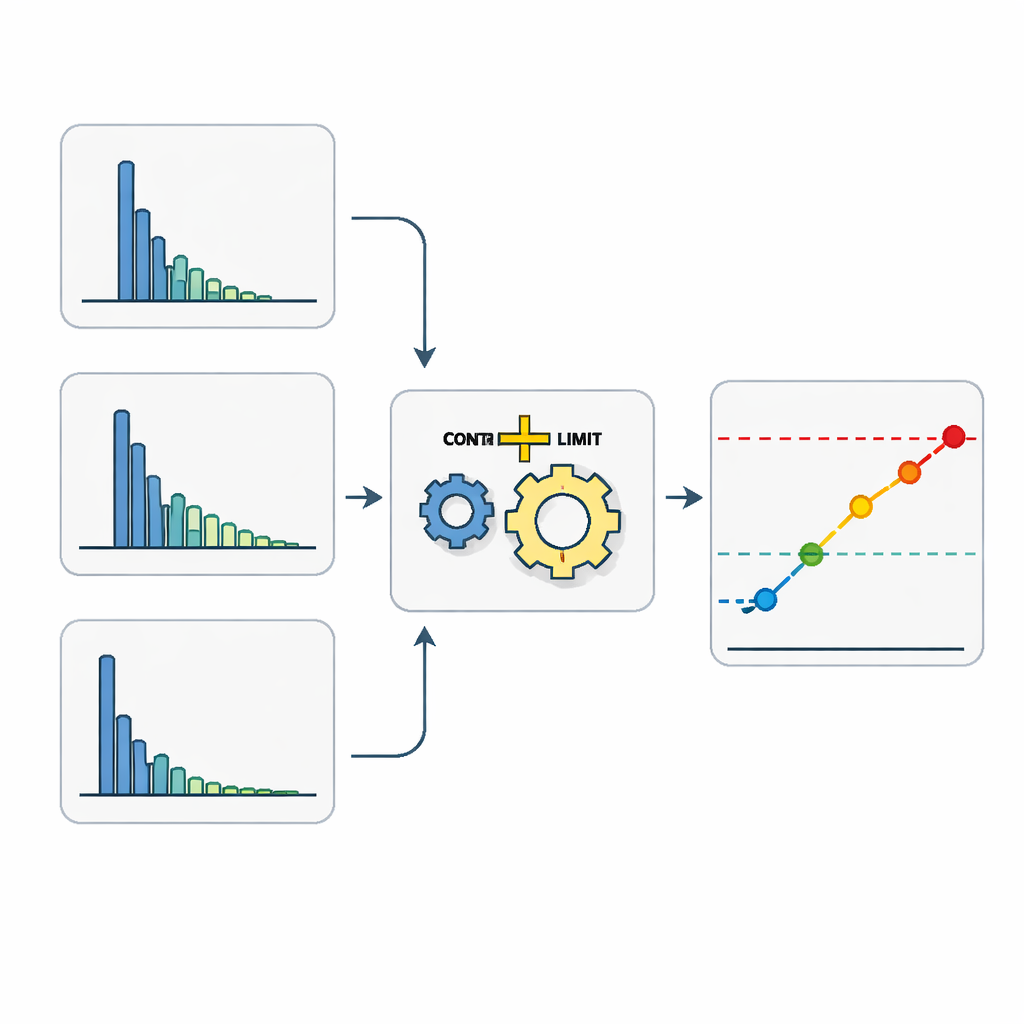

Die Autoren bauen auf einer flexiblen Modellfamilie auf, der Conway–Maxwell–Poisson (COMP)‑Verteilung, die Daten behandeln kann, die variabler oder weniger variabel als der klassische Poisson‑Fall sind. Sie erweitern sie zur nullaufgeblähten COMP‑Verteilung (ZICOMP), die zwei Bestandteile explizit trennt: die Wahrscheinlichkeit, dass ein Ergebnis überhaupt null ist, und das Muster der nicht‑nullen Zählwerte, wenn Probleme auftreten. Dadurch kann sich das Modell an drei häufige Situationen anpassen: stark variable Daten mit langen rechtsschiefen Verteilungen, ungefähr ausgewogene Daten und eng gebündelte Daten mit geringer Streuung. Die ZICOMP‑Shewhart‑Regelkarte nutzt diese reichere Beschreibung, um eine einzelne obere Grenze festzulegen, die auf Prozesse abgestimmt ist, bei denen Nullen besonders häufig sind.

Schlauere Alarmgrenzen entwerfen

Eine zentrale praktische Frage ist, wie hoch die Alarmgrenze gesetzt werden soll. Liegt sie zu niedrig, ruft die Karte fälschlich Alarm; ist sie zu hoch, werden echte Probleme übersehen. Die Autoren verwenden großangelegte Computersimulationen, um zu untersuchen, wie ein „Grenzkoeffizient“ diesen Zielkonflikt steuert. Sie betrachten zwei wichtige Leistungsmaße. Eines ist die durchschnittliche Lauflänge (average run length), also die erwartete Anzahl von Stichproben bis zum Signal der Karte; das spiegelt wider, wie häufig Fehlalarme auftreten, wenn der Prozess gesund ist. Das andere ist der Typ‑II‑Fehler, die Wahrscheinlichkeit, dass die Karte nicht signalisiert, obwohl der Prozess tatsächlich verschoben ist. Durch Durchlaufen vieler Kombinationen von Modellparametern — für unterschiedliche Variabilitätsstufen und unterschiedliche Grade der Nullaufblähung — zeigen sie, wie der Grenzkoeffizient so gewählt werden kann, dass eine gewünschte durchschnittliche Lauflänge erreicht wird, während verpasste Signale auf einem akzeptablen Niveau bleiben, selbst wenn die Diskretheit der Daten eine perfekte Abstimmung unmöglich macht.

Die Methode im Praxistest

Um das Verhalten ihrer Karte in realistischen Situationen zu prüfen, vergleichen die Autoren sie mit einem konkurrierenden Entwurf, der keine spezielle Behandlung für Nullen annimmt und nur die COMP‑Verteilung verwendet. In mehrfachen simulierten Szenarien stellen sie wiederholt fest, dass die ZICOMP‑Shewhart‑Karte Verschiebungen der Fehlerquote früher und häufiger erkennt, unabhängig davon, ob die Daten stark variabel, mäßig variabel oder eng gebündelt sind. In einer Fallstudie mit realen Lese‑/Schreibfehlerdaten von Festplatten — bei denen lange Phasen fehlerfreier Operationen von Ausbrüchen von Ausfällen unterbrochen werden — erkennt die neue Karte erfolgreich eine Veränderung nach einer Folge von Nullen, gefolgt von größeren Zählwerten, und zeigt so, wie sie in hochzuverlässigen Umgebungen als Frühwarnsystem dienen kann.

Was das in der Praxis bedeutet

Für Praktiker lautet die Botschaft, dass das Ignorieren der besonderen Rolle der Nullen wichtige Signale über den Zustand eines Prozesses verschleiern kann. Indem man eine Regelkarte um ein Modell herum aufbaut, das sowohl zusätzliche Nullen als auch ungewöhnliche Variationsmuster erkennt, liefert die ZICOMP‑Shewhart‑Karte ein verlässlicheres Bild dafür, wann ein Prozess wirklich von seinem beabsichtigten Verhalten abweicht. Obwohl die Leistung weiterhin davon abhängt, wie gut die zugrunde liegenden Parameter geschätzt werden, und zukünftige Arbeiten diese Schätzungen weiter verfeinern könnten, zeigt diese Studie, dass die Anpassung statistischer Werkzeuge an die Eigenheiten realer Daten die Qualitätsüberwachung empfindlicher, vertrauenswürdiger und letztlich besser darin machen kann, kostspielige Ausfälle zu verhindern.

Zitation: Sattar, A., Raza, M.A., AL-Essa, L.A. et al. Assessing the effectiveness of the ZICOMP-Shewhart control chart for monitoring zero-inflated processes. Sci Rep 16, 8269 (2026). https://doi.org/10.1038/s41598-025-32581-y

Schlüsselwörter: nullaufgeblähte Zähldaten, statistische Prozesskontrolle, Qualitätsregelkarten, Conway‑Maxwell‑Poisson, Fertigungsfehler