Clear Sky Science · de

Erkennung getarnter Objekte durch kontext‑ und textur‑bewusste hierarchische Interaktion

Warum das Entdecken versteckter Formen wichtig ist

Von blattgrünen Insekten über militärische Tarnung bis hin zu schwer erkennbaren Läsionen in medizinischen Untersuchungen: Unsere Welt ist voll von Dingen, die darauf ausgelegt sind, im Hintergrund zu verschwinden. Computern beizubringen, solche versteckten Objekte zuverlässig zu finden, könnte helfen, Wildleben zu schützen, Sicherheitsinspektionen zu verbessern und Ärztinnen und Ärzten zu ermöglichen, Krankheiten früher zu erkennen. Dieses Paper stellt ein neues KI‑System namens CTHINet vor, das lernt, durch Tarnung hindurchzusehen, indem es nicht nur auf den Gesamtzusammenhang einer Szene achtet, sondern auch auf winzige Texturhinweise, die dem menschlichen Auge oft entgehen.

Den Wald sehen und die Bäume

Die Erkennung getarnter Objekte ist deutlich anspruchsvoller als gewöhnliche Objekterkennung, weil das Zielobjekt häufig in Farbe, Helligkeit und Form seiner Umgebung ähnelt. Frühere Computermethoden stützten sich auf einfache, von Hand entwickelte Hinweise wie Bewegung, Kanten oder grundlegende Textur, die in überladenen oder verrauschten Szenen versagen. Moderne Deep‑Learning‑Ansätze haben Fortschritte erzielt, indem sie große Netze auf spezialisierten Bildsammlungen mit getarnten Tieren und menschengemachten Objekten trainieren. Viele dieser Methoden fügen zusätzliche Hinweise hinzu, etwa das Hervorheben von Begrenzungen oder das Abschätzen von Unsicherheit, doch sie lassen sich leicht irreführen, wenn die Kanten selbst unscharf oder mehrdeutig sind — genau der Fall bei guter Tarnung.

Winzige Texturhinweise, die das Versteck verraten

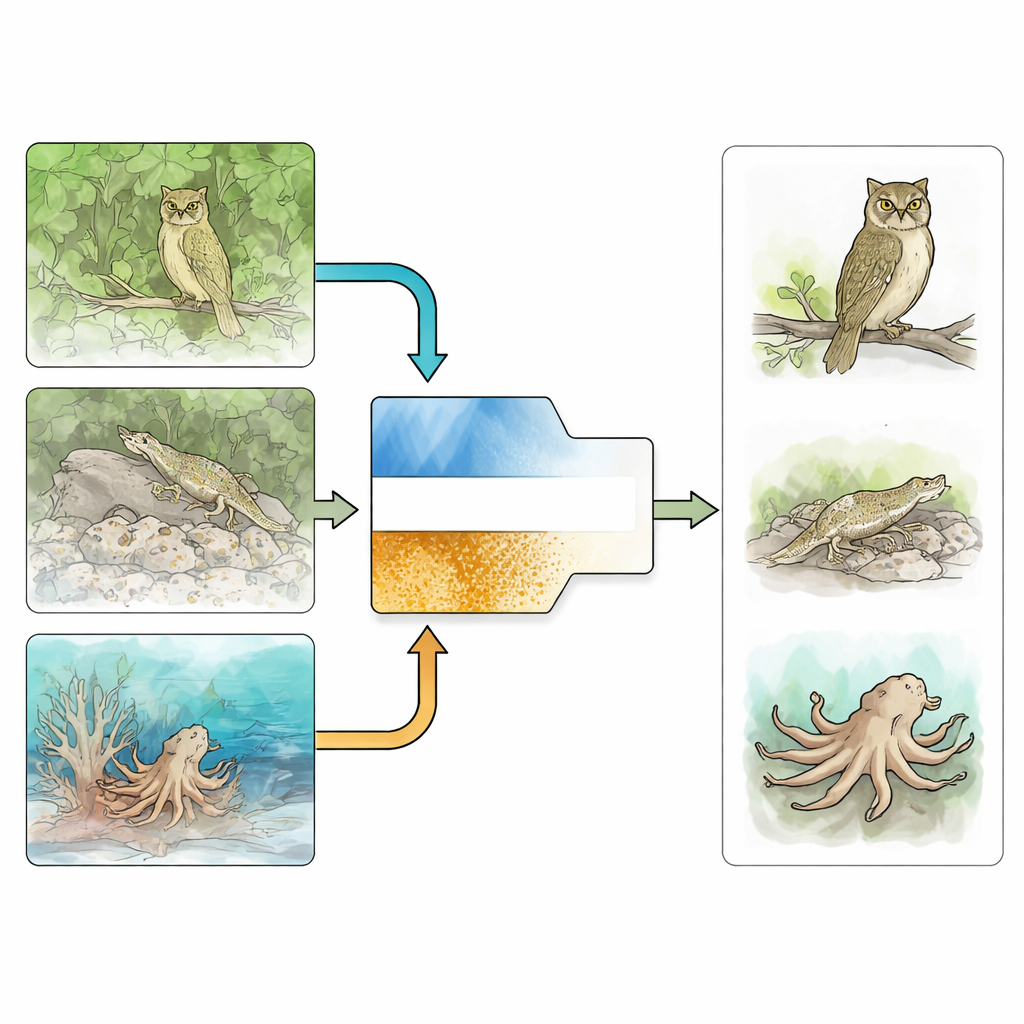

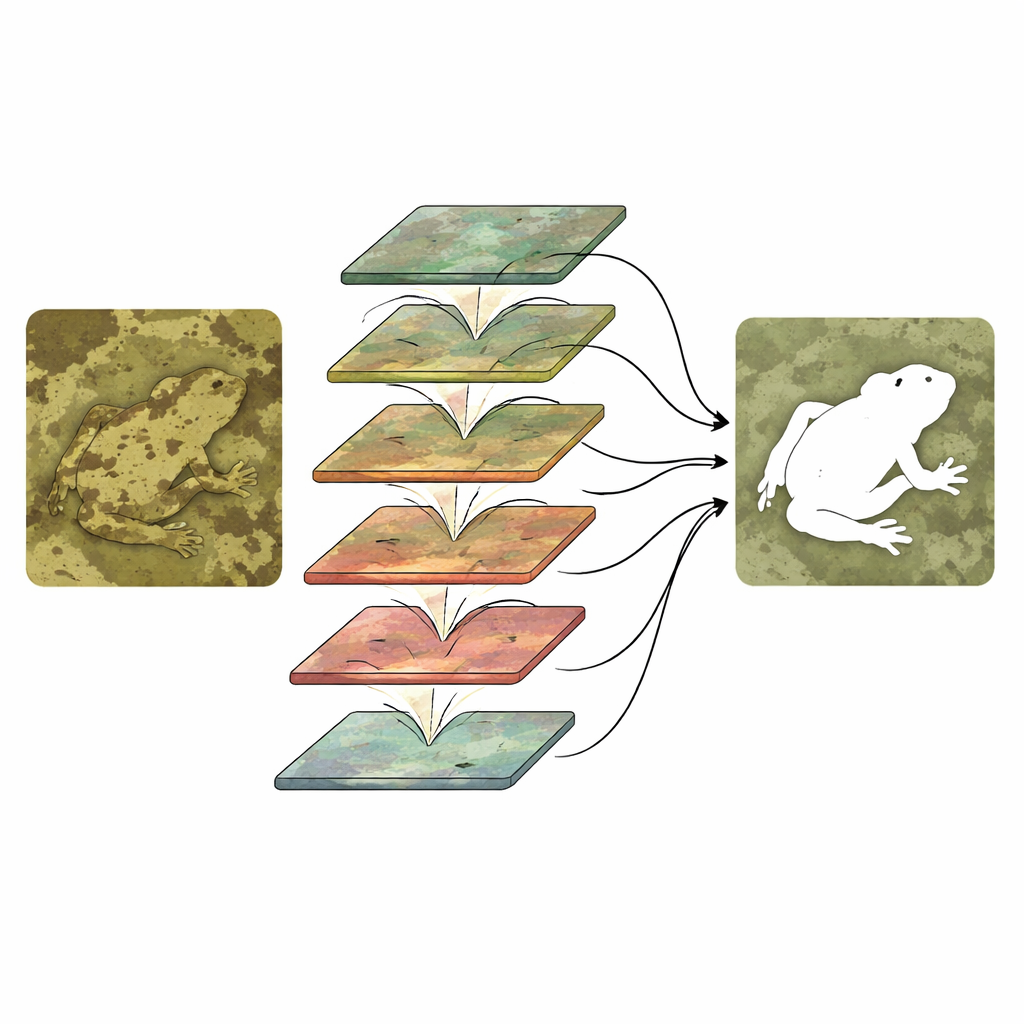

Die Autorinnen und Autoren argumentieren, dass selbst beste Tarnung verräterische Spuren in der feinen Textur eines Bildes hinterlässt — kleine Unterschiede in Körnung, Muster oder Glätte, die leicht übersehen werden, wenn man sich nur auf Konturen konzentriert. Aufbauend auf dieser Idee trennt CTHINet das Lernen in zwei koordinierte Zweige. Ein „Kontext“-Zweig, basierend auf einem leistungsfähigen Vision‑Transformer‑Backbone, erfasst breite, mehrskalige Informationen über die gesamte Szene: wie Regionen zueinander stehen, wo sich große Formen befinden und welche Bereiche plausibel ein Objekt enthalten könnten. Parallel dazu konzentriert sich ein dedizierter „Textur“-Zweig eng auf subtile Oberflächenmuster und wird mit speziellen Textur‑Labels trainiert, die dem Netzwerk sagen, welche feinen Details zum verdeckten Objekt und welche zum Hintergrund gehören.

Wie die beiden Zweige zusammenarbeiten

Einfach zwei Zweige parallel laufen zu lassen, reicht nicht; sie müssen auf intelligente Weise interagieren. CTHINet verfeinert zunächst die Kontextmerkmale mithilfe eines Multi‑head Feature Aggregation Module. Dieses Modul teilt die Informationen in mehrere Teile, die jeweils mit einer anderen effektiven „Zoomstufe“ verarbeitet werden, sodass das System auf winzige Insekten ebenso reagieren kann wie auf große Tiere. Anschließend werden diese Perspektiven so wieder zusammengeführt, dass sie einander informieren, ohne die Rechenkosten explodieren zu lassen. Danach verknüpft eine Reihe von Hierarchical Mixed‑scale Interaction Modules die Kontext‑ und Textur‑Ströme. In jedem Stadium gruppiert und mischt das Netzwerk Kanäle aus beiden Zweigen, lässt sie Informationen austauschen und gewichtet sie anschließend neu, sodass die informativsten Kombinationen verstärkt und weniger nützliche unterdrückt werden. Dieses grob‑zu‑fein‑Stapeln schärft schrittweise die Kontur eines verdeckten Objekts und trennt es von ablenkenden Hintergrunddetails.

Bewährung in freier Wildbahn und in der Klinik

Zur Evaluation von CTHINet testeten die Forschenden es auf drei herausfordernden öffentlichen Benchmarks mit getarnten Tieren und Objekten, die Tausende Bilder in unterschiedlichen natürlichen Umgebungen enthalten. Über mehrere standardisierte Genauigkeitsmaße hinweg übertraf die neue Methode beständig mehr als zwanzig führende Systeme, insbesondere in schwierigen Szenen mit kleinen Zielen, starker Hintergrundanpassung oder teilweiser Verdeckung. Das Team wandte das gleiche Netzwerk mit minimalen Änderungen auch auf eine medizinische Aufgabe an: die Segmentierung von Polypen in Koloskopiebildern. Polypen gehen häufig auf ähnliche Weise in der Darmwand auf wie Tiere im Blattwerk. Auch hier lieferte CTHINet die besten Ergebnisse unter mehreren starken Modellen für medizinische Bildverarbeitung, was darauf hindeutet, dass die Kombination von Kontext und Textur breit nutzbar ist.

Was das Finden des Beinahe‑Unsichtbaren bedeutet

Alltäglich ausgedrückt verkörpert CTHINet eine einfache, aber kraftvolle Einsicht: Um etwas zu finden, das verborgen sein soll, muss ein Computer sowohl das große Ganze als auch die winzigsten Oberflächendetails betrachten und diese beiden Blickwinkel Schritt für Schritt ineinander überführen lassen. Indem die Autorinnen und Autoren ein Netzwerk entwerfen, das diese Rollen sauber trennt und sie dann durch sorgfältig abgestufte Interaktionen wieder zusammenführt, erreichen sie eine genauere Erkennung getarnter Ziele und zeigen Potenzial für medizinische und industrielle Inspektionsaufgaben, bei denen wichtige Strukturen leicht übersehen werden können. Mit dem weiteren Wachstum bildlicher Daten könnten solche kontext‑ und textur‑bewussten Systeme zu wichtigen Werkzeugen werden, um zu enthüllen, was verborgen bleiben sollte.

Zitation: Wang, Z., Deng, Y., Shen, C. et al. Camouflaged object detection via context and texture-aware hierarchical interaction. Sci Rep 16, 9328 (2026). https://doi.org/10.1038/s41598-025-32409-9

Schlüsselwörter: Erkennung getarnter Objekte, Computer Vision, Texturanalyse, Segmentierung medizinischer Bilder, Tiefes Lernen