Clear Sky Science · de

Inkrementeller Lernansatz für die semantische Segmentierung von Hauthistologiebildern

Warum es wichtig ist, Computern das Lesen von Hautproben beizubringen

Hautkrebs gehört zu den weltweit häufigsten Krebsarten, und Ärztinnen und Ärzte stützen sich häufig auf dünne Gewebeschnitte, die unter dem Mikroskop betrachtet werden, um die Schwere eines Tumors und die geeignete Therapie zu bestimmen. Das Lesen dieser Präparate ist zeitaufwendig, anspruchsvoll und kann von Expertin zu Expert variieren. Diese Studie untersucht, wie man Computersysteme entwickelt, die lernen, verschiedene Hautgewebe und Krebserkrankungen in diesen Mikroskopbildern zu erkennen und — wichtig — im Laufe der Zeit besser zu werden, wenn neue Bildtypen hinzukommen, ähnlich wie ein menschlicher Auszubildender, der sich über die gesamte Karriere weiterentwickelt.

Von einfachen Ja‑Nein-Antworten zu detaillierten Gewebekarten

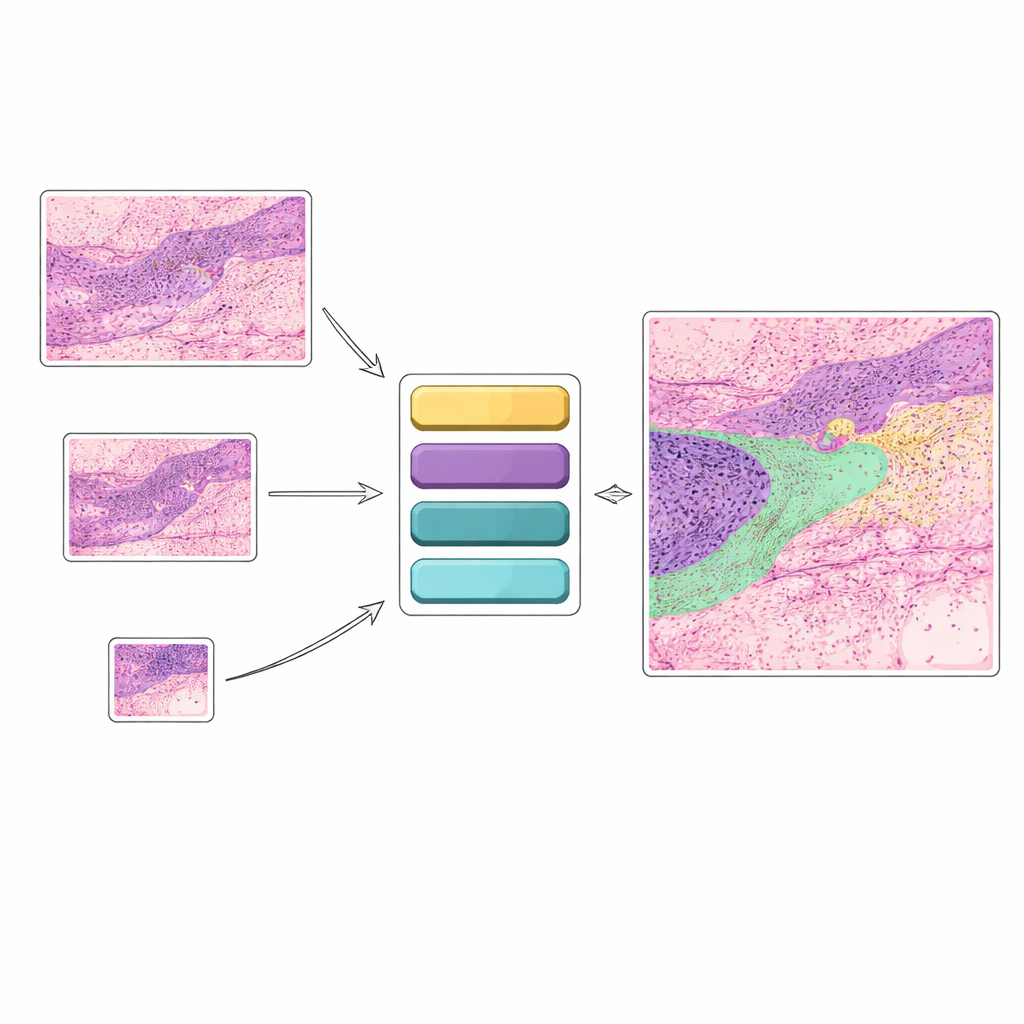

Viele vorhandene KI‑Werkzeuge für Hautkrebs beantworten ein Bild mit einer engen Frage wie „Krebs“ oder „kein Krebs“. Zwar nützlich, erfasst diese Art von Ja‑Nein‑Entscheidung nicht die reichhaltigen Details, die Pathologen sehen. In der Praxis sind Ärztinnen und Ärzte an vielen Strukturen gleichzeitig interessiert: unterschiedliche Krebsarten, gesunde Hautschichten, Haarfollikel, Drüsen, entzündete Bereiche und mehr. Diese Studie konzentriert sich stattdessen auf die „semantische Segmentierung“, bei der jedem Pixel eines Histologiebilds eine von zwölf Gewebekategorien zugewiesen wird. Das ergibt eine farblich kodierte Karte, die genau zeigt, wo verschiedene Krebsarten und normale Gewebe liegen, und damit klarere Hinweise für Diagnose und Therapieplanung liefert.

Warum aktuelle intelligente Systeme Schwierigkeiten haben, sich anzupassen

Die heute leistungsfähigen Deep‑Learning‑Modelle gehen meist davon aus, dass alle Trainingsdaten auf einmal verfügbar sind. Einmal trainiert, neigen sie dazu, ihr Wissen zu „versiegeln“. Werden später neue Daten mit anderen Eigenschaften — etwa Bilder mit anderer Vergrößerung — eingeführt, ist die sicherste Option oft, das gesamte Modell von Grund auf neu zu trainieren. Das ist kostspielig und zeitaufwendig, und noch schlimmer: Neue Informationen können zu „katastrophalem Vergessen“ führen, bei dem die Leistung in früheren Aufgaben leise nachlässt. In klinischen Umgebungen verändern sich Daten jedoch ständig, wenn Scanner aufgerüstet werden, Bildgebungsparameter wechseln und Krankenhäuser neue Probenarten sammeln. Ein KI‑Werkzeug, das solche Änderungen nicht elegant aufnehmen kann, ist im Alltag schwer vertrauenswürdig.

Eine schrittweise Lernstrategie, inspiriert vom menschlichen Lernen

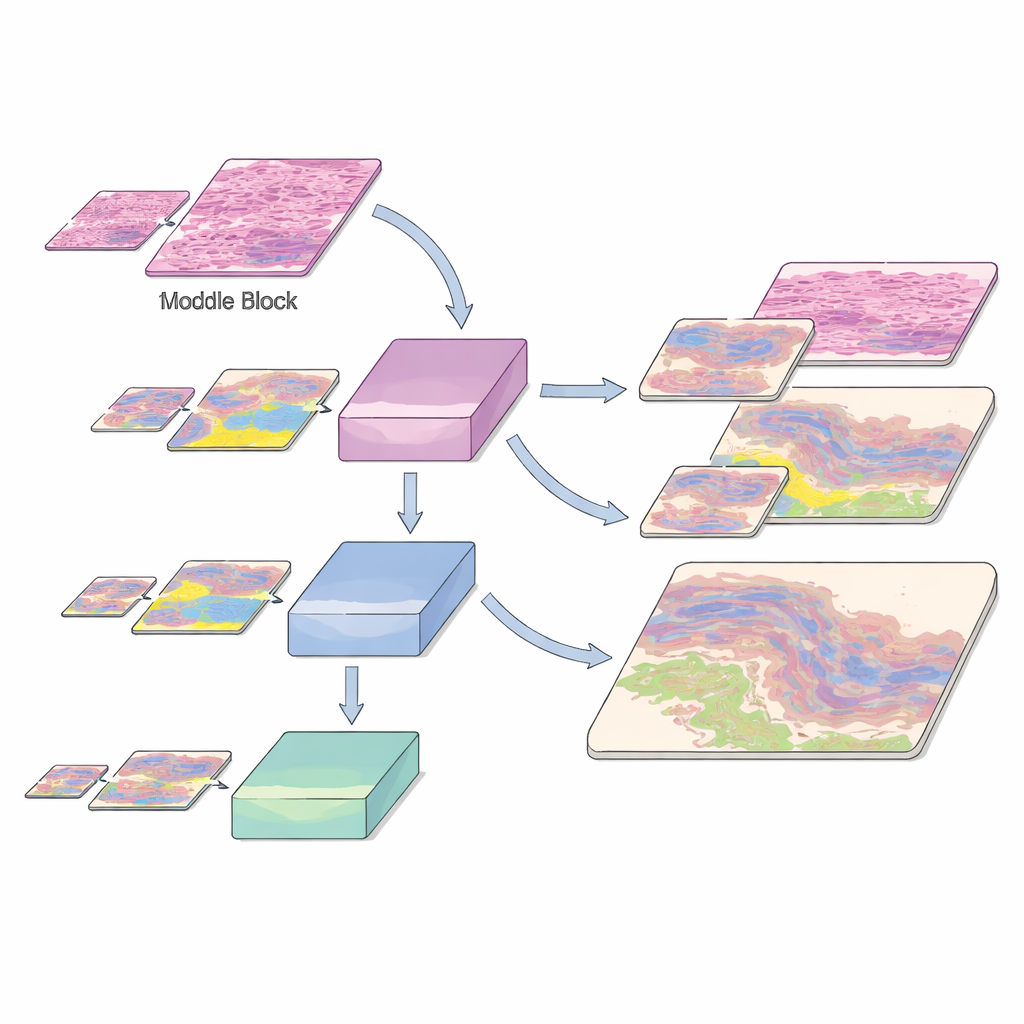

Die Autorinnen und Autoren bauen auf einer modernen Vision‑Transformer‑Architektur namens SegFormer auf und verwandeln sie in ein inkrementelles Lernsystem für nicht‑melanozytären Hautkrebs. Statt alle Daten gleichzeitig zu sehen, wird das Modell in Stufen mit Histologieschnitten aus einem öffentlichen Datensatz der Queensland University trainiert. Zuerst lernt es an hochvergrößerten (10×) Bildern, in denen feine Details deutlich sind. Später werden Bilder mit 5× und schließlich 2× Vergrößerung hinzugefügt, während ein Teil der früheren hochdetaillierten Daten im Mix erhalten bleibt. Spezielle Verlustfunktionen helfen der neuen Modellversion, das zuvor Gelernte über Gewebemuster zu bewahren, während sie sich an die gröberen, weiter herausgezoomten Ansichten anpasst. Dieses „Lernen ohne Vergessen“ wird durch eine Technik namens Knowledge Distillation gesteuert, bei der ein früheres Modell als Lehrer für das neue fungiert, sowie durch einen gegenseitigen Distillationsbegriff, der alte und neue Repräsentationen in Einklang hält.

Lernen über Zoomstufen und seltene Gewebetypen hinweg

Histologiebilder sind nicht nur wegen der vielen Gewebetypen herausfordernd, sondern auch, weil einige wichtige Strukturen selten vorkommen. Der Datensatz enthält häufige Krebsarten wie Basalzellkarzinom und Plattenepithelkarzinom sowie normale und entzündete Hautschichten, die jeweils von Expertinnen und Experten auf Pixelebene annotiert wurden — ein mühsamer Prozess, der Hunderte von Stunden in Anspruch nimmt. Die Autorinnen und Autoren zerschneiden diese riesigen Schnitte in kleine Patches und trainieren ihr Modell unter sorgfältiger Aufteilung in Trainings-, Validierungs‑ und Testsets, wobei die Mischung der Gewebeklassen bei jeder Vergrößerung erhalten bleibt. Um dem System zu helfen, seltene, aber klinisch wichtige Regionen zu erkennen, verstärken sie unterrepräsentierte Klassen durch Rotation der Patches und indem sie das Modell diesen Geweben auf mehreren Zoomstufen aussetzen. Diese Mehrauflösungs‑Exposition hilft der KI, dieselbe biologische Struktur zu erkennen, egal ob sie als scharfes Nahaufnahmebild oder als weichere, herausgezoomte Form erscheint.

Was das Modell im Vergleich zu früheren Werkzeugen erreicht

Für sich genommen übertreffen SegFormer‑Modelle, die getrennt für jede Vergrößerung trainiert werden, bereits viele frühere Faltungsnetz‑Designs wie U‑Net in zahlreichen Gewebekategorien. Wendet man jedoch das inkrementelle Lernschema an — zuerst Training bei 10×, dann bei 10× plus 5× und schließlich gemeinsam bei 10×, 5× und 2× — werden die Verbesserungen deutlich. Die Gesamtgenauigkeit steigt von etwa 89 % bei ausschließlich 10×‑Bildern auf über 95 %, nachdem alle drei Vergrößerungen einbezogen wurden. Auch Maße der Überlappung zwischen vorhergesagten und tatsächlichen Regionen verbessern sich stetig, und die Leistung bei Krebsarten wie Basalzell‑ und Plattenepithelkarzinom sowie bei wichtigen normalen Schichten wie Epidermis und papillärem Dermis übertrifft konkurrierende Methoden. Wichtig ist: Mit jeder hinzugefügten Zoomstufe vergisst das Modell nicht, was es zuvor gelernt hat; stattdessen wird sein Verständnis der Gewebestruktur robuster und allgemeiner.

Wie diese Arbeit die KI‑gestützte Diagnostik näher an die Klinik bringt

Für Nicht‑Spezialisten lautet die Kernbotschaft, dass die Autorinnen und Autoren einen Kartenmacher für Hautgewebe entwickelt haben, der weiter lernen kann, wenn neue Bildarten hinzukommen, ohne seine bisherigen Fähigkeiten zu verlieren. Durch sorgfältiges Design des stufenweisen Lernens und die Wiederverwendung des eigenen Vorwissens zeigen sie, dass es möglich ist, KI‑Werkzeuge zu bauen, die sich an die Entwicklung der medizinischen Bildgebung anpassen. Zwar sind weitere Validierungen über verschiedene Krankenhäuser und Krankheitsarten hinweg nötig, doch dieser inkrementelle, transformer‑basierte Ansatz weist in Richtung KI‑Systeme, die mit wechselnden Daten auf dem Laufenden bleiben, detaillierte visuelle Erklärungen liefern, wo Krebsherde liegen, und letztlich Pathologinnen und Pathologen dabei unterstützen können, sicherere und konsistentere Therapieentscheidungen zu treffen.

Zitation: Fatima, S., Salam, A.A., Akram, M.U. et al. Incremental learning approach for semantic segmentation of skin histology images. Sci Rep 16, 9593 (2026). https://doi.org/10.1038/s41598-025-31553-6

Schlüsselwörter: Hautkrebs, Histologiebilder, semantische Segmentierung, inkrementelles Lernen, Deep-Learning-Transformer