Clear Sky Science · de

Ein zeitlich synchronisiertes Multi-Sensor-Drohnen-Datensatz, aufgenommen von mehreren Radaren und einem RF-Empfänger

Warum es wichtig ist, den Himmel zu beobachten

Drohnen haben sich schnell von Spielzeugen und Filmwerkzeugen zu unverzichtbaren Geräten für Lieferung, Inspektion, Landwirtschaft und mehr entwickelt. Dieselben kleinen Fluggeräte, die uns nützen, können jedoch auch für Spionage, Schmuggel oder sogar Angriffe missbraucht werden. Gefährliche Drohnen zu stoppen ist schwierig, weil sie klein, schnell und oft in unübersichtlichen, realen Umgebungen unterwegs sind. Dieser Artikel stellt einen neuen offenen Datensatz vor, der Forschenden und Ingenieurinnen hilft, intelligentere Systeme zu entwickeln, die Drohnen anhand ihrer unsichtbaren Funk‑Fingerabdrücke erkennen, verfolgen und identifizieren — und nicht nur anhand ihres Aussehens oder Klangs.

Drohnen mit unsichtbaren Wellen belauschen

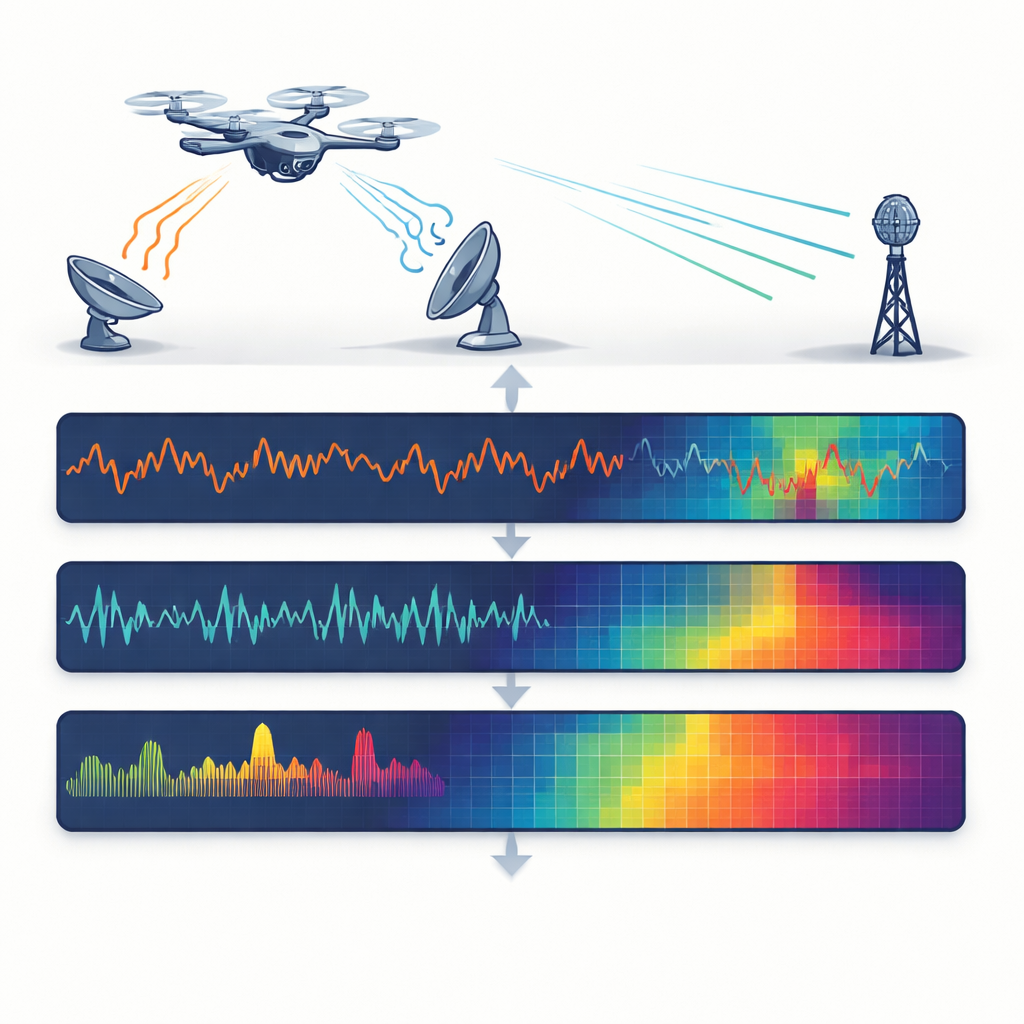

Anstatt sich auf Kameras oder Mikrofone zu stützen, konzentrieren sich die Forschenden auf Funkwellen, die bei Tag und Nacht sowie bei Nebel, Regen oder Blendlicht funktionieren. Sie setzen drei verschiedene funkbasierte Sensoren gleichzeitig ein: ein Radar, das ein stetiges Signal aussendet, um Bewegung zu erfassen; ein weiteres Radar, das seine Frequenz durchfegt, um sowohl Distanz als auch Geschwindigkeit zu messen; und einen Funkempfänger, der einfach die Steuer‑ und Videosignale der Drohne abhört. Jeder Sensor nimmt die Drohne auf eine andere Weise wahr — durch winzige Vibrationen der rotierenden Rotorblätter, durch die veränderliche Entfernung zum Sensor oder durch die Struktur der drahtlosen Verbindung — ähnlich wie die Kombination von Sehen, Hören und Tasten zu einem vollständigerem Bild führt.

Aufbau einer sorgfältig kontrollierten Teststrecke

Um verlässliche Daten zu erzeugen, flogen die Forscherinnen vier verbreitete kommerzielle Drohnen und stellten als Nicht‑Drohnen‑Referenz einen einfachen metallischen Eckreflektor in ein freies Feld ohne große Gebäude. Alle Ziele schwebten in gleicher Höhe und waren auf einen Satz gemeinsam aufgestellter Sensoren gerichtet, sodass jedes Gerät die Szene aus nahezu exakt demselben Winkel betrachtete. Die Drohnen wurden in Abständen von 2 bis 30 Metern in 2‑Meter‑Schritten gemessen, mit jeweils 500 wiederholten Aufnahmen für jede Kombination aus Drohnentyp, Entfernung und Sensor. Dieses sorgfältige Design ermöglicht es, zu untersuchen, wie sich die Erkennung mit wachsender Entfernung verändert und verschiedene Modelle hinsichtlich Größe, Gewicht und Bauweise zu vergleichen.

Die Sensoren im Gleichschritt atmen lassen

Eine zentrale Stärke des Datensatzes ist, dass die drei Sensoren softwareseitig zeitlich synchronisiert sind. Alle Geräte werden von einem einzigen Steuerprogramm angesteuert, das sie gemeinsam triggert und ihre Ausgaben synchron speichert. Jede Aufnahme eines Sensors hat ein passendes Gegenstück der anderen, ausgerichtet über einen gemeinsamen Index statt über komplexe Hardware‑Uhren. Für die beiden Radare erfasst das System entweder Rohsignale oder verarbeitete Karten, die zeigen, wie reflektierte Energie über Entfernung und Geschwindigkeit verteilt ist. Für den Funkempfänger wird das rohe Kommunikationssignal gespeichert. Diese gemeinsame Zeitbasis erlaubt Forschenden, Informationen direkt über Sensoren hinweg zu fusionieren — etwa eine Flimmern in der Rotorbewegung mit einem Burst im Steuerlink zu korrelieren — ohne anschließend schwerfällige Abgleichungen vornehmen zu müssen.

Von rohen Wellen zu maschinenbereiten Bildern

Weil moderne Erkennungswerkzeuge häufig auf Deep Learning beruhen, wandeln die Autorinnen die Rohmessungen auch in bildähnliche Darstellungen um, die Computer leicht verarbeiten können. Für das Dauerton‑Radar extrahieren sie die Frequenzmuster, die durch rotierende Propeller entstehen — sogenannte Mikrobewegungen — und stellen diese als einfache Spektren dar. Für das durchfegende Radar erzeugen sie farbige Distanz‑Geschwindigkeits‑Bilder, die hervorheben, wo und wie sich die Drohne bewegt, nachdem Hintergrundstörungen entfernt wurden. Für den Funkempfänger berechnen sie die Leistungsverteilung über Frequenzen und erstellen Fingerabdrücke des Kommunikationsstils jeder Drohne. Jede Rohdatei hat eine passende Bilddatei, sodass Forschende wählen können, ob sie auf Signalebene arbeiten oder direkt in standardmäßige bildbasierte neuronale Netze einspeisen möchten.

Beweis, dass mehrere Augen besser sind als eins

Um zu zeigen, dass der Datensatz nicht nur interessant, sondern nützlich ist, trainiert das Team ein bekanntes Bilderkennungsnetzwerk separat auf den Bildern jedes Sensors und dann auf fusionierten Kombinationen aller drei. Wie zu erwarten, haben die Radare bei zunehmender Entfernung stärkere Probleme: Die reflektierten Signale schwächen ab und die Klassifikationsgenauigkeit sinkt mit der Distanz. Der Funkempfänger hält die Reichweite besser durch, aber einige Drohnen teilen nahezu identische Kommunikationsbänder und sind mit diesem Sensor allein schwer zu unterscheiden. Wenn die Forschenden die drei Perspektiven zu einem einzigen zusammengesetzten Eingang zusammenführen, verbessert sich die Leistung durchweg, insbesondere bei kleineren, schwerer zu erkennenden Drohnen. Das zeigt, dass synchronisierte Multi‑Sensor‑Information blinde Flecken einzelner Geräte ausgleichen kann.

Was das für sichereren Luftraum bedeutet

Kurz gesagt haben die Autorinnen ein detailliertes, öffentliches „Trainingsgelände“ geschaffen, auf dem intelligente Algorithmen lernen können, Drohnen mithilfe mehrerer funkbasierter Augen gleichzeitig zu erkennen. Durch die Veröffentlichung sowohl der Rohsignale als auch gebrauchsfertiger Bilder sowie Beispielcode senken sie die Hürde für andere, Erkennungssysteme zu entwickeln, die in wechselnden Bedingungen und auf unterschiedlichen Distanzen zuverlässig funktionieren. Mit der Zeit könnten auf diesem Datensatz basierende Werkzeuge Flughäfen, kritische Einrichtungen und Stadtbehörden dabei unterstützen, freundliche von verdächtigen Drohnen besser zu unterscheiden und den Luftraum in niedrigen Höhen sicherer zu machen — ohne sich ausschließlich auf Kameras oder menschliche Beobachter zu verlassen.

Zitation: Han, SK., Jung, YH. A Time-Synchronized Multi-Sensor drone dataset acquired from multiple radars and RF receiver. Sci Data 13, 407 (2026). https://doi.org/10.1038/s41597-026-06802-6

Schlüsselwörter: Drohnenerkennung, Radarsensorik, Funkfrequenzsignale, Sensorfusion, offener Datensatz