Clear Sky Science · de

Ein Video-Super-Resolution-Datensatz für chinesische traditionelle Oper basierend auf der „Real-world+“-Degradationsfusion

Alte Opernfilme wieder zum Leben erwecken

Viele Aufnahmen chinesischer traditioneller Opern existieren nur in fragiler, qualitativ minderwertiger Videoform. Zeit, Staub und wiederholtes Kopieren haben Gesichter verwaschen, Kostüme entfärbt und Szenen mit visuellen Störungen überdeckt. Dieses Papier stellt einen neuen Weg vor, solche Videos digital „zu säubern“ und zu schärfen — nicht indem man jeden Film von Hand repariert, sondern indem man eine spezialisierte Trainingssammlung für Künstliche Intelligenz aufbaut. Ziel ist es, Computern beizubringen, wie sie verschwommene, gealterte Aufnahmen in klarere, lebendigere Bilder verwandeln und so einen wichtigen Teil des kulturellen Gedächtnisses der Welt bewahren können.

Warum alte Opernvideos so schlecht aussehen

Die chinesische traditionelle Oper, einschließlich bekannter Stile wie Pekingoper und Kunqu, ist von der UNESCO als Teil des gemeinsamen Kulturerbes der Menschheit anerkannt. Viele überlieferte Videos dieser Aufführungen haben jedoch einen langen und harten Weg hinter sich. Zuerst erzeugte die ursprüngliche Aufnahmetechnik Unschärfen und Kamerarauschen. Lagerung auf Film, Band oder Datenträger brachte Kratzer, Verformungen und Datenverlust. Schließlich führten wiederholtes Kopieren, Internetkompression und instabile Netzübertragung zu blockigen Artefakten, Flackern und Bildausfällen. Das Ergebnis ist nicht nur eine einfache Unschärfe, sondern ein verwobenes Gemisch vieler Schadensarten, das es Wiederherstellungsmethoden sehr schwer macht, das ursprüngliche Bild zu rekonstruieren.

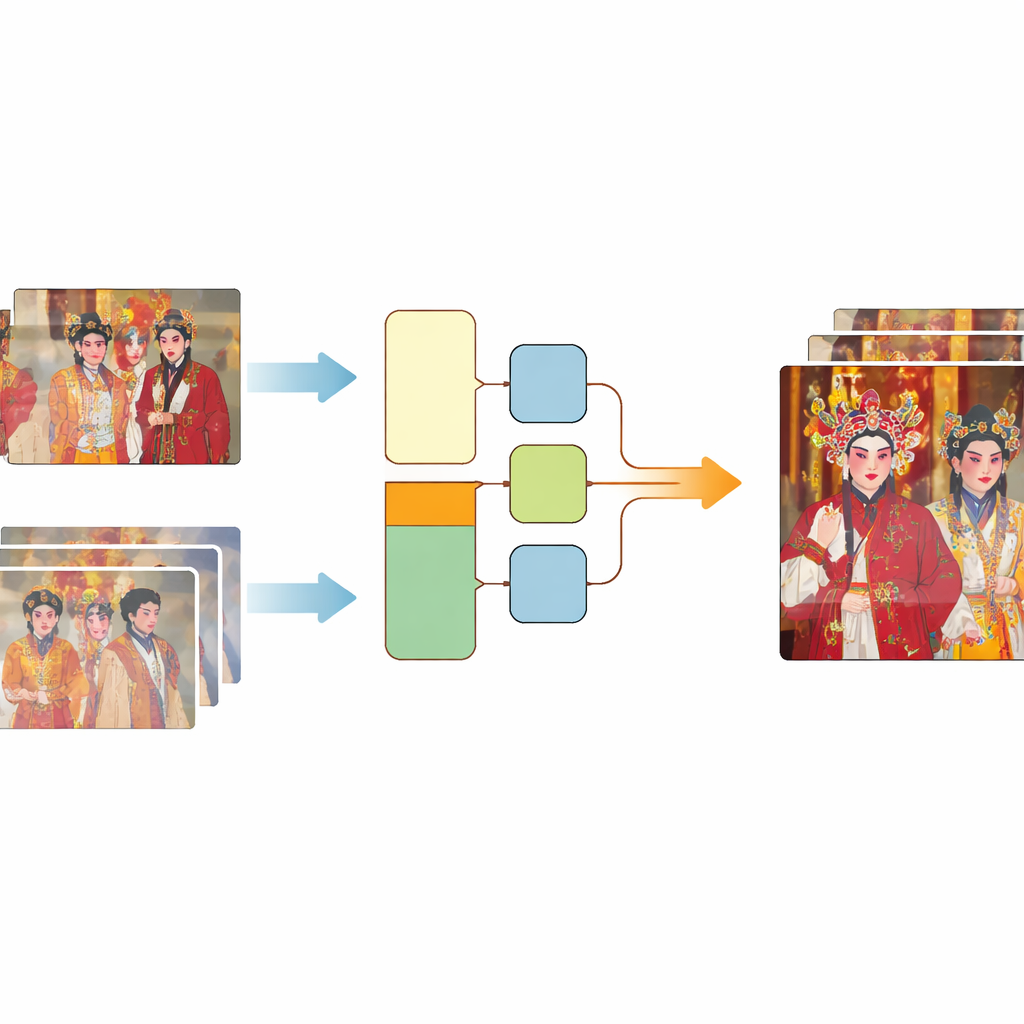

Paare aus verschwommenen und klaren Frames erstellen

Moderne Video-Super-Resolution-Methoden trainieren Computer darauf, aus einem qualitativ schlechten Frame ein scharfes, detailliertes Bild vorherzusagen. Um diese Fähigkeit zu erlernen, benötigen sie viele Beispiele, in denen ein verschwommener Frame exakt mit derselben Szene in hoher Qualität übereinstimmt. Bestehende Trainingssammlungen beruhen meist entweder auf vereinfachter, künstlicher Beschädigung oder auf realem Filmmaterial, das zwischen der Low- und High-Quality-Version nicht präzise ausgerichtet ist. Die Autoren erstellten eine neue Ressource namens CTOVSR, indem sie mit vier professionell restaurierten traditionellen Opernfilmen begannen, die von Originalrollen aus sehr hohe Auflösung erreicht hatten. Anschließend fanden sie passende, standarddefinierte Versionen derselben Aufführungen, die online veröffentlicht wurden. Diese niedrigeren Kopien hatten den vollen realen Alterungsprozess durchlaufen und bildeten ideale „Vorher“-Bilder.

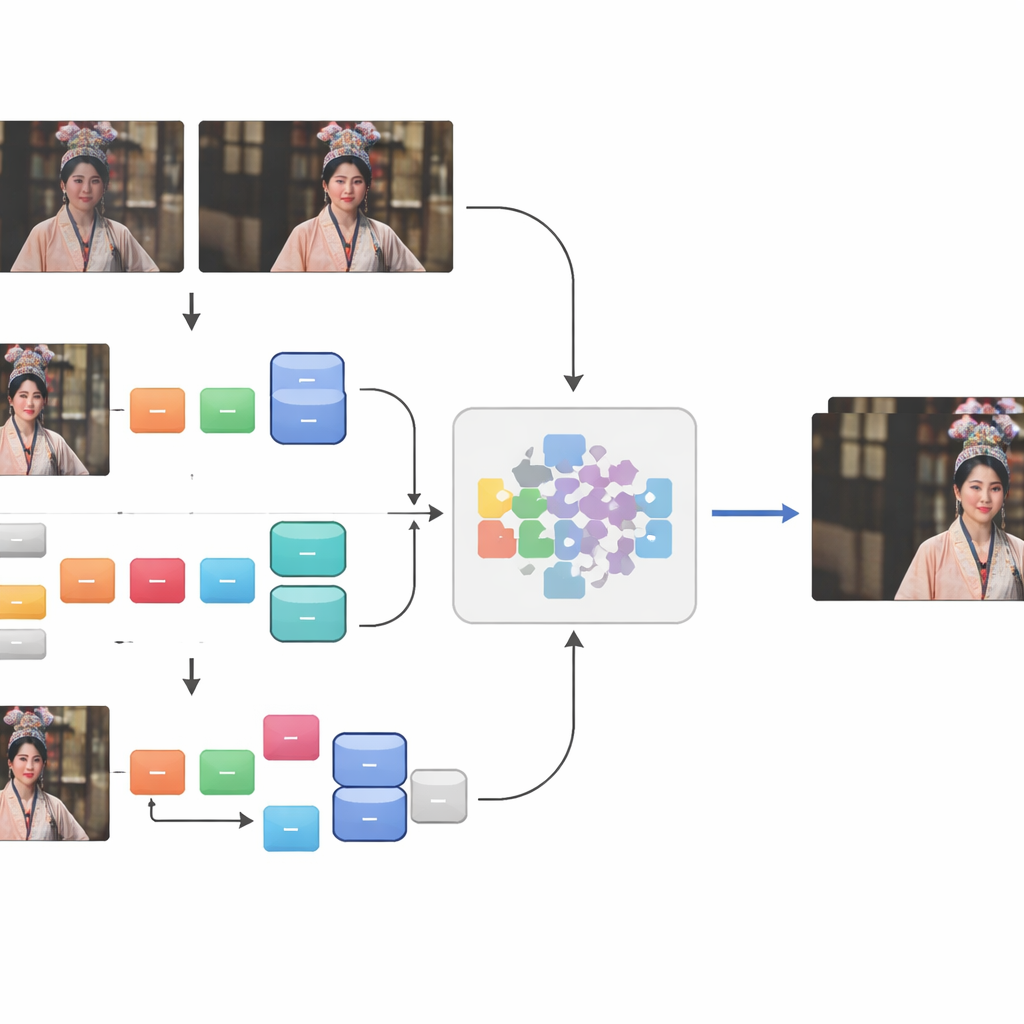

Jeden Frame sorgfältig ausrichten

Die Zuordnung der restaurierten und der gealterten Videos war alles andere als einfach. Unterschiede in der Bildrate, fehlende Einstellungen, hinzugefügte Wasserzeichen, schwarze Ränder und wechselnde Seitenverhältnisse führten dazu, dass einfache automatische Methoden nicht ausreichten. Das Team extrahierte verwendbare Segmente und führte dann eine sorgfältige, dreistufige Ausrichtung durch. Zunächst nutzten sie ein maßgeschneidertes Werkzeug, eye_comparer, um zeitliche Probleme wie Frameverlust, ausser-Reihenfolge geratene Frames und „Geister“-Frames an Szenenübergängen manuell zu beheben. Anschließend beheben sie räumliche Abweichungen, indem sie Frames in Bildbearbeitungssoftware überlagerten, den Inhalt präzise ausrichteten und Ränder, Logos und Untertitel zuschnitten, während so viel der Szene wie möglich erhalten blieb. Abschließend führten sie eine automatische Prüfung mit einem Ähnlichkeitsmaß durch und behielten nur Frame-Paare, die in ihrer Struktur nahezu identisch waren. Dieser Prozess erzeugte 250 hochwertige Real-World-Sequenzpaare mit Hunderttausenden von Frames.

Reale Schäden mit simuliertem Verschleiß verbinden

Obwohl diese sorgfältig ausgerichteten Paare echte, realweltliche Verfallsmuster erfassten, reichten sie noch nicht aus, um die volle Vielfalt möglicher Videoausfälle abzudecken. Um das Trainingsmaterial zu erweitern, fügten die Autoren eine zweite Komponente hinzu: synthetisch erzeugte Schäden, angewendet auf 41 zusätzliche hochauflösende Opernvideos. Sie simulierten räumliche Schäden — wie Unschärfe und Rauschen — durch eine zweistufige Kette von Degradationsschritten, und zeitliche Schäden, indem sie die Videos mit einem weitverbreiteten älteren Kompressionsstandard verschlüsselten, der viele historisch kodierte Onlineclips widerspiegelt. Durch das Verschmelzen dieses synthetischen Anteils mit den „Real-world+“-Paaren stellten sie den CTOVSR-Datensatz zusammen, der 900 strikt ausgerichtete Low–High-Quality-Video-Paare enthält, jeweils 100 Frames lang und mit einer großen Bandbreite an Opern, Szenen und Lichtbedingungen.

Den Wert der neuen Sammlung beweisen

Um zu testen, ob CTOVSR Computern wirklich bei der Restaurierung alter Videos hilft, trainierten die Autoren mehrere moderne Super-Resolution-Modelle ausschließlich mit diesem Datensatz. Sie verglichen die Ergebnisse mit einfachen Skalierungsverfahren und stellten fest, dass die trainierten Modelle deutlich klarere Bilder erzeugten, mit schärferen Kostümdetails, besser lesbarem Bühnenmake-up und weniger sichtbaren Artefakten. Eine Ablationsstudie zeigte, dass die Kombination aus realen und synthetischen Schäden wesentlich besser war als jeweils eines von beiden allein. Die Forscher testeten ihre trainierten Modelle außerdem an völlig neuem Material: gealterten Opernclips aus dem Internet und sogar Aufführungsaufnahmen aus anderen Kulturen, etwa italienischer Oper und indischem klassischem Tanz. Menschliche Betrachter bewerteten die verbesserten Frames signifikant höher als die Originale oder einfache hochskalierte Versionen, was darauf hindeutet, dass auf CTOVSR trainierte Modelle über das spezifische Ausgangsmaterial hinaus generalisieren können.

Erhalt des Kulturerbes durch bessere Daten

Vereinfacht gesagt, führt diese Arbeit keinen weiteren Wiederherstellungsalgorithmus ein; vielmehr liefert sie das sorgfältig vorbereitete „Übungsmaterial“, das solche Algorithmen zum Lernen benötigen. Indem beschädigte und hochqualitative Versionen traditioneller Opernaufnahmen akribisch paarweise gegenübergestellt und anschließend mit realistisch simuliertem Verschleiß angereichert wurden, gibt der CTOVSR-Datensatz der Künstlichen Intelligenz ein deutlich besseres Verständnis dafür, wie alte Videos verfallen und wie sie nach der Restaurierung aussehen sollten. Dieser Ansatz bietet einen praktischen Weg, nicht nur chinesischer traditioneller Oper neues visuelles Leben einzuhauchen, sondern auch viele andere unersetzliche historische Videos vor dem Vergessen im digitalen Raum zu bewahren.

Zitation: Xi, W., Qin, B., Zhang, Y. et al. A Chinese Traditional Opera Video Super-Resolution Dataset Based on the “Real-world+” Degradation Fusion. Sci Data 13, 387 (2026). https://doi.org/10.1038/s41597-026-06776-5

Schlüsselwörter: Video-Super-Resolution, Erhaltung digitalen Kulturerbes, chinesische traditionelle Oper, Bildrestauration, datensätze mit degradierter Videoqualität