Clear Sky Science · de

Ein umfassender IMU-Datensatz zur Bewertung von Sensor-Layouts bei der Erkennung von menschlichen Aktivitäten und Intensität

Warum es für Ihren Fitness-Tracker wichtig ist, wo er sitzt

Fitnessuhren und Schrittzähler versprechen, alles von Ihrem täglichen Spaziergang bis zum Training im Fitnessstudio zu überwachen. Unter den schlanken Armbändern verbirgt sich jedoch eine überraschend knifflige Designfrage: An welcher Körperstelle sollten die Sensoren sitzen, damit sie genug von unserer Bewegung erfassen, ohne uns in verkabelte Roboter zu verwandeln? Diese Studie stellt einen umfangreichen neuen Datensatz vor, der Forschenden genau dabei hilft: zu zeigen, wie verschiedene tragbare Sensor-Layouts erfassen, was wir tun und wie stark wir uns anstrengen.

Viele Tracker, eine große blinde Stelle

Die Erkennung menschlicher Aktivitäten ist die Technik, die Geräten erlaubt zu erkennen, ob Sie sitzen, gehen, laufen oder Rad fahren – basierend auf Bewegungsdaten. Kameras können das ebenfalls leisten, aber körpernahe Sensoren sind für langfristigen Einsatz im Alltag, in Kliniken und zu Hause oft besser geeignet, weil sie die Privatsphäre wahren. Die meisten vorhandenen Datensätze für diese Forschung platzieren jedoch nur wenige Sensoren an ausgewählten Körperstellen – etwa ein Smartphone in der Tasche oder ein Band am Handgelenk. Diese eingeschränkte Sicht macht es schwer, einen wichtigen Kompromiss zu untersuchen: Wie viele Sensoren und an welchen Positionen sind tatsächlich nötig, um Aktivitäten und deren Intensität genau zu erkennen und gleichzeitig Tragekomfort und Praktikabilität zu wahren?

Aufbau einer Ganzkörper-Bewegungskarte

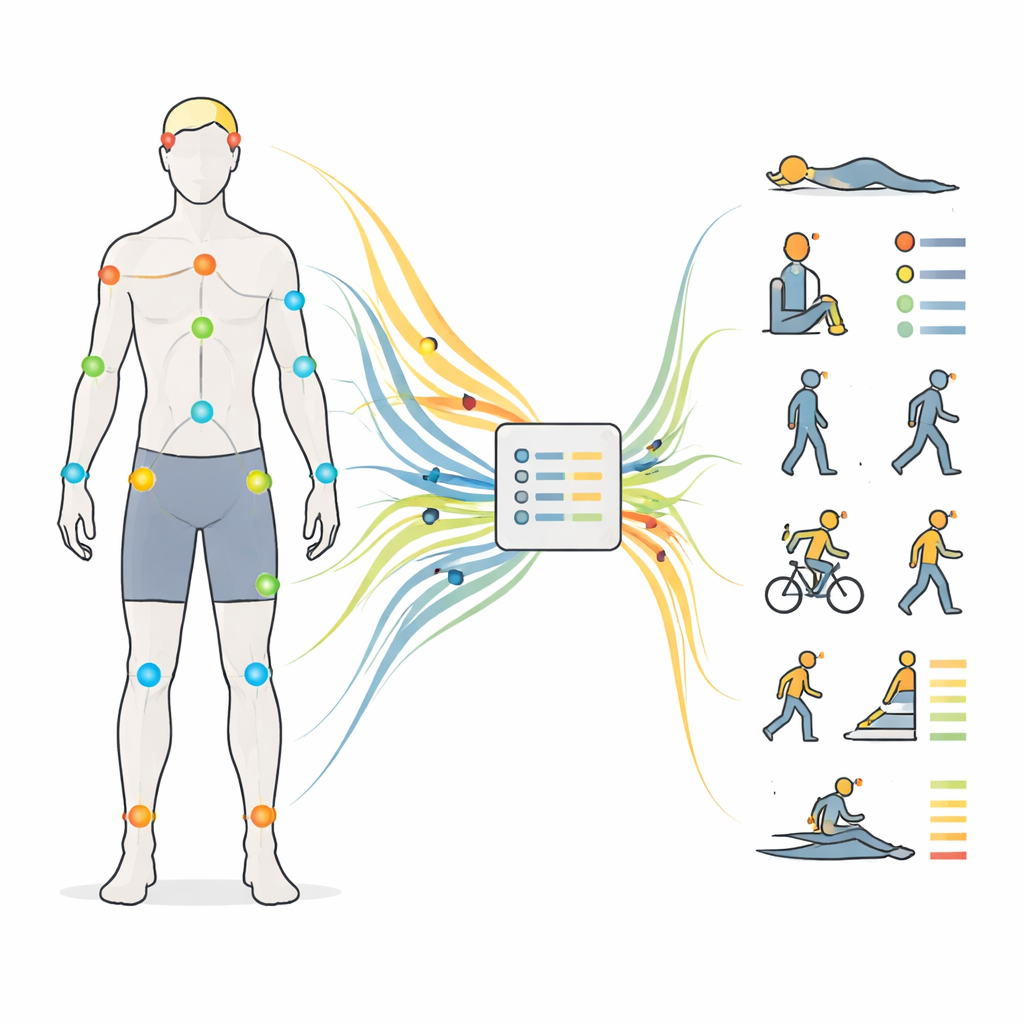

Um diese Lücke zu schließen, sammelten die Forschenden Bewegungsdaten von 30 gesunden jungen Erwachsenen, während diese 12 typische Aktivitäten ausführten, darunter Liegen, Sitzen, Stehen, mehrere Gehgeschwindigkeiten, Treppensteigen, Radfahren, Laufen, Springen und Rudern. Jede Person trug 17 kleine Bewegungseinheiten, verteilt vom Kopf bis zu den Füßen: am Kopf, am oberen Rücken, unteren Rücken, an den Schultern, Armen, Handgelenken, Oberschenkeln, Unterschenkeln und Füßen. Diese Einheiten zeichneten die Bewegung jedes Körpersegments in drei Dimensionen mit 60 Messungen pro Sekunde in einem konsistenten globalen Koordinatensystem auf. Das Team protokollierte außerdem grundlegende Körpermaße wie Größe und Gliedmaßenlängen und annotierte sorgfältig sowohl die Art der Aktivität als auch deren Anstrengungsgrad von sitzend bis kräftig, basierend auf Standardtabellen zum Energieverbrauch.

Von Rohbewegungen zu erkennbaren Mustern

Nach der Datenerhebung wurden die Signale in kurze überlappende Zeitfenster zerteilt, die von einer halben Sekunde bis zu 10 Sekunden reichten. Für klassische maschinelle Lernmodelle verdichtete das Team jedes Fenster zu Sätzen handgefertigter Merkmale, die beschreiben, wie sich die Signale über Zeit und Frequenz verhalten – etwa Mittelwerte, Variabilität und dominierende Rhythmen. Anschließend trainierten sie vier verbreitete Modelle – zwei klassische Ansätze und zwei Deep-Learning-Netze – für zwei Aufgaben: die Unterscheidung der 12 Aktivitäten und die Gruppierung in vier Anstrengungsstufen. Alle Trainings- und Testläufe erfolgten personenweise: Daten jeder Versuchsperson wurden nur in einer Rolle verwendet, sodass die Modelle wirklich allgemeine Muster lernten und nicht den individuellen Bewegungsstil auswendig lernten.

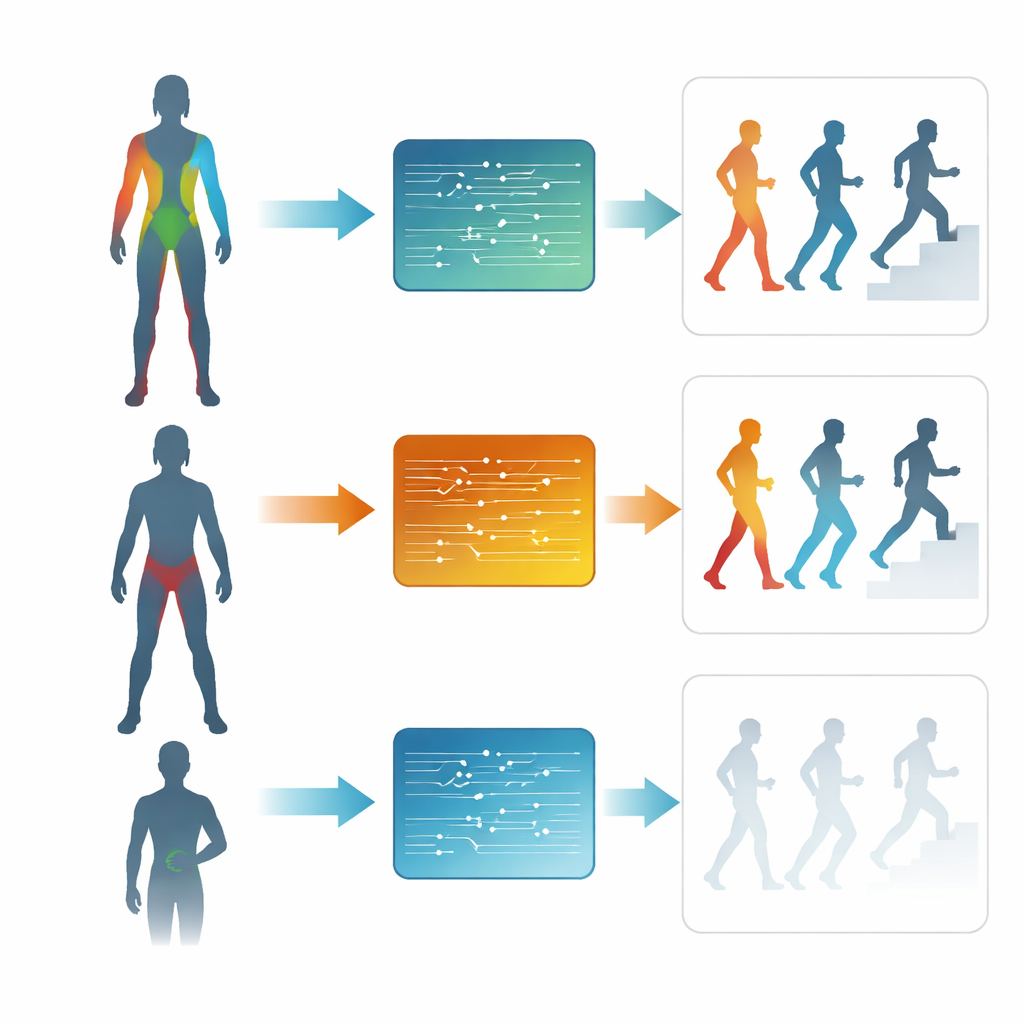

Was wirklich zählt: Zeit und Platzierung

Die Ergebnisse zeigen, dass klassische Modelle mit sorgfältig gewählten Merkmalen Aktivitäten mit etwa 96–97 % Genauigkeit und Anstrengungsstufen sogar noch zuverlässiger erkennen können. Deep-Learning-Modelle, die direkt auf Rohsignalen trainiert wurden, schneiden nahezu genauso gut ab, insbesondere bei kürzeren Zeitfenstern. Über alle Ansätze hinweg bieten Fenster von etwa 2–5 Sekunden die beste Balance zwischen schneller Reaktion und zuverlässiger Klassifikation: lang genug, um den Rhythmus von Gehen oder Rudern zu erfassen, aber kurz genug, um für Echtzeit-Feedback nützlich zu sein. Bei der Sensorplatzierung sind die Befunde eindrücklich. Ein auf den Unterkörper fokussiertes Layout – Hüfte, Oberschenkel, Unterschenkel und Füße – erreicht oft die gleiche oder sogar bessere Leistung als eine Vollkörperabdeckung, insbesondere für die Einschätzung der Intensität. Ein minimales Drei-Sensor-Setup am unteren Rücken, Oberschenkel und Unterschenkel liegt weiterhin über 90 % Genauigkeit, während Ein-Sensor-Setups, insbesondere am Handgelenk, spürbar schlechter abschneiden.

Schlankere, intelligentere Wearables entwerfen

Dieser neue Datensatz legt nahe, dass mehr Sensoren nicht immer besser sind: Bei Alltagsbewegungen, die von den Beinen dominiert werden, kann eine kompakte, gut gewählte Sensorgruppe mit deutlich komplexeren Systemen mithalten. Diese Erkenntnis kann das Design künftiger Wearables leiten, die leichter, günstiger und einfacher zu verwenden sind und dennoch zuverlässig sowohl erfassen, was Menschen tun, als auch wie stark sie sich anstrengen. Indem die Autoren den vollständigen Datensatz und Code öffentlich zugänglich machen, stellen sie eine Testumgebung zur Verfügung, um Sensor-Layouts weiter zu verfeinern, neue Algorithmen zu erforschen und diese Werkzeuge schließlich auf ältere Erwachsene, Patientengruppen und vielfältigere reale Settings auszuweiten.

Zitation: Feng, M., Zhang, Q. & Fang, H. A comprehensive IMU dataset for evaluating sensor layouts in human activity and intensity recognition. Sci Data 13, 317 (2026). https://doi.org/10.1038/s41597-026-06710-9

Schlüsselwörter: tragbare Sensoren, Erkennung menschlicher Aktivitäten, Trägheitsmesseinheiten, Sensorsetzung, Intensität körperlicher Aktivität