Clear Sky Science · de

Ein Datensatz für Brustultraschall mit Chain-of-Thought-Begründungen, der alle histopathologischen Kategorien abdeckt

Warum diese Forschung wichtig ist

Die Brustkrebsvorsorge stützt sich zunehmend auf Ultraschall, besonders bei jüngeren Frauen und in Regionen, in denen Mammographie weniger verfügbar ist. Dennoch verhalten sich selbst die fortschrittlichsten künstlichen Intelligenz (KI)-Werkzeuge zum Auswerten dieser Aufnahmen oft wie Black Boxes: Sie liefern ein Urteil – benign oder malign – ohne darzulegen, wie sie dazu gelangt sind. Diese Arbeit stellt BUS-CoT vor, einen neuen, öffentlich zugänglichen Brustultraschall-Datensatz, der nicht nur dabei helfen soll, Krebs zu erkennen, sondern die KI auch dazu bringen möchte, „laut zu denken“ und damit die Art des Schlussfolgerns nachzuahmen, wie sie erfahrene Radiologinnen und Radiologen bei schwierigen Fällen anwenden.

Von unscharfen Aufnahmen zu strukturierten Hinweisen

Ultraschallbilder sind verrauscht und schwer zu interpretieren, selbst für Spezialistinnen und Spezialisten. Menschen blicken nicht einfach kurz auf eine Aufnahme und springen zur Diagnose; sie suchen eine Kette visueller Hinweise – ob ein Knoten oval oder unregelmäßig ist, ob seine Ränder glatt oder gezackt erscheinen, ob er einen Schatten wirft und ob winzige helle Punkte auf Verkalkungen hindeuten. Diese Hinweise werden dann mit standardisierten Regeln, etwa dem BI-RADS-System, abgewogen, um die Wahrscheinlichkeit einer malignen Läsion abzuschätzen und zu entscheiden, ob eine Biopsie nötig ist. Bestehende KI-Systeme überspringen meist dieses schrittweise Begründen und gehen direkt von Pixeln zur Vorhersage, was ihre Entscheidungen schwer vertrauenswürdig und schwer auf ungewöhnliche oder seltene Fälle übertragbar macht.

Eine umfangreiche neue Sammlung realer Fälle

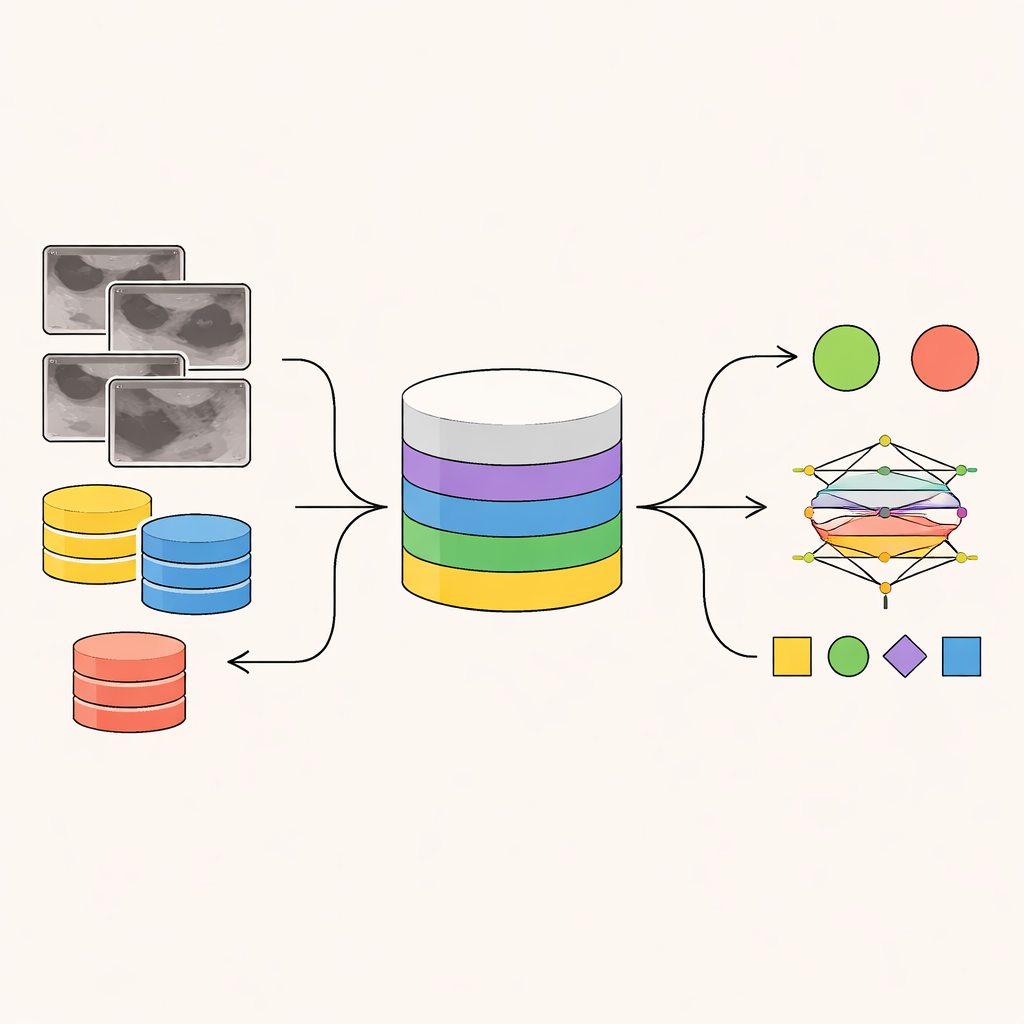

Der BUS-CoT-Datensatz begegnet diesen Problemen, indem er 11.439 Brustultraschallbilder von 11.850 Läsionen bei 4.838 Patientinnen zusammenführt, entnommen aus Publikationen, offenen Datensätzen und online verfügbaren Fallarchiven über mehrere Kontinente und verschiedene Ultraschallgeräte hinweg. Entscheidend ist, dass die Sammlung alle 99 Brustgewebe-Kategorien abdeckt, die von der Weltgesundheitsorganisation definiert wurden – von häufigen benignen Herden wie Fibroadenomen bis hin zu seltenen und aggressiven Karzinomen. Diese breite Abdeckung behebt eine wesentliche Schwäche früherer Datensätze, die seltene Erkrankungen häufig ganz auslassen und KI-Systeme gerade für die Fälle schlecht vorbereiten, bei denen Ärztinnen und Ärzte am ehesten Schwierigkeiten haben.

Maschinen beibringen, einem Begründungspfad zu folgen

Über die Rohbilder hinaus bietet BUS-CoT mehrere Ebenen fachlicher Annotationen. Radiologinnen und Radiologen erfassen zunächst grundlegende Beobachtungen: ob eine Raumforderung vorhanden ist, ob Verkalkungen vorliegen und wo sich die Läsion befindet. Anschließend annotieren sie detaillierte visuelle Merkmale – Form, Ränder, interne Echo-Muster und mehr – bevor sie BI-RADS-Kategorien zuweisen und diese Bildbefunde mit gesicherter Pathologie aus Gewebeproben verknüpfen. Schließlich wandeln sie diese strukturierten Informationen in eine narrative Chain-of-Thought um: eine kurze, schrittweise Erklärung, die verbindet, was auf dem Scan zu sehen ist und warum eine bestimmte Diagnose wahrscheinlich ist. Im Unterschied zu automatisch generiertem Text sind diese Begründungsketten von erfahrenen Brustbildgebungsspezialistinnen und -spezialisten erstellt und verifiziert und bewahren damit echte klinische Logik, von der Modelle lernen können.

Den Datensatz auf die Probe stellen

Um zu demonstrieren, was diese Ressource leisten kann, trainierten die Autorinnen und Autoren eine Reihe moderner Bild- und Vision‑Language-Modelle auf BUS-CoT, wobei sie sich auf einen kuratierten, hochwertigen Teilsatz von 5.163 läsionszentrierten Bildern konzentrierten. Traditionelle Bildnetzwerke lernten, Läsionen als benign oder malign zu klassifizieren, während ein fortgeschrittenes Vision‑Language-Modell darauf trainiert wurde, sowohl das Bild zu betrachten als auch eine Begründungskette zu generieren, bevor es seine Antwort gab. Wenn das Modell gezwungen wurde, in dieser strukturierten Weise zu begründen, verbesserte sich seine Genauigkeit, insbesondere bei mehrdeutigen Fällen, in denen benigne und maligne Läsionen ähnlich aussehen. Anders gesagt: Das Modell durch die gleichen visuellen Hinweise zu führen, die Radiologinnen und Radiologen nutzen, half ihm, bessere und sicherere Entscheidungen zu treffen.

Wie diese Arbeit die künftige Versorgung beeinflussen kann

Für Patientinnen und Klinikpersonal liegt das Versprechen von BUS-CoT in KI-Werkzeugen, die nicht nur die menschliche Genauigkeit erreichen, sondern sich auch klinisch sinnvoll erklären können. Indem tausende Ultraschallbilder mit sorgfältig dokumentierten Begründungen gepaart und das gesamte Spektrum von Brustgewebe-Diagnosen – einschließlich seltener – abgedeckt wird, schafft dieser Datensatz die Grundlage für KI-Systeme, die schwierige Randfälle behandeln und ihre Empfehlungen begründen können. Auch wenn er noch keine umfangreicheren klinischen Informationen wie Genetik oder Krankengeschichte enthält, ist BUS-CoT ein bedeutender Schritt zu transparenteren, vertrauenswürdigeren ultraschallbasierten Diagnosen, bei denen Maschinen weniger wie mysteriöse Orakel und mehr wie gewissenhafte junge Kolleginnen und Kollegen agieren, deren Denkprozesse einsehbar und verfeinerbar sind.

Zitation: Yu, H., Li, Y., Niu, Z. et al. A Chain-of-thought Reasoning Breast Ultrasound Dataset Covering All Histopathology Categories. Sci Data 13, 370 (2026). https://doi.org/10.1038/s41597-026-06702-9

Schlüsselwörter: Brustultraschall, medizinische Bildgebung KI, erklärbare KI, Brustkrebsdiagnose, klinische Datensätze