Clear Sky Science · de

BaleUAVision: Datensatz mit von UAV erfassten Heuballen

Warum das Zählen von Heuballen aus der Luft wichtig ist

Heuballen mögen wie einfache Rollen getrockneten Grases wirken, doch die genaue Kenntnis darüber, wie viele sich auf einem Feld befinden und wo sie liegen, hat für Landwirtinnen und Landwirte echten wirtschaftlichen Wert. Präzise Zählungen steuern, wie viel Futter verfügbar ist, wie viele Lkw benötigt werden und wie lange Ernte- und Sammelteams eingesetzt werden müssen. Dieser Artikel stellt BaleUAVision vor, einen neuen offenen Datensatz aus Drohnenaufnahmen, der das automatische Erkennen und Zählen von Heuballen aus der Luft erleichtert und damit die Landwirtschaft in Richtung effizienterer, intelligenterer Bewirtschaftung voranbringt.

Felder aus der Vogelperspektive

BaleUAVision basiert auf 2.599 scharfen Farbfotos, die mit Drohnen über 16 Heufeldern in Nordgriechenland aufgenommen wurden. Die Felder erstrecken sich über etwa 94 Hektar und liegen in zwei Regionen mit unterschiedlicher Landschaft: weitläufige Ebenen rund um Xanthi und abwechslungsreicheres Gelände nahe Drama. Die Flüge fanden im Sommer 2023 bei klarem Himmel und leichtem Wind in Höhen zwischen 50 und 100 Metern und mit moderaten Geschwindigkeiten statt. Das Ergebnis ist ein realistisches Abbild post-ernte Felder, mit Ballenverteilungen, die lokale Anbaumethoden und Geländeeinflüsse widerspiegeln statt eines Laboraufbaus.

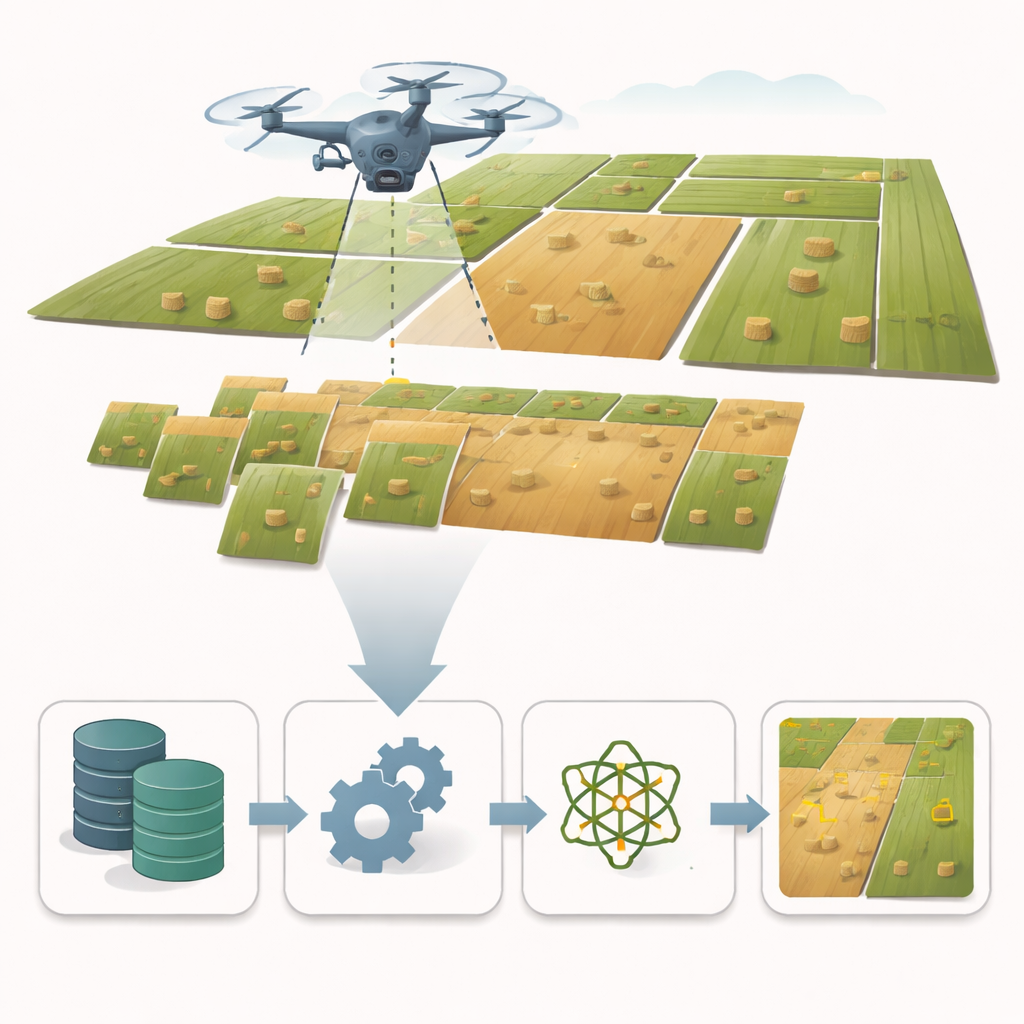

Bilder in nutzbare Daten verwandeln

Das Sammeln der Bilder ist nur der erste Schritt. Das Team hat alle Fotos sorgfältig verarbeitet, verwackelte oder fehlerhafte Aufnahmen verworfen und die übrigen zu detaillierten Luftkarten, sogenannten Orthomosaiken, für jedes Feld zusammengesetzt. Diese Mosaike dienten als vertrauenswürdige Referenz für manuelle Zählungen jedes einzelnen Ballens. Gleichzeitig wurden einzelne Ballen in den Originalfotos per Hand exakt nachgezeichnet, nicht nur grob per Rechteck. Diese akribische Arbeit erzeugte hochwertige „Ground-Truth“-Daten in mehreren gebräuchlichen Dateiformaten, sodass unterschiedlichste KI-Werkzeuge ohne zusätzlichen Konvertierungsaufwand trainiert und geprüft werden können.

Vielfalt in den Flügen, Robustheit in den Modellen

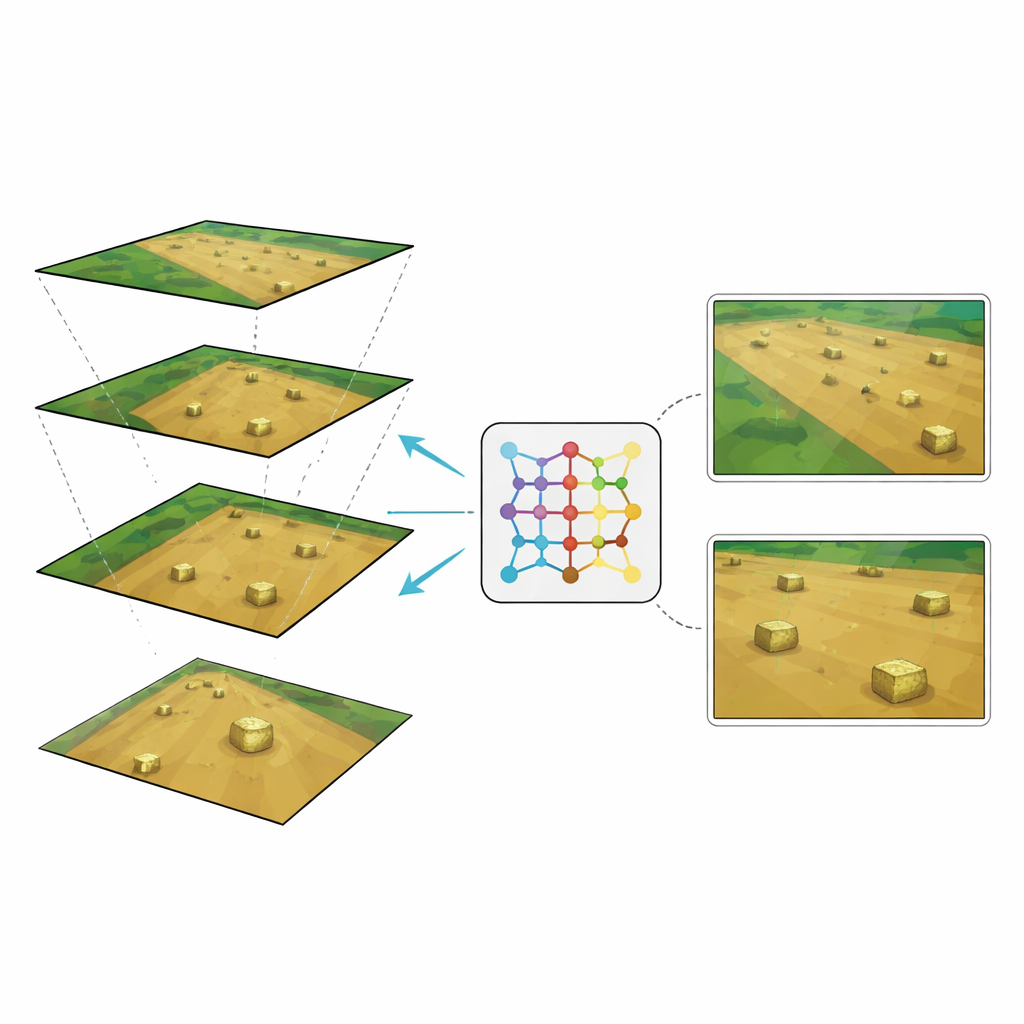

Die Art und Weise, wie eine Drohne geflogen wird — Höhe, Geschwindigkeit und Überlappung der Bilder — bestimmt stark, was sie erfasst. BaleUAVision variiert diese Flugeinstellungen bewusst, damit auf ihm trainierte Erkennungssysteme auch bei veränderten Bedingungen zuverlässig bleiben. Niedrigere Flüge liefern mehr Details, erfassen jedoch weniger Fläche pro Bild; höhere Flüge sehen größere Bereiche, lassen Ballen aber kleiner erscheinen. Durch die Aufnahme von Bildern in unterschiedlichen Höhen und Lichtverhältnissen über zwei Regionen erfasst der Datensatz sowohl geographische Vielfalt als auch die skalenbedingten Kameraänderungen, denen reale Einsätze ausgesetzt sind. Tests zeigen, dass diese Vielfalt KI-Modelle dabei unterstützt, Ballen zu erkennen, selbst wenn sie an neuen Orten oder aus ungewohnten Höhen fotografiert werden.

Den Datensatz auf die Probe stellen

Um zu prüfen, ob BaleUAVision tatsächlich nützlich ist, trainierten die Autorinnen und Autoren ein populäres Erkennungssystem, bekannt als YOLOv11, um Heuballen in den Bildern zu finden. Sie prüften das Modell in zweierlei Hinsicht: indem sie es auf Felder aus einer anderen Region ansetzten, als es beim Training gesehen hatte, und indem sie die Flughöhe zwischen Training und Test veränderten. Trainiert auf dem Datensatz erkannte das System nahezu alle Ballen in neuen Feldern mit sehr wenigen Fehlalarmen. Es bewältigte auch größere Flughöhen gut, wenn es während des Trainings Beispiele aus niedrigeren Höhen gesehen hatte. Ein ausschließlich mit hoch fliegenden Aufnahmen trainiertes Modell tat sich hingegen bei Nahaufnahmen schwer, bis die Forschenden eine kleine Anzahl niedrig fliegender Beispiele hinzufügten — ein Beleg dafür, wie schon moderat ausgewählte Zusatzdaten die Zuverlässigkeit deutlich steigern können.

Von generischer KI zu feldtauglichen Werkzeugen

Die Forschenden verglichen ihr spezialisiertes, auf Ballen trainiertes Modell zudem mit großen allgemeinen Bildverarbeitungssystemen, die darauf ausgelegt sind, „alles“ in einem Bild zu segmentieren. Zwar sind diese Foundation-Modelle in vielen Anwendungsfällen leistungsstark, bei dicht gepackten, kleinen Heuballen vor unruhigen Feldhintergründen schnitten sie jedoch deutlich schlechter ab. Das für BaleUAVision trainierte, maßgeschneiderte Modell war nicht nur genauer, sondern auch praktischer im Betrieb auf echten Drohnen und landwirtschaftlichen Rechnern. Das unterstreicht, wie sorgfältig erstellte, feldspezifische Daten allgemeine KI-Fortschritte in tatsächlich einsetzbare Werkzeuge auf Farmebene verwandeln können.

Von besseren Zählungen zu intelligenterer Landwirtschaft

Einfach gesagt bietet BaleUAVision Forschenden und Unternehmen einen reichhaltigen, frei verfügbaren Satz von Drohnenbildern und Ballenkonturen, um autonome Zählwerkzeuge und Software zu entwickeln und zu testen. Damit lassen sich Anwendungen erstellen, die Landwirtinnen und Landwirten schnell und zuverlässig sagen, wie viele Ballen vorhanden sind, wo sie liegen und wie sie am besten eingesammelt werden können — was Kraftstoff, Zeit und Arbeitskraft spart. Dieselben Daten können außerdem Studien zu Feldbedingungen, Logistikplanung und zukünftigen Ernte- und Sammelrobotern unterstützen. Indem die Autorinnen und Autoren diesen Datensatz öffentlich zugänglich machen, legen sie eine Grundlage dafür, einfache Heuballen zum Ausgangspunkt für präzisere, datengetriebene Landwirtschaft zu machen.

Zitation: Karatzinis, G.D., Gkelios, S. & Kapoutsis, A.C. BaleUAVision: Hay Bales UAV Captured Dataset. Sci Data 13, 313 (2026). https://doi.org/10.1038/s41597-026-06622-8

Schlüsselwörter: präzisionslandwirtschaft, Drohnenbilder, Heuballenerkennung, Computer Vision, Fernerkundungsdatensatz