Clear Sky Science · de

Ein chinesisches Datenset zu naturwissenschaftlichen Fragen der Grundschule zur Generierung von Problemlösungsprozessen

Kinder beim Naturwissenschaftslernen mit schlauerer KI unterstützen

Eltern und Lehrkräfte sehen Künstliche Intelligenz zunehmend als potenziellen Lernpartner, doch aktuelle Chatbots liefern oft Erklärungen, die entweder zu oberflächlich oder viel zu anspruchsvoll für Kinder sind. Dieses Paper stellt ein neues Chinese Elementary Science Question (CSQ)-Datenset vor, das große Sprachmodelle darin schult, Naturwissenschaften so zu erklären, wie es eine gute Grundschullehrkraft tun würde: Schritt für Schritt, auf dem passenden Schwierigkeitsniveau und eng an dem orientiert, was Kinder tatsächlich im Unterricht lernen.

Ein neuer Fragenkatalog für junge Naturwissenschaftler

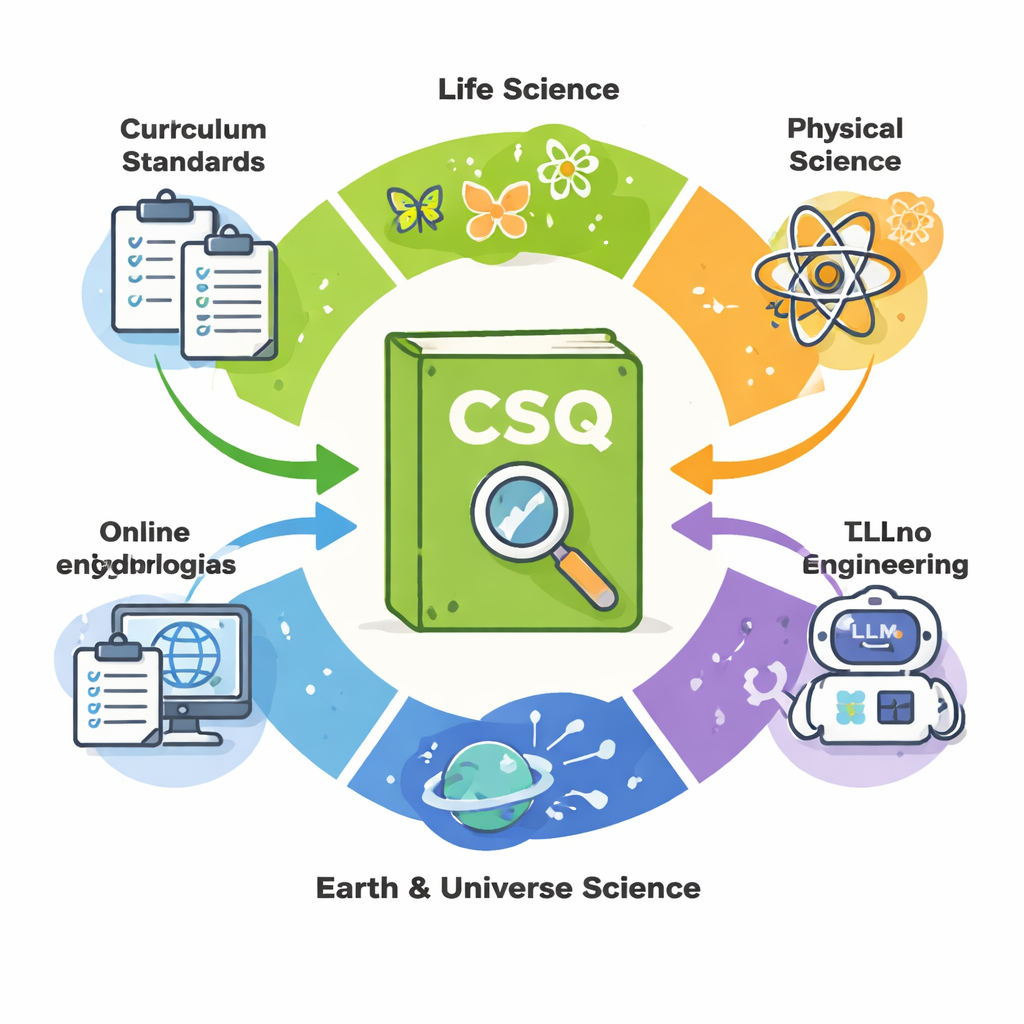

Das CSQ-Datenset ist eine Sammlung von 12.000 sorgfältig ausgearbeiteten naturwissenschaftlichen Fragen, entnommen aus dem chinesischen Grundschullehrplan, Prüfungen und vertrauenswürdigen Online-Quellen. Die Fragen decken vier breite Bereiche ab — Biowissenschaften, Physik, Erde und Weltraum sowie Technologie und Ingenieurwesen — und umfassen die Klassen 1 bis 6. Anders als viele bestehende Fragebanken, die nur Frage und richtige Antwort auflisten, enthält jeder CSQ-Eintrag zusätzlich Angaben zur Klassenstufe, zum Thema und dazu, welche naturwissenschaftlichen Fertigkeiten geprüft werden, sowie eine vollständige, altersgerechte Erklärung der Lösung.

Erfassen, wie Kinder tatsächlich denken

Eine zentrale Innovation von CSQ ist der Fokus auf den „problemlösenden Gedankengang“ hinter jeder Antwort. Für jede Frage legen Experten den Begründungsprozess in einer Sprache und mit einem Detaillierungsgrad dar, der zur Zielklasse passt. Bei jüngeren Kindern bleiben die Erklärungen konkret und beobachtungsbasiert — etwa indem beschrieben wird, was gesehen oder gefühlt werden kann. Bei älteren Schülerinnen und Schülern werden nach und nach abstraktere Begriffe eingeführt, wie Systeme, Ursache und Wirkung oder einfache Modelle. Jeder Eintrag markiert außerdem die zentralen Fähigkeiten, etwa ein Phänomen beobachten, zwei Objekte vergleichen oder die Funktion eines Werkzeugs erkennen. Diese Struktur erlaubt es KI-Modellen, nicht nur die richtige Antwort zu nennen, sondern das Durchschreiten der Denkweise zu üben, die von den Lernenden erwartet wird.

Dataset mit Klassenraum-Realismus bauen

Die Erstellung von CSQ erforderte einen strukturierten, menschenzentrierten Prozess. Ein Team von 19 Forschenden mit Erfahrung in naturwissenschaftlicher Bildung und KI teilte die Arbeit in Phasen auf. Senior-Teammitglieder sammelten Fragen aus offiziellen Lehrplanstandards, Prüfungsunterlagen und Enzyklopädien und stellten sicher, dass sie rechtlich wiederverwendbar waren. Doktorandinnen und Doktoranden passten die Fragen anschließend an und annotierten sie so, dass sie in Multiple-Choice- oder Wahr/Falsch-Formate passten und den offiziellen Science Curriculum Standards for Compulsory Education (2022) entsprachen. Ihre Schulung betonte das Festhalten an klassenstufengerechtem Wortschatz und kognitiver Tiefe. Jeder Datenpunkt — Frage, fachspezifische Eigenschaften und Lösung — wurde von einer weiteren Annotatorin bzw. einem weiteren Annotator überprüft, und Meinungsverschiedenheiten über die richtigen Fähigkeiten oder den Erklärungsumfang wurden unter Bezug auf die nationalen Standards geklärt.

Der KI beibringen, wie man seine Arbeit zeigt

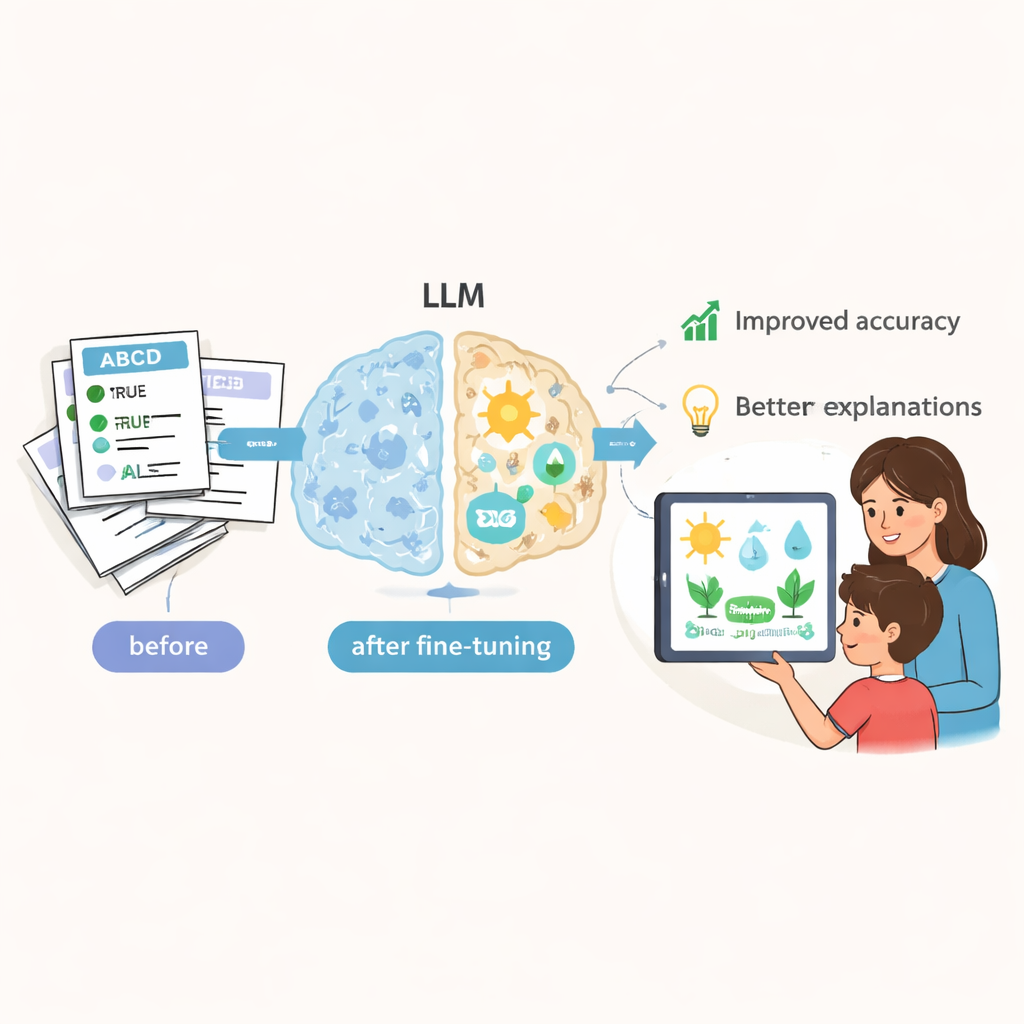

Um den Wert von CSQ zu testen, feinjustierten die Forschenden mehrere Open-Source-Sprachmodelle und bewerteten außerdem ein führendes kommerzielles Modell anhand dieses Datensets. Gemessen wurde nicht nur, ob die Modelle die richtige Multiple-Choice-Antwort wählten. Es wurde auch die Qualität des generierten Denkprozesses sowohl mit automatischen Textmetriken als auch mit Expertenbewertungen durch Menschen beurteilt. Nach dem Training auf CSQ zeigten Open-Source-Modelle deutliche Verbesserungen in Genauigkeit sowie in Klarheit und Vollständigkeit ihrer Erklärungen. Beispielsweise wechselte ein Modell, das zuvor eine Grundschulfrage zum Thema Schall mithilfe fortgeschrittener Wellentheorie beantwortet hatte, nach dem Fine-Tuning zu einer einfacheren, altersgerechteren Darstellung. Menschliche Gutachter befanden, dass die feinjustierten Modelle deutlich besser darin waren, sich an die Klassenstufe der Kinder zu halten und ein „Wissensüberschießen“ zu vermeiden, bei dem zu technische Ideen verwirren statt helfen.

Heute begrenzt, morgen ein Vorbild

Die Autorinnen und Autoren räumen ein, dass CSQ die Struktur des chinesischen naturwissenschaftlichen Lehrplans widerspiegelt und sich nur auf Fragenformate wie Multiple-Choice und Wahr/Falsch konzentriert, nicht auf praktische Experimente oder offene Projekte. Die Erklärungen wurden von ausgebildeten Doktorandinnen und Doktoranden verfasst, nicht von Lehrkräften im Klassenzimmer oder von Kindern selbst, sodass noch Arbeit nötig ist, um die Sprache im echten Unterricht vollständig zu treffen. Dennoch ist das zugrundeliegende Rahmenwerk von CSQ — jede Frage mit Fach, Thema, Klasse, spezifischen Fertigkeiten und schrittweiser Begründung zu verknüpfen — allgemein genug, um ähnliche Ressourcen für andere Sprachen und Schulsysteme zu inspirieren. Kurz gesagt zeigt diese Arbeit, wie sorgfältig gestaltete Fragensets der KI helfen können, ein zuverlässigerer, altersgerechter Naturwissenschaftsnachhilfelehrer für junge Lernende zu werden.

Zitation: Li, D., Liu, Z., Wen, C. et al. A Chinese Elementary Science Question Dataset in Problem-Solving Process Generation. Sci Data 13, 291 (2026). https://doi.org/10.1038/s41597-026-06618-4

Schlüsselwörter: naturwissenschaftliche Grundschulbildung, große Sprachmodelle, Datensatz für Fragebeantwortung, personalisierte Nachhilfe, chinesischer Lehrplan