Clear Sky Science · de

BreastDCEDL: Ein standardisierter, Deep-Learning-kompatibler Brust-DCE‑MRT‑Datensatz mit 2.070 Patientinnen

Warum das für die Brustkrebsversorgung wichtig ist

Wenn bei jemandem Brustkrebs diagnostiziert wird, müssen Ärztinnen und Ärzte rasch entscheiden, welche Behandlungen voraussichtlich am besten wirken. Leistungsfähige MRT‑Aufnahmen können zeigen, wie sich ein Tumor verhält, doch diese Aufnahmen in verlässliche, computerbasierte Werkzeuge zur Behandlungssteuerung zu verwandeln, war bisher schwierig. Dieser Artikel stellt BreastDCEDL vor, eine große, sorgfältig aufbereitete Sammlung von Brust‑MRT‑Aufnahmen, die speziell dazu gedacht ist, Forschende beim Aufbau und Testen von Systemen der künstlichen Intelligenz (KI) zu unterstützen, die vorhersagen, wie Tumoren auf Therapien reagieren.

Tumoren im Zeitverlauf beobachten

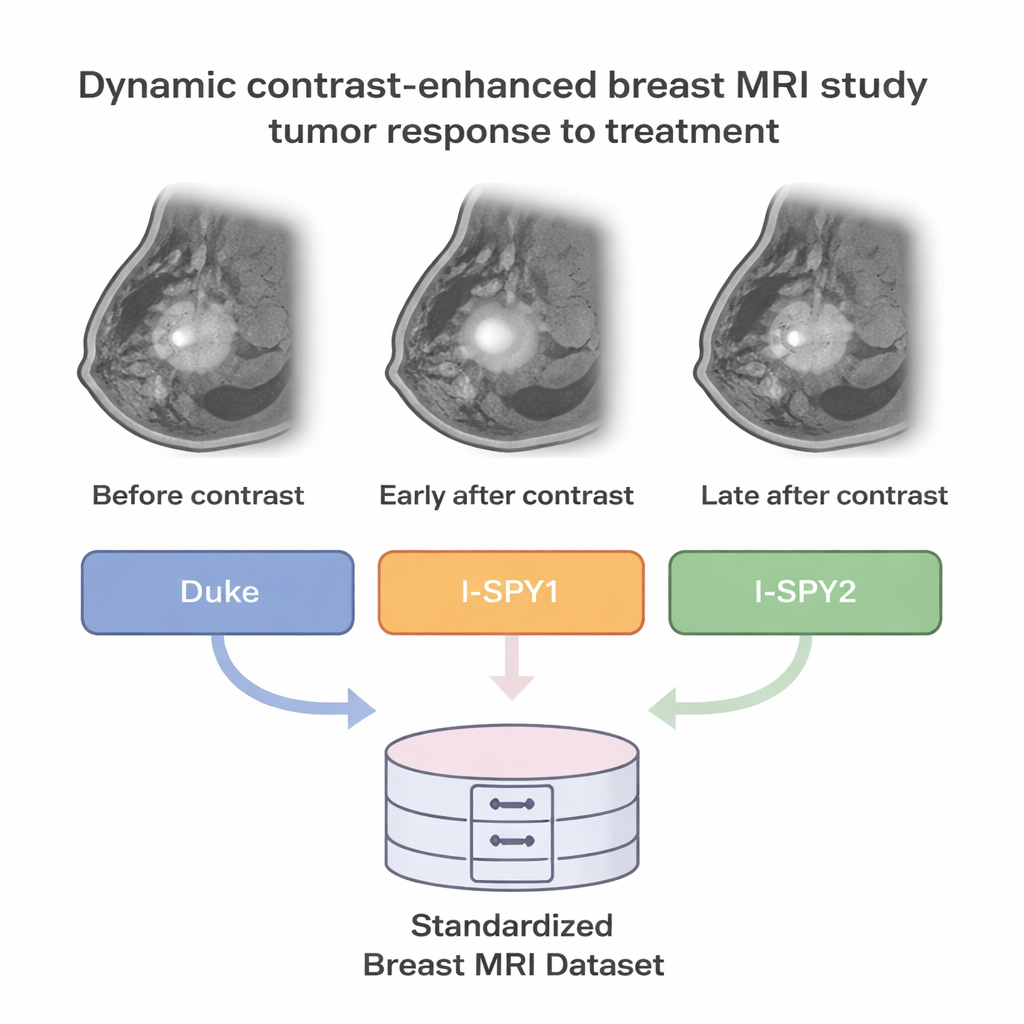

Ärztinnen und Ärzte nutzen häufig eine spezielle MRT‑Methode, die dynamisch kontrastmittelverstärkte MRT (DCE‑MRT) genannt wird, um Brusttumoren zu betrachten. Bei dieser Untersuchung werden Bilder vor und nach Verabreichung eines Kontrastmittels aufgenommen, sodass der Blutfluss durch den Tumor über mehrere Minuten sichtbar wird. Krebsgewebe hat oft undichte, ungeordnete Blutgefäße, daher hebt es sich anders hervor und verblasst anders als gesundes Gewebe. Diese Zeitrafferaufnahmen können zeigen, wie aggressiv ein Tumor ist, und helfen möglicherweise vorherzusagen, ob er nach starken Medikamenten wie Chemotherapie vollständig verschwinden wird.

Getrennte Scans zu einer klaren Ressource zusammenfügen

Bisher wurde der Fortschritt bei KI für Brust‑MRT durch verstreute Daten gebremst: Krankenhäuser speichern Bilder in unterschiedlichen Formaten, verwenden verschiedene Scanner und dokumentieren klinische Angaben unterschiedlich. Das BreastDCEDL‑Projekt ging dieses Problem an, indem es prätherapeutische DCE‑MRT‑Aufnahmen von 2.070 Patientinnen aus drei großen Forschungsgruppen – bekannt als I‑SPY1, I‑SPY2 und Duke – zusammenführte. Das Team konvertierte mehr als 8,5 Millionen einzelne Bildschichten in etwas über elftausend 3D‑Volumen in einem standardisierten Format, das in der medizinischen Bildforschung weit verbreitet ist. Zudem wurden die Aufnahmen zeitlich (vor Kontrastmittel, früh nach und später nach Injektion) und räumlich sorgfältig sortiert, sodass die Scans jeder Patientin korrekt ausgerichtet sind.

Die Tumoren markieren und Fakten zuordnen

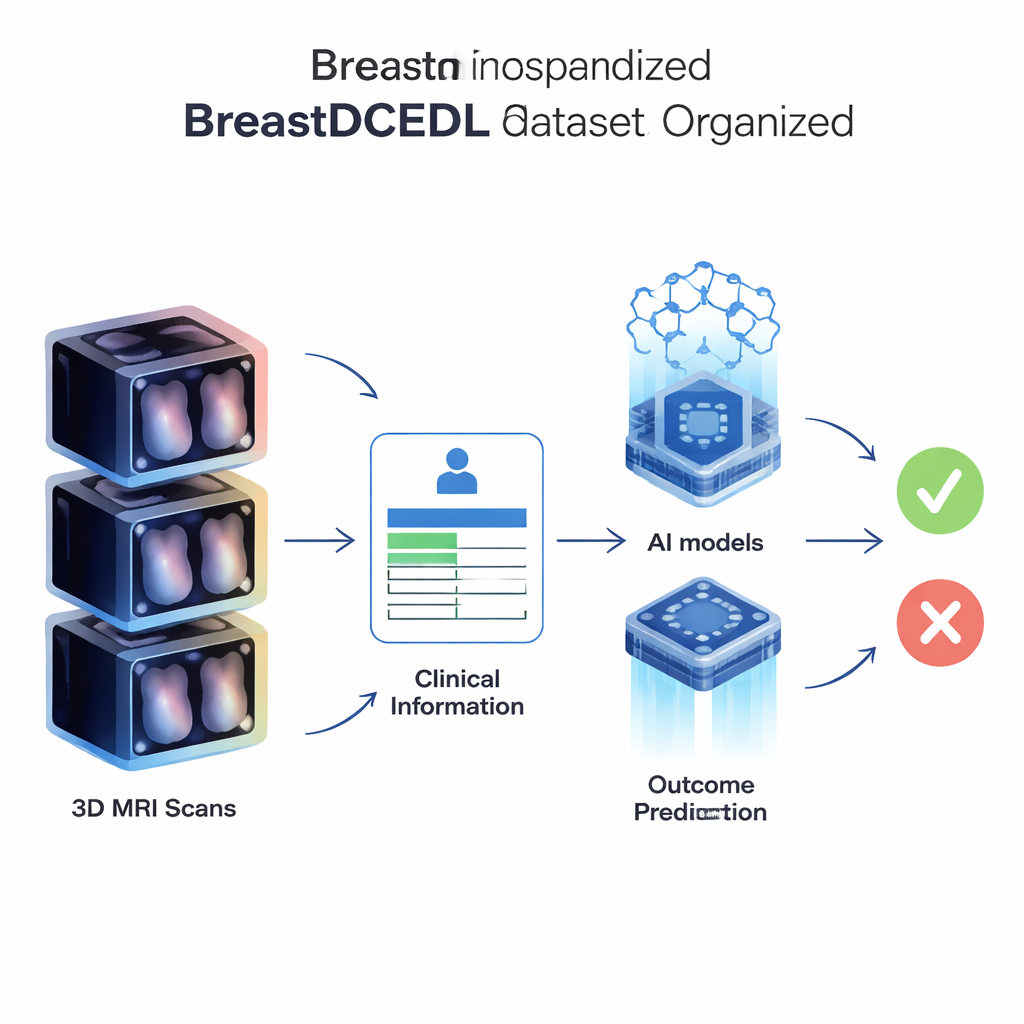

Damit KI lernen kann, muss sie wissen, wo der Tumor liegt und was mit der Patientin geschehen ist. In BreastDCEDL hat jede Patientin Tumorannotationen und die wichtigsten klinischen Informationen. Für die I‑SPY‑Gruppen wurden komplexe Computerbeschreibungen der Tumorumrisse in einfache 3D‑Masken decodiert, die Tumorbereiche Voxel für Voxel kennzeichnen. Für die Duke‑Gruppe zeichneten erfahrene Radiologinnen und Radiologen Begrenzungsrahmen um den größten Tumor in jedem Fall. Neben den Bildern enthält der Datensatz Alter, grundlegende demografische Angaben, Tumorgröße, Hormonrezeptorstatus (HR), HER2‑Status und die Information, ob der Tumor nach Behandlung vollständig verschwunden ist — ein Ergebnis, das als pathologisches Komplettansprechen (pCR) bezeichnet wird. Dieses Outcome, verfügbar für 1.452 Patientinnen, steht in engem Zusammenhang mit dem Langzeitüberleben und ist ein zentrales Ziel für Vorhersagemodelle.

Faire Prüfungen für KI‑Werkzeuge schaffen

Um den Vergleich neuer KI‑Methoden zu erleichtern, stellen die Autorinnen und Autoren festgelegte Trainings‑, Validierungs‑ und Testgruppen zur Verfügung, die ähnliche pCR‑Raten aufweisen. Das bedeutet, dass verschiedene Forschungsteams ihre Modelle an exakt denselben Patientinnen testen können, was Leistungsaussagen vertrauenswürdiger macht. Der Datensatz bewahrt außerdem die natürliche Vielfalt realer Kliniken: Die Aufnahmen stammen aus vielen Zentren, von unterschiedlichen MRT‑Geräten und mit leicht verschiedenen Definitionen von HR‑ und HER2‑Positivität. Anstatt diese Unterschiede zu glätten, dokumentiert BreastDCEDL sie transparent, sodass Forschende entscheiden können, wie sie damit umgehen, und testen können, ob ihre Modelle über verschiedene Patientinnen‑Populationen und Aufnahmebedingungen hinweg robust bleiben.

Was das für künftige Forschung eröffnet

BreastDCEDL ist mehr als nur ein Stapel Bilder; es ist ein gut organisiertes Toolkit für viele Studienformen. Forschende können KI‑Systeme trainieren, um Tumoren zu lokalisieren, Tumorvolumen zu messen, pCR vor Beginn der Behandlung vorherzusagen und zu untersuchen, wie Bildmuster mit der Tumorbiologie zusammenhängen. Patientinnen ohne Outcome‑Daten helfen weiterhin, indem sie zusätzliche Beispiele für unüberwachtes und halbüberwachtes Lernen liefern. Da alle Dateien einer einfachen Benennungsstruktur und einem gemeinsamen Format folgen, können Wissenschaftlerinnen und Wissenschaftler die Daten schnell mit Standardsoftware laden und analysieren, was Tage manueller Vorbereitung spart und die Fehlerwahrscheinlichkeit reduziert.

Ein klarerer Weg zur personalisierten Behandlung

Vereinfacht gesagt verwandelt diese Arbeit eine unordentliche Sammlung von Brust‑MRT‑Aufnahmen aus mehreren Krankenhäusern in eine saubere, gemeinsam nutzbare Grundlage für KI‑Forschung. Durch die Standardisierung der Speicherung von Bildern und klinischen Informationen sowie durch konsistente Markierung von Tumoren und Outcomes gibt BreastDCEDL Forschenden das nötige Material, um Computerwerkzeuge zu entwickeln und fair zu testen, die eines Tages Ärztinnen und Ärzten helfen könnten, für jede Patientin die richtige Behandlung zu wählen. Obwohl es nicht allein Krebs heilen kann, beseitigt es ein zentrales Hindernis auf dem Weg zu präziserer, datengetriebener Brustkrebsversorgung.

Zitation: Fridman, N., Solway, B., Fridman, T. et al. BreastDCEDL: A standardized deep learning-ready breast DCE-MRI dataset of 2,070 patients. Sci Data 13, 264 (2026). https://doi.org/10.1038/s41597-026-06589-6

Schlüsselwörter: Brust‑MRT, Krebsbildgebung, medizinische KI, Therapieansprechen, medizinische Datensätze