Clear Sky Science · de

Kymata Soto Sprachdatensatz: ein elektro‑magnetoenzephalographisches Datenset für die Verarbeitung natürlicher Sprache

Zuhören, wie das Gehirn echte Gespräche hört

Das meiste, was wir täglich sagen und hören, sind zwanglose Unterhaltungen, nicht einzelne Wörter oder sorgfältig gelesene Sätze. Trotzdem basierte ein Großteil der Hirnforschung zur Sprache auf künstlichen Aufgaben. Der Kymata Soto Sprachdatensatz ändert das, indem er eine reichhaltige, offene Sammlung von Hirnaufzeichnungen bereitstellt, die entstehen, während Menschen einfach lebhafte Radiodiskussionen auf Englisch und Russisch hören. Er eröffnet Wissenschaftlern ein kraftvolles neues Fenster darauf, wie unser Gehirn natürliche Sprache verarbeitet.

Eine neue Bibliothek von Gehirnreaktionen auf echte Sprache

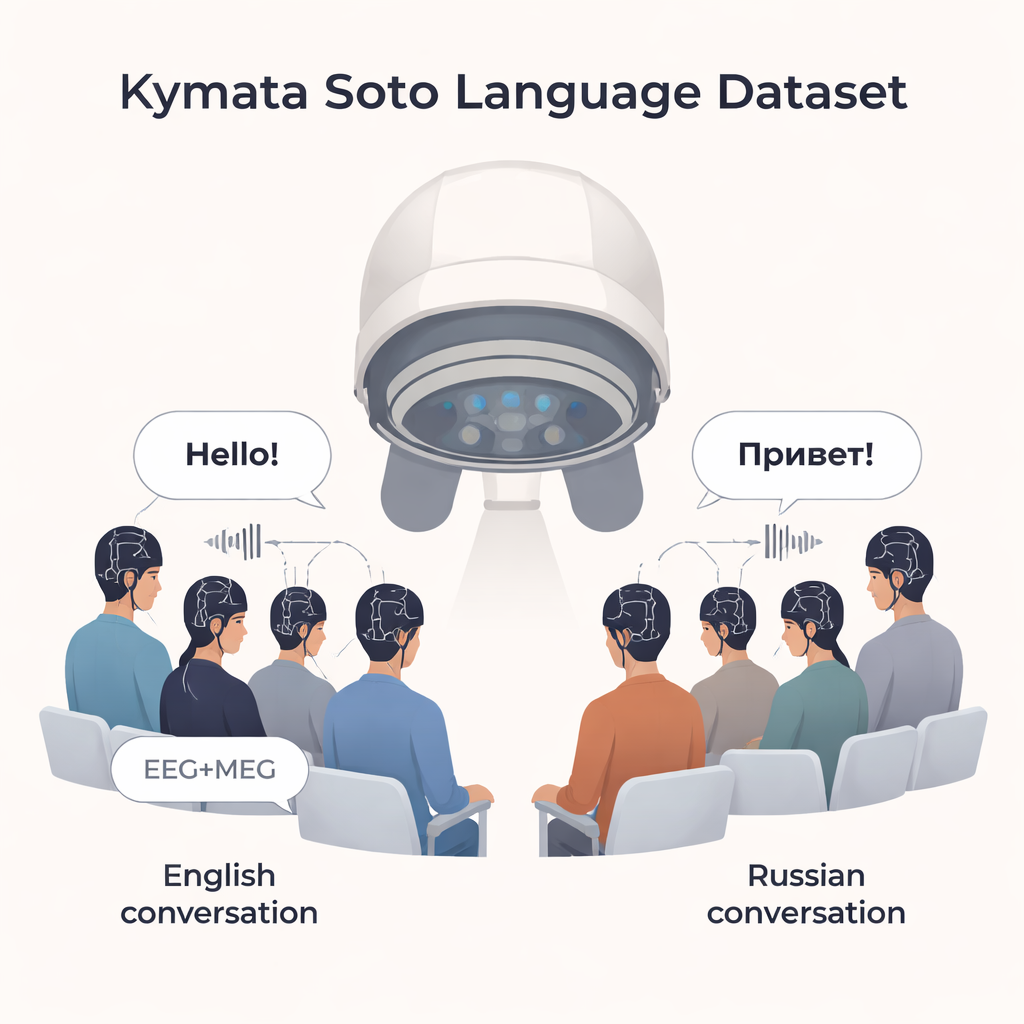

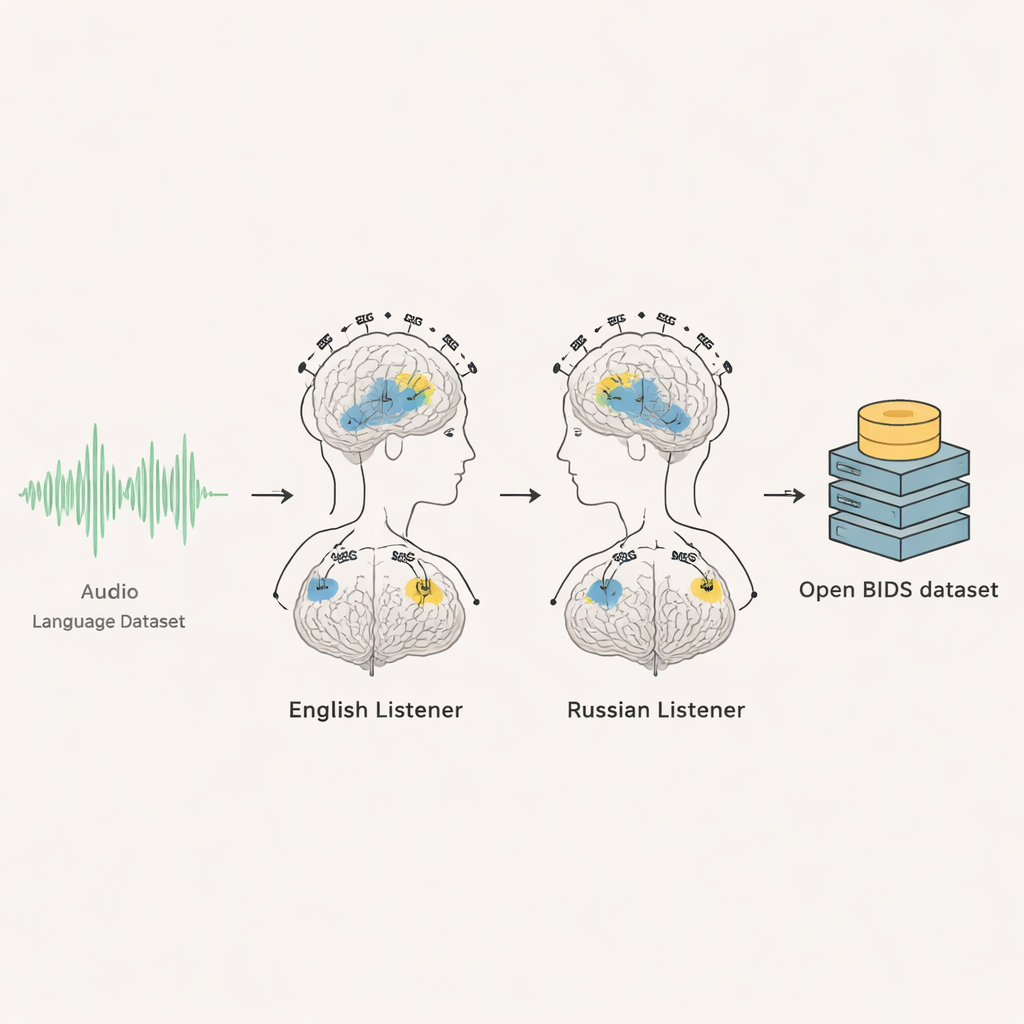

Dieses Projekt vereint zwei fortgeschrittene Hirnaufzeichnungsverfahren — Elektroenzephalographie (EEG) und Magnetenzephalographie (MEG) — von 35 Erwachsenen: 20 Muttersprachlern des Englischen und 15 Muttersprachlern des Russischen. Während sie still saßen und etwa sechseinhalb Minuten radiostiliger Unterhaltung in ihrer jeweiligen Sprache hörten, wurde ihre Gehirnaktivität tausendmal pro Sekunde aufgezeichnet. Jede Person hörte das gleiche Audio mehrfach, sodass Forschende über Wiederholungen mitteln konnten, um die zuverlässigen Hirnantworten aus dem Hintergrundrauschen herauszufiltern. Das Ergebnis ist ein detaillierter, zeitgebundener Bericht darüber, wie das Gehirn Moment für Moment reagiert, während Personen einer sich entfaltenden Diskussion folgen.

Gespräche über Eiscreme und Kaffee

Anstatt klassische Geschichten oder künstliche Sätze zu verwenden, wählte das Team ansprechende, aber alltägliche Themen: die Geschichte der Eiscreme für die englischen Zuhörer und die Geschichte des kolumbianischen Kaffees für die russischen Zuhörer. Beide Aufnahmen stammten aus BBC‑Studio‑Diskussionen mit drei Sprechern (zwei Männer und eine Frau). Die Gespräche wurden auf etwa 400 Sekunden bearbeitet und über Ohrhörer in angenehmen Lautstärken präsentiert. Nach jeder Wiederholung beantworteten die Teilnehmenden ein oder zwei einfache Multiple‑Choice‑Fragen zum Inhalt — gerade genug, um sicherzustellen, dass sie aufmerksam blieben und der Geschichte folgten, nicht um sie streng zu prüfen.

Die Augen beschäftigen, aber den Geist auf den Klang richten

Während die Teilnehmenden zuhörten, fixierten sie ein zentrales Kreuz auf einem Bildschirm. Daran vorbei drifteten Wolken farbiger Punkte, die sich scheinbar zufällig bewegten und veränderten. Diese bewegten Punkte erfüllten zwei Zwecke: Sie halfen, den Blick der Probanden stabil zu halten, was die Datenqualität verbessert, und sie schufen kontrollierte Muster visueller Bewegung und Farbe, die später von anderen Forschenden analysiert werden können. Wichtig ist, dass die Punkte nicht mit dem Sprachinhalt synchronisiert waren, also die Geschichte nicht „illustrierten“ oder Bedeutung hinzufügten; sie boten jedoch einen konsistenten visuellen Hintergrund, der zusammen mit den Klängen studiert werden kann.

Von rohen Hirnsignalen zu gebrauchsfertigen Daten

Die Forschenden dokumentierten sorgfältig jeden Teil des Experiments und organisierten den Datensatz nach einem internationalen Standard für Hirndaten namens BIDS. Für jede Person gibt es rohe EEG‑ und MEG‑Aufzeichnungen, Timing‑Marker für den Audiostart, sekundenweise visuelle Ereignisse und Übungssegmente. Das Team stellt außerdem die Originalaudiodateien, vollständige Transkripte und präzise Zeitangaben dafür bereit, wann jedes Wort und sogar jeder einzelne Sprachlaut begann. Skripte sind enthalten, damit andere die exakt verwendeten Audioausschnitte automatisch reproduzieren können. Für die englische Gruppe werden anonymisierte MRT‑Scans geteilt, sodass Gehirnreaktionen auf die individuelle Gehirnanatomie abgebildet werden können; für die russische Gruppe erlaubte die Einwilligung nicht das Teilen von MRT‑Bildern, sodass Nutzende geraten wird, auf standardisierte Durchschnitts‑Gehirnvorlagen zurückzugreifen.

Überprüfung, dass die Signale Sinn ergeben

Um sicherzustellen, dass die Daten wissenschaftlich vertrauenswürdig sind, führten die Autorinnen und Autoren Validierungsanalysen durch, die sich darauf konzentrierten, wie das Gehirn Veränderungen der Lautstärke über die Zeit verfolgt. Sie verwandelten das Audio in mehrere mathematische Beschreibungen von „zeitlich variierender Lautstärke“ und untersuchten dann, wo und wann die Hirnantworten mit diesen Lautstärkemustern übereinstimmten. Sowohl bei englischen als auch bei russischen Zuhörern zeigte das Gehirn ähnliche zeitliche Muster, was mit Befunden früherer Arbeiten übereinstimmt. Diese Übereinstimmung über Sprachen hinweg und mit früheren Studien ist ein starkes Indiz dafür, dass die Aufzeichnungen sauber, zuverlässig und bereit für weitere Forschung sind.

Warum das für künftige Forschung zu Gehirn und Sprache wichtig ist

Für Nicht‑Spezialisten ist die wichtigste Erkenntnis, dass dieser Datensatz eine neue gemeinsame Ressource darstellt, die vielen verschiedenen Forschungsteams erlaubt zu untersuchen, wie echte, spontane Sprache im Gehirn verarbeitet wird. Da er offen, gut annotiert und in zwei verschiedenen Sprachen aufgenommen ist, kann er Projekte unterstützen, die von grundlegenden Fragen zur Gesprächsverarbeitung über Sprachvergleiche bis hin zu ambitionierten Vorhaben reichen, Sprache direkt aus Gehirnaktivität zu dekodieren. Kurz gesagt: Der Kymata Soto Sprachdatensatz dient weniger dazu, eine einzelne Frage zu beantworten, als vielmehr der wissenschaftlichen Gemeinschaft eine hochwertige, geteilte Grundlage zu geben, um zu erforschen, wie unsere Gehirne die Gespräche verstehen, die unseren Alltag füllen.

Zitation: Yang, C., Parish, O., Klimovich-Gray, A. et al. Kymata Soto Language Dataset: an electro-magnetoencephalographic dataset for natural speech processing. Sci Data 13, 254 (2026). https://doi.org/10.1038/s41597-026-06579-8

Schlüsselwörter: Gehirn und Sprache, Sprachwahrnehmung, EEG MEG, natürliche Unterhaltung, offene Neuroimaging‑Daten