Clear Sky Science · de

Auf dem Weg zur Ende‑zu‑Ende‑Automatisierung der KI‑Forschung

Warum ein Roboter‑Wissenschaftler wichtig ist

Stellen Sie sich einen unermüdlichen digitalen Forscher vor, der Ideen entwickelt, Programmcode schreibt, Experimente durchführt, Diagramme erstellt und sogar wissenschaftliche Artikel nahezu ohne menschliche Hilfe verfasst und begutachtet. Dieses Papier beschreibt ein solches System, genannt „Der KI‑Wissenschaftler“. Es zeigt, dass moderne künstliche Intelligenz inzwischen fast jeden Schritt eines Forschungsprojekts im Bereich des maschinellen Lernens übernehmen kann, was auf eine Zukunft hindeutet, in der Entdeckungen schneller erfolgen — gleichzeitig wirft es jedoch ernsthafte Fragen zu Vertrauen, Arbeitsplätzen und der Gesundheit der Wissenschaft selbst auf.

Von der Idee zum fertigen Artikel

Der KI‑Wissenschaftler ist so konzipiert, dass er den gesamten Lebenszyklus einer Studie durchläuft, ähnlich wie es ein Doktorand tun würde. Zuerst schlägt er Forschungsrichtungen innerhalb eines gewählten Bereichs des maschinellen Lernens vor, erklärt, warum jede Idee interessant sein könnte, und skizziert einen Plan zu deren Überprüfung. Anschließend prüft er diese Ideen anhand von Online‑Forschungsdatenbanken, um zu vermeiden, bereits vorhandene Arbeiten einfach zu kopieren. Nur Ideen, die wirklich neu erscheinen, werden weiterverfolgt. Danach schreibt und bearbeitet das System den benötigten Programmcode für die Experimente, behebt viele der eigenen Fehler und führt ein fortlaufendes „Labornotizbuch“ darüber, was es versucht hat und was passiert ist.

Zwei Wege, das System erkunden zu lassen

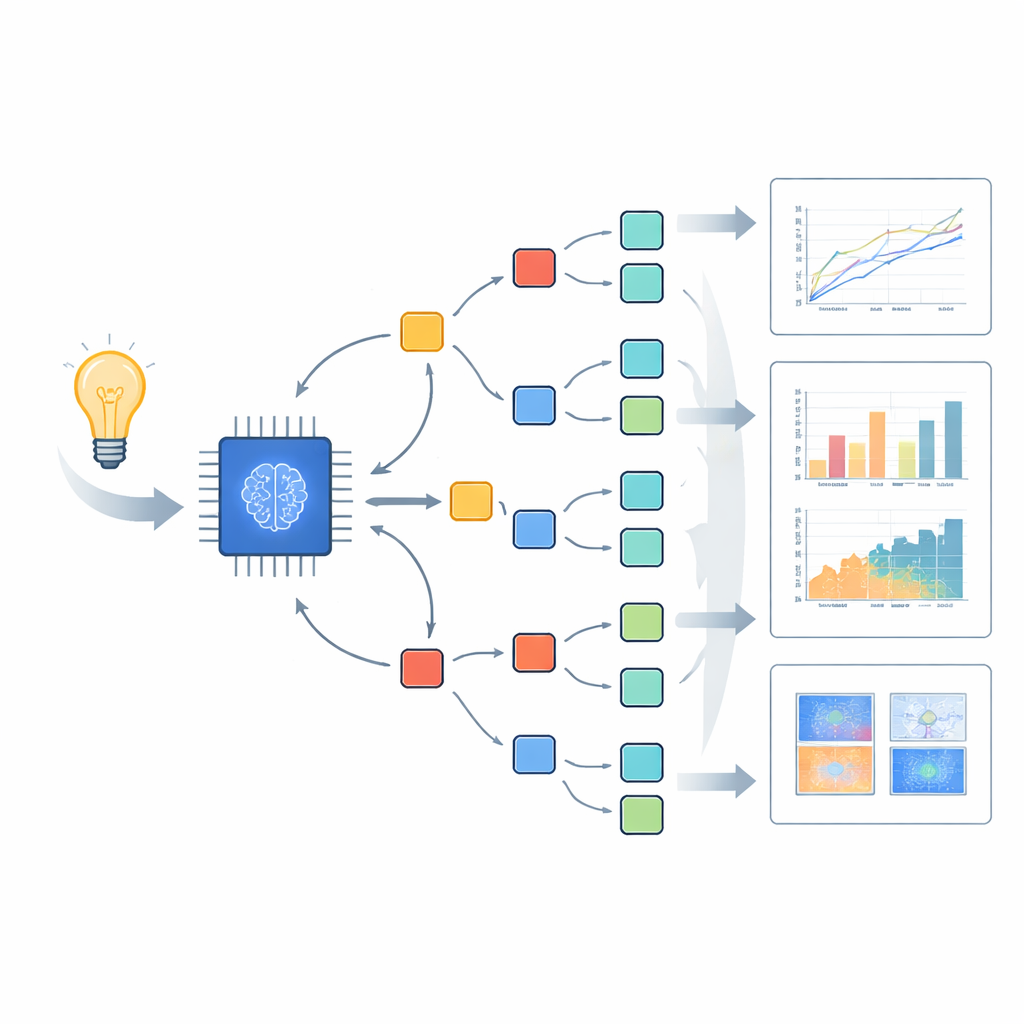

Die Forschenden entwickelten zwei Versionen dieses digitalen Wissenschaftlers. Im „vorlagenbasierten“ Modus stellen Menschen ein einfaches Startprogramm bereit, das das System schrittweise modifiziert, um verwandte Fragen zu untersuchen. Im „vorlagenfreien“ Modus beginnt die KI nahezu bei Null: sie erfindet Ideen, entwirft Experimente und schreibt eigenständig Code, geleitet nur von groben Vorgaben wie dem Thema eines Workshop‑Tracks. Diese offenere Version nutzt eine verzweigende Suche durch viele parallele Experimentpfade, fördert die vielversprechendsten und kürzt solche, die abstürzen oder schlechte Ergebnisse liefern. Mehr Rechenleistung erlaubt es, mehr Zweige zu erkunden und führt tendenziell zu stärkeren abschließenden Studien.

Der KI das Begutachten beibringen

Die Qualität eines endlosen Stroms KI‑verfasster Arbeiten zu beurteilen ist eine Herausforderung, daher entwickelte das Team auch einen Automatisierten Gutachter. Dieses Werkzeug liest Forschungsarbeiten, bewertet sie hinsichtlich Solidität und Beitrag, listet Stärken und Schwächen auf und gibt eine Annahme‑oder‑Ablehnungsempfehlung nach denselben Richtlinien wie eine führende Konferenz im maschinellen Lernen. Bei Tests an Tausenden realer Arbeiten mit bekannten Entscheidungen stimmten die Urteile des Automatisierten Gutachters ungefähr so gut mit denen menschlicher Gutachter überein wie Menschen untereinander. Auch bei aktuellen Arbeiten, die nicht in den Trainingsdaten enthalten waren, zeigte das System ähnliche Leistungen, was darauf hindeutet, dass es die Begutachtungsaufgabe wirklich gelernt hat und nicht nur Ergebnisse auswendig gelernt hat.

Den KI‑Wissenschaftler auf die Probe stellen

Um zu prüfen, wie gut ihr System in der Praxis funktioniert, baten die Autorinnen und Autoren das System, vollständige Artikel für einen Workshop einer führenden Konferenz im Bereich maschinelles Lernen zu erzeugen. Mit zustimmender Ethikprüfung und in Zusammenarbeit mit den Organisatoren wurden drei KI‑generierte Manuskripte neben von Menschen verfassten eingereicht. Die Gutachter wurden darüber informiert, dass einige Einreichungen KI‑generiert sein könnten, jedoch nicht welche. Eines der drei KI‑erstellten Papiere erhielt Begutachtungsnoten, die für eine Annahme beim Workshop ausgereicht hätten; die Autorinnen und Autoren zogen es anschließend nach einem vorab vereinbarten Protokoll zurück. Die beiden anderen Arbeiten erreichten nicht das erforderliche Niveau. Insgesamt erzeugte das System bislang Arbeiten, die noch nicht mit der besten menschlichen Forschung mithalten können, aber bereits gut genug sind, gelegentlich eine reale Begutachtung zu bestehen.

Versprechen, Fallstricke und der weitere Weg

Obwohl der KI‑Wissenschaftler weiterhin Fehler macht — etwa oberflächliche Ideen, Programmierfehler und irreführende Zitate — deutet die Studie darauf hin, dass solche Systeme mit Verbesserungen der zugrunde liegenden KI‑Modelle und Rechenressourcen wahrscheinlich deutlich besser werden. Das könnte die Entdeckungsgeschwindigkeit in Bereichen drastisch erhöhen, in denen Experimente am Computer oder in automatisierten Laboren durchgeführt werden können. Gleichzeitig könnte die einfache Erstellung von Artikeln Zeitschriften mit minderwertigen Arbeiten überschwemmen, die Grenzen von Urheberschaft und Anerkennung verwischen und riskante oder unethische Experimente erleichtern. Die Autorinnen und Autoren argumentieren, dass die wissenschaftliche Gemeinschaft jetzt klare Regeln und Schutzmaßnahmen benötigt, solange die Technologie noch im Entstehen ist, damit automatisierte Forschende die Wissenschaft stärken anstatt sie zu schwächen.

Zitation: Lu, C., Lu, C., Lange, R.T. et al. Towards end-to-end automation of AI research. Nature 651, 914–919 (2026). https://doi.org/10.1038/s41586-026-10265-5

Schlüsselwörter: automatisierte wissenschaftliche Forschung, KI‑Wissenschaftler, Experimente im maschinellen Lernen, Automatisierung der Begutachtung, wissenschaftliche Integrität