Clear Sky Science · de

Ein großskaliger kohärenter 4D-Bildgebungssensor

Die Welt in vier Dimensionen sehen

Autonome Fahrzeuge, Lieferdrohnen und Augmented-Reality-Headsets beruhen alle auf Systemen, die die dreidimensionale Umgebung in Echtzeit erfassen können. Heutige Lösungen für diese Art von Wahrnehmung sind oft sperrig, teuer oder energieintensiv. Dieser Beitrag berichtet einen wichtigen Schritt in Richtung einer „4D-Kamera“ — eines chipskaligen Sensors, der nicht nur die Form einer Szene in 3D abbildet, sondern auch misst, wie sich Objekte bewegen, und so kompakte maschinelle Wahrnehmung von Robotern bis zu Smartphones ermöglichen könnte.

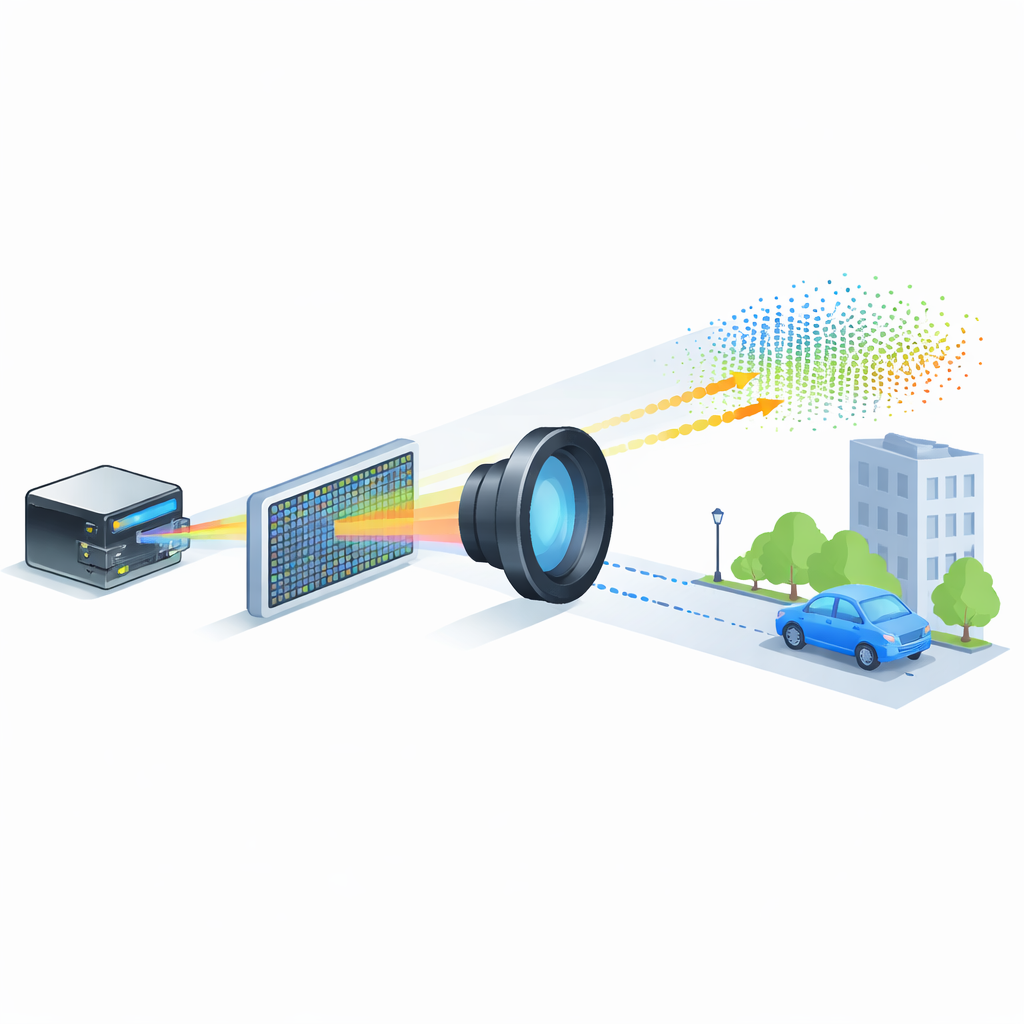

Von flachen Fotos zu lebendigen Karten

Konventionelle Kameras erfassen Lichtintensität auf einer Ebene und liefern schöne 2D-Bilder, aber keine direkten Entfernungsinformationen. Im Gegensatz dazu senden Light Detection and Ranging (LiDAR)-Systeme Laserpulse aus und messen, wie lange deren Rückkehr dauert, um eine 3D-Karte der Umgebung zu erstellen. Bestehende Ansätze erreichen große Reichweiten und hohe Detailgenauigkeit, erfordern jedoch oft bewegliche Teile, große Optiken oder hohe Energie pro gemessenem Punkt. Das erschwert es, etwas so Klein, Günstig und Robust wie eine Smartphone-Kamera zu bauen, das dennoch Straßen, Industrieanlagen oder überfüllte Räume sicher und fein aufgelöst erfassen kann.

Ein Chip, der Entfernung und Bewegung misst

Die Forschenden stellen eine neue Art von LiDAR-Fokalplattenarray vor — im Wesentlichen eine LiDAR-Version des Bildsensors in einer Digitalkamera. Ihr Gerät enthält 352 mal 176 Pixel, insgesamt mehr als 60.000 Messstellen, die alle auf einem einzigen Silicon-Photonics-Chip zusammen mit der Steuerelektronik integriert sind. Statt kurzer Laserpulse nutzt das System frequenzmoduliertes Dauerstrichlicht (FMCW), bei dem die Wellenlänge des Lasers in einem kontrollierten „Chirp“ variiert wird. Wenn Licht von Objekten zurückkommt und auf den Chip trifft, wird es kohärent mit einem Referenzstrahl überlagert. Kleine Frequenzunterschiede verraten sowohl die Entfernung jedes Punkts als auch dessen Radialgeschwindigkeit relativ zum Sensor, wodurch die Geschwindigkeit als vierte Messdimension hinzukommt.

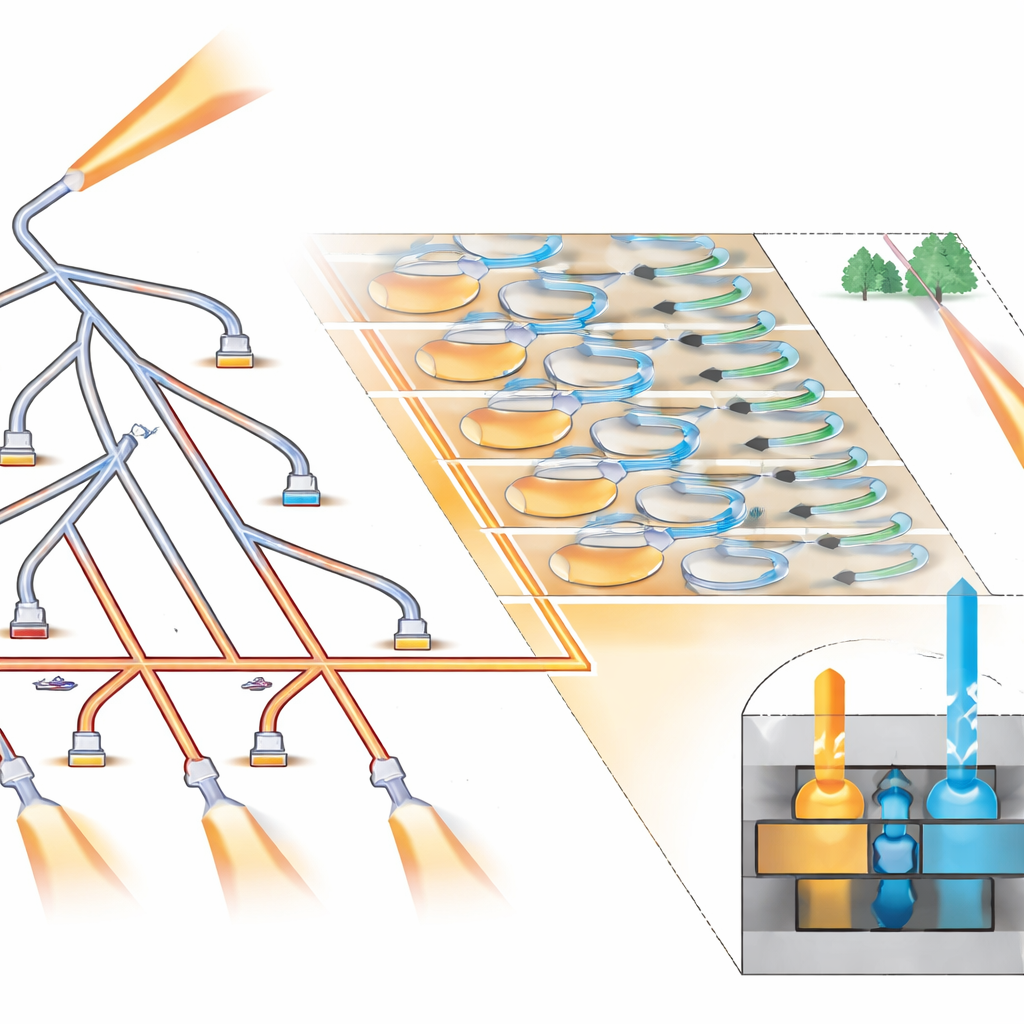

Wie das winzige Lichtgitter funktioniert

Um viele Pixel abzudecken, ohne Energie zu verschwenden, leitet der Chip das chirpende Laserlicht durch einen Baum aus winzigen optischen Schaltern und steuert es nacheinander zu Gruppen von acht benachbarten Pixeln. Innerhalb jeder Gruppe wird das Licht gleichmäßig aufgeteilt, sodass alle acht gleichzeitig als Sender und Empfänger fungieren. Jedes Pixel verwendet ein Paar Gitterkoppler zum Senden und Empfangen von Licht sowie ein Paar balancierter Photodetektoren und einen On-Pixel-Verstärker, um das Beat-Signal zu extrahieren, das Entfernung und Geschwindigkeit kodiert. Speziell gestaltete Mikrolinsen, die direkt auf dem Chip aufgebracht sind, helfen, mehr Licht ein- und auszuleiten und verbessern so die Effizienz. Da dieselbe Öffnung sendet und empfängt (monostatisches Design), vermeidet das System unerwünschte Kopplungen zwischen Pixeln und benötigt nur eine einzelne externe Objektivlinse, ähnlich wie eine normale Kamera.

Die 4D-Kamera im Praxistest

Mit handelsüblichen kurzwelligen Infrarotlinsen baute das Team ein kameraähnliches Modul um den Chip und erfasste detaillierte 3D-Punktwolken von Innen- und Außenbereichen. Mit einer Linse erreichte der Sensor ein Sichtfeld von etwa 33 mal 19 Grad und eine Winkelauflösung von bis zu 0,06 Grad — ausreichend, um Möbel in einem Büro und architektonische Details an Gebäuden in Dutzenden Metern Entfernung zu erkennen. Das System maß Objekte in einem Bereich von 4 bis 65 Metern unter Verwendung nur weniger Zehner-Nanojoule optischer Energie pro Punkt und einer durchschnittlichen Zielleistung von etwa 178 Mikrowatt pro Pixel und blieb dabei innerhalb strenger Augensicherheitsgrenzen. Es verfolgte zudem Bewegungen: In einem Experiment bestimmte es die sich ändernde Radialgeschwindigkeit einer rotierenden Scheibe mit Millimeter-pro-Sekunde-Präzision.

Leistung, Grenzen und künftiges Wachstum

Sorgfältige Messungen zeigen, dass die Sensorleistung nahe an den fundamentalen physikalischen Grenzen liegt, die durch die Quantennatur des Lichts gesetzt sind, aber noch nicht ganz dort angekommen ist. Derzeit ist die Hauptbegrenzung das elektronische Rauschen der Verstärker in jedem Pixel, das das Signal-Rausch-Verhältnis gegenüber einem idealen, rein photonengesteuerten Detektor etwas reduziert. Die Autorinnen und Autoren skizzieren einfache Designanpassungen — vor allem die Erhöhung des internen Referenzlichtniveaus und die Verfeinerung des optischen Layouts, gegebenenfalls unter Verwendung von Silizium–Siliziumnitrid-Kombinationen — die das System in einen wirklich schussrauschbegrenzten Bereich bringen und die nutzbare Reichweite auf über 200 Meter ausdehnen könnten. Das Auslagern einiger On-Chip-Schalter aus der Pixelmatrix würde außerdem kleine Lücken in der Fernfeldabdeckung entfernen und sauberere Punktwolken liefern.

Auf dem Weg zur alltäglichen 4D-Wahrnehmung

Diese Arbeit demonstriert einen kompakten, vollständig integrierten 4D-Bildgebungssensor, der mit den Pixelzahlen und Reichweiten vieler realer Anwendungen mithalten kann und gleichzeitig Größe und Leistungsaufnahme im Blick behält. Indem Lichtemitter, Empfänger, Strahlsteuerung und Steuerelektronik auf einem einzigen Siliziumchip zusammengebracht werden, übernimmt das Gerät für 3D- und Bewegungswahrnehmung eine ähnliche Rolle wie der CMOS-Sensor für die Digitale Fotografie. Mit weiteren Verfeinerungen könnten solche Sensoren so kostengünstig und robust werden, dass sie in Autos, Robotern, Telefonen und Headsets eingebettet werden, um Maschinen ein präzises, Echtzeitverständnis der 3D-Welt und ihrer ständigen Veränderungen zu geben.

Zitation: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Schlüsselwörter: LiDAR, 4D-Bildgebung, Silicon Photonics, autonome Systeme, Tiefensensorik