Clear Sky Science · de

Symbolische Analyse des Grover-Suchalgorithmus mittels Chain-of-Thought-Reasoning und quanten-nativer Tokenisierung

Computern beibringen, Quanten-Schaltkreise zu lesen

Quantencomputer versprechen bei bestimmten Aufgaben drastische Beschleunigungen, doch ihre Programme sind für Menschen berüchtigt schwer zu durchschauen. Heutige Werkzeuge können berechnen, was ein Quanten-Schaltkreis ausgibt, erklären jedoch selten, warum er so funktioniert. Dieses Paper stellt GroverGPT+ vor, ein spezialisiertes KI-Modell, das den Code eines bekannten Quanten-Suchalgorithmus — Grovers Algorithmus — „lesen“ und seine Logik klar und schrittweise erklären kann, ähnlich einem erfahrenen Lehrer, der einen Schüler durch ein komplexes Rätsel führt.

Von Zahlenschieberei zu Verständnis

Die meisten existierenden Programme für Quantencomputing konzentrieren sich auf rohe Berechnung. Gibt man einen Schaltkreis ein, verfolgen diese Simulatoren eine enorme Wolke von Quantenwahrscheinlichkeiten, um Messresultate vorherzusagen. Das Verfahren ist leistungsfähig, aber undurchsichtig: die Software multipliziert große Matrizen, liefert Endwahrscheinlichkeiten und überlässt es menschlichen Expertinnen und Experten, die Struktur des Algorithmus abzuleiten. Im Gegensatz dazu ist GroverGPT+ darauf ausgelegt, symbolische Analysen durchzuführen. Es nimmt dieselbe niedrigstufige Beschreibung eines Schaltkreises in einer Quanten-Assemblersprache namens QASM entgegen und zielt darauf ab, die übergeordneten Rollen der verschiedenen Teilabschnitte des Schaltkreises zu beschreiben — insbesondere die "Oracle"-Komponente, die kodiert, welche Antworten in Grovers Suche als korrekt gelten.

Ein sprachmodell, der Quanten versteht

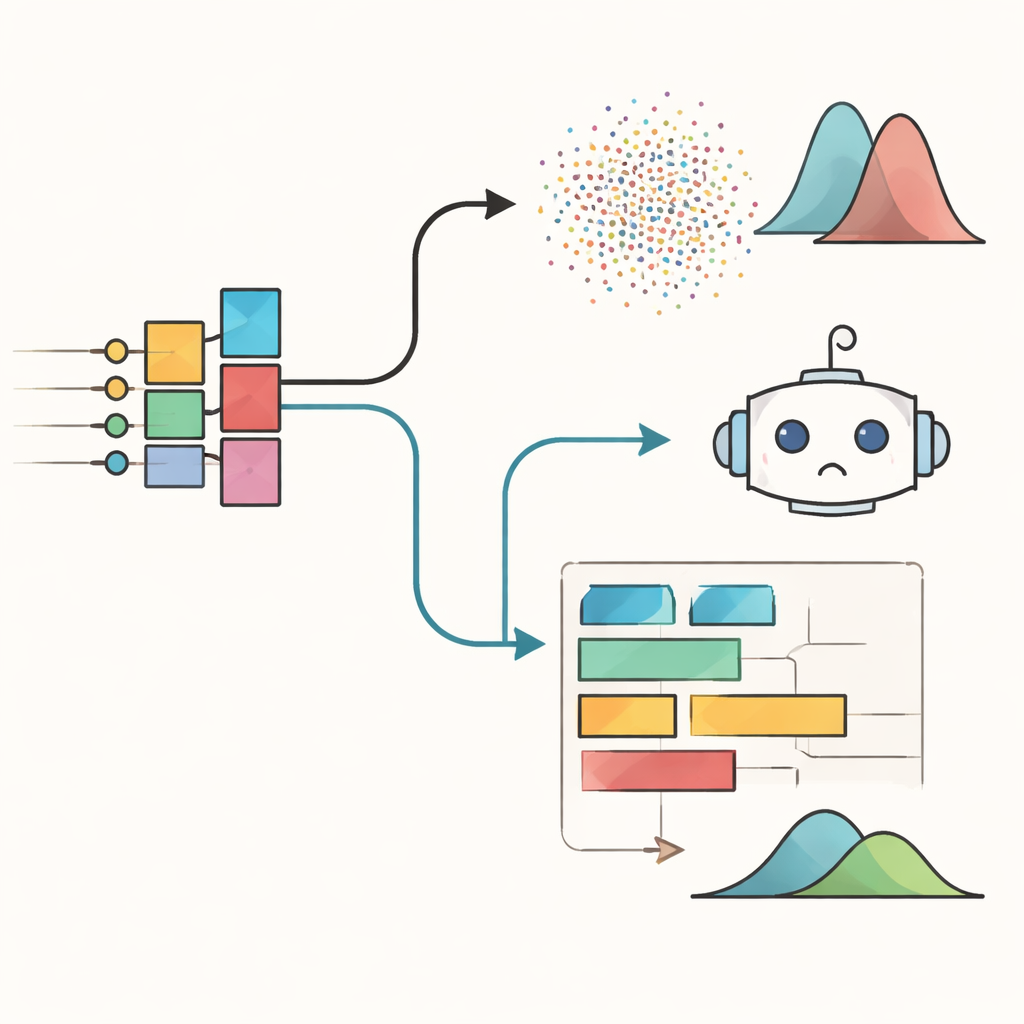

Im Kern ist GroverGPT+ ein großes Sprachmodell — eine neuronale Netzwerkarchitektur, die ursprünglich zur Verarbeitung und Erzeugung natürlicher Sprache entwickelt wurde. Um es in der "Sprache" von Quanten-Schaltkreisen versiert zu machen, führen die Autoren zwei zentrale Anpassungen ein. Erstens entwerfen sie einen quanten-nativen Tokenizer, der QASM-Code in sinnvolle Einheiten aufteilt, etwa einzelne Gatter und Qubit-Bezeichner, statt in willkürliche Textfragmente. Diese kompakte, strukturbewusste Kodierung hilft dem Modell, ganze Operationen auf einen Blick zu erfassen. Zweitens trainieren sie das Modell mit Chain-of-Thought-Supervision: Es lernt nicht nur die richtigen Endantworten, sondern auch detaillierte Schlussfolgerungspfad, die Schritt für Schritt zeigen, wie das Oracle extrahiert, die markierten Zustände identifiziert und die Wahrscheinlichkeit jedes möglichen Ergebnisses vorhergesagt wird.

GroverGPT+ auf dem Prüfstand

Um das System rigoros zu bewerten, nutzen die Autorinnen und Autoren Grovers Algorithmus als kontrolliertes Labor. Die Grover-Suche besitzt saubere mathematische Eigenschaften: Für eine gegebene Anzahl von Qubits und markierten Zuständen können Fachleute genau angeben, welche Zustände speziell sind und wie wahrscheinlich der Algorithmus ist, sie zu finden. Das Team erzeugt viele Schaltkreise mit unterschiedlichen Größen und verschiedenen Anzahlen von Ziel-Lösungen und bittet GroverGPT+, die markierten Zustände zu identifizieren und die Ausgabewahrscheinlichkeiten zu rekonstruieren. Der Erfolg wird auf zwei Arten gemessen: Suchgenauigkeit, die prüft, ob die Top-Vorhersagen des Modells mit den tatsächlich markierten Zuständen übereinstimmen, und klassische Fidelity, die die vollständige Wahrscheinlichkeitsverteilung mit der eines idealen Simulators vergleicht.

Genau, stabil und überraschend skalierbar

Über Schaltkreise mit bis zu sieben Qubits — dem Bereich, auf dem es trainiert wurde — lokalisiert GroverGPT+ konstant die korrekten Zielzustände und reproduziert die richtigen Wahrscheinlichkeitsmuster, wobei Suchgenauigkeit und Fidelity nahe eins liegen und nur geringe Schwankungen zeigen. Vorgefertigte Sprachmodelle hingegen zeigen deutlich geringere und weniger stabile Leistungen. Die Autoren untersuchen außerdem, wie gut GroverGPT+ über sein Trainingsregime hinaus generalisiert. Bei leicht größeren Vollschaltkreisen mit acht oder neun Qubits bleibt seine Genauigkeit hoch, mit nur einem moderaten Abfall. Bei kompakteren Eingaben, die nur den Oracle-Teil des Schaltkreises enthalten, arbeitet es sogar bis zu dreizehn Qubits zuverlässig. Ebenfalls bemerkenswert ist, dass die Analysezeit des Modells nur sanft mit der Schaltkreisgröße wächst und sich in etwa innerhalb einer Größenordnung der kleinsten Fälle hält — deutlich besser als das exponentielle Wachstum einer vollständigen Quanten-Zustandssimulation.

Eine neue Perspektive auf die Komplexität Quantenalgorithmen

Diese Ergebnisse deuten darauf hin, dass KI-Modelle wie GroverGPT+ wertvolle Begleiter für Quantenforscher, Lehrende und Studierende werden können. Anstatt numerische Simulatoren zu ersetzen, bieten sie eine andere Funktion: sie verwandeln niedrigstufigen Schaltkreiscode in hochstufige Erklärungen dessen, was der Algorithmus tut und warum er funktioniert. Die Autoren gehen noch weiter und schlagen einen konzeptuellen Wandel vor. Wenn einige Quantenalgorithmen für einen KI-Reasoner leicht zu erlernen und zu erklären sind, andere jedoch nicht, könnte dieser Unterschied etwas über ihre zugrunde liegende konzeptionelle Komplexität verraten, jenseits traditioneller Ressourcenmaße wie der Anzahl von Gattern. In dieser Sicht ist GroverGPT+ nicht nur ein Werkzeug zum Debugging, sondern ein frühes Prototyp eines KI-"wissenschaftlichen Instruments" — eines Instruments, das hilft, die Struktur und Verständlichkeit von Quantenalgorithmen selbst zu untersuchen.

Zitation: Chen, M., Cheng, J., Li, P. et al. Symbolic analysis of Grover search algorithm via Chain-of-Thought reasoning and quantum-native tokenization. npj Quantum Inf 12, 48 (2026). https://doi.org/10.1038/s41534-026-01195-1

Schlüsselwörter: Quantenalgorithmen, Grover-Suche, große Sprachmodelle, symbolische Analyse, Werkzeuge für Quantencomputing