Clear Sky Science · de

Überwindung der Grenzen dimensionaler Faktorisierung in diskreten Diffusionsmodellen durch Quantenlernen gemeinsamer Verteilungen

Warum dieser neue Dreh zwischen KI und Quanten wichtig ist

Moderne KI‑Systeme sind bemerkenswert gut darin, Text, Bilder und andere Daten zu erzeugen, doch sie tun sich schwer, wenn viele Teile der Daten stark miteinander verknüpft sind. Dieses Paper zeigt, dass eine große Klasse generativer KI‑Modelle, die sogenannten diskreten Diffusionsmodelle, eine eingebaute Beschränkung hat: Wenn Daten höherdimensional und stärker korreliert werden, können ihre Fehler schnell anwachsen. Die Autoren schlagen einen neuen Ansatz vor, der Quantencomputer nutzt, um diese komplexen Zusammenhänge treuer zu lernen, was potenziell schnellere und flexiblere generative Modelle als heutige klassische Verfahren ermöglichen könnte.

Wenn Zerlegen das Wesentliche zerstört

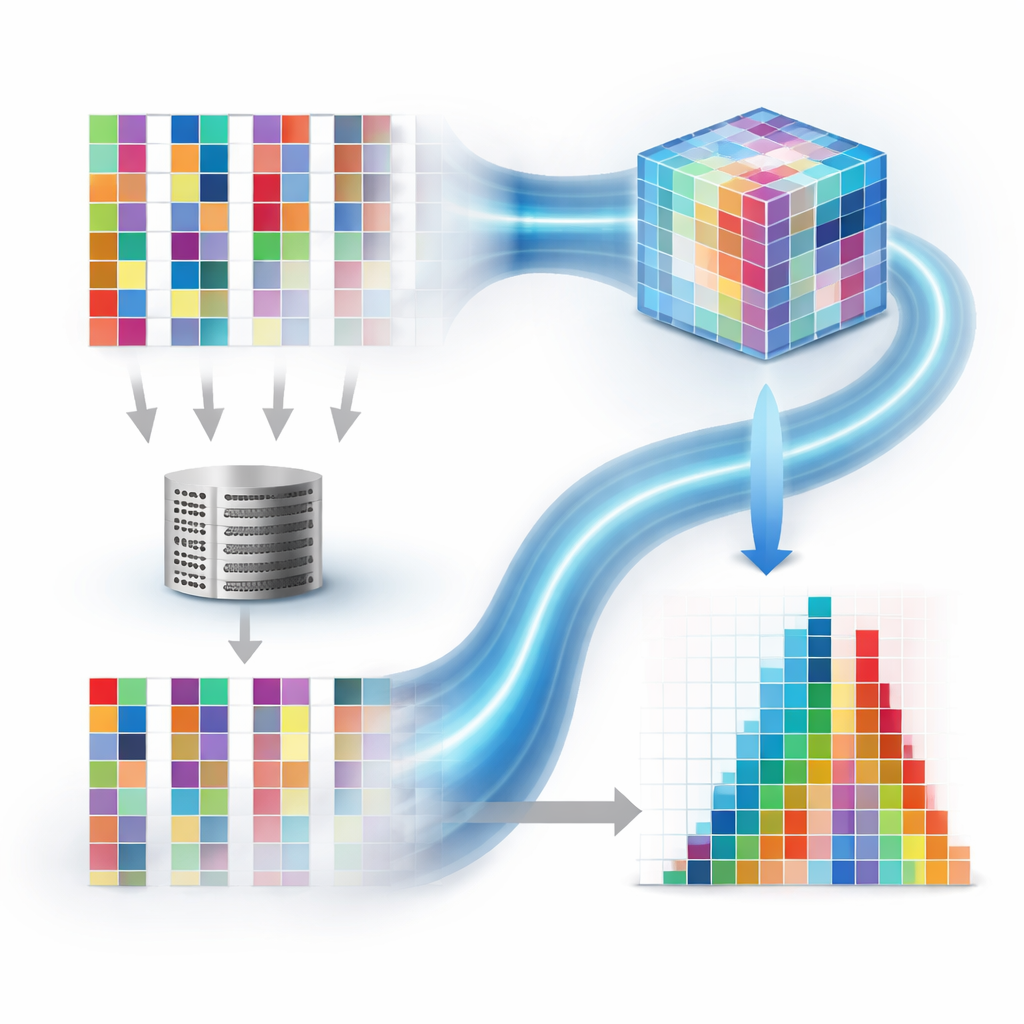

Klassische diskrete Diffusionsmodelle funktionieren, indem sie Daten schrittweise mit Rauschen korruptieren und dann lernen, diesen Prozess Schritt für Schritt umzukehren, um neue Stichproben zu erzeugen. Um die Berechnungen handhabbar zu halten, behandeln sie jede Dimension — etwa jedes Pixel in einem Bild oder jedes Symbol in einer Sequenz — so, als verändere sie sich unabhängig von den anderen. Diese „Faktorisierung“ verhindert eine exponentielle Explosion der Komplexität, ignoriert jedoch die Korrelationen zwischen den Dimensionen. Die Autoren analysieren ein Worst‑Case‑Szenario, in dem jeder Teil der Daten stark mit jedem anderen Teil verbunden ist. Sie beweisen, dass in solchen Daten die Abweichung zwischen der wahren Verteilung und dem, was ein faktorisiertes Modell lernen kann, ungefähr proportional zur Anzahl der Dimensionen wachsen kann. Mit anderen Worten: Sobald Daten größer und strukturierter werden, können klassische diskrete Diffusionsmodelle grundlegend versagen, das Abhängigkeitsverhältnis der Informationsbausteine korrekt abzubilden.

Korrelationsbewahrung durch Quantenzustände

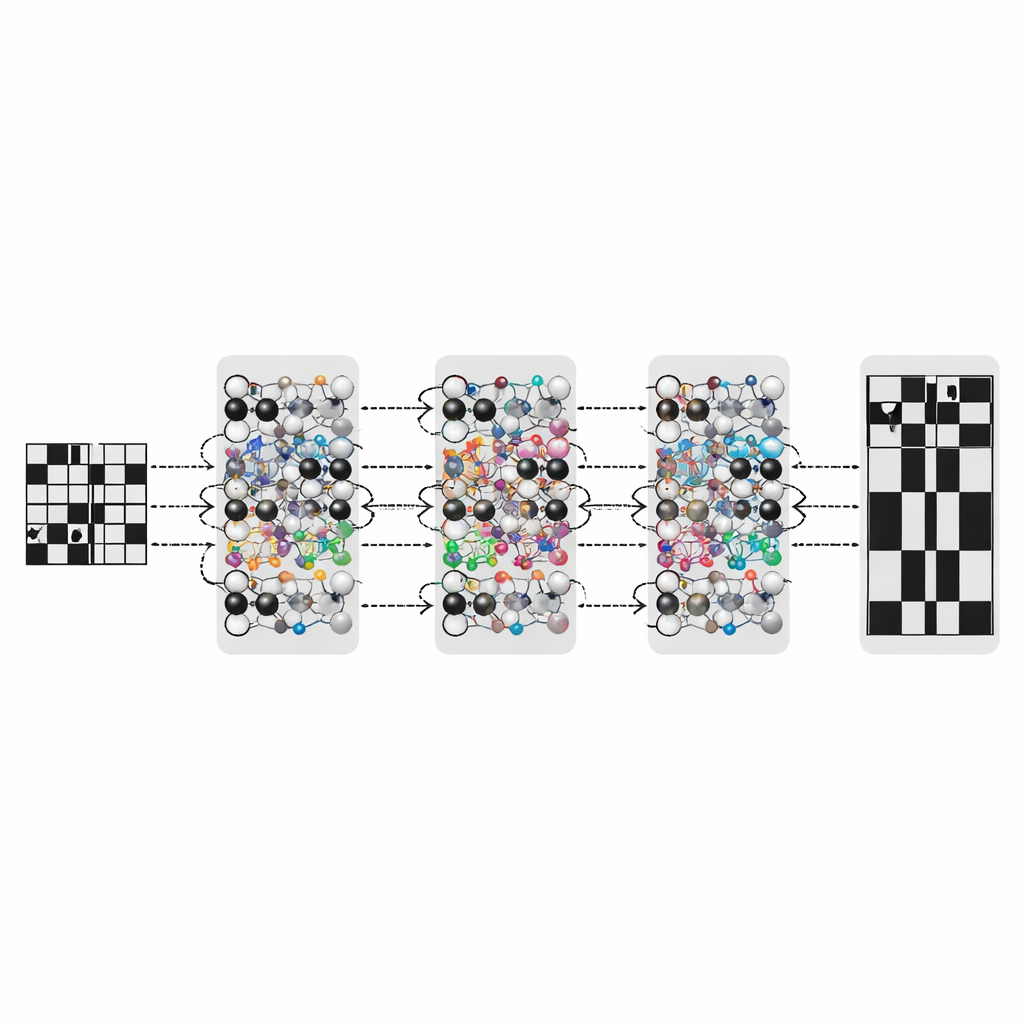

Das vorgeschlagene Quantum Discrete Denoising Diffusion Probabilistic Model (QD3PM) begegnet diesem Problem, indem es Daten als Quantenzustände statt als separate klassische Variablen darstellt. In einem Quantensystem lebt eine Sammlung von Qubits natürlich in einem sehr großen gemeinsamen Raum, in dem gemeinsame Konfigurationen und Korrelationen zusammen gespeichert sind. QD3PM kodiert diskrete Daten in diesem Raum, wendet einen kontrollierten „Diffusions“prozess an, der über Quantenkanäle Rauschen hinzufügt, und lernt dann, diesen Prozess mit einer trainierbaren Quanten‑Schaltung umzukehren. Entscheidend ist, dass das Modell auf dem vollständigen gemeinsamen Zustand arbeitet, sodass die Wechselbeziehungen zwischen den Dimensionen während Diffusion und Denoising erhalten bleiben. Mit einer an die Quanten‑Theorie angepassten Version der Bayes‑Regel leiten die Autoren her, wie der exakte „Posterior“‑Quantenzustand berechnet werden muss, der das Training leiten sollte, und entwerfen Schaltungen, die dieses Update physisch implementieren.

Von vielen langsamen Schritten zu einem einzigen Quantensprung

Standard‑Diffusionsmodelle benötigen üblicherweise viele Runden schrittweisen Denoisings, um reines Rauschen in eine realistische Stichprobe zu verwandeln, was sie rechnerisch teuer macht. QD3PM wird zunächst in dieser vertrauten iterativen Weise beschrieben, doch die Autoren zeigen anschließend, wie dieselbe Quanten‑Schaltung so trainiert werden kann, dass sie direkt in einem Schritt von Rauschen zu sauberen Daten springt. Sie erreichen dies, indem die Quanten‑Schaltung die Verteilung der Originaldaten bedingt auf einen verrauschten Input lernt und diese gelernte Abbildung dann sorgfältig mit den Quanten‑Diffusions‑ und Update‑Regeln komponiert. Dank Eigenschaften von Quantenoperationen und Messungen hängt das finale Sampling nur von bestimmten Diagonalelementen des Quantenzustands ab, was das Verfahren vereinfacht, ohne die beobachtbaren Ergebnisse zu verändern. Das ergibt einen One‑Shot‑Generator, der prinzipiell deutlich schneller sein kann als klassische mehrstufige Diffusion, während er dennoch die vollständige gemeinsame Verteilung modelliert.

Ausfüllen von Lücken, ohne neu anzufangen

Ein praktischer Vorteil von QD3PM ist, wie natürlich es bedingte Aufgaben wie Inpainting — das Ausfüllen fehlender Bildteile bei Kenntnis des sichtbaren Bereichs — handhabt. Da das Modell die vollständige gemeinsame Verteilung über alle Dimensionen beschreibt, können die Autoren ganz einfach auf bekannte Werte konditionieren, indem sie diese Teile der Daten während der Denoising‑Schritte wiederholt zurücksetzen, während die unbekannten Teile variieren dürfen. So wird der Sampling‑Prozess behutsam in Richtung der korrekten bedingten Verteilung gelenkt, ohne die Schaltung zu verändern oder neu zu trainieren. In Simulationen auf synthetischen Datensätzen, die stark strukturierte „Balken und Streifen“‑Muster enthalten, passt QD3PM nicht nur die Gesamtdistribution genauer an als sowohl klassische Diffusionsmodelle als auch Quantenmodelle, die auf Faktorisierung setzen, sondern arbeitet auch robust unter realistischen Pegeln von Quantenhardware‑Rauschen und meistert bedingte Erzeugung gut.

Worin die Ergebnisse künftig bestehen

Zusammengefasst zeigen Analyse und Experimente, dass das unabhängige Behandeln von Dimensionen ein ernsthafter Engpass für diskrete Diffusionsmodelle ist, wenn Daten stark korreliert sind. Indem stattdessen Quantenzustände genutzt werden, um gemeinsame Verteilungen direkt zu lernen, umgeht QD3PM diese Beschränkung und kann theoretisch komplexe Zielverteilungen perfekt nachbilden in Fällen, in denen klassische faktorisiert arbeitende Ansätze nicht ausreichen. Die Arbeit demonstriert außerdem, dass Quanten‑generative Modelle nicht nur rohe Ausdruckskraft bieten können, sondern auch praktische Vorteile wie schnelleres One‑Step‑Sampling und flexible bedingte Inferenz ohne Retraining. Obwohl die aktuellen Demonstrationen auf relativ kleine Systeme beschränkt sind, die auf klassischen Computern simuliert werden können, liefert das Framework einen konkreten Fahrplan dafür, wie aufkommende Quantenhardware eines Tages die Kernmechanik generativer KI verbessern könnte.

Zitation: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Schlüsselwörter: quanten-generative Modelle, Diffusionsmodelle, gemeinsames Verteilungslernen, hochdimensionale Korrelationen, konditionale Erzeugung