Clear Sky Science · de

Ein multimodales Framework zur Erkennung von Müdigkeitsfahren durch Merkmalsfusion von visuellen und taktilen Informationen

Warum Wachbleiben am Steuer wichtig ist

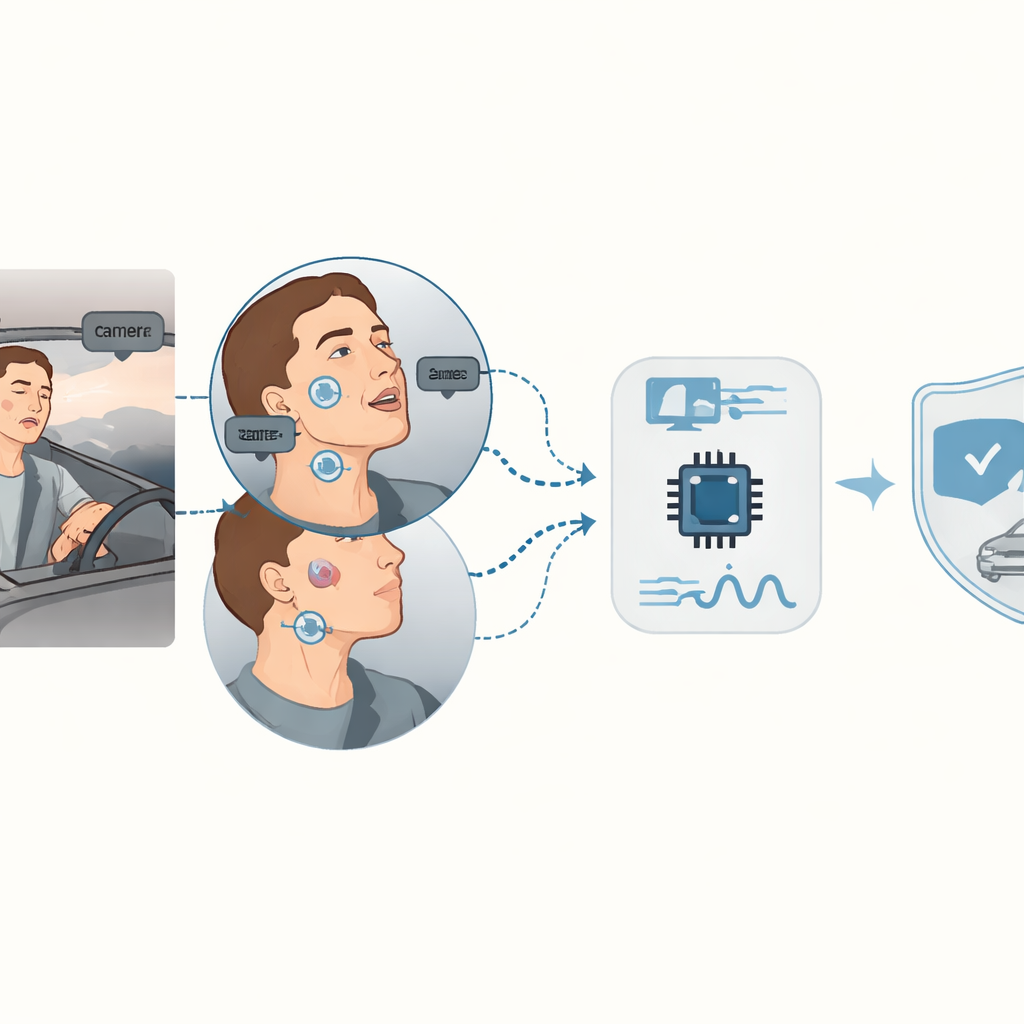

Lange Fahrten, späte Nächte und vollgepackte Zeitpläne führen dazu, dass viele Menschen hinter das Steuer treten, obwohl sie müde sind. Müdigkeit verlangsamt still und leise die Reaktionszeit und trübt die Aufmerksamkeit, was jedes Jahr einen großen Anteil schwerer Verkehrsunfälle verursacht. Diese Studie stellt ein neues fahrzeuginternes Überwachungssystem vor, das sowohl das Gesicht des Fahrers als auch feine Druckänderungen auf der Haut beobachtet, um Schläfrigkeit früher und verlässlicher zu erkennen als heutige rein kamerabasierte oder alleinige Sensorsysteme.

Zwei Sinne sind besser als einer

Die meisten gegenwärtigen Systeme versuchen, Müdigkeit aus einer einzigen Informationsquelle zu erkennen. Kamerabasierte Werkzeuge suchen nach Hinweisen wie herabhängenden Augenlidern, verlängerten Lidschlägen und Gähnen, haben aber bei Nacht, Blendung oder wenn Gesichter teilweise durch Brillen oder Masken verdeckt sind, Schwierigkeiten. Andere Ansätze stützen sich auf elektrische Körpersignale oder sperrige Wearables, die unbequem und störanfällig sein können. Das Forschungsteam ahmt stattdessen nach, wie das menschliche Gehirn Tastsinn und Sehen kombiniert: Ihr System vereint Videoaufnahmen des Fahrergesichts mit sanften "taktilen" Messungen von weichen, hautfreundlichen Patches, die in der Nähe von Augen, Mund und Nacken angebracht sind, und lässt ein KI-Modell beurteilen, ob der Fahrer wachsam ist oder in Richtung Einschlafen driftet.

Weiche Sensoren, die erfassen, was Kameras verpassen

Kern des Systems sind flexible Drucksensoren aus einem leichten, porösen Kunststoff, der mit einem leitfähigen Polymer vermischt und zu winzigen wurmförmigen Strukturen geformt ist. Dieses schwammartige Material lässt sich leicht zusammendrücken und verändert sein elektrisches Verhalten bei sehr kleinen Druck- und Biegeeinwirkungen. Wenn ein Patch leicht auf die Haut geklebt wird, reagiert einer in Augen-Nähe beim Schließen der Lider, ein anderer am Nacken registriert das Nicken des Kopfes, und ein dritter in Mundnähe spürt das weite Öffnen und Dehnen beim Gähnen. Tests zeigten, dass diese Sensoren in wenigen Tausendstelsekunden ansprechen, extrem sanfte Druckreize erfassen und auch nach zehntausenden Biege- und Druckzyklen zuverlässig arbeiten—wichtig für ein Gerät, das im Alltag in einem fahrenden Auto getragen werden könnte.

Dem System beibringen, Müdigkeit zu lesen

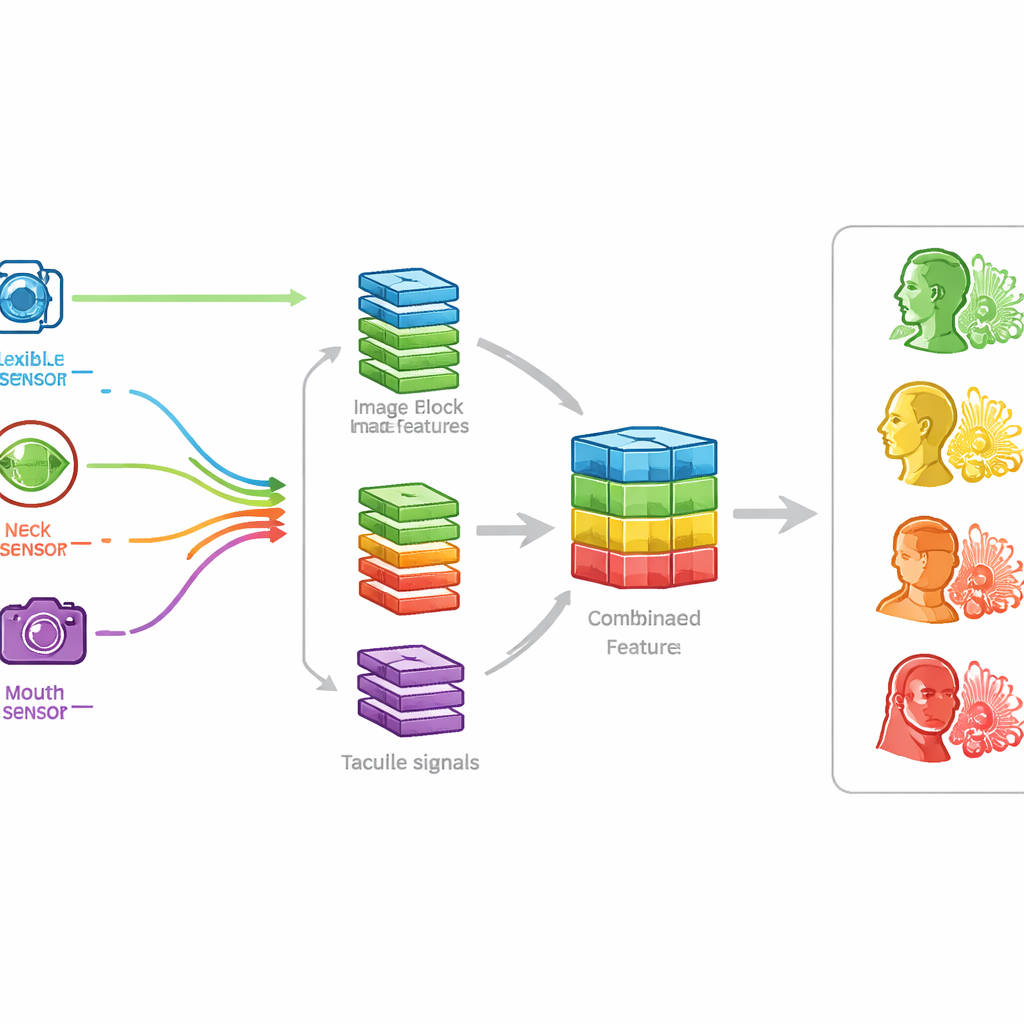

Um dem System beizubringen, wie Müdigkeit aussieht, bauten die Forschenden einen Datensatz auf, der kurze Videoclips von fünf Freiwilligen mit den passenden Signalen der drei Hautpatches koppelte. Sie zeichneten vier typische Zustände auf: normales Fahren, Augen schließen, Kopfnicken und Gähnen, sowohl bei hellem Tageslicht als auch bei gedämpfter Parkhausbeleuchtung. Ein modernes Bilderkennungsnetzwerk lernte, Schlüsselmuster aus den Gesichtsaufnahmen zu extrahieren, während ein zweites Netzwerk die Sensormesswerte in kompakte Signaturen umwandelte. Diese beiden Informationsströme wurden dann zu einer einzigen kombinierten Repräsentation verschmolzen, sodass das Modell erkennen konnte, wann Tastsinn und Sehvermögen Anzeichen von Müdigkeit bestätigten, und sich stärker auf die Sensoren stützte, wenn das Videobild dunkel oder gestört war.

Von momentanen Signalen zu umsetzbaren Warnungen

Als das System die vier Basiszustände in kontrollierten Tests mit etwa 98 Prozent Genauigkeit erkannte, ging das Team einen Schritt weiter: Sie wandten die bild‑für‑bild getroffenen Urteile in praktische Empfehlungen für Fahrer um. Sie definierten einfache Regeln basierend darauf, wie oft jemand zu lange blinzelte, nickte oder pro Minute gähnte, und wandeln diese Zählungen in eine dreistufige Müdigkeitsskala um: normal, leicht müde oder stark ermüdet. Das System läuft in Echtzeit auf einem kompakten Fahrzeugcomputer, aktualisiert kontinuierlich die Fahrerbewertung und löst bei leichter Müdigkeit einen sanften Hinweis auf eine Pause aus bzw. bei starker Ermüdung eine deutliche Sofort‑Stop-Meldung. Es zeigte hohe Leistungsfähigkeit über verschiedene Altersgruppen, Hauttöne, Gesichtsbehaarung, Masken und sogar bei schlechter Beleuchtung oder Vehikelbewegungen—ein Hinweis darauf, dass der kombinierte Kamera‑und‑Tastsinn-Ansatz in realistischen Situationen robust ist.

Was das für den Alltag am Steuer bedeutet

Für Nicht‑Spezialisten ist die Kernbotschaft klar: Indem man kombiniert, was eine Kamera sieht, mit dem, was weiche Hautsensoren fühlen, liefert diese Studie einen intelligenteren „Co‑Piloten“, der subtile Anzeichen von Schläfrigkeit bemerkt, bevor sie zu Katastrophen werden. Die Technologie umgeht viele Schwächen rein kamerabasierter Systeme bei Nacht und unbequemer medizinischer Wearables, während sie schnell und effizient genug bleibt, um im Fahrzeug zu laufen. Obwohl größere Tests im realen Straßenverkehr noch nötig sind, weist dieses multimodale Framework in Richtung künftiger Fahrzeuge, die im Hintergrund leise die Wachsamkeit des Fahrers überwachen und rechtzeitig Warnungen ausgeben, wodurch müdigkeitsbedingte Unfälle reduziert und lange Fahrten für alle Verkehrsteilnehmer sicherer werden.

Zitation: Li, K., Yue, W., Shin, DB. et al. A multimodal framework for fatigue driving detection via feature fusion of vision and tactile information. npj Flex Electron 10, 40 (2026). https://doi.org/10.1038/s41528-026-00543-7

Schlüsselwörter: Erkennung von Fahrermüdigkeit, Überwachung der Sicherheit im Fahrzeug, flexible Hautsensoren, multimodale KI, Prävention von Sekundenschlaf am Steuer