Clear Sky Science · de

Ausgerichtete Repräsentation visueller und taktiler Bewegungsrichtungen in hMT+/V5 und fronto-parietalen Regionen

Warum das im Alltag wichtig ist

Eine Mücke am Arm zu verscheuchen erscheint mühelos, doch Ihr Gehirn löst dabei unauffällig ein schwieriges Problem: Es muss sehen und fühlen zusammenführen, um zu entscheiden, in welche Richtung sich etwas über die Haut bewegt und wie reagiert werden soll. Diese Studie fragt, wo im menschlichen Gehirn Sehen und Tasten in Einklang gebracht werden und wie das Gehirn sehr unterschiedliche Signalarten — Licht auf der Netzhaut und Druck auf der Haut — in ein einheitliches, gemeinsames Bewegungsgefühl der Umgebung übersetzt.

Zwei Arten zu wissen, wo sich etwas bewegt

Sehen und Tasten sprechen zunächst verschiedene „räumliche Sprachen“. Visuelle Bewegung wird zuerst relativ zu den Augen abgebildet: welcher Teil der Netzhaut aktiviert wird. Taktilen Bewegung wird relativ zur Haut verortet: welcher Teil der Hand gestrichen wird. Unsere Handlungen richten sich jedoch danach, wo Dinge in der Außenwelt sind, nicht nur auf der Netzhaut oder der Haut. Das Gehirn muss diese körperbezogenen Karten daher in einen gemeinsamen, weltbezogenen Referenzrahmen übersetzen, sodass ein in der Nähe der Hand gesehenes, sich bewegendes Objekt und eine passende Empfindung auf der Haut als dasselbe Ereignis behandelt werden.

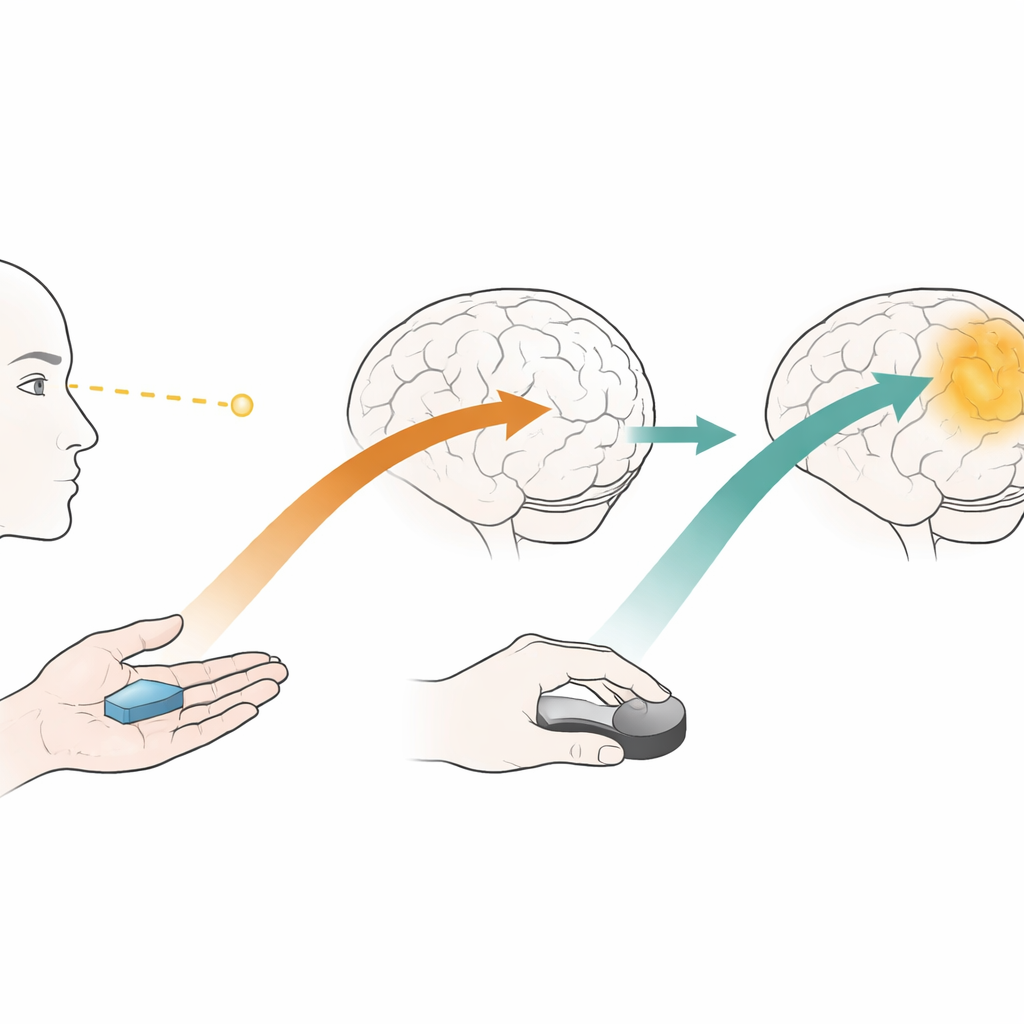

Ein cleverer Test mit bewegten Punkten und bewegten Bürsten

Die Forschenden nutzten funktionelle MRT, um die Hirnaktivität zu beobachten, während Probanden bewegte Punktmuster sahen und gleichzeitig ein Pinsel über ihre rechte Hand gestrichen wurde. Sie variierten die Handhaltung — manchmal Handfläche nach oben, manchmal gedreht — sodass dieselbe physische Bewegung auf der Haut in unterschiedlicher Richtung im äußeren Raum liegen konnte. Durch den Vergleich von Aktivitätsmustern über viele kleine Messpunkte fragten sie, ob eine Region Bewegungsrichtungen unterscheiden kann und ob ihr „Code“ für Richtung konsistent bleibt, wenn Bewegung auf der Haut definiert ist versus im Raum draußen.

Ein visueller Bewegungs-Hub, der auch Bewegung fühlt

Ein zentrales Ziel war hMT+/V5, ein Areal des visuellen Kortex, das lange für die Verarbeitung von Bewegung bekannt ist. Das Team bestätigte zunächst, dass dieser Bereich nicht nur bei bewegten visuellen Punkten reagiert, sondern auch, wenn die Hand gestrichen wurde, und dass er Bewegungsrichtungen in beiden Modalitäten unterscheiden kann. Das galt auch für Subregionen, die als MT und MST bekannt sind. Im Gegensatz dazu sprachen primäre Tastareale auf der linken Gehirnhälfte stark auf taktile Bewegung an, nicht jedoch auf visuelle Bewegung — im Einklang mit ihrer klassischen Rolle als detaillierte Karte der Körperoberfläche.

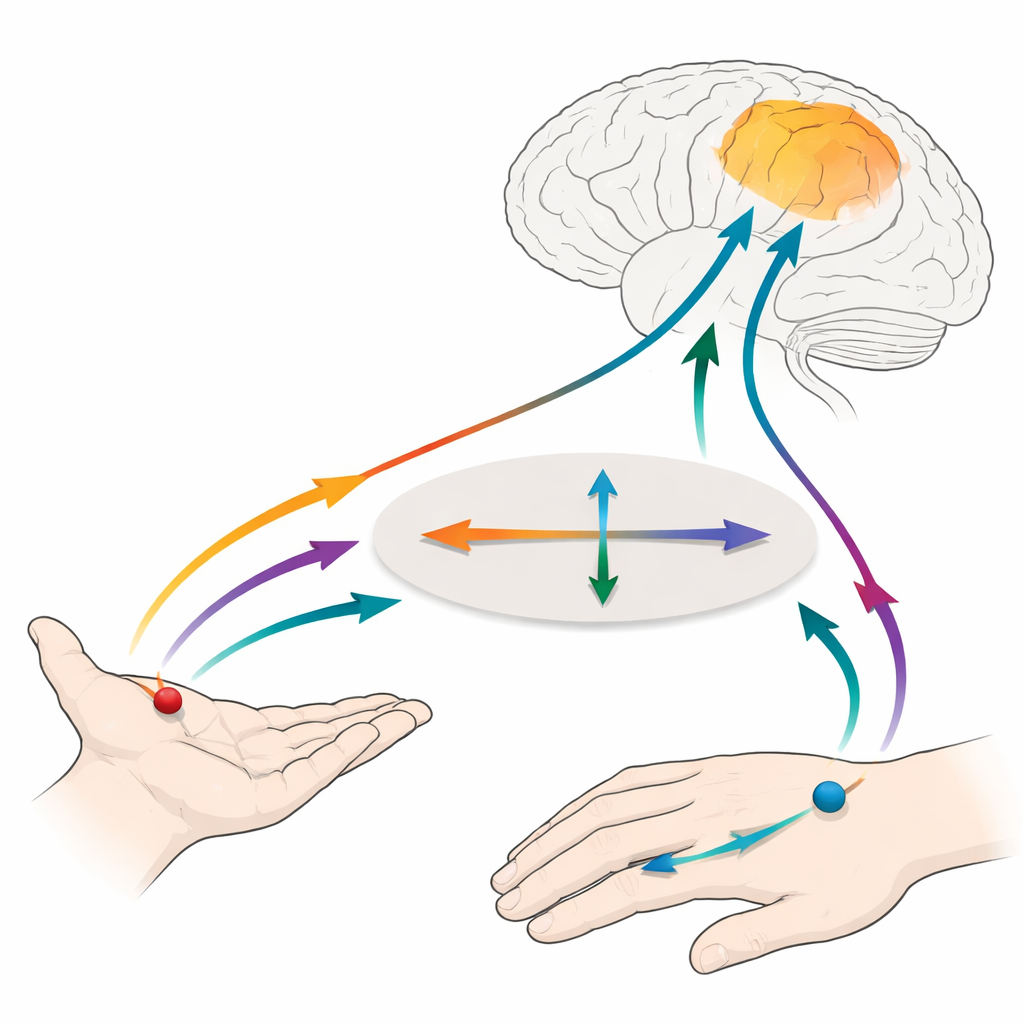

Von der hautbasierten zur weltbasierten Bewegung

Die zentrale Frage war, wie diese Areale mit unterschiedlichen „Referenzrahmen“ umgehen. Im primären Tastkortex wurden Bewegungen entlang der Achse vom Kleinfinger zum Daumen und entlang der Achse vom Finger zum Handgelenk am deutlichsten getrennt, wenn sie rein auf der Haut definiert waren, was einen dominanten körperbasierten Code zeigte. Im rechten hMT+/V5 dagegen ließen sich taktile Richtungen klarer unterscheiden, wenn sie relativ zur Außenwelt beschrieben wurden — horizontal versus vertical im Raum — unabhängig von der Handhaltung. Entscheidend war, dass nur im rechten hMT+/V5 ein Computer, der auf visuellen Bewegungsmustern trainiert wurde, taktile Bewegungsrichtungen korrekt vorhersagen konnte, und diese über Modalitäten hinweg funktionierende Dekodierung gelang nur, wenn Berührung in externen Koordinaten beschrieben wurde. Ganzhirn-Analysen zeigten, dass das Abgleichen von visueller und taktiler Bewegung auf diese Weise auch ein Netzwerk rechter parietaler und frontaler Regionen einband, die mit räumlicher Aufmerksamkeit und Bewegungsplanung verknüpft sind.

Eine gemeinsame Karte, die die Modalität dennoch bewahrt

Obwohl der rechte hMT+/V5 genügend gemeinsame Informationen trug, um Bewegungsrichtungen über Sehen und Tasten auszurichten, löschte er den Unterschied zwischen den Sinnen nicht vollständig aus: Muster für visuelle und taktile Bewegung ließen sich weiterhin unterscheiden. Die Autoren argumentieren, dass diese Region zusammen mit fronto-parietalen Partnern als multisensorischer Bewegungs-Hub fungiert. Sie wandelt haut- und augenbasierte Eingänge in eine teilweise gemeinsame, externe Karte von Bewegungsrichtungen um und bewahrt gleichzeitig, welcher Sinn die Information geliefert hat. Diese flexible Kodierung könnte dem Gehirn helfen, bewegte Ereignisse im Blick zu behalten, während sich Augen und Gliedmaßen verschieben, und ermöglicht uns so, Wahrnehmung und Handlung in einer geschäftigen, dynamischen Welt nahtlos zu koordinieren.

Zitation: Shahzad, I., Battal, C., Cerpelloni, F. et al. Aligned representation of visual and tactile motion directions in hMT+/V5 and fronto-parietal regions. Nat Commun 17, 2625 (2026). https://doi.org/10.1038/s41467-026-70537-6

Schlüsselwörter: multisensorische Bewegung, hMT+/V5, Visuell-taktile Integration, räumliche Referenzrahmen, Gehirnbildgebung