Clear Sky Science · de

Die Latenzlücke überbrücken mit einem kontinuierlichen Stream-Bewertungsrahmen in ereignisgetriebener Wahrnehmung

Warum schnellere Robotersicht wichtig ist

Stellen Sie sich ein selbstfahrendes Auto vor, das ein plötzliches Hindernis erkennt, oder einen Roboter, der versucht, einen heranrasenden Tischtennisball zurückzuschlagen. In diesen Bruchteilen einer Sekunde ist schnelles Sehen genauso wichtig wie klares Sehen. Dieser Artikel untersucht eine neue Methode, um zu beurteilen, wie schnell und zuverlässig moderne „Ereigniskameras“ tatsächlich bewegte Objekte verfolgen können, und zeigt, dass die üblichen Labortests die Leistungsfähigkeit dieser Systeme in der Praxis dramatisch überschätzen können.

Von Schnappschüssen zu Streams

Die meisten heutigen Computer-Vision-Systeme behandeln die Welt wie eine Diashow. Normale Kameras nehmen Bilder in festen Intervallen auf, und Algorithmen verarbeiten jeweils ein Einzelbild. Selbst wenn Ingenieure neuromorphe, also ereignisbasierte Kameras verwenden, die Helligkeitsänderungen mit Mikrosekundenauflösung erfassen, wandeln sie diesen reichen, kontinuierlichen Strom oft wieder in grobe Frames um. Diese frame-basierte Denkweise verschleiert ein zentrales Problem: Verzögerung. Jedes Mal, wenn das System auf das nächste Frame wartet und es dann verarbeitet, vergehen wertvolle Millisekunden. Bei Hochgeschwindigkeitsaufgaben wie autonomem Fahren oder Mensch–Roboter-Interaktion bedeutet diese Latenz, dass das System immer auf die jüngste Vergangenheit statt auf die Gegenwart reagiert.

Eine neue Art, Echtzeit-Sehen zu bewerten

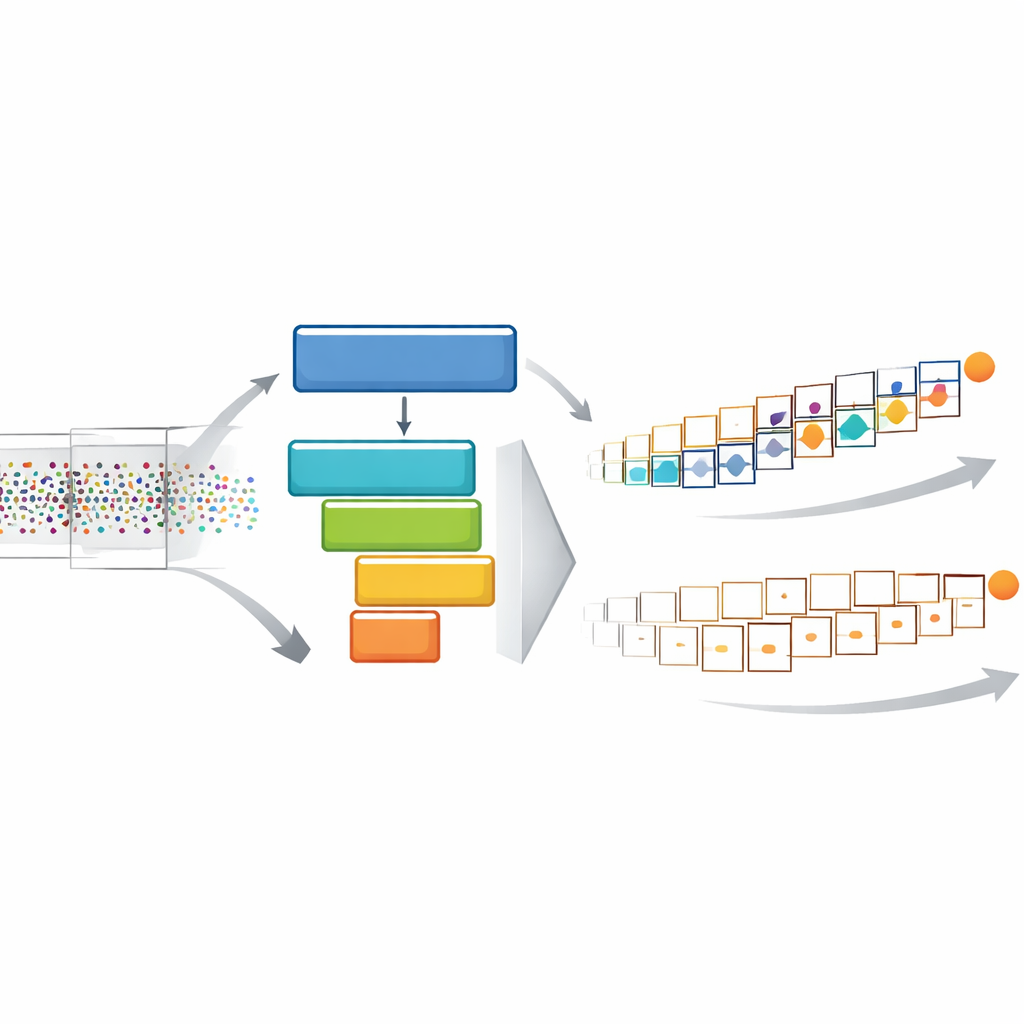

Um die Lücke zwischen Laborscores und realen Anforderungen zu schließen, führen die Autoren einen Rahmen namens STream-based lAtency-awaRe Evaluation, kurz STARE, ein. Anstatt Ereignisdaten in feste Frames zu pressen, versorgt STARE ein Modell mit den frischesten Ereignissen, sobald es seine letzte Vorhersage abgeschlossen hat. Dieses „Continuous Sampling“ hält das Modell beschäftigt und treibt seine Ausgaberate so hoch, wie es die Hardware zulässt. Gleichzeitig bewertet STARE die Genauigkeit auf neue Weise: Jede Bodenwahrheitsposition eines sich bewegenden Objekts wird mit der aktuellsten zu diesem Zeitpunkt verfügbaren Vorhersage gekoppelt. Ist das Modell langsam, wird dieselbe veraltete Vorhersage über viele Zeitpunkte hinweg wiederverwendet, und ihre scheinbare Genauigkeit sinkt. So fließt die Kosten der Verzögerung direkt in die Endbewertung ein.

Aufbau eines Hochgeschwindigkeits-Testbeds

Solch fein abgestimmte Zeitmessungen erfordern ebenso fein granulierte Daten, die in bestehenden Ereigniskamera-Datensätzen fehlen. Dort wird die Position eines Objekts meist nur einige Dutzend Mal pro Sekunde aufgezeichnet. Die Autoren haben deshalb ESOT500 erstellt, einen neuen Datensatz, in dem Objekte 500 Mal pro Sekunde annotiert werden, sowohl mit niedrig- als auch hochauflösenden Ereigniskameras und über verschiedene Szenen hinweg wie rotierende Ventilatoren, fliegende Vögel und fahrende Fahrzeuge. Bei dieser Dichte folgen die Ground-Truth-Spuren schnellen, komplexen Bewegungen eng genug, um „temporale Alias-Effekte“ zu vermeiden, bei denen langsame Abtastung einen wirbelnden, schnellen Pfad fälschlich vereinfacht erscheinen lässt. ESOT500 fungiert damit als Stresstest für jede Methode, die mit raschen, unvorhersehbaren Dynamiken umgehen will.

Was wirklich passiert, wenn Latenz zählt

Mit STARE und ESOT500 werteten die Autoren eine Reihe moderner Objekt-Tracker neu aus. Unter traditionellen frame-basierten Tests wirken schwerere, komplexere Modelle oft am besten. Unter STARE verlieren jedoch viele dieser hochgenauen, aber langsamen Systeme mehr als die Hälfte ihrer effektiven Genauigkeit, sobald die Verzögerung berücksichtigt wird. Leichtere, schnellere Modelle klettern plötzlich an die Spitze, weil sie häufiger und aktueller vorhersagen. Das Team bestätigte dies in einem Robotertischtennis-Experiment: Ein Roboter nutzte eine Ereigniskamera und einen Tracker, um eingehende Bälle zurückzuschlagen. Eine mäßig schnellere Wahrnehmung verdoppelte nahezu die Trefferquote, während ein langsameres, offline-starkes Modell schlecht abschnitt. Anders gesagt: In Echtzeit können Geschwindigkeit und Aktualität der Informationen reine Präzision überwiegen.

Intelligenterer Einsatz kontinuierlicher Streams

Über die Bewertung hinaus untersuchen die Autoren, wie man Systeme für kontinuierliches Sehen besser entwirft. Eine Strategie, „Asynchrones Tracking“, koppelt ein langsames, aber sorgfältiges Basismodell mit einem kleineren, wendigen Begleiter, der die Objektposition zwischen den vollen Durchläufen des Basismodells weiter aktualisiert. Dieses Doppel-Setup nutzt gemeinsame Merkmale wieder und exploitert den stetigen Strom von Ereignissen, steigert die Ausgaberate um nahezu 80 % und verbessert die latenzbewertete Genauigkeit um etwa 60 %. Eine zweite Strategie, „kontextbewusste Abtastung“, beobachtet, wie viele Ereignisse um das verfolgte Objekt herum auftreten. Wenn die Szene ruhig ist und wenig passiert, verwendet der Tracker vorübergehend seine letzte gute Schätzung statt neu zu berechnen und spart so unnötige Arbeit. Er reaktiviert sich wieder, wenn die Bewegung zunimmt, was besonders bei niedriger Aktivität oder spärlichen Ereignissen hilft.

Die Lücke zwischen Labor und Wirklichkeit schließen

Für Nichtfachleute ist die Kernbotschaft einfach: In schnelllebigen Situationen ist es genauso wichtig, wie schnell ein Sichtsystem sein Weltbild aktualisieren kann, wie genau jede einzelne Vorhersage ist. Indem man die Ausgabe der Kamera als echten Strom behandelt und Verzögerung direkt in die Bewertung einfließen lässt, deckt STARE Schwächen auf, die konventionelle Tests übersehen, und hebt Entwürfe hervor, die unter Druck wirklich funktionieren. Zusammen mit dem Datensatz ESOT500 und den vorgeschlagenen Tracking-Strategien weist diese Arbeit in Richtung künftiger Roboter, Fahrzeuge und interaktiver Maschinen, die nicht nur gut sehen, sondern rechtzeitig sehen.

Zitation: Chu, J., Zhang, R., Yang, C. et al. Bridging the latency gap with a continuous stream evaluation framework in event-driven perception. Nat Commun 17, 2441 (2026). https://doi.org/10.1038/s41467-026-70240-6

Schlüsselwörter: Ereigniskameras, Echtzeitverfolgung, robotische Sicht, latenzbewertete Evaluation, neuromorphe Wahrnehmung