Clear Sky Science · de

Zuverlässige Unsicherheitsabschätzungen im Deep Learning mit effizienten Metropolis-Hastings-Algorithmen

Warum intelligentere Unsicherheit wichtig ist

Von medizinischen Scans bis zu selbstfahrenden Autos trifft moderne künstliche Intelligenz oft Entscheidungen, bei denen ein selbstsicherer Irrtum gefährlich sein kann. Übliche Deep-Learning-Systeme sind hervorragend im Erkennen von Mustern, aber notorisch schlecht darin, ihre eigene Unsicherheit anzugeben. Dieses Papier geht diese Lücke an: Es stellt neue Wege vor, tiefe neuronale Netze mit verlässlichen Unsicherheitsmaßen auszustatten, ohne dabei die hohe Rechenlast traditioneller Bayesscher Methoden außer Acht zu lassen.

Von Vermutungen zu gemessener Zuversicht

Im Alltags-Deep-Learning wird ein Modell meist einmal trainiert und dann unverändert genutzt. Es liefert eine einzige beste Vermutung, gibt aber wenig Aufschluss darüber, wie vertrauenswürdig diese Vermutung ist. Bayessche neuronale Netze gehen einen anderen Weg: Anstatt einen festen Parametersatz zu verwenden, betrachten sie die Parameter als zufällig und versuchen, eine ganze Verteilung plausibler Modelle zu erfassen. Das Mittel über Vorhersagen aus dieser Sammlung kann sowohl die wahrscheinlichste Antwort als auch das Maß an Vertrauen zeigen, das das Modell haben sollte. Die Herausforderung besteht darin, dass das genaue Ziehen von Proben aus dieser Verteilung mit Goldstandard-Methoden wie Hamiltonschem Monte-Carlo bei heutigen großen Netzen und Datensätzen extrem kostenintensiv ist.

Schnelleres Sampling ohne das große Ganze zu verlieren

Die Autorinnen und Autoren konzentrieren sich auf eine Methodenfamilie namens stochastisches Gradienten-Hamiltonsches Monte-Carlo, die bereits Ideen aus dem Standardtraining — Mini-Batches und verrauschte Gradienten — wiederverwendet, um das Sampling zu beschleunigen. Die fehlende Zutat ist ein verlässlicher „Filter“, der entscheidet, welche vorläufigen Parameterupdates beibehalten werden sollen. Im klassischen Hamiltonschen Monte-Carlo übernimmt diese Rolle ein Metropolis-Hastings-Akzeptanzschritt, der numerische Fehler korrigiert und verhindert, dass der Sampler in falsche Bereiche driftet. Diese Akzeptanzstufe in die verrauschte Mini-Batch-Welt des Deep Learning zu übertragen, ist schwierig, weil sie üblicherweise vollständige Datensatz-Auswertungen verlangt und den Fortschritt ausbremsen kann, wenn die Akzeptanzraten zu niedrig sind.

Zwei neue Wege, die Landschaft zu durchwandern

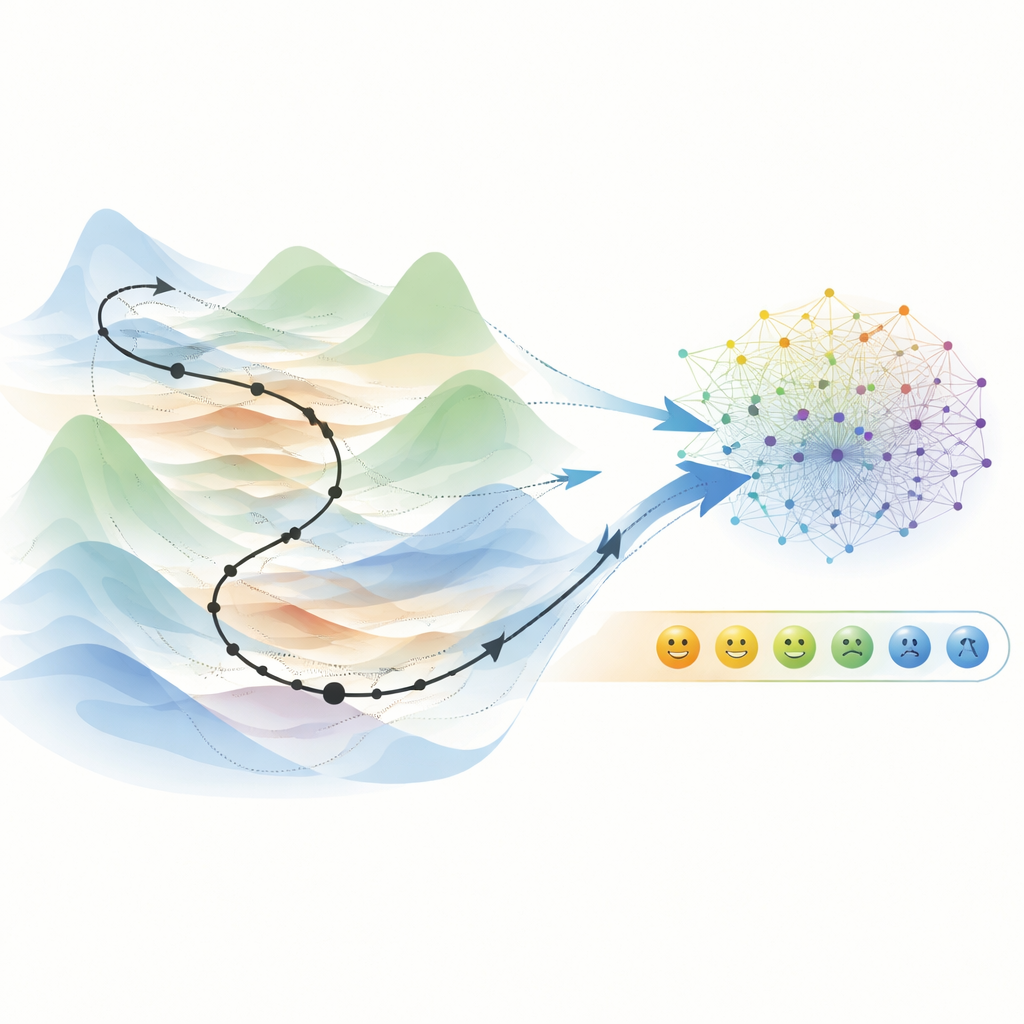

Das Papier stellt zwei komplementäre Strategien vor. Die erste, genannt generalisiertes stochastisches Gradienten-Hamiltonsches Monte-Carlo (GSGHMC), entwirft einen Akzeptanztest, der auf Mini-Batches läuft und gleichzeitig die wichtige Eigenschaft bewahrt, dass echte Optima des vollständigen Problems korrekt erkannt werden. Er nutzt einen sorgfältig gewählten numerischen Integrator, sodass die schrittweise Akzeptanz stabil bleibt, obwohl jeweils nur ein Datenabschnitt betrachtet wird. Das ergibt einen effizienten Sampler, der nahe am wahren bayesschen Bild bleibt und Ensembles von Modellen liefert, deren Vertrauenswerte besonders gut kalibriert sind.

Lange Trajektorien für bessere Vorhersagen

Die zweite Methode, das Hamiltonian Trajectory Ensemble (HTE), trifft einen gezielten Kompromiss: Anstatt auf exaktes bayessches Verhalten zu pochen, setzt es auf lange, impulsgetriebene Wanderungen durch den Parameterraum, die aggressiven Trainingsläufen ähneln. Am Ende jeder solchen Trajektorie entscheidet ein Metropolis-ähnlicher Test, ob der resultierende Modell-Snapshot behalten wird. Da diese Pfade dazu neigen, sich in breiten, generalisierbaren Tälern der Verlustlandschaft niederzulassen, bildet die gesammelte Menge an Modellen ein diverses, aber fokussiertes Ensemble. Bei Bildklassifikations-Benchmarks wie EMNIST und CIFAR-10 verbessert HTE die Genauigkeit um bis zu etwa sechs Prozentpunkte gegenüber starken bayesschen Baselines und um mehrere Punkte gegenüber gewöhnlichem deterministischem Training, während es dennoch nützliche Unsicherheitsinformationen und eine starke Erkennung von Out-of-Distribution-Eingaben liefert.

Kleinere Ensembles, intelligentere Nutzung

Hunderte oder Tausende Modelle zu sampeln klingt im Testeinsatz teuer, daher untersuchen die Autoren auch, wie viele Ensemble-Mitglieder wirklich nötig sind. Durch gieriges Verwerfen von Modellen, die wenig Einfluss auf die Leistung haben, finden sie, dass sich häufig etwa ein Drittel des Ensembles behalten lässt, ohne die Genauigkeit zu beeinträchtigen, wobei sehr scharfe Kalibrierung in der Regel mehr Mitglieder erfordert. Über Bildaufgaben und ein chaotisches Zeitreihen-Prognoseproblem hinweg übertreffen oder erreichen ihre Methoden konstant beliebte Alternativen wie Variationsinferenz, Monte-Carlo-Dropout und einfachere Deep-Ensembles, wenn auch bei höheren Trainingskosten als beim einfachen deterministischen Lernen.

Was das für reale KI bedeutet

Für Nicht-Spezialistinnen und Nicht-Spezialisten lautet die Kernbotschaft: Wir können Deep Learning nicht nur genauer, sondern auch ehrlicher in Bezug auf sein Nichtwissen machen, ohne Supercomputer-Ressourcen zu benötigen. Indem klassische Sampling-Ideen sorgfältig in modernes, auf Mini-Batches basierendes Training eingeflochten werden, liefern die beiden vorgeschlagenen Ansätze bessere Vorhersagen und vertrauenswürdigere Konfidenzabschätzungen als viele bestehende Techniken. Diese Kombination aus Effizienz, Robustheit und kalibrierter Unsicherheit ist ein wichtiger Schritt hin zu einem sicheren Einsatz von Deep Learning in sensiblen Bereichen, in denen die Kosten von Selbstüberschätzung nicht in Prozentpunkten, sondern in Menschenleben gemessen werden können.

Zitation: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Schlüsselwörter: Bayessche neuronale Netze, Unsicherheitsabschätzung, Hamiltonsche Monte-Carlo, Ensembles im Deep Learning, stochastische Gradient-MCMC