Clear Sky Science · de

Ein äquivarianter vortrainierter Transformer für einheitliches 3D-molekulares Repräsentationslernen

Computern beibringen, Moleküle in 3D zu sehen

Die Entwicklung neuer Arzneimittel und Materialien beruht darauf, zu verstehen, wie Moleküle tatsächlich in drei Dimensionen aussehen und sich bewegen – nicht nur als flache Formeln auf dem Papier. Dieser Artikel stellt ein leistungsfähiges neues KI-Modell vor, das aus den 3D‑Formen vieler unterschiedlicher Moleküle gleichzeitig lernen kann – von kleinen, wirkstoffähnlichen Verbindungen bis zu großen Proteinen und deren Komplexen – und dieses Wissen dann nutzt, um vorherzusagen, wie stark sie miteinander wechselwirken und welche davon potenzielle Arzneimittelkandidaten sein könnten.

Eine einzige Karte für viele molekulare Welten

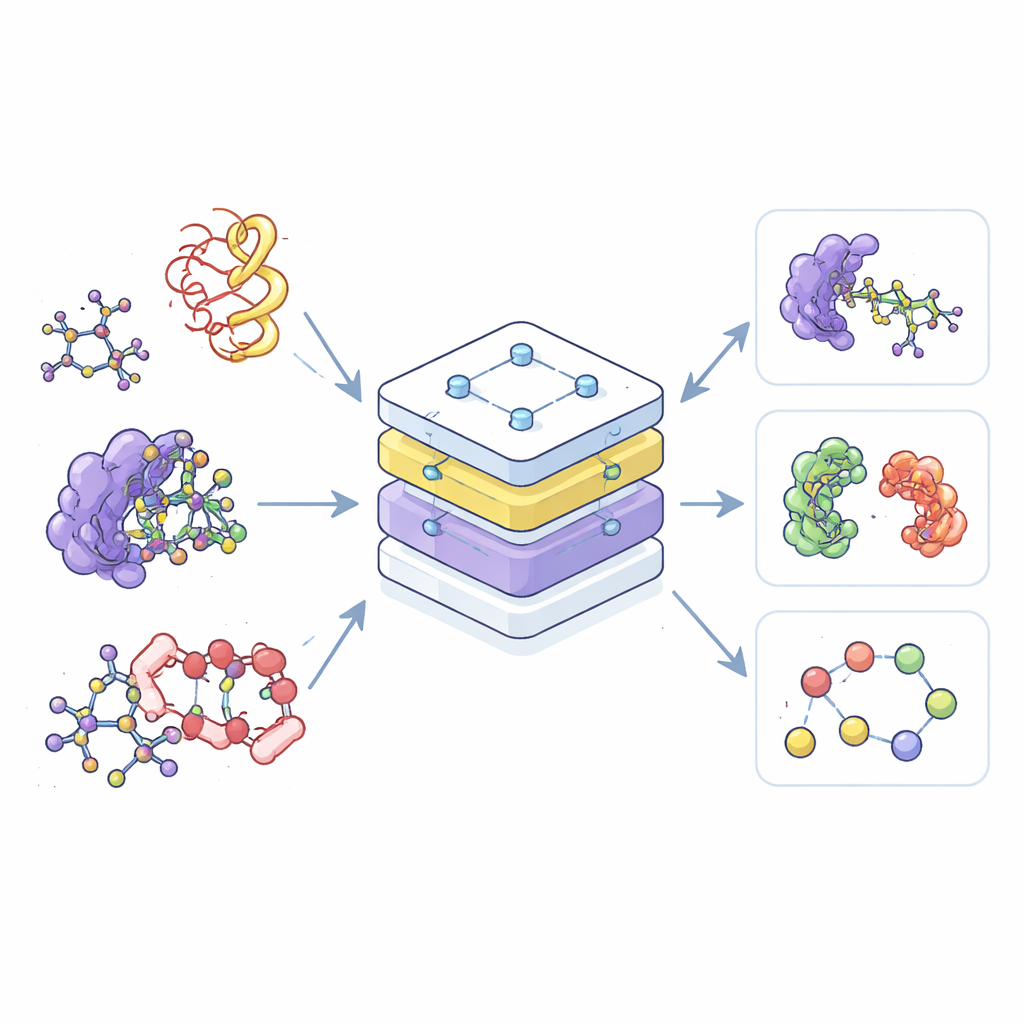

Die meisten heutigen KI-Werkzeuge für die Chemie sind Spezialisten: Eines wird nur auf kleine Moleküle trainiert, ein anderes nur auf Proteine und ein drittes nur auf deren Komplexe. Diese Trennung verschwendet Daten und erschwert es, Erkenntnisse aus einem Bereich in einen anderen zu übertragen. Die Autoren entwickeln stattdessen ein einzelnes „Foundational“-Modell, den Equivariant Pretrained Transformer (EPT), der aus einer umfangreichen Sammlung 3D‑molekularer Strukturen lernt, die aus mehreren öffentlichen Datenbanken stammen. Indem alle diese Strukturen in einem gemeinsamen Rahmen betrachtet werden, kann das Modell wiederkehrende Muster erkennen, wie sich Atome anordnen und interagieren – egal, ob sie zu einem einfachen Wirkstoffmolekül oder zu einem komplexen Geflecht von Proteinketten gehören.

Moleküle in handhabbare Teile zerlegen

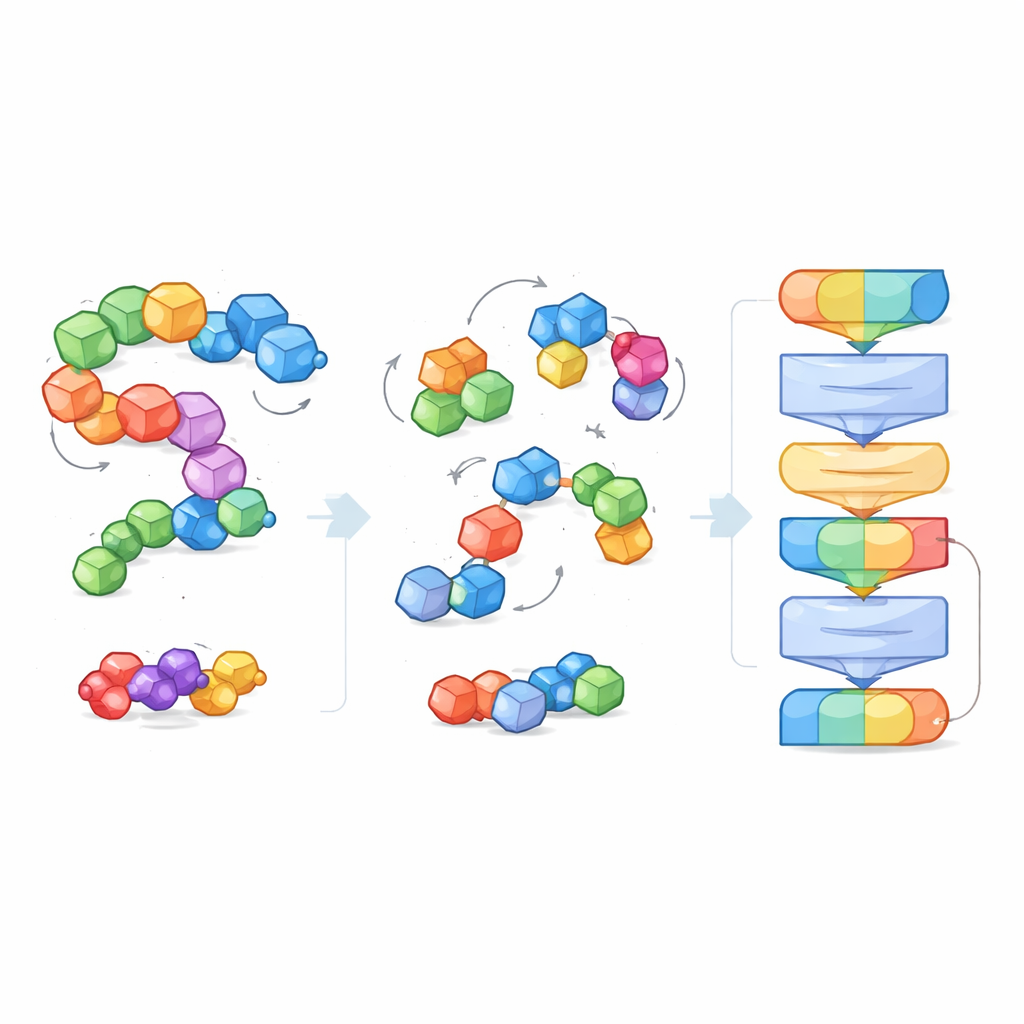

Um mit der großen Vielfalt und Größe molekularer Systeme fertigzuwerden, führen die Forschenden die Idee der „Blöcke“ ein – kleine, sinnvolle Atomgruppen. Bei kleinen Molekülen fasst ein Block ein Schweratom mit seinen gebundenen Wasserstoffen zusammen; bei Proteinen wird jede Aminosäure zu einem Block. Während des Trainings sieht das Modell sowohl die feingliedrigen Atome als auch die gröbere Blockstruktur, wodurch es lokale chemische Details mit größeren 3D‑Formen wie Proteingerüsten oder Bindungstaschen verknüpfen kann. Diese Blocksicht schafft außerdem eine gemeinsame Sprache, die über sehr unterschiedliche Molekültypen hinweg funktioniert und es einem einzigen Modell ermöglicht, sie alle zu verstehen.

Durch Reinigen verrauschter Strukturen lernen

Anstatt dem Modell explizite Labels wie „dieses Molekül ist löslich“ oder „dieses bindet stark“ zu geben, wird EPT selbstüberwacht trainiert. Die Autoren stören absichtlich jeden molekularen Block, verschieben und drehen ihn zufällig von seiner echten Position weg, und fordern das Modell dann auf, die Kräfte und Drehungen zu rekonstruieren, die nötig sind, um die ursprüngliche Struktur wiederherzustellen. Da das Training grundlegende geometrische Regeln respektiert – das Molekül sollte gleich aussehen, wenn das gesamte System im Raum rotiert oder verschoben wird – erlernt das Modell ein physikalisch stimmiges Verständnis von 3D‑Form. Dieses Denosing-Spiel lehrt EPT, wie Atome innerhalb und zwischen Blöcken zusammenhalten und wie subtile Änderungen in der Geometrie die Stabilität beeinflussen.

Das Modell auf die Probe stellen

Nach dem Vortraining auf mehr als fünf Millionen Strukturen wird EPT für mehrere reale wissenschaftliche Aufgaben feinabgestimmt. Es sagt voraus, wie stark ein kleines Molekül an eine Protein‑Tasche bindet, wie sich eine einzelne Mutation an einer Protein‑Schnittstelle auf die Bindung auswirkt, und wichtige physikalische Eigenschaften kleiner Moleküle, die Chemiker interessieren. Über verschiedene Benchmarks hinweg erreicht das einheitliche Modell die Leistung der besten bestehenden Werkzeuge oder übertrifft sie, auch solcher, die speziell für nur einen Bereich optimiert wurden. Bemerkenswert ist, dass Training auf einem Datentyp, etwa kleinen Molekülen, weiterhin bei scheinbar unterschiedlichen Aufgaben wie der Proteinbindung hilft – ein Hinweis darauf, dass das Modell breit nützliche chemische Prinzipien und keine engen Tricks erfasst hat.

Suche nach neuen COVID‑19‑Behandlungen

Die Autoren zeigen den praktischen Wert von EPT zusätzlich anhand einer Wirkstoff‑Repositionierungsaufgabe. Sie stimmen das Modell zunächst auf Protein–Ligand‑Komplexe fein ab und verwenden es dann, um fast 2.000 bereits zugelassene Medikamente nach ihrer vorhergesagten Fähigkeit zu bewerten, an das Hauptprotease‑Enzym von SARS‑CoV‑2 zu binden – ein zentrales Enzym, das das Virus zur Replikation benötigt. Bekannte Anti‑COVID‑19‑Medikamente rücken in der Rangliste nach oben, und das Modell hebt weitere vielversprechende Kandidaten hervor. Zwölf Spitzenkandidaten werden anschließend mit Computersimulationen näher untersucht, und zwei – darunter ein Wirkstoff, der ursprünglich nicht für COVID‑19 entwickelt wurde – zeigen besonders starke vorhergesagte Bindung und werden experimentell bestätigt, das virale Proteaseenzym auf Mikromol‑Niveaus zu hemmen.

Ein Schritt zu allgemeiner molekularer KI

Kurz gesagt zeigt diese Arbeit, dass ein einziges, geometriebewusstes KI‑Modell ein gemeinsames 3D‑Verständnis vieler molekularer Systeme erlernen und dieses dann zur Beantwortung einer breiten Palette wissenschaftlicher Fragen einsetzen kann. Indem Moleküle in Blöcke organisiert und das Modell darauf trainiert wird, verzerrte Strukturen „zu reparieren“, schaffen die Autoren ein Werkzeug, das nicht nur Zahlen genauer vorhersagt, sondern auch Aufgaben wie die Suche nach neuen antiviralen Wirkstoffen beschleunigen kann. EPT deutet auf eine Zukunft hin, in der generalistische molekulare KI‑Systeme Chemiker und Biologen effizienter durch den chemischen Raum führen – Experimente leiten und den Weg von atomarer Struktur zu praktischen Therapien und Materialien verkürzen.

Zitation: Jiao, R., Kong, X., Zhang, L. et al. An equivariant pretrained transformer for unified 3D molecular representation learning. Nat Commun 17, 2606 (2026). https://doi.org/10.1038/s41467-026-69185-7

Schlüsselwörter: 3D-molekulare Repräsentation, äquivarianter Transformer, Wirkstoffforschung, Protein–Ligand-Bindung, selbstüberwachtes Lernen