Clear Sky Science · de

Geschlossene Form, feedback-freies Lernen mit Vorwärtsprojektion

Maschinen lehren ohne rückwärts gerichtete Botschaften

Moderne künstliche Intelligenz lernt größtenteils mit einer Methode namens Backpropagation, bei der Fehler rückwärts durch ein Netzwerk gesendet werden, um dessen interne Verbindungen anzupassen. Dieser Prozess ähnelt jedoch nicht der Funktionsweise echter Gehirne und kann langsam sowie ressourcenintensiv sein. Diese Arbeit stellt eine neue Lernmethode für neuronale Netze vor, die Vorwärtsprojektion genannt wird und den Rückwärtsschritt vollständig überspringt, dabei aber dennoch starke Leistungen erzielt — insbesondere bei anspruchsvollen biomedizinischen Aufgaben mit begrenzten Daten.

Eine neue Art, Lernen zu steuern

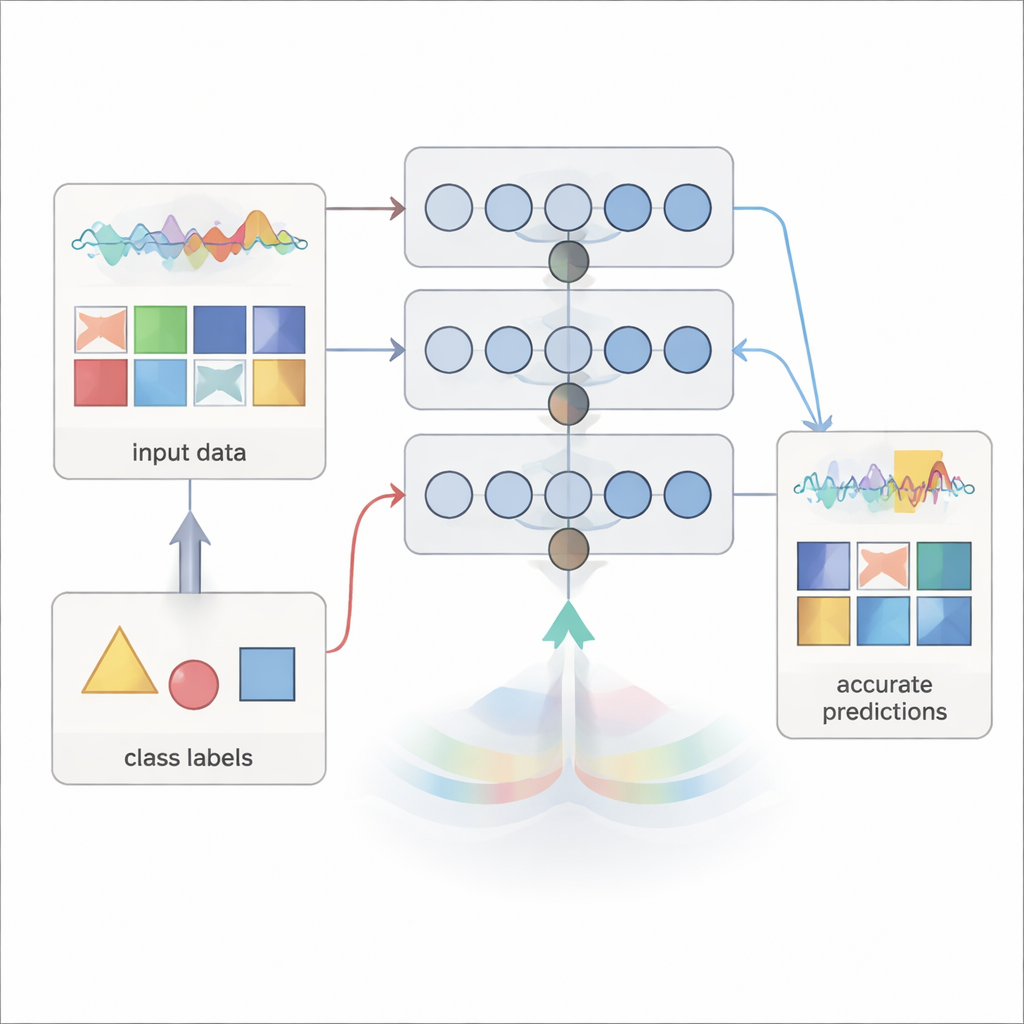

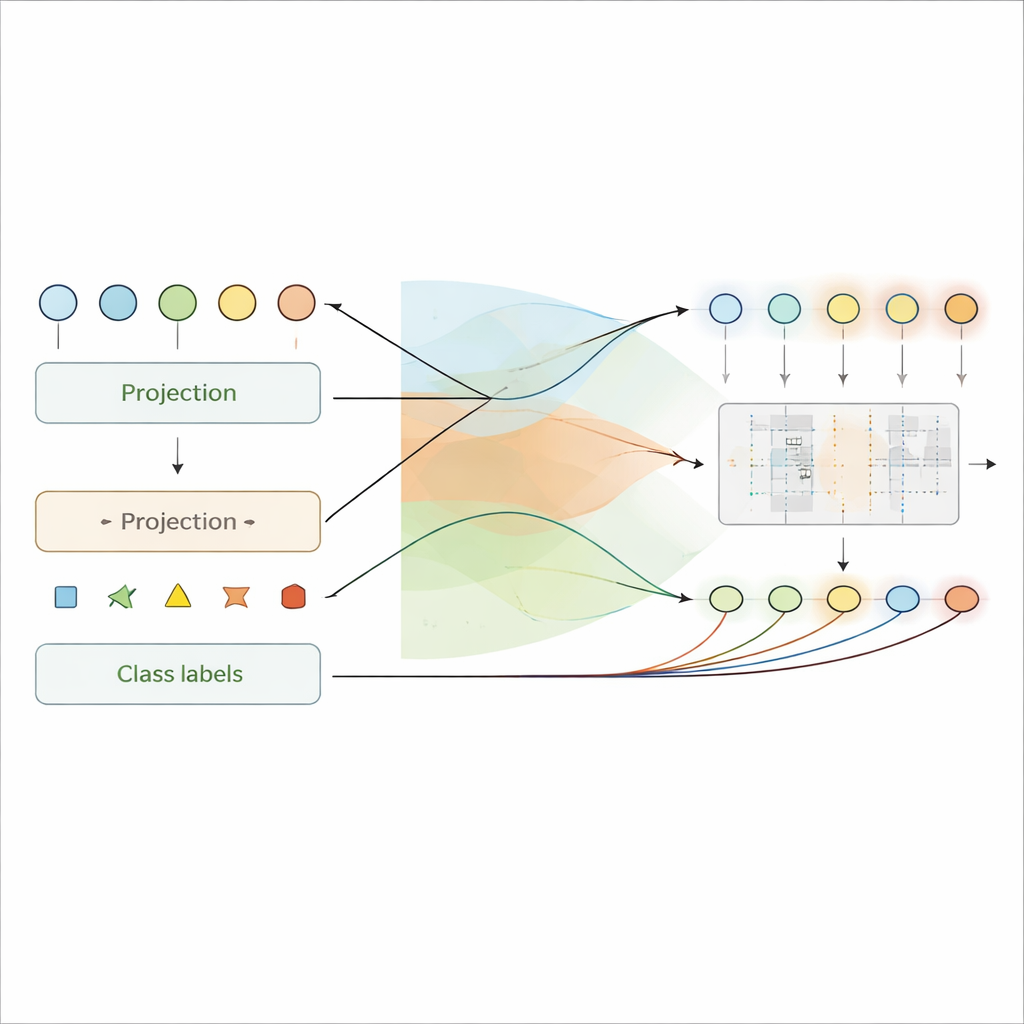

Traditionelle neuronale Netze lernen, indem sie ihre Vorhersagen mit den korrekten Antworten vergleichen und Fehlersignale rückwärts durch jede Schicht schicken, um die Verbindungen feinzujustieren. Vorwärtsprojektion geht einen anderen Weg. Anstatt auf diese rückwärtigen Fehlersignale zu bauen, verwendet sie nur Informationen, die beim Vorwärtsdurchlauf verfügbar sind: die Aktivität der aktuellen Schicht und das Ziellabel. In jeder Schicht kombiniert die Methode den Input dieser Schicht und das gewünschte Output-Label mithilfe fester zufälliger Projektionen, die durch eine einfache Nichtlinearität laufen. Das erzeugt ein „Target“-internsignal für diese Schicht — ein elektrischen Potential ähnliches Muster, das die Schicht anzustreben hat.

Sobald diese Targets erzeugt sind, werden die Verbindungsgewichte jeder Schicht in einem Schritt mittels geschlossener Regressionsformeln gelöst, einer standardmäßigen statistischen Formel statt iterativem Gradientenabstieg. Das bedeutet, dass das Netzwerk in einem einzigen Durchgang über den Datensatz trainiert werden kann, ohne Beispiele wiederholt zu durchlaufen oder große Mengen von Zwischenaktivierungen zu speichern. Da keine Information rückwärts fließen muss, entspricht die Methode der einbahnigen Kommunikation, die bei biologischen Neuronen beobachtet wird, und könnte sich leichter auf spezialisierten Hardwarearchitekturen mit einseitigen Verbindungen realisieren lassen.

Bedeutung in verborgener Aktivität sichtbar machen

Ein auffälliger Vorteil der Vorwärtsprojektion ist, dass die internen Signale in den versteckten Schichten direkt interpretierbar werden. Da jede Schicht explizit darauf trainiert wird, sowohl den Input als auch das Label in ihren membranähnlichen Potenzialen zu kodieren, können diese internen Werte als lokale Klassen-Vorhersagen gelesen werden. Die Autoren zeigen, wie sich diese Signale annähernd wieder in Labelraum „dekodieren“ lassen, womit Aktivitätsmuster in pro-Schicht-Erklärungen darüber verwandelt werden, was das Netzwerk in jedem Stadium glaubt. In Experimenten werden diese Erklärungen in tieferen Schichten genauer, was progressives Lernen widerspiegelt — frühe Schichten erfassen breite Muster, spätere konzentrieren sich auf entscheidungsrelevante Details.

Diese Interpretierbarkeit ist besonders wertvoll in der Medizin, wo das Verständnis, warum ein Modell eine Entscheidung traf, genauso wichtig sein kann wie die Entscheidung selbst. Anhand von Elektrokardiogrammdaten zeigen die Autoren, dass Vorwärtsprojektion klinisch bekannte Hinweise auf Herzinfarkt — etwa Veränderungen in bestimmten Wellenformsegmenten — zum richtigen Zeitpunkt hervorhebt. Bei Netzhautaufnahmen zur Erkennung abnormalen Gefäßwachstums konzentriert sich die Methode naturgemäß auf Flüssigkeitsansammlungen, helle Ablagerungen und narbenähnliche Bereiche, auf die Fachleute achten, selbst wenn mit nur 100 Beispielen pro Klasse trainiert wurde.

Schnelles Training, starke Ergebnisse

Das Team verglich Vorwärtsprojektion mit mehreren Alternativen, die ebenfalls versuchen, vollständige Backpropagation zu vermeiden, sowie mit der Standard-Backpropagation selbst. Bei Bild- und Sequenzaufgaben wie Fashion-MNIST, der Erkennung von DNA-Promotoren, Herzinfarkterkennung aus Elektrokardiogrammen und Objekterkennung erreichte die neue Methode die Leistung anderer lokaler Lernregeln und übertraf sie teilweise. In Standardsettings hatte Backpropagation insgesamt noch einen Vorteil, doch die Genauigkeit der Vorwärtsprojektion kam überraschend nahe, obwohl nur ein einziger Trainingsdurchlauf verwendet wurde.

Die Vorteile zeigten sich deutlicher in Few-Shot-Szenarien, in denen nur wenige gelabelte Beispiele vorliegen, wie es in der klinischen Praxis häufig der Fall ist. Hier generalisierte Vorwärtsprojektion oft besser als sowohl Backpropagation als auch konkurrierende lokale Methoden bei Thoraxröntgenaufnahmen, Netzhautscans und kleinen Bilduntergruppen. Backpropagation neigte dazu, die sehr kleinen Datensätze zu überfitten oder nicht hinreichend reichhaltige Merkmale zu lernen, während Vorwärtsprojektion stabilere, wiederverwendbare interne Repräsentationen lieferte. Aus rechentechnischer Sicht erforderte das Training einer großen Schicht um Größenordnungen weniger Multiply-and-Accumulate-Operationen als das Ausführen vieler Epoche der Backpropagation, was in erheblichen Beschleunigungen und geringerem Energieaufwand resultierte.

Was das für zukünftige KI und gehirninspirierte Rechner bedeutet

Einfach ausgedrückt zeigt diese Arbeit, dass neuronale Netze nicht auf schwere, biologisch unplausible Feedback-Schleifen angewiesen sein müssen, um nützliche und verständliche interne Repräsentationen zu lernen. Indem Eingaben und Labels in einem einzigen Vorwärtsdurchlauf geschickt vermischt und die Gewichte in geschlossener Form gelöst werden, bietet Vorwärtsprojektion eine Möglichkeit, Modelle schnell zu trainieren, ihre inneren Abläufe zu interpretieren und mit kleinen, verrauschten biomedizinischen Datensätzen umzugehen. Während Backpropagation für viele großangelegte Aufgaben weiterhin der Goldstandard bleibt, weist dieser feedback-freie Ansatz in Richtung gehirnähnlicherer und hardwarefreundlicher Lernstrategien, die die nächste Generation effizienter, erklärbarer KI-Systeme unterstützen könnten.

Zitation: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Schlüsselwörter: feedback-freies Lernen, neuronale Netze, Few-Shot-Training, biomedizinische KI, erklärbares Deep Learning