Clear Sky Science · de

Eulen-vision-inspirierte Near-Sensor-Computing

Im Dunkeln sehen wie eine Eule

Stellen Sie sich eine Drohne vor, die einen verlorenen Wanderer oder ein entferntes Raumfahrzeug ohne Suchscheinwerfer entdeckt — selbst bei so schwachem Sternenlicht, dass gewöhnliche Kameras fast nichts erkennen. Dieses Papier beschreibt neue Vision‑Hardware, die von Eulen inspiriert ist und dieser Idee näherkommt. Indem sie nachahmt, wie sich das Auge der Eule an Dunkelheit anpasst und wie ihr Gehirn schwache Signale effizient verarbeitet, bauen die Forschenden eine winzige elektronische „Synapse“, die sowohl schwaches Licht detektiert als auch einen Teil der für die Erkennung notwendigen Rechnung direkt am Sensor ausführt.

Warum bestehende Maschinen bei Nacht scheitern

Moderne Künstliche Intelligenz kann Gesichter, Objekte und Szenen mit beeindruckender Genauigkeit erkennen, doch dafür sind meist leistungsstarke Chips nötig, die enorme Energiemengen verbrauchen. Konventionelle Kameras trennen zudem Sensorik und Rechenleistung: Zuerst nimmt die Kamera ein Bild auf, dann verarbeiten entfernte Prozessoren die Daten. Bei sehr schwachem Licht versagen diese Kameras in der Regel, sofern sie nicht durch starke Lampen oder aufwändige digitale Verstärkung unterstützt werden. Dagegen arbeiten Auge und Gehirn einer Eule zusammen: Ihre Netzhaut sammelt winzige Photonentröpfchen über die Zeit, und ihre neuronalen Schaltkreise passen sich so an, dass schwache Formen allmählich sichtbar werden. Die Autor:innen wollen eine ähnliche, eng integrierte und energieeffiziente Strategie in die maschinelle Vision übertragen.

Ein winziges Bauteil, das aus Licht lernt

Im Zentrum der Arbeit steht eine „euleninspirierte dualmodus‑adaptive Synapse“ — ein kleines, transistorbasiertes Bauteil, das sowohl als Lichtsensor als auch als lernende Verbindung zwischen Nervenzellen fungiert. Das Gerät ist schichtweise aufgebaut: eine transparente untere Elektrode, eine dielektrische Schicht, die Ladungen trappt, eine speziell gestaltete lichtabsorbierende Mischung und oben ein organischer Halbleiterkanal. Trifft schwaches Licht auf die Absorberschicht, werden wenige Ladungsträger erzeugt und — gesteuert von einer angelegten Spannung — in der Dielektrik festgehalten und im Kanal angesammelt. Das verstärkt nach und nach die elektrische Reaktion des Bauteils, ähnlich wie Stäbchenzellen in der Netzhaut einer Eule ihre Empfindlichkeit bei Dunkeladaption erhöhen. Die Autor:innen zeigen, dass ihr Bauteil auf Lichtintensitäten bis zu 0,146 Nanowatt pro Quadratzentimeter reagieren kann — etwa drei Größenordnungen schwächer als das, was Standard‑Kamerachips bewältigen — und gleichzeitig eine starke, einstellbare Verstärkung aufweist, die seine Dunkeladaptation quantifiziert.

Als künstliche Synapse wirken

Über das bloße Erfassen von Licht hinaus imitiert das Bauteil auch, wie biologische Synapsen sich durch Aktivität verstärken oder abschwächen. Unter wiederholten Lichtpulsen über ein weites Farbspektrum von Ultraviolett bis Nahinfrarot steigt der Strom des Bauteils in dauerhaften Schritten und speichert so eine Erinnerung an die optische Historie. Unter elektrischen Pulsen am Gate zeigt es langanhaltende Potenzierung und Depression — graduelle, reversible Leitfähigkeitsänderungen, die synaptische „Gewichte“ in künstlichen neuronalen Netzen kodieren. Diese Gewichte werden nicht‑flüchtig gespeichert, das heißt, das Bauteil behält sie ohne dauerhafte Stromzufuhr und kann sie über mehrere Stufen wie einen mehrbitigen digitalen Wert anpassen. Entscheidend ist, dass jedes synaptische Ereignis auf der Größenordnung von 10 Femttojoule verbraucht — vergleichbar mit oder sogar geringer als Schätzungen für biologische Synapsen und um Größenordnungen unter den Energiebudgets typischer KI‑Hardware.

Von einer einzelnen Synapse zum Visionssystem

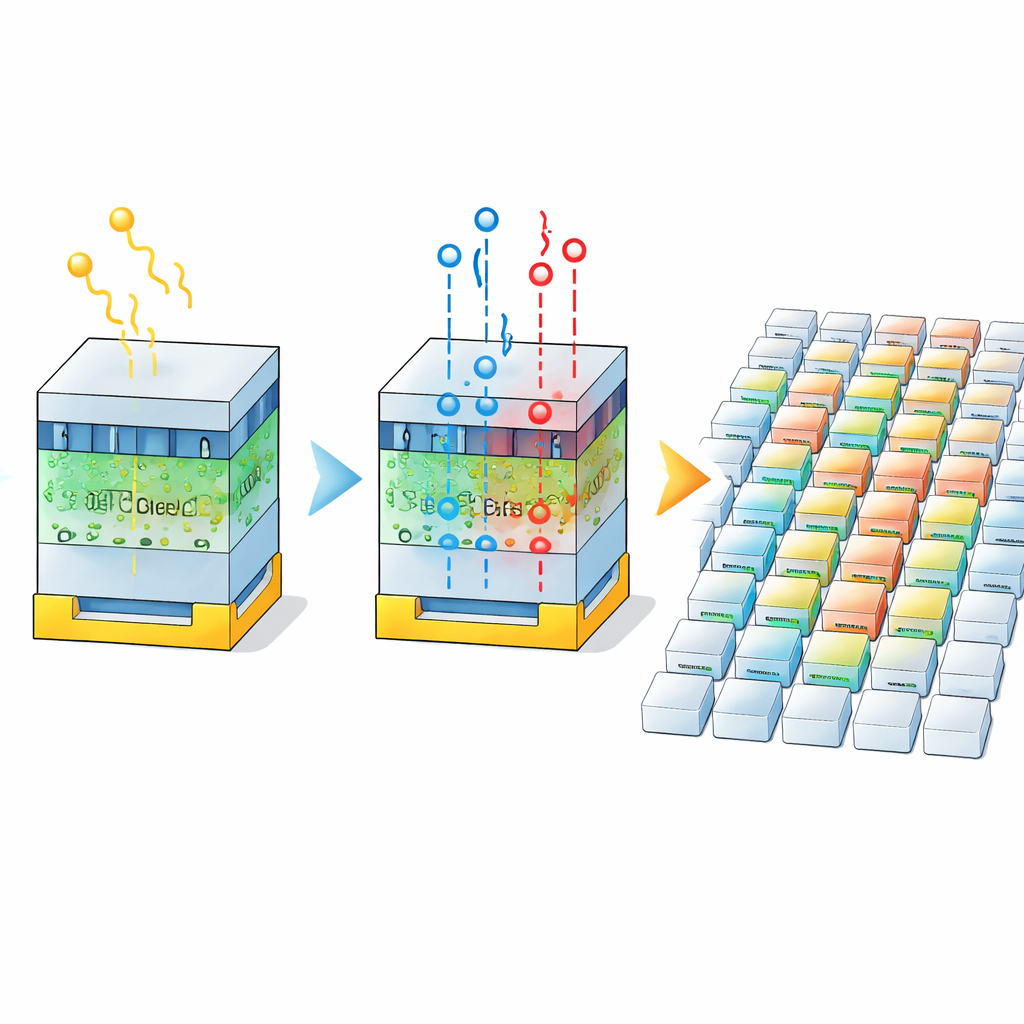

Um zu bestätigen, dass dieses Verhalten skaliert, fertigt das Team ein Array aus 19 mal 17 Bauteilen und zeigt, dass sie gleichmäßig funktionieren. Wenn ein schwaches Lichtmuster auf das Array projiziert wird, wachsen die Photoströme an beleuchteten Stellen während der Adaptation allmählich und offenbaren zuvor verborgene Formen bei ultraniedriger Beleuchtung — ähnlich wie die Netzhaut einer Eule ein Bild im Dunkeln schärft. Die Autor:innen übertragen dann die mehrfachen Leitfähigkeitsstufen der Bauteile auf Gewichte in maschinellen Lernmodellen, darunter einfache mehrlagige Perzeptrons, Faltungsnetzwerke und eine tiefe VGG‑artige Architektur. Selbst mit relativ groben, diskreten Gewichten erreichen diese simulierten Netze immer noch über 90 Prozent Genauigkeit auf standardisierten Bilddatensätzen, was zeigt, dass die synaptischen Zustände für praktische Berechnungen ausreichend sind.

Nachtsicht für Drohnen und mehr

Um das Potenzial in der Praxis zu veranschaulichen, simulieren die Forschenden ein Luft‑zu‑Boden‑Erkennungssystem auf einer kleinen Drohne, das darauf trainiert ist, ein kleidungsförmiges Ziel bei verschiedenen Helligkeitsstufen zu erkennen, die Sternenlichtbedingungen entsprechen. Indem sie die zeitabhängige Antwort des Bauteils mit dem Kontrast der erfassten Bilder verknüpfen, bauen sie eine Vorverarbeitungsstufe, die das Bild „adaptieren“ lässt, nützlichen Kontrast verstärkt und dabei realistische Sensorverhalten respektiert. Ein populäres Objekterkennungsnetz (YOLOv5), auf diese adaptierten Daten trainiert, erreicht über 95 Prozent Erkennungsgenauigkeit selbst bei der niedrigsten getesteten Lichtstufe. Einfach gesagt zeigt die Arbeit, dass sich durch die Kombination eulenartiger Dunkeladaptation mit eingebautem synaptischem Lernen direkt am Sensor die maschinelle Vision bis in Bereiche vorantreiben lässt, in denen traditionelle Kameras versagen — und das bei deutlich geringerem Energieaufwand. Solche Technologien könnten schließlich Such‑und‑Rettungsdrohnen, autonome Erkundungsfahrzeuge oder astronomische Instrumente ermöglichen, die mehr sehen, ohne viel zu beleuchten.

Zitation: Zhao, Z., Cao, Y., Huang, S. et al. Owl-vision-inspired near sensor computing. Nat Commun 17, 2676 (2026). https://doi.org/10.1038/s41467-026-69123-7

Schlüsselwörter: Sehen bei schlechtem Licht, neuromorpher Sensor, euleninspirierte Bildgebung, Near-Sensor-Computing, Objekterkennung bei Nacht