Clear Sky Science · de

Transferlernen in DeepLC verbessert die Vorhersage von LC-Retentionstimes über deutlich unterschiedliche Modifikationen und Einstellungen hinweg

Warum die Vorhersage von chemischen Zeitpunkten wichtig ist

Immer wenn Wissenschaftler die Proteine in unseren Zellen untersuchen, verlassen sie sich auf eine Methode, die zunächst winzige Proteinfragmente, sogenannte Peptide, durch eine flüssigkeitsgefüllte Säule schickt, bevor sie diese in einem Massenspektrometer wiegen. Wie lange jedes Peptid in der Säule verweilt – seine „Retentionszeit“ – ist außerordentlich aufschlussreich und hilft Forschern zu erkennen und zu bestätigen, was sie messen. Da jedoch jedes Labor leicht unterschiedliche Instrumente und Einstellungen verwendet, brechen Computer‑Modelle, die diese Retentionszeiten vorhersagen, oft zusammen, wenn sie von einem Setup in ein anderes übertragen werden. Dieser Artikel zeigt, wie ein modernes Maschinenlernverfahren namens Transferlernen diese Vorhersagen über viele experimentelle Bedingungen hinweg deutlich zuverlässiger und flexibler machen kann.

Die Reise der Proteinfragmente zeitlich messen

In der Proteinforschung ist die Flüssigkeitschromatographie gekoppelt mit Massenspektrometrie die Arbeitspferd‑Methode. Der Schritt der Flüssigkeitschromatographie trennt Tausende von Peptiden nach ihren chemischen Eigenschaften, sodass sie nicht alle gleichzeitig am Detektor ankommen. Die resultierende Retentionszeit liefert zusammen mit der gemessenen Masse des Peptids einen kraftvollen zweidimensionalen Fingerabdruck. Im vergangenen Jahrzehnt haben Forscher Computer‑Modelle trainiert, Retentionszeiten direkt aus Peptidsequenzen vorherzusagen. Diese Vorhersagen erhöhen die Zuverlässigkeit von Peptididentifikationen, helfen bei der Planung besserer Experimente und sind essenziell für den Aufbau großer, computergenerierter Spektralbibliotheken, die in modernen Hochdurchsatz‑Workflows verwendet werden.

Das Problem sich ändernder Laborbedingungen

Leider ist die Retentionszeit sehr empfindlich gegenüber Details wie Lösungsmittel‑Säuregrad, Säulenmaterial, Druck und Temperatur. Selbst kleine Änderungen können die Reihenfolge, in der Peptide aus der Säule kommen, durcheinanderbringen. Traditionelle Ansätze versuchen dies durch eine „Kalibrierung“ eines anderswo trainierten Modells mit einer kleinen Menge Referenzpeptide zu beheben, wobei angenommen wird, dass die Reihenfolge der Elution erhalten bleibt. Wenn diese Annahme bricht – etwa wenn sich die Chemie der Säule oder der pH‑Wert der Probe ändert – kann die Kalibrierung massiv versagen. Eine andere Möglichkeit ist, für jedes Setup ein völlig neues Modell zu trainieren, aber das erfordert viele gut gemessene Peptide, die nicht immer verfügbar sind, insbesondere bei seltenen oder ungewöhnlichen chemischen Modifikationen.

Wissen wiederverwenden mit Transferlernen

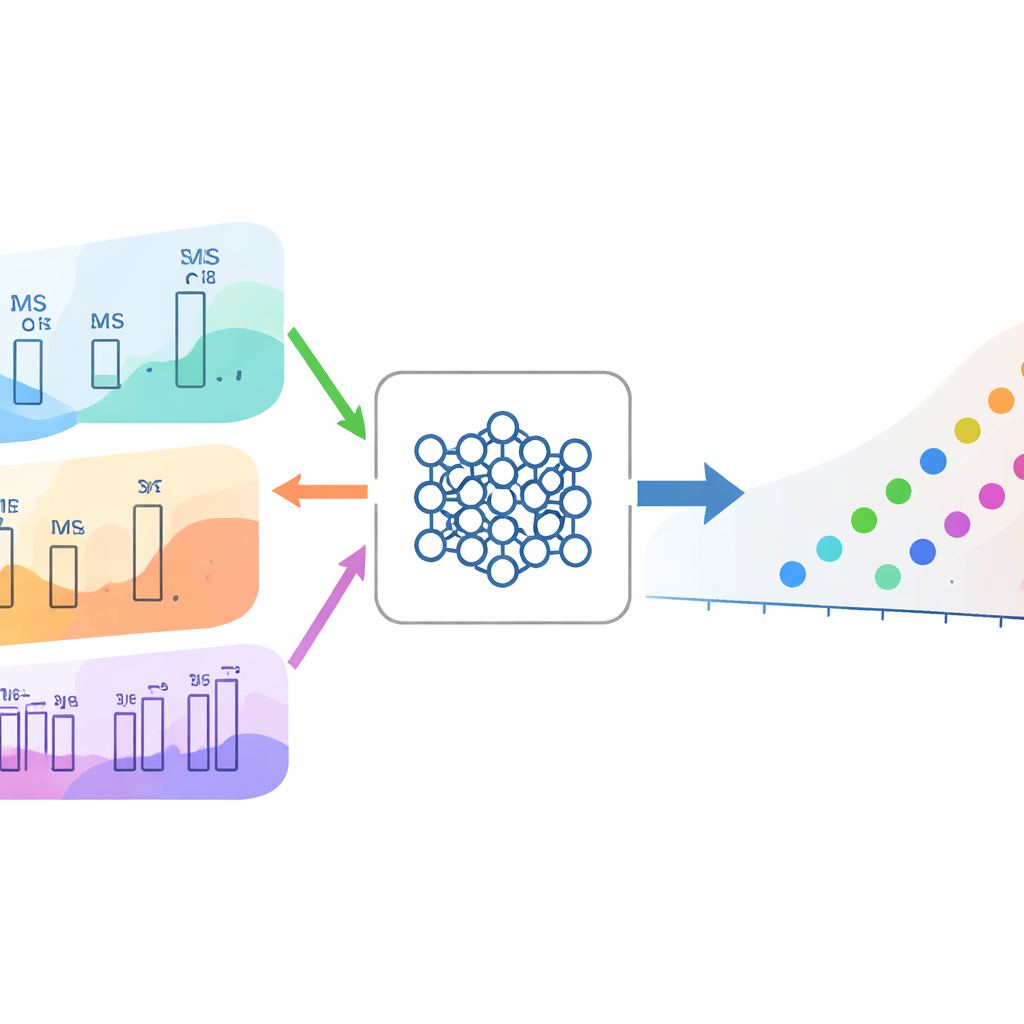

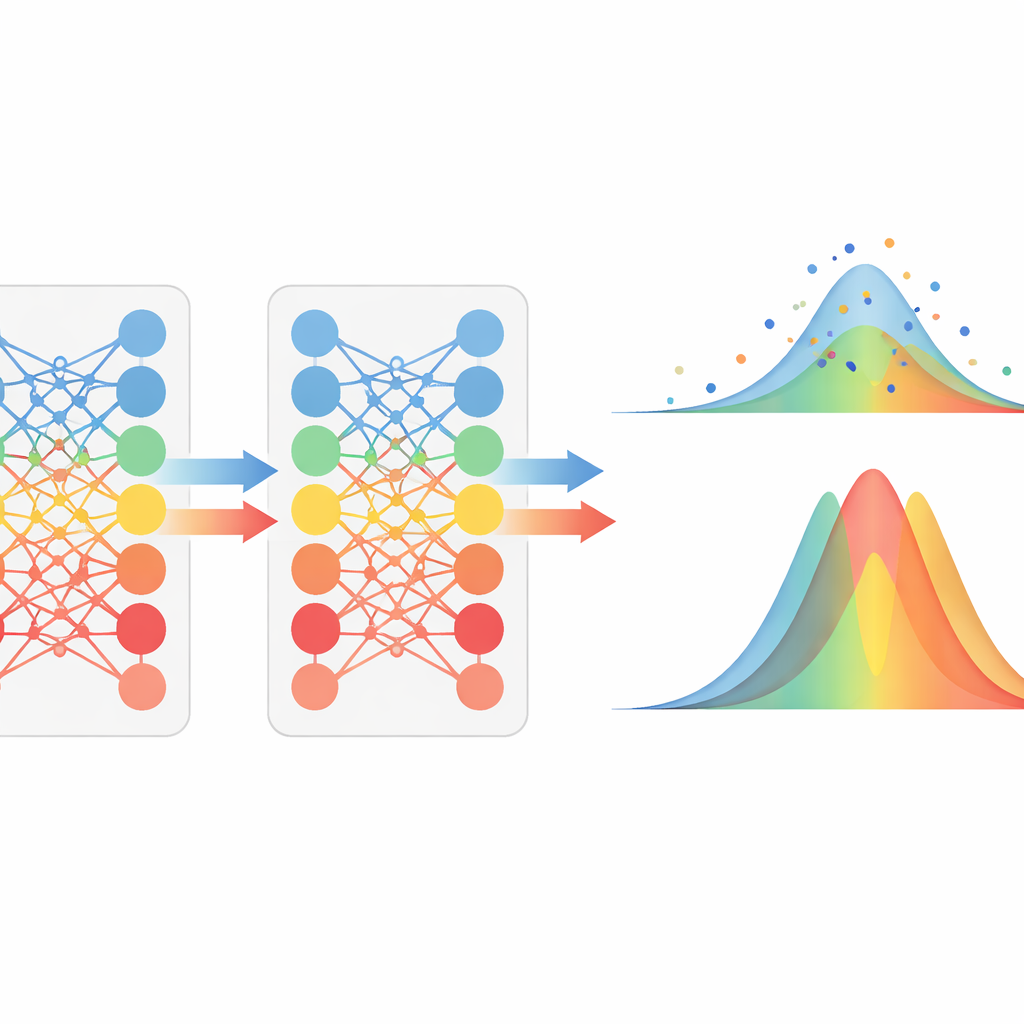

Die Autoren bauen auf DeepLC auf, einem Deep‑Learning‑Modell, das bereits Retentionszeiten für viele Peptidtypen vorhersagt. Anstatt für jede neue Situation bei Null anzufangen, verwenden sie ein Modell, das auf einem großen, hochwertigen Datensatz trainiert wurde, und feinjustieren (fine‑tunen) es an einer deutlich kleineren Sammlung von Peptiden aus dem neuen Setup. Über 474 Datensätze aus Hunderten öffentlicher Experimente hinweg übertrifft diese Transferlern‑Strategie fast immer sowohl einfache Kalibrierung als auch das Training eines neuen Modells aus zufälliger Anfangsbedingung. Die Vorteile sind besonders deutlich, wenn nur wenige Hundert bis wenige Tausend Trainingspeptide verfügbar sind – ein häufiger Fall in realen Studien. Selbst wenn viele Beispiele vorliegen, liefert Transferlernen tendenziell noch etwas bessere Genauigkeit.

Umgang mit ungewöhnlichen Chemien und extremen Bedingungen

Um zu prüfen, wie weit sich dieser Ansatz treiben lässt, untersuchte das Team sehr herausfordernde Szenarien. In einem Fall trugen Peptide ein voluminöses chemisches Label, das sie deutlich „fetthaltiger“ macht und ihre Retentionszeiten stark verschiebt. In einem anderen Fall war die Flüssigkeit in der Säule basisch statt sauer, was die Wechselwirkung der Peptide mit der Säule grundlegend verändert. In beiden Fällen scheiterte die einfache Kalibrierung eines alten Modells, und selbst ein neu trainiertes Modell benötigte viele Beispiele, um gute Genauigkeit zu erreichen. Transferlernen passte sich hingegen schnell an und erreichte ähnliche oder bessere Leistung mit zwei- bis dreimal weniger Trainingspeptiden. Die Methode verbesserte zudem Vorhersagen für ein breites Spektrum posttranslationaler Modifikationen, die während des Trainings nie gesehen wurden, was darauf hindeutet, dass das Vorwissen des Modells über Peptidchemie auf neue Modifikationen übertragbar ist.

Was das für zukünftige Proteinuntersuchungen bedeutet

Für Nicht‑Spezialisten ist die Kernbotschaft, dass die Wiederverwendung dessen, was ein neuronales Netz bereits über das Verhalten von Peptiden gelernt hat, es erheblich erleichtert, präzise Zeitvorhersagen unter neuen experimentellen Bedingungen zu erhalten. Anstatt mühsam große Trainingssätze zu sammeln oder sich mit schlechter Leistung durch einfache Kalibrierung abzufinden, können Forscher ein bestehendes DeepLC‑Modell mit einer überschaubaren Anzahl von Beispielen feinjustieren und dennoch hochgenaue Retentionszeiten erzielen. Das macht fortschrittliche Vorhersagewerkzeuge robuster und zugänglicher, ermöglicht zuverlässige Analysen über verschiedene Instrumente, chemische Einstellungen und seltene Peptidmodifikationen hinweg und hilft letztlich Wissenschaftlern, die Proteinwelt klarer und effizienter zu lesen.

Zitation: Bouwmeester, R., Nameni, A., Declercq, A. et al. Transfer learning in DeepLC improves LC retention time prediction across substantially different modifications and setups. Nat Commun 17, 2601 (2026). https://doi.org/10.1038/s41467-026-68981-5

Schlüsselwörter: Proteomik, Flüssigkeitschromatographie, Vorhersage der Retentionszeit, Tiefes Lernen, Transferlernen