Clear Sky Science · de

Mensch-KI-Teams zur Verbesserung der Genauigkeit und Effizienz der Vorauswahl von Einschlusskriterien für onkologische Studien: eine randomisierte Evaluationsstudie mit retrospektiven elektronischen Gesundheitsakten

Warum es wichtig ist, die richtigen Patientinnen und Patienten zu finden

Für viele Menschen mit Krebs kann die Teilnahme an einer klinischen Studie den Zugang zu modernen Therapien und besseren Behandlungsergebnissen eröffnen. Allerdings nimmt nur ein kleiner Teil der erwachsenen Krebspatienten an Studien teil. Ein wesentlicher Engpass entsteht lange bevor eine Einverständniserklärung unterschrieben wird: Mitarbeitende müssen umfangreiche, unübersichtliche medizinische Unterlagen durchsuchen, um zu prüfen, wer überhaupt infrage kommt. Diese Studie untersucht, ob die Kombination von menschlichen Expertinnen und Experten mit einem KI-System die frühe Vorauswahl genauer machen kann — ohne den Ablauf zu verlangsamen.

Wie die Studiensichtung heute funktioniert

Bevor jemand an einer Krebsstudie teilnehmen kann, müssen Forschungsmitarbeitende entscheiden, ob die Person dutzende detaillierter Einschlussregeln erfüllt, etwa Tumortyp, Stadium, Testergebnisse und das Alltagsfunktionsniveau. Viele dieser Informationen stecken in unstrukturierten Notizen — Radiologieberichten, Sprechstundenberichten, Laborzusammenfassungen — die oft redundant, lückenhaft oder widersprüchlich sind. Das manuelle Durcharbeiten dieser Dokumente ist langsam und anstrengend, und selbst erfahrene Mitarbeitende können wichtige Details übersehen. In der Folge werden einige geeignete Patientinnen und Patienten nie identifiziert und potenziell lebensverlängernde Optionen gehen verloren.

Was die Forschenden getestet haben

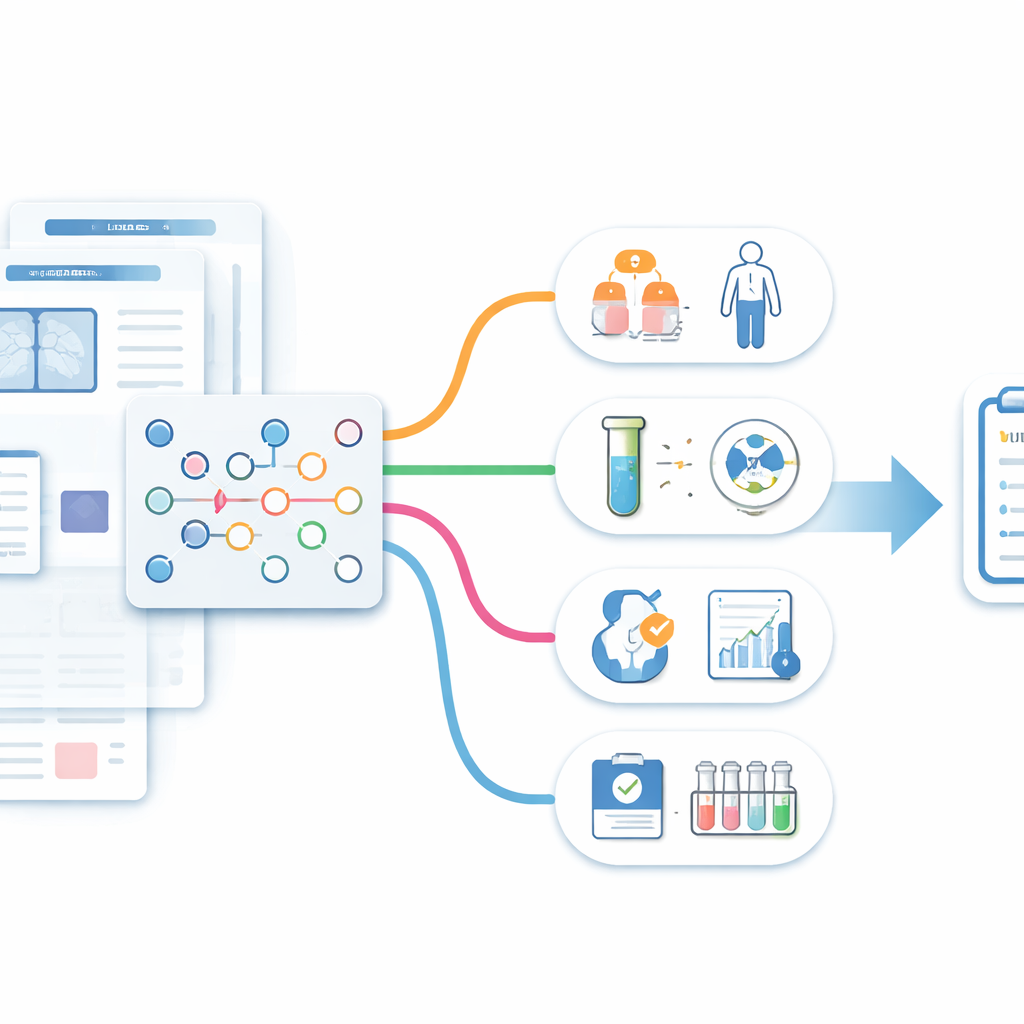

Um zu prüfen, ob KI helfen kann, nutzte das Team elektronische Akten von 355 Personen mit Lungen- oder Darmkrebs, die in einer kommunalen Praxis behandelt wurden. Fokus waren 12 übliche Studienkriterien, darunter Tumorstadium, spezifische Biomarker, Ansprechen auf vorangegangene Therapien und der allgemeine Gesundheitszustand. Ein spezialisiertes „neurosymbolisches“ Sprachsystem wandte sich zunächst gescannten Akten als Text zu und extrahierte dann strukturierte Fakten wie Testergebnisse und Staging-Details. Zwei geschulte Studienkoordinatorinnen bzw. -koordinatoren überprüften jede Akte zweimal — einmal mit KI-Vorschlägen auf dem Bildschirm (Mensch+KI-Ansatz) und einmal ohne (nur Mensch), in zufälliger Reihenfolge. Eine separate Gruppe von Klinikerinnen und Klinikern hatte bereits für jede Akte einen „Goldstandard“-Antwortschlüssel erstellt, anhand dessen die Genauigkeit bewertet wurde.

Wie gut das Mensch–KI-Team abgeschnitten hat

Als Menschen und KI zusammenarbeiteten, stimmten ihre Antworten häufiger mit dem Goldstandard überein als die Bewertungen der Menschen allein. Insgesamt traf das Mensch+KI-Team etwa drei von vier Angaben korrekt, verglichen mit etwas mehr als sieben von zehn bei rein menschlichen Prüferinnen und Prüfern, und deutlich besser als das KI-System allein. Die größten Zugewinne gab es in schwierigen Bereichen wie Biomarkertests und -ergebnissen, dem genauen Tumorstadium und dem Ansprechen auf frühere Behandlungen. In diesen Kategorien half die Stärke der KI beim Durchsuchen großer Textmengen den Koordinatorinnen und Koordinatoren, Informationen zu finden, die sie sonst übersehen hätten, während die Menschen KI-Fehler korrigierten und unklare Fälle interpretierten.

Geschwindigkeit, Abwägungen und menschliche Verzerrung

Überraschenderweise machte die Zugabe der KI den Prozess nicht schneller. Beide Vorgehensweisen dauerten im Schnitt etwas mehr als eine halbe Stunde pro Akte. Die Autorinnen und Autoren vermuten, dass die KI die Arbeit der Koordinatorinnen und Koordinatoren umschichtete: Statt selbst intensiv nach jedem Detail zu suchen, widmeten sie mehr Aufwand dem Prüfen und Interpretieren der von der KI vorgeschlagenen Einträge. Das kann sich als gesunde Sicherheitsmaßnahme erweisen und das Risiko verringern, dass Menschen die maschinellen Antworten einfach ungeprüft übernehmen. Die Studie untersuchte auch, wo die Zusammenarbeit scheitern kann. Bei einer Messgröße des Funktionsniveaus der Patientinnen und Patienten war die KI unzuverlässig, und menschliche Prüferinnen und Prüfer, die sich zu sehr auf deren Ausgabe stützten, schnitten etwas schlechter ab — ein Hinweis auf „Automationsbias“. In anderen Bereichen schienen Menschen korrekte KI-Signale zu wenig zu nutzen, was auf „Bestätigungsfehler“ hindeutet, also die Tendenz, Informationen zu bevorzugen, die den ersten Eindrücken entsprechen.

Was das für die zukünftige Krebsversorgung bedeutet

Einfach gesagt zeigt diese Studie, dass eine gut gestaltete Partnerschaft zwischen Menschen und KI die frühe Sichtung für Studien etwas genauer machen kann, ohne sie zu verlangsamen. Die Verbesserungen sind moderat, konzentrieren sich jedoch auf genau die komplexen Details — wie Biomarkerstatus und präzises Staging — die häufig darüber entscheiden, ob eine Patientin oder ein Patient an einer Studie teilnehmen kann. Werden solche Systeme weiter verfeinert und in Live-Abläufe in Kliniken integriert, könnten sie dabei helfen, mehr geeignete Patientinnen und Patienten zu identifizieren, den Zugang zu modernen onkologischen Studien zu verbreitern und dies gleichzeitig bei Beibehaltung der menschlichen Entscheidungsverantwortung zu erreichen.

Zitation: Parikh, R.B., Kolla, L., Beothy, E.A. et al. Human-AI teaming to improve accuracy and efficiency of eligibility criteria prescreening for oncology trials: a randomized evaluation trial using retrospective electronic health records. Nat Commun 17, 2306 (2026). https://doi.org/10.1038/s41467-026-68873-8

Schlüsselwörter: klinische Krebsstudien, elektronische Gesundheitsakten, künstliche Intelligenz, Patienteneignung, Mensch-KI-Zusammenarbeit