Clear Sky Science · de

Rekurrente Verbindungen erleichtern die Erkennung okkludierter Objekte durch „Explaining-Away“

Wie das Gehirn das Wahrnimmt, was nicht sichtbar ist

Im Alltag erkennen wir mühelos Objekte, die teilweise verdeckt sind – eine Katze hinter einem Vorhang, ein Auto hinter einem Baum. Diese Arbeit untersucht, wie Gehirne und gehirninspirierte künstliche Netze diese Fähigkeit erreichen. Die Autoren zeigen, dass Schaltkreise mit Rückkopplungen Informationen über das verdeckende Objekt nutzen können, um mental das dahinterliegende Objekt „aufzufüllen“. Das offenbart einen wichtigen Trick, auf den unser visuelles System zurückgreifen könnte, wenn die Welt unübersichtlich und unvollständig ist.

Warum versteckte Objekte ein schwieriges Problem sind

Wenn ein Objekt okkludiert ist, fehlen viele seiner üblichen visuellen Merkmale oder sind verzerrt. Ein einfaches feedforward-visuelles System, bei dem Informationen geradewegs von den Augen zu den Erkennungszentren fließen, muss das verborgene Objekt allein anhand sichtbarer Bruchstücke erraten. Biologische Gehirne hingegen sind voll rekurrenter Verbindungen – Schleifen, in denen höhere Areale mit früheren Rückkopplungen. Diese Schleifen werden seit langem verdächtigt, bei schwierigen Aufgaben wie der Erkennung okkludierter Objekte zu helfen, doch war unklar, welchen konkreten Vorteil sie bieten und wie sie die internen Repräsentationen des Gesehenen verändern.

Gehirninspirierte Netzwerke auf dem Prüfstand

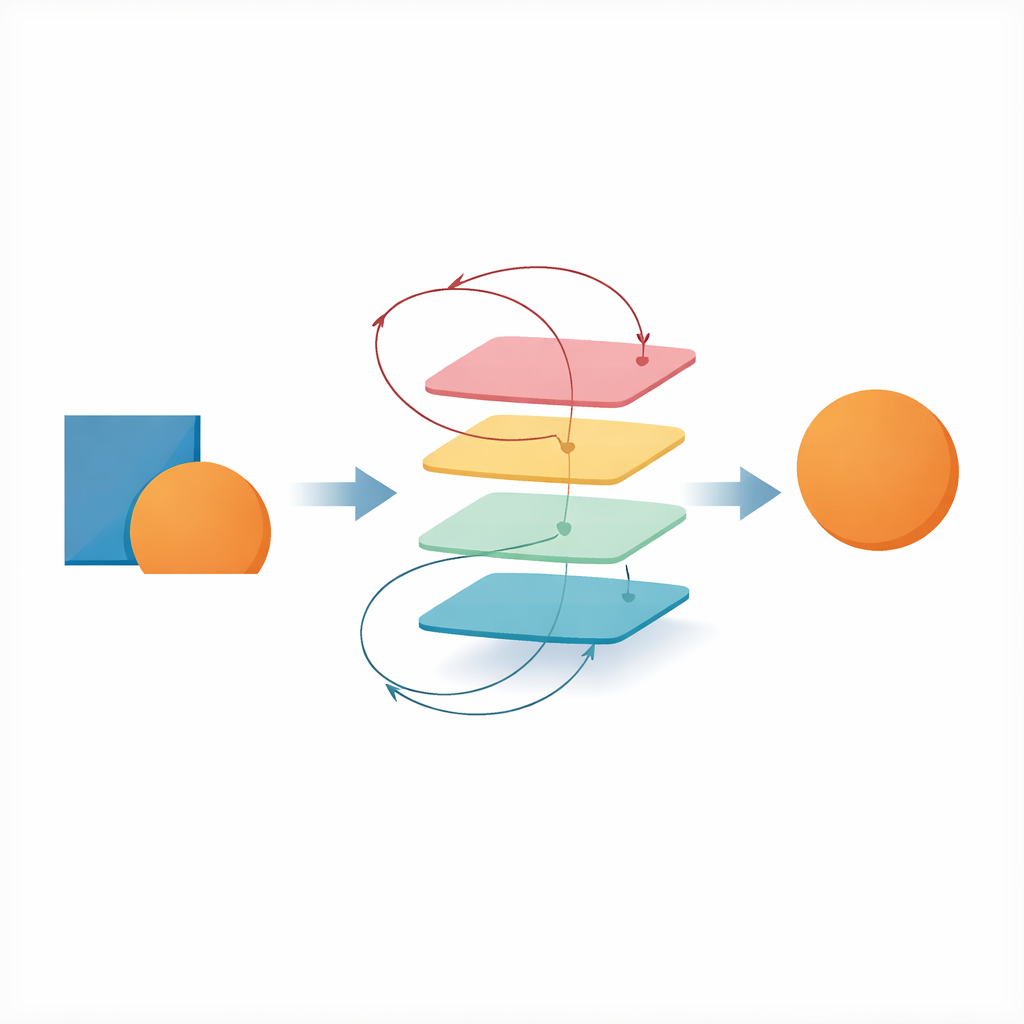

Die Autoren bauten eine umfangreiche Reihe tiefer Faltungsnetzwerke, die Stadien der visuellen Verarbeitung nachahmen. Einige waren rein feedforward, andere hatten rekurrente Schleifen oder zusätzliches top-down-Feedback. Sie trainierten diese Modelle an eigens erstellten Bildsätzen, in denen ein Modeartikel ein anderes teilweise verdeckte. Die Netze mussten unter verschiedenen Aufgabenbedingungen sowohl das vordere (okkulierende) als auch das hintere (okkludierte) Objekt identifizieren. Die Leistung hing weniger davon ab, ob ein Netzwerk rekurrent oder feedforward war, sondern mehr von seiner „rechnerischen Tiefe“ – wie viele aufeinanderfolgende Verarbeitungsschritte ein Eingangssignal durchlief. Tiefe feedforward-Modelle konnten bei der einfachen Erkennungsaufgabe mit rekurrenten Modellen mithalten oder diese übertreffen, was zeigt, dass Rekurrenz für sich genommen nicht automatisch überlegen ist.

Ein besonderer Trick: Den Okkluder erklären (explaining away)

Obwohl Tiefe für die rohe Genauigkeit am wichtigsten war, zeigten rekurrente Netze einen charakteristischen Vorteil in der Nutzung des Kontexts. Wurden diese Netze zunächst gebeten, das vordere Objekt zu identifizieren und erst danach das verborgene, verbesserte sich ihre Leistung beim okkludierten Objekt verglichen mit einer Klassifikation allein. Dieses Muster trat in gewöhnlichen feedforward-Netzen, die beide Labels gleichzeitig ausgaben, nicht auf. Die Autoren deuten dies als „explaining away“: Sobald das System den Okkluder erkannt hat, kann es ungewöhnliche oder fehlende Bildmerkmale als durch diesen Okkluder verursacht behandeln, statt sie als Hinweis auf ein seltsames neues Objekt zu werten. In realistischeren 3D-Szenen und in einem an Primaten orientierten Modell (CORnet) steigerte die gleiche Reihenfolge – vorderes Objekt vor verborgenem Objekt – ebenfalls die Erkennungsleistung.

Dasselbe Phänomen beim Menschen beobachten

Um zu prüfen, ob Menschen eine ähnliche Strategie verwenden, führten die Forschenden ein Online-Experiment durch. Teilnehmende sahen kurz ein einzelnes Objekt, dann eine Szene, in der ein Objekt ein anderes verdeckte, und mussten schließlich auswählen, welches von zwei Optionen das verborgene Objekt gewesen war. In manchen Durchgängen entsprach das anfänglich gezeigte Einzelobjekt dem späteren Okkluder; in anderen war es nicht verwandt. Wenn Menschen gerade den tatsächlichen Okkluder gesehen hatten, identifizierten sie das verborgene Objekt genauer und antworteten schneller – über verschiedene Okklusionsgrade hinweg. Das legt nahe, dass unsere Gehirne, wie die rekurrenten Netze, davon profitieren, das verdeckende Element zuerst zu verarbeiten und dieses Wissen anschließend zu nutzen, um die partiellen Hinweise auf das Dahinterliegende zu interpretieren.

Versteckte Bilder von innen wiederherstellen

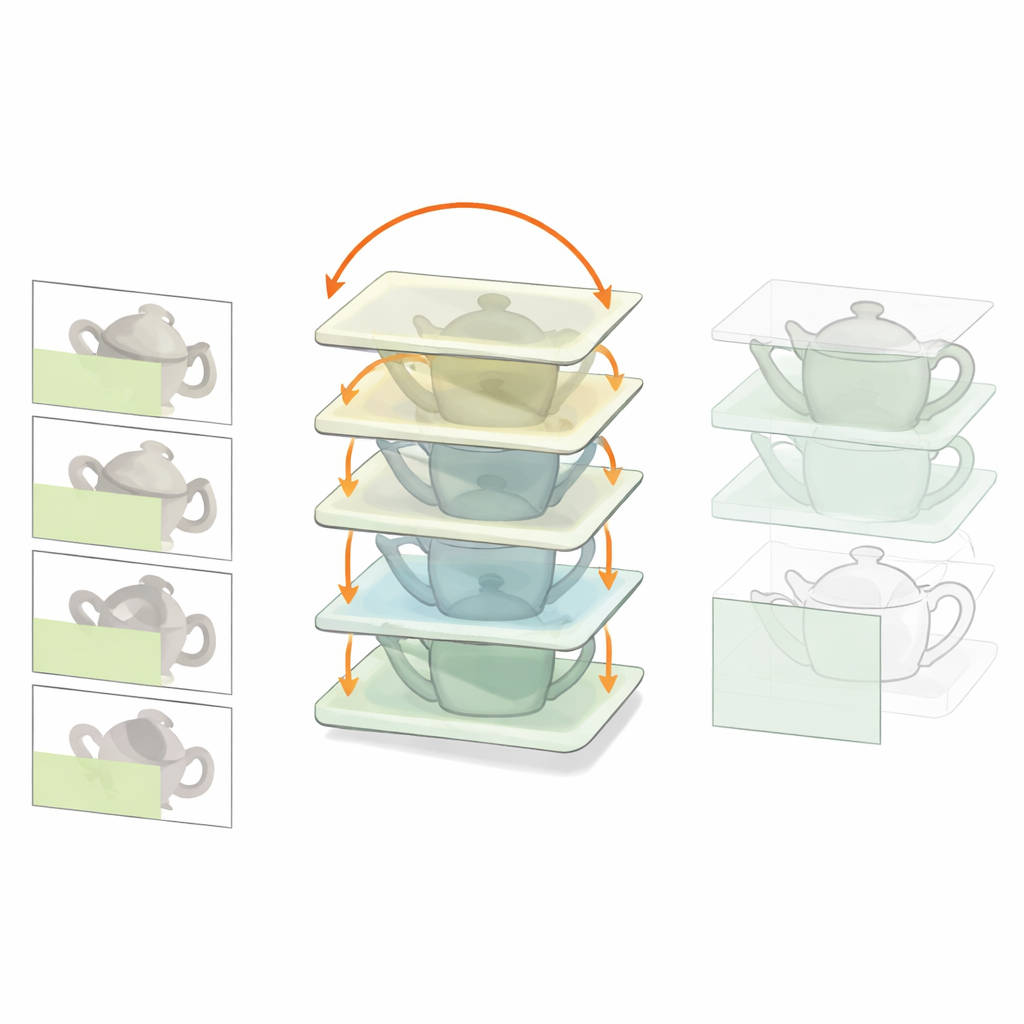

Um tiefer in den Mechanismus vorzudringen, entwarfen die Autoren ein biologisch inspirierteres Modell, Recon-Net, das lose auf Wechselwirkungen zwischen visuellem Kortex und präfrontalem Kortex basiert. Recon-Net erhält ein Bild mit einem okkludierten Objekt sowie eine separate Ansicht des Okkluders und transformiert iterativ eine interne Repräsentation, bis sie dem entsprechen sollte, wie die nicht-okkludierte Version des verborgenen Objekts aussieht. Auffällig ist, dass Klassifizierer, die nur auf sauberen, nicht-okkludierten Bildern trainiert wurden, die Ausgaben von Recon-Net fast genauso gut erkennen können, als wären sie direkt auf okkludierte Beispiele trainiert worden. Das bedeutet, dass die rekurrente Verarbeitung effektiv ein sauberes internes Abbild des verborgenen Objekts „rekonstituiert“, obwohl die Pixel fehlen.

Was das für Gehirne und Maschinen bedeutet

Insgesamt zeigt die Studie, dass Rückkopplungsschleifen nicht nur rohe Leistungssteigerung bewirken, sondern eine qualitativ andere Art, Kontext zu nutzen. Rekurrente Verbindungen unterstützen auf natürliche Weise das explaining-away: Sie ermöglichen dem visuellen System, zu berücksichtigen, wie ein Okkluder das Wahrgenommene verzerrt, und eine stabile interne Repräsentation des verborgenen Objekts wiederherzustellen. Gleichzeitig finden die Autoren, dass das Training an stark okkludierten Bildern die Reaktionen auf klare Bilder weitgehend unverändert lassen kann, was im echten Gehirn das Lernen erleichtern könnte, indem ständige Umverkabelung vermieden wird. Diese Erkenntnisse deuten auf ein gemeinsames Prinzip für Neurowissenschaft und künstliche Intelligenz hin: Wenn die Welt Informationen verbirgt, schauen kluge Systeme nicht nur genauer hin – sie schließen daraus, warum die Informationen fehlen.

Zitation: Kang, B., Midler, B., Chen, F. et al. Recurrent connections facilitate occluded object recognition by explaining-away. Nat Commun 17, 2225 (2026). https://doi.org/10.1038/s41467-026-68806-5

Schlüsselwörter: Erkennung okkludierter Objekte, rekurrente neuronale Netze, visuelle Wahrnehmung, explaining away, computational neuroscience