Clear Sky Science · de

Taktiler Sensor-Transfer: Kraftwahrnehmung voneinander lernen

Roboter, die fühlen können und ihr Tastsinn teilen

Da Roboter aus Fabriken in Wohnungen, Krankenhäuser und Lagerhallen vordringen, benötigen sie einen Sinn, den wir meist für selbstverständlich halten: den Tastsinn. So wie unsere Finger automatisch anders greifen, wenn wir einen Chips versus einen schweren Karton anheben, müssen künftige Roboter lernen, wie fest sie drücken und wann ein Objekt zu entgleiten droht. Dieser Artikel stellt eine neue Methode vor, mit der robotische „Haut“ Kraftwahrnehmung voneinander erlernen kann, wodurch teure Kalibrierungen sinken und Maschinen der menschlichen Geschicklichkeit näherkommen.

Warum Robotertastsinn so schwer zu meistern ist

Moderne Roboter besitzen bereits viele Arten künstlicher Haut. Einige verwenden winzige Kameras, die in weiche Gele blicken, andere setzen auf Magnete oder elektronische Gitter zur Druckmessung. Jedes Design glänzt bei bestimmten Aufgaben, doch sie sprechen alle unterschiedliche „Dialekte“ des Tastsinns: dieselbe Kraftanwendung kann bei zwei Sensoren sehr verschiedene Signale erzeugen. Heute benötigt in der Regel jeder neue Sensor einen eigenen aufwändigen Trainingsprozess mit präzisen Kraftmessgeräten, der tausendfach wiederholt wird. Noch problematischer: weiche Materialien altern und verschleißen, sodass diese teure Kalibrierung bei Sensorwechsel erneut ansteht.

Eine Idee aus dem menschlichen Gehirn ausleihen

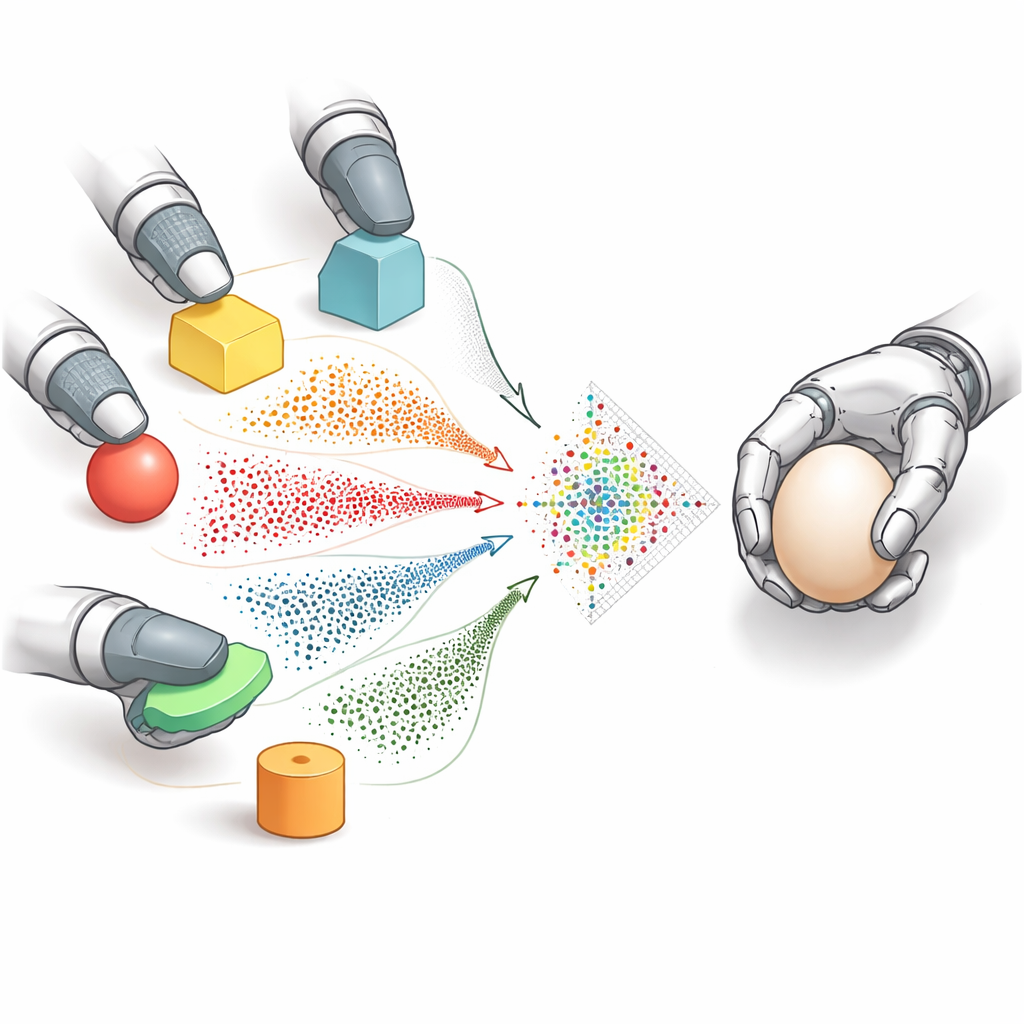

Menschen lösen ein ähnliches Problem mühelos. Unsere Haut ist mit verschiedenen Arten von Rezeptoren gespickt, doch das Gehirn wandelt all ihre Signale in einen gemeinsamen internen Code um. Dieses einheitliche taktile Gedächtnis erlaubt es uns, abzuschätzen, wie sich etwas an einem Teil der Hand anfühlt, das es noch nie berührt hat, allein durch Rückgriff auf Erfahrungen. Die Forschenden hinter dieser Arbeit ahmen diese Idee bei Robotern nach. Sie wandeln alle Sensorausgaben — Kamerabilder, Magnetmessungen oder elektrische Signale — in eine gemeinsame, bildähnliche Form aus Punkten um, die darstellen, wie sich die Haut verformt. Diese gemeinsame Marker-Repräsentation fungiert als einfache „Sprache des Tastsinns“, die jeder Sensor verwenden kann.

Einen Sensor beibringen, einen anderen zu imitieren

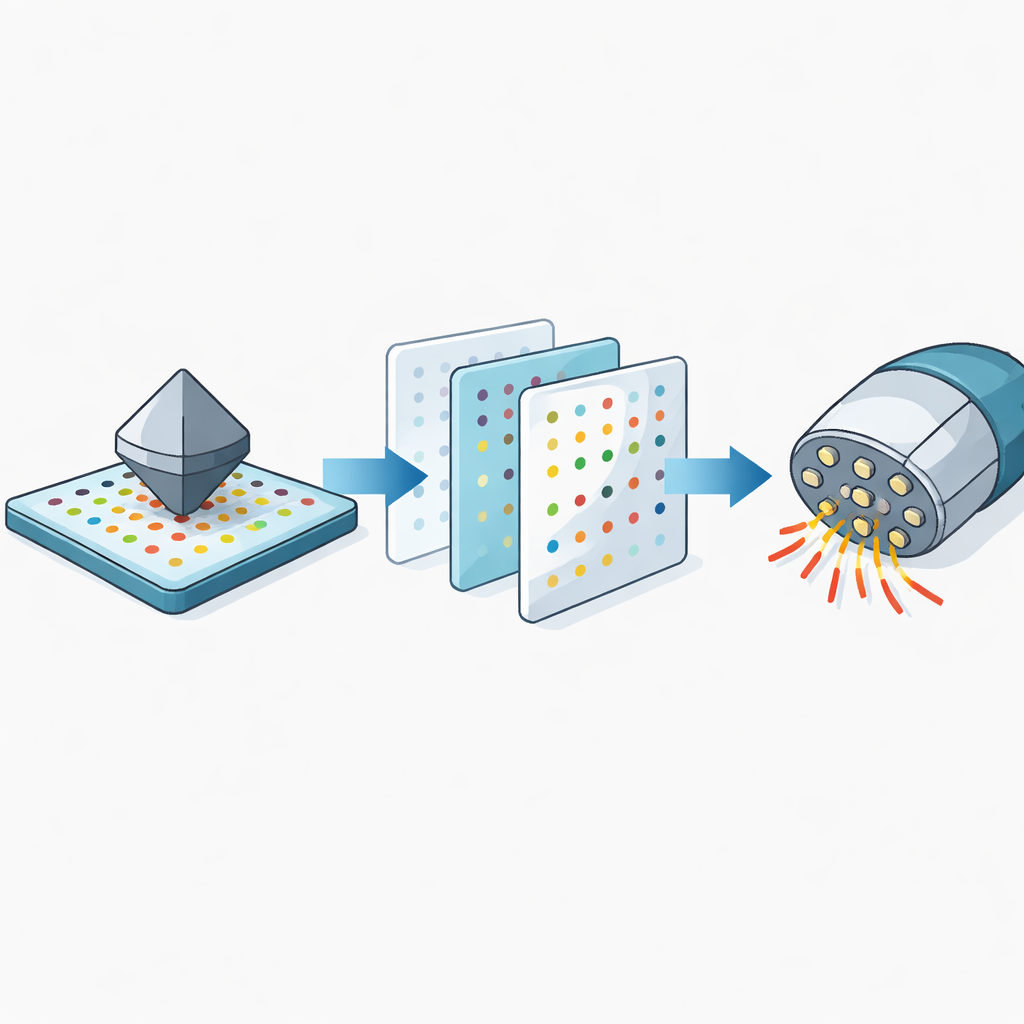

Sobald alle Sensoren diese punktbasierte Sprache sprechen, führt das Team einen Übersetzungsschritt ein, den sie Marker-zu-Marker-Übersetzung nennen. Mit leistungsfähigen generativen Modellen trainieren sie ein System, das das Punktmuster eines Sensors in das Muster transformieren kann, das ein anderer Sensor bei derselben Berührung erzeugt hätte. Das bedeutet, ein gut kalibrierter Sensor kann sich praktisch vorstellen, was ein unkalibrierter Sensor fühlen würde, und synthetische Trainingsdaten für ihn erzeugen. Ein zweites Modell betrachtet dann kurze Sequenzen dieser Punktbilder, um vorherzusagen, wie sich Kräfte über die Zeit in drei Richtungen ändern, wobei sowohl Druck als auch seitliches Scheren berücksichtigt werden.

Umgang mit realen Unterschieden in weicher Haut

In der Praxis sind verschiedene robotische Häute nicht nur unterschiedlich geformt und verkabelt; sie bestehen auch aus Materialien, die weicher oder steifer sein können und sich mit der Zeit verändern. Diese Unterschiede können Kraftschätzungen verzerren, selbst wenn die Muster ähnlich aussehen. Die Forschenden messen, wie sich jeder Materialtyp unter Last verformt, und bauen einen einfachen Korrekturschritt ein, der Kraftbeschriftungen vor dem Training nach oben oder unten skaliert. Diese Materialkompensation reduziert Fehler deutlich, insbesondere beim Transfer zwischen sehr weichen und sehr steifen Häuten.

Vom Labortisch zur alltäglichen Manipulation

Das Team testet seine Methode, GenForce genannt, an einer breiten Mischung von Sensoren — von mehreren Kopien des gleichen kamerabasierten Pads bis hin zu sehr unterschiedlichen Designs mit Magneten oder gebogenen, fingertipähnlichen Formen. In mehr als 200 Kombinationen in Simulation und Hardware senkt GenForce die Vorhersagefehler deutlich gegenüber dem einfachen Wiederverwenden eines auf einem anderen Sensor trainierten Modells. In Demonstrationen verwendet eine Roboterhand, die an jedem Finger unterschiedliche taktile Häute trägt, übertragene Modelle, um zerbrechliche Gegenstände wie Obst und Kartoffelchips behutsam zu greifen und rutschende Objekte zu erkennen und durch Koordination der Messwerte beider Seiten eines Griffs zu korrigieren.

Was das für die Zukunft robotischer Hände bedeutet

Indem taktile Sensoren Kraftwahrnehmung voneinander lernen, statt bei null anzufangen, weist GenForce den Weg zu Robotern, die sich leichter und kostengünstiger in großem Maßstab einsetzen lassen. Ein einziger, sorgfältig kalibrierter Sensor könnte viele andere trainieren, selbst mit unterschiedlichen Designs, und vortrainierte Modelle ließen sich mit nur einer kleinen Menge neuer Daten feinabstimmen. Für Nicht-Fachleute ist die Kernaussage einfach: Diese Arbeit macht es praktischer, dass Roboter spüren, wie fest sie greifen, und schnell reagieren, wenn Gegenstände zu rutschen beginnen — und bringt uns näher an Maschinen, die die reale Welt mit derselben sicheren Berührung wie menschliche Hände handhaben.

Zitation: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Schlüsselwörter: Roboter-Berührung, taktilen Sensoren, Kraftmessung, Roboter-Manipulation, Transferlernen