Clear Sky Science · de

Neuronale und rechnerische Mechanismen, die dem einmaligen perzeptuellen Lernen beim Menschen zugrunde liegen

Das verborgene Bild sehen

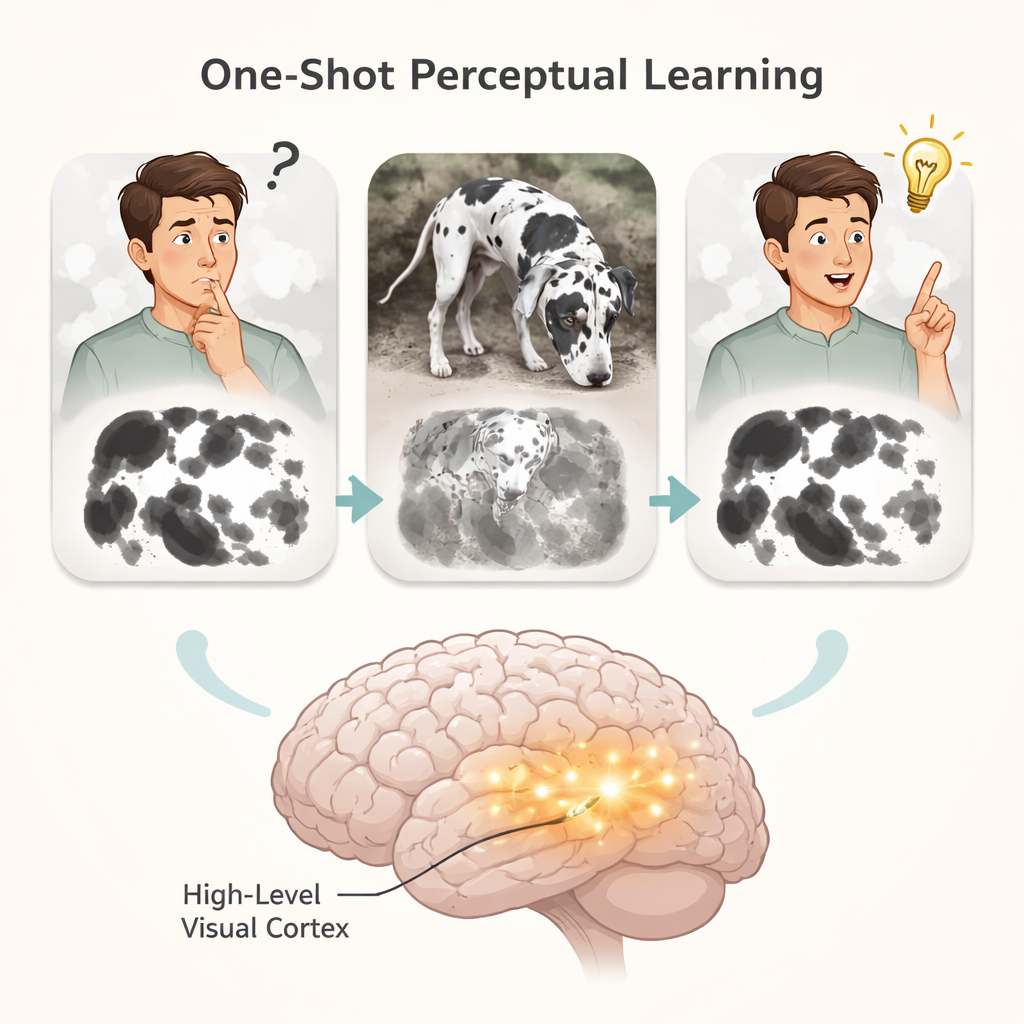

Viele Menschen kennen den plötzlichen „Aha!“-Moment, wenn ein verwirrendes schwarz-weiß-fleckiges Bild plötzlich als klares Bild eines Hundes oder eines Gesichts erscheint – und sobald man es gesehen hat, lässt sich der Eindruck nicht mehr rückgängig machen. Diese Studie fragt, wie ein einziger kurzer Blick auf ein klares Bild dauerhaft verändern kann, was wir in einer verwischten Version sehen, und was das darüber verrät, wie unser Gehirn – und zukünftige KI-Systeme – aus nur einem Beispiel lernen.

Von verschwommenen Flecken zur sofortigen Erkennung

Die Forschenden nutzten klassische „Mooney-Bilder“: stark vereinfachte Schwarz-Weiß-Bilder, die schwer zu erkennen sind, bis man das ursprüngliche Graustufenfoto sieht, aus dem sie entstanden sind. Freiwillige versuchten zunächst zu benennen, was sie in diesen schwierigen Bildern sahen. Später betrachteten sie kurz die passenden klaren Fotos und versuchten dann erneut die schweren Bilder. Nach dieser einzigen Begegnung konnten die Personen die zuvor rätselhaften Bilder plötzlich erkennen, und diese Verbesserung hielt an. Indem das Team die klaren Fotos sorgfältig veränderte – sie links-rechts spiegelte, rotierte, in der Größe änderte oder auf dem Bildschirm verschob – kartierten sie, welche Art von visuellen Informationen das Gehirn während dieses One-Shot-Lernens tatsächlich speichert.

Wo das Gehirn die neue Einsicht speichert

Verschiedene Veränderungen der Bilder beeinflussten das Lernen unterschiedlich. Das Vergrößern oder Verkleinern des klaren Bildes (doppelt so groß oder halb so groß) beeinträchtigte das Lernen nicht, was darauf hindeutet, dass die gespeicherte „Vorlage“ des Gehirns in der Größe flexibel ist. Das Spiegeln, Rotieren oder Verschieben des Bildes auf dem Bildschirm schwächte das Lernen jedoch, wenn auch nicht vollständig. Das Ersetzen des klaren Bildes durch ein anderes Exemplar aus derselben Kategorie – etwa ein anderer Hund – machte das Lernen komplett zunichte. Das zeigt, dass das Gehirn nicht nur die Idee „das ist ein Hund“ speichert; vielmehr bewahrt es eine detaillierte, bildähnliche Erinnerung an die spezifische Form und Anordnung des genauen Bildes. Die Kombination dieser Verhaltensbefunde mit dem bekannten Aufbau des visuellen Systems deutet auf höhere visuelle Areale und nicht auf frühe visuelle Regionen oder Gedächtnisstrukturen wie den Hippocampus als wahrscheinlichen Speicherort dieses neuen Wissens hin.

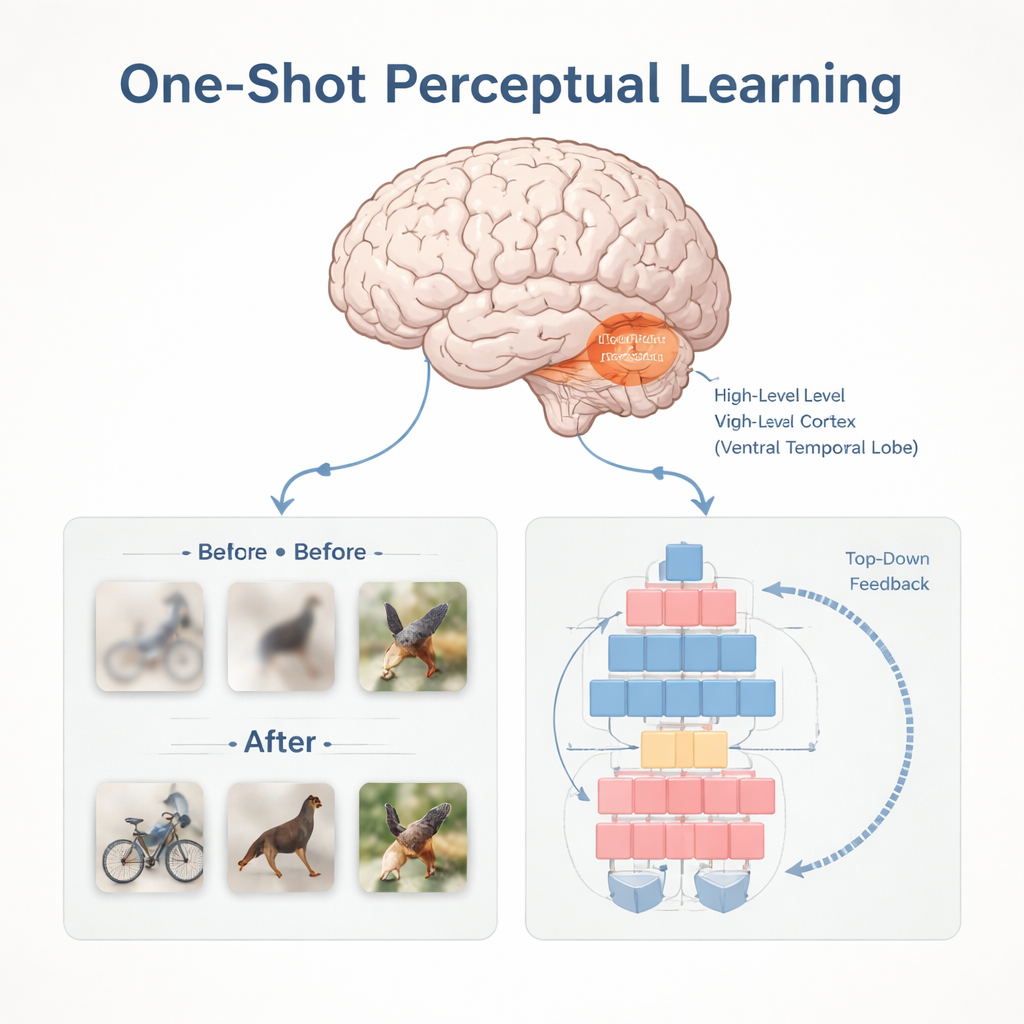

Dem Lernen im Gehirn beim Entfalten zuschauen

Um das zu bestätigen, verwendete das Team ultra-hochauflösende 7-Tesla-MRT-Scans und direkte Aufzeichnungen von Elektroden, die bei Epilepsiepatientinnen und -patienten im Gehirn platziert waren. Die MRT-Experimente zeigten, dass Neuronen in einer Region, die als höherer visueller Kortex bezeichnet wird, auf verschiedene Versionen desselben Objekts (verändert in Größe, Position oder Orientierung) genau so reagierten, wie es aus den Verhaltensstudien vorhergesagt worden war. In den Elektrodenaufzeichnungen trat die entscheidende Veränderung zuerst in diesem höheren visuellen Kortex auf: Nach dem Lernen wurden die Aktivitätsmuster, die das schwierige Bild auslösten, ähnlicher zu denen, die sein klares Gegenstück auslöste, und das geschah hier früher als in den primären visuellen Arealen. Dieses zeitliche Muster legt nahe, dass diese Region der Ort ist, an dem die neue „Prior“-Information gespeichert und reaktiviert wird und dass sie dann Feedback an frühere visuelle Bereiche sendet, um dabei zu helfen, mehrdeutige Eingaben zu interpretieren.

Eine Maschine bauen, die im One-Shot-Verfahren lernt

Die Forschenden bauten außerdem ein tiefes neuronales Netzmodell, das diese Fähigkeit nachahmen sollte. Ihr System verwendete einen modernen Vision Transformer als „bottom-up“-visuelle Engine, kombiniert mit einem speziellen Modul, das Vorabinformationen speichert und „top-down“-Feedback sendet, wenn es später ein verwandtes Bild sieht. Trainiert an Mooney-ähnlichen Aufgaben, zeigte das Modell echtes One-Shot-Lernen: Seine Genauigkeit stieg nach nur einer Begegnung mit dem klaren Bild sprunghaft an und übertraf deutlich, was durch bloße Wiederholung erklärbar wäre. Es teilte sogar viele der gleichen Erfolge und Fehler mit menschlichen Beobachtern bei bestimmten Bildern, und die internen Merkmale, die es aus den klaren Bildern lernte, konnten vorhersagen, welche Bilder Menschen lernen würden bzw. nicht lernen würden zu erkennen. Beim Vergleich der im Modell gespeicherten Vorabinformation mit menschlichen Hirnscans fanden die Forschenden die engste Übereinstimmung in denselben höheren visuellen Regionen, die auch in den Experimenten hervorgehoben wurden.

Warum das für Gehirne und Maschinen wichtig ist

Zusammen deuten diese Befunde darauf hin, dass unsere plötzlichen „Jetzt sehe ich es!“-Momente entstehen, wenn höhere visuelle Areale nach einer einzigen Erfahrung ihre Verknüpfungen rasch anpassen und ein detailliertes, bildähnliches Vorwissen speichern, das später unsere Interpretation verrauschter Eingaben umgestalten kann. Diese schnelle, aber stabile Form des Lernens, verankert im höheren visuellen Kortex und unterstützt durch top-down-Feedback, bietet eine Blaupause für den Bau von KI-Systemen, die aus sehr wenigen Beispielen lernen können. Sie liefert auch einen Ausgangspunkt, um zu verstehen, was schiefgehen könnte, wenn die Wahrnehmung zu stark auf Vorannahmen vertraut – wie bei bestimmten psychiatrischen Erkrankungen, die Halluzinationen umfassen.

Zitation: Hachisuka, A., Shor, J.D., Liu, X.C. et al. Neural and computational mechanisms underlying one-shot perceptual learning in humans. Nat Commun 17, 1204 (2026). https://doi.org/10.1038/s41467-026-68711-x

Schlüsselwörter: One-Shot-Lernen, visuelle Wahrnehmung, höhere visuelle Kortizes, perzeptuelles Lernen, tiefe neuronale Netze