Clear Sky Science · de

Ultraschnelle visuelle Wahrnehmung jenseits menschlicher Fähigkeiten durch Bewegungsanalyse mit synaptischen Transistoren

Warum schnellere Roboter-Vision wichtig ist

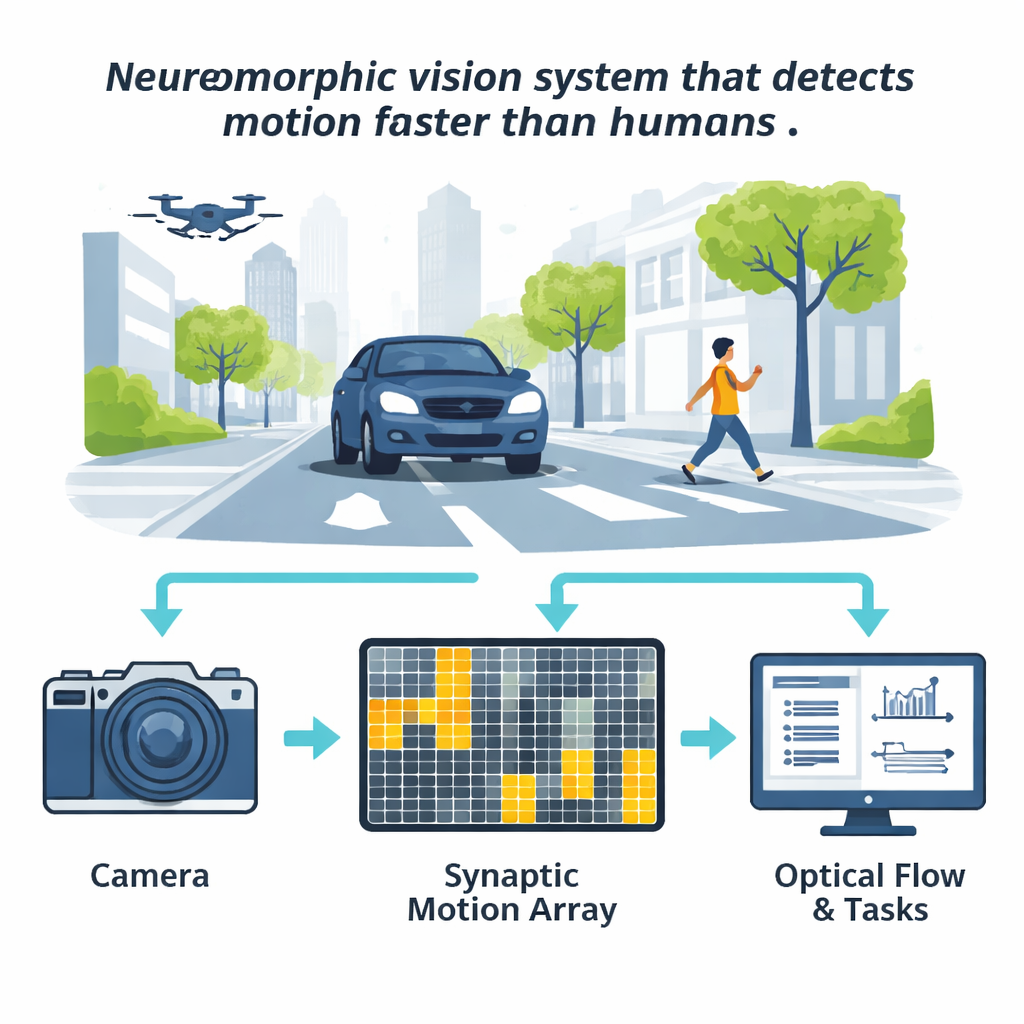

Wenn das Fahrassistenzsystem eines Autos oder eine fliegende Drohne auch nur um einen Bruchteil einer Sekunde zu langsam reagiert, können die Folgen gravierend sein. Die besten heutigen Computer-Vision-Algorithmen erreichen in Standardtests menschliches Niveau oder übertreffen es, benötigen aber immer noch zu viel Zeit, um jedes Videobild in Echtzeit zu verarbeiten. Dieses Papier stellt eine neue Form von Vision-Hardware vor, an der sich das Gehirn orientiert und die Maschinen erlaubt, Bewegung deutlich schneller als Menschen zu erkennen, ohne Genauigkeit einzubüßen.

Wie wir Maschinen normalerweise Bewegung beibringen

Konventionelle Bewegungsanalyse beruht auf einer Methode namens optischer Fluss, die schätzt, wie sich jeder Punkt im Bild von einem Frame zum nächsten bewegt. Sie funktioniert gut, ist aber rechenintensiv: Für ein vollständiges hochauflösendes Bild kann eine leistungsstarke Grafikkarte mehr als eine halbe Sekunde benötigen, um die Berechnung abzuschließen. In schnelllebigen Szenarien wie der Autobahnfahrt kann diese Verzögerung bedeuten, dass Dutzende Meter zurückgelegt werden, bevor das System eine Gefahr erkennt. Anders als das menschliche visuelle System, das schnell die relevantesten Bildbereiche fokussiert, bearbeiten Standardalgorithmen pflichtbewusst jeden Pixel, selbst in statischen Hintergrundregionen, die kaum nützliche Informationen liefern.

Ein Trick aus den frühen Stationen der Gehirnvision übernehmen

Die Biologie löst dieses Problem, indem frühe Filterstufen im Auge und Thalamus hervorheben, wo Veränderung stattfindet, und alles andere herunterspielen. Die Autorinnen und Autoren ahmen diese Idee in Silizium nach, indem sie ein neuromorphes „temporal attention“-Modul bauen. Eine Standardkamera nimmt weiterhin die Bilder auf, aber ihre Helligkeitsänderungen werden zusätzlich in ein kompaktes Gitter aus synaptischen Transistoren eingespeist – elektronische Bauelemente, die sich ein wenig wie verstellbare Verbindungen im Gehirn verhalten. Jedes Bauteil akkumuliert lokal, wie stark sich das Licht in seinem zugewiesenen Bereich über ein kurzes Zeitfenster verändert hat. Gitterbereiche, die starke Veränderungen registrieren, leuchten als Interessensregionen auf, während ruhigere Bereiche in den Hintergrund treten.

Intelligente Transistoren, die Bewegung speichern

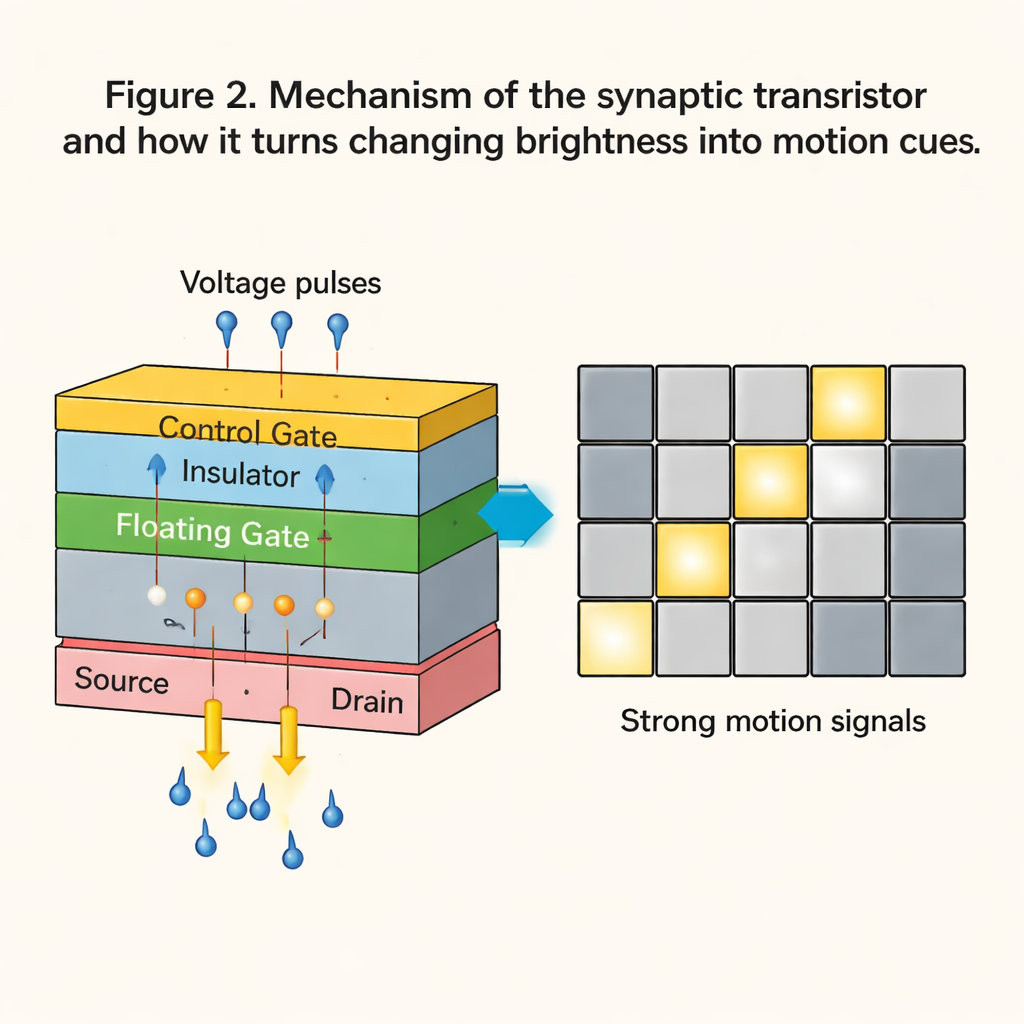

Im Kern dieses Systems steht ein speziell entwickelter Floating-Gate-Synaptiktransistor aus geschichteten, atomar dünnen Materialien. Durch das Anlegen kurzer Spannungspulse lässt sich die Leitfähigkeit des Bauteils einstellen und dann über Stunden halten, wodurch effektiv eine Erinnerung an jüngste visuelle Aktivität gespeichert wird. Die Transistoren reagieren in etwa 100 Mikrosekunden – schnell genug für Hochgeschwindigkeitsvideo – und überstehen Tausende von Aktualisierungszyklen ohne Verschleiß. Das Team skalierte ein einzelnes Bauteil zu einem 4×4-Array und zeigte, wie Helligkeitsänderungen der Kamera in Spannungspulse umgewandelt werden, die selektiv einige Zellen in hochleitfähige „Bewegungs“-Zustände treiben, während geringfügiges Flackern und Rauschen unterdrückt werden.

Schwere Berechnungen nur dort fokussieren, wo sie zählen

Die Ausgabe des Arrays wird in eine grobe „Heatmap“ der Bewegung umgewandelt, die kompakte Interessensregionen markiert. Statt teuren optischen Fluss auf das gesamte Bild anzuwenden, analysiert das System nur diese hervorgehobenen Bereiche, mit etwas Rand darum. Die Autorinnen und Autoren demonstrieren, dass dieser Ansatz nahtlos in mehrere gebräuchliche optische Flussmethoden integriert werden kann, von klassischen Algorithmen wie Farneback bis zu modernen Deep-Learning-Modellen wie RAFT und GMFlow. In Tests mit Autos, Drohnen, Roboterarmen und schnellen Sportarten wie Tischtennis reduziert das neuromorphe Frontend routinemäßig die Zeit für Bewegungsschätzung und Folgeaufgaben – etwa die Vorhersage der Objektbewegung, die Segmentierung bewegter Objekte vom Hintergrund oder das Tracking eines Ziels – um ungefähr das Vierfache.

Die menschliche Reaktion übertreffen, ohne Genauigkeit zu verlieren

Entscheidend ist, dass diese Beschleunigung nicht auf Kosten der Zuverlässigkeit geht. Indem zusätzliche Hinweise geliefert werden, wo Bewegung wahrscheinlich ist, verbessern die zeitlichen Signale oft die Genauigkeit, insbesondere beim Objekt-Tracking und der Segmentierung in unruhigen Szenen. In Fahrzeug- und Kleindrohnen-Szenarien verdoppelten sich die Leistungsmetriken für Aufgaben gegenüber konventionellen Pipelines, während die Gesamtverarbeitungszeiten in den Bereich von einigen zehn Millisekunden sanken – vergleichbar mit oder besser als typische menschliche Reaktionszeiten von etwa 150 Millisekunden. Die Autorinnen und Autoren argumentieren, dass dieses neuromorphe Bewegungs-Frontend mit vielen bestehenden Vision-Algorithmen koppelt werden kann und sogar über optischen Fluss hinaus mit Objektdetektoren kombiniert werden kann, um Robotern, Fahrzeugen und interaktiven Maschinen eine deutlich schnellere und gezieltere Art zu geben, dynamische Umgebungen zu verstehen.

Zitation: Wang, S., Zhao, J., Pu, T. et al. Ultrafast visual perception beyond human capabilities enabled by motion analysis using synaptic transistors. Nat Commun 17, 1215 (2026). https://doi.org/10.1038/s41467-026-68659-y

Schlüsselwörter: neuromorphe Sicht, optischer Fluss, synaptische Transistoren, Roboterwahrnehmung, autonomes Fahren