Clear Sky Science · de

Inverse-entworfene nanophotonische neuronale Netzwerkbeschleuniger für ultrakompaktes optisches Rechnen

Warum die Verkleinerung von Computern aus Licht wichtig ist

Moderne künstliche Intelligenz läuft auf umfangreicher elektronischer Hardware, die enorme Energie verbraucht und Wärme erzeugt. Diese Studie untersucht einen ganz anderen Weg: winzige Lichtmuster auf einem Chip statt Elektronenströme zur Ausführung von Teilen der Berechnungen in neuronalen Netzen zu verwenden. Die Autorinnen und Autoren zeigen, dass sich durch das „Formen" von Licht auf der Nanometerskala ultrakompakte optische Beschleuniger bauen lassen, die handgeschriebene Ziffern und medizinische Bilder erkennen, dabei deutlich weniger Platz und prinzipiell auch deutlich weniger Energie benötigen als heutige Elektronik.

Winzige Chips, die mit Licht denken

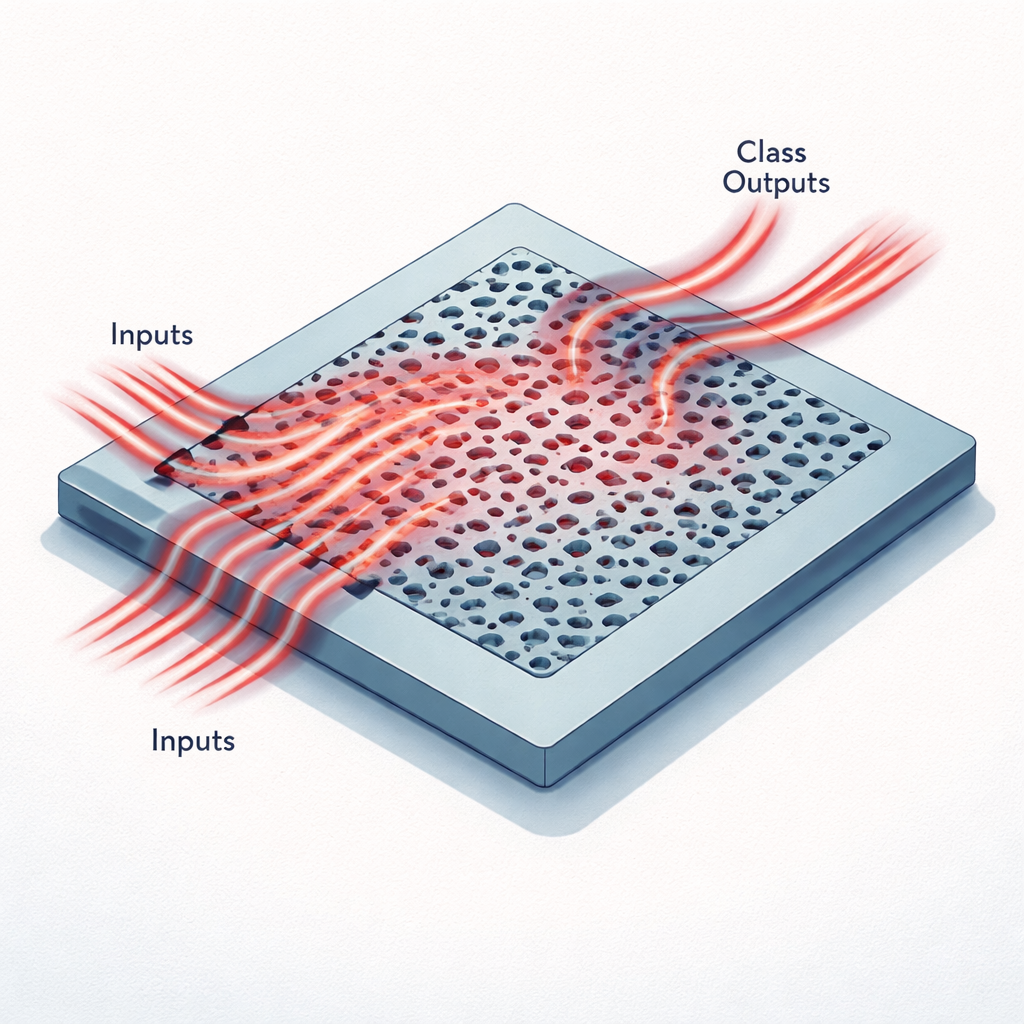

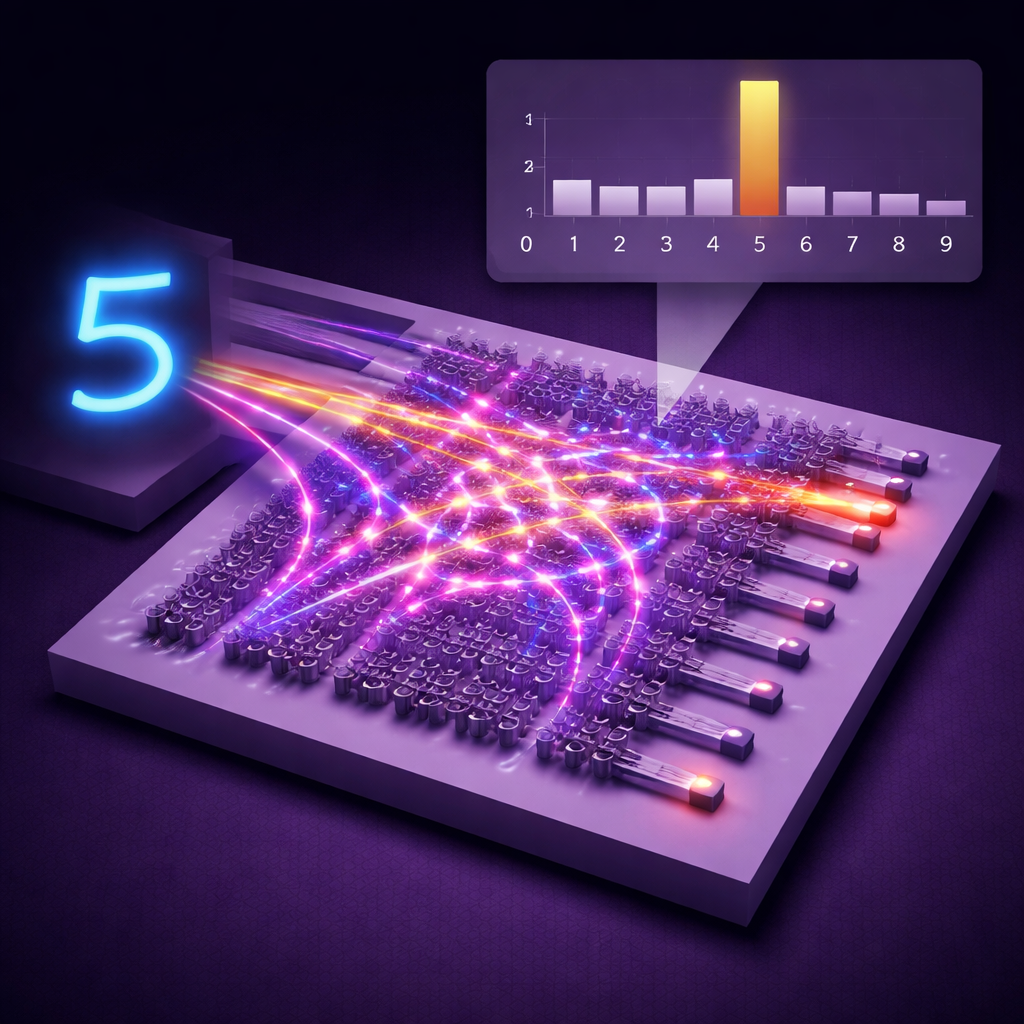

Statt Drähten und Transistoren nutzen diese Beschleuniger eine flache Siliziumscheibe mit Mustern aus Löchern und Kanälen, die kleiner sind als die Wellenlänge des Infrarotlichts. Bilddaten werden zunächst auf eine kleine Anzahl von Zahlen komprimiert, die dann als Helligkeit von Licht kodiert werden, das mehrere enge Wellenleiter bei einer einzigen Telekommunikationswellenlänge einspeist. Wenn dieses Licht in den strukturierten Bereich eintritt, wird es gestreut, interferiert mit sich selbst und wird in Richtung einiger Ausgangswellenleiter umgelenkt. Jeder Ausgang entspricht einer möglichen Klasse, etwa einer der zehn Ziffern im MNIST‑Datensatz oder einer von sechs Kategorien in einem medizinischen Bildersatz namens MedNIST. Das Muster der optischen Leistung an den Ausgängen übernimmt die gleiche Rolle wie die letzte Schicht eines digitalen neuronalen Netzes.

Algorithmen zeichnen die optische Blaupause

Eine solche Struktur von Hand zu entwerfen wäre nahezu unmöglich, weil jedes winzige „Voxel“ Material das Verhalten des Lichts verändern kann. Die Forschenden nutzen stattdessen einen inversen Entwurfsansatz: Sie beginnen mit einem zufälligen Muster aus Silizium und Glas, simulieren die dreidimensionale Ausbreitung des Lichts und passen dann das Muster an, um eine Verlustfunktion zu minimieren, die Klassifikationsfehler misst. Sie nutzen die Linearität der Maxwell‑Gleichungen—der Gesetze, die das Licht beschreiben—um das Training effizient zu gestalten. Anstatt jedes Trainingsbild einzeln zu simulieren, simulieren sie jeden Eingangskanal einmal und rekonstruieren dann die Felder für alle Bilder als Linearkombinationen dieser vorab berechneten Felder. Eine mathematische Technik, die Adjoint‑Methode, liefert exakte Gradienten, die dem Algorithmus sagen, wie jedes Voxel zu verändern ist, um die Leistung zu verbessern.

Kompakte Bildklassifikatoren auf einem Sandkorn

Mit dieser Strategie entwarf das Team zwei nanophotonische Beschleuniger auf einer standardmäßigen Silizium‑auf‑Isolator‑Plattform. Der eine, nur 20 × 20 Mikrometer groß, klassifiziert handgeschriebene Ziffern aus dem MNIST‑Datensatz; der andere, 30 × 20 Mikrometer, klassifiziert medizinische Bilder aus MedNIST. In Simulationen erzielten diese winzigen Geräte Genauigkeiten von 97,8 % bzw. 99,1 %. Gefertigte Versionen derselben Entwürfe, getestet mit echten Lasern und Detektoren, erreichten 89 % Genauigkeit für MNIST und 90 % für MedNIST—beeindruckende Werte angesichts der winzigen Chipgrößen. Die optischen Strukturen bündeln etwa 160.000 bis 240.000 trainierbare Parameter auf Flächen, die kleiner sind als ein Staubkorn, was etwa 400 Millionen Parametern pro Quadratmillimeter entspricht.

Entwickelt für Geschwindigkeit, Effizienz und Skalierbarkeit

Da die Bauteile passiv sind—während der Inferenz gibt es keine beweglichen Teile oder umprogrammierbaren Elemente—brauchen sie nach der Fertigung keine kontinuierliche Feinabstimmung. Die „Gewichte" des neuronalen Netzes sind in die Geometrie der Nanostruktur fest eingebettet, sodass die Berechnung mit Lichtgeschwindigkeit und im Wesentlichen als In‑Memory‑Verarbeitung abläuft: Licht tritt mit kodierten Daten ein und kommt bereits zu Klassenskalen gemischt wieder heraus. Die Trainingsmethode ist ebenfalls auf Skalierbarkeit ausgelegt. Jeder Optimierungsschritt erfordert nur eine feste Anzahl von Vollphysik‑Simulationen, bestimmt durch die Anzahl der Eingänge und Ausgänge, nicht durch die Größe des Datensatzes, und diese Simulationen lassen sich über mehrere Grafikprozessoren verteilen. Die Autorinnen und Autoren skizzieren außerdem, wie mehrere solcher optischer Kerne mit Fotodetektoren dazwischen gestapelt werden könnten, ähnlich den Schichten in einem tiefen neuronalen Netz, und wie Multiplexing in Wellenlänge oder Zeit den Durchsatz erhöhen könnte.

Was das für zukünftige KI‑Hardware bedeutet

Einfach ausgedrückt zeigt diese Arbeit, dass es möglich ist, maßgeschneiderte Stücke aus Glas und Silizium „wachsen" zu lassen, die wie spezialisierte Schichten neuronaler Netze funktionieren, und das alles auf einer Fläche, die klein genug ist, um Hunderte oder Tausende solcher Bausteine auf einem einzigen Chip unterzubringen. Vollständige optische Computer liegen zwar noch in der Zukunft, doch könnten diese invers entworfenennanophotonischen Beschleuniger einige der energieintensivsten Teile von KI‑Workloads von elektronischen Prozessoren verlagern. In Kombination mit schnellen Modulatoren, Detektoren und durchdachtem Systemdesign weisen sie in Richtung kompakter, energiearmer Hardware, bei der Licht statt allein Elektrizität einen Großteil der Rechenarbeit in der maschinellen Lernverarbeitung übernimmt.

Zitation: Sved, J., Song, S., Li, L. et al. Inverse-designed nanophotonic neural network accelerators for ultra-compact optical computing. Nat Commun 17, 1059 (2026). https://doi.org/10.1038/s41467-026-68648-1

Schlüsselwörter: photonische neuronale Netzwerke, Nanophotonik, optisches Rechnen, Hardwarebeschleuniger, inverse Gestaltung