Clear Sky Science · de

Das Mosaikgedächtnis großer Sprachmodelle

Warum Near‑Miss‑Kopien wichtig sind

Große Sprachmodelle wie ChatGPT lernen aus Ozeanen von Texten und merken sich dabei gelegentlich Teile dieses Materials. Das wirft Bedenken hinsichtlich Privatsphäre, Urheberrecht und der Fairness bei der Bewertung dessen auf, was diese Systeme tatsächlich wissen. Diese Studie zeigt, dass Memorierung nicht nur reines Copy‑and‑Paste ist. Stattdessen können Sprachmodelle Textstellen aus vielen leicht unterschiedlichen Versionen rekonstruieren, ähnlich wie beim Zusammensetzen eines Mosaiks. Das Verständnis dieser verborgenen Form des Gedächtnisses ist entscheidend für alle, denen sichere und verlässliche KI am Herzen liegt.

Eine neue Sicht auf maschinelles Gedächtnis

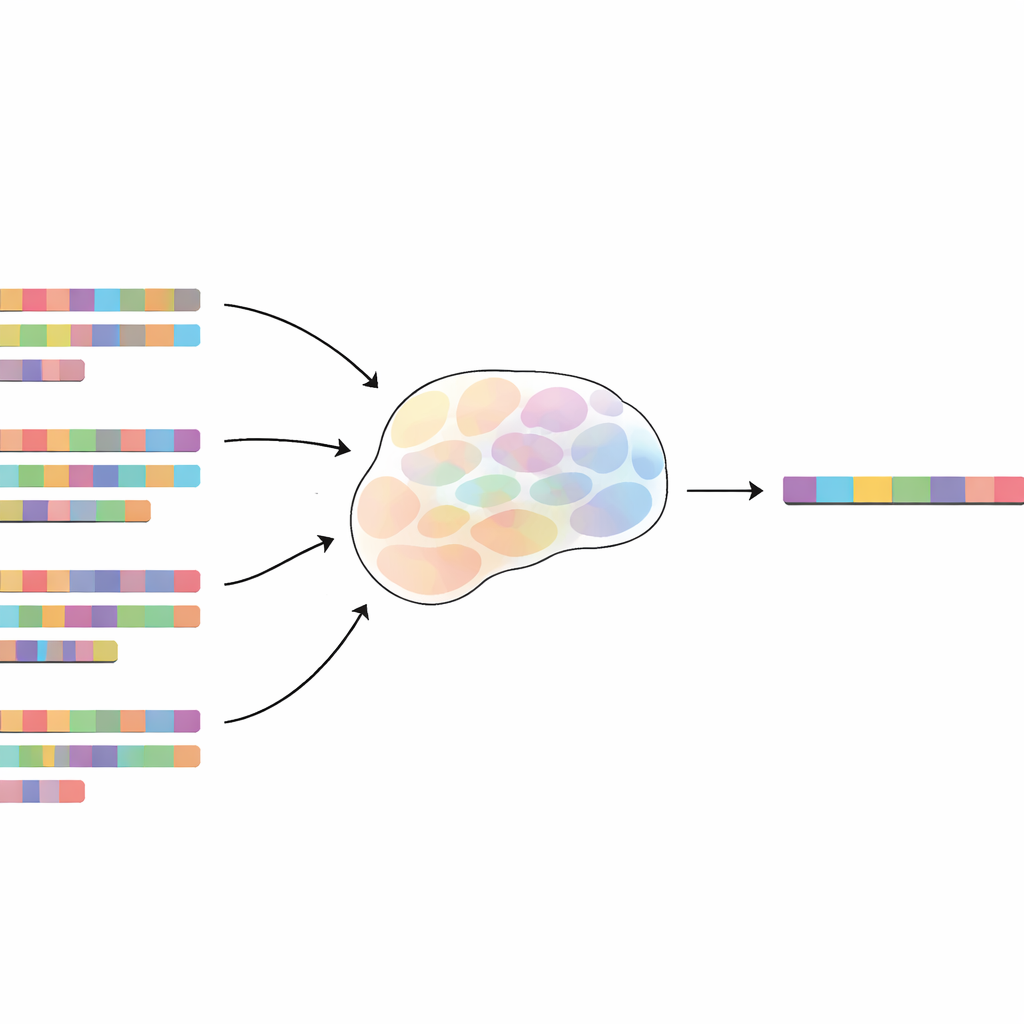

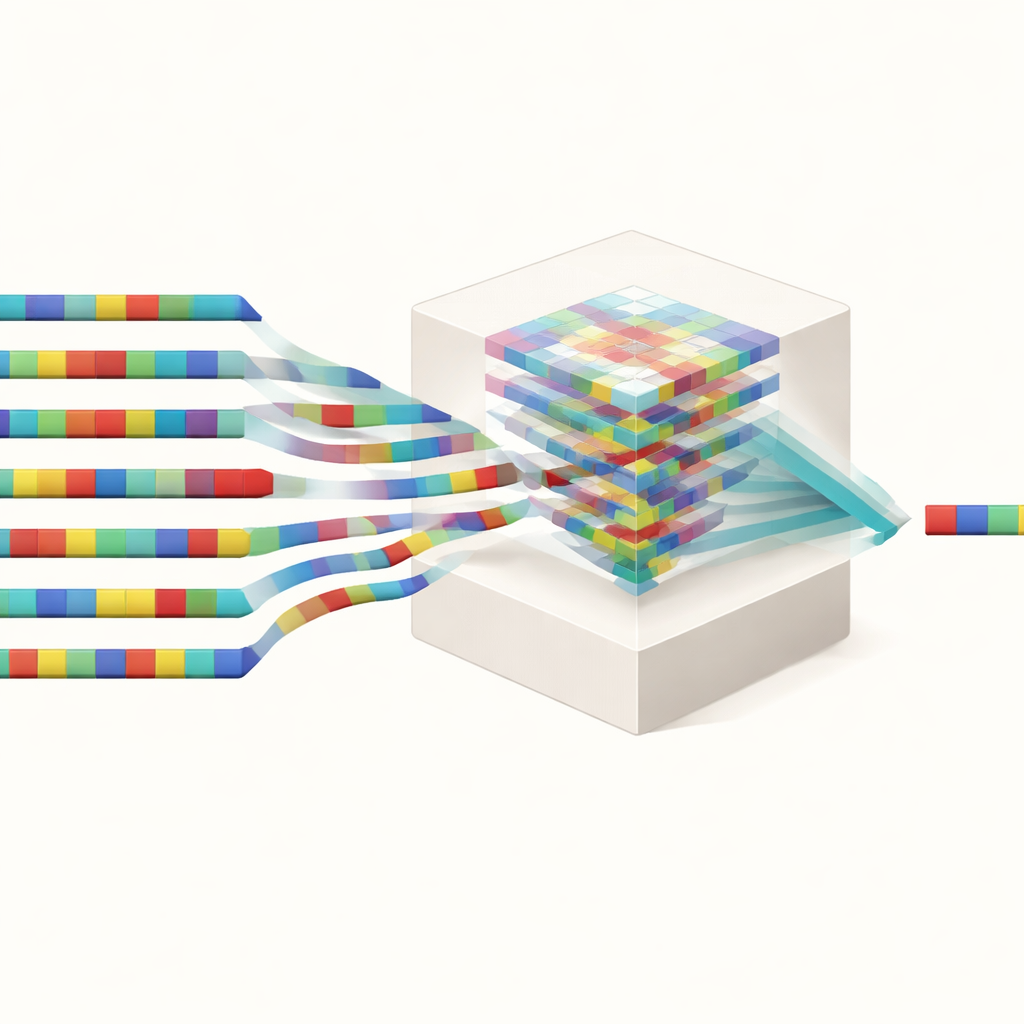

Die meisten gehen davon aus, dass ein Sprachmodell etwas nur dann memorisiert, wenn es denselben Satz immer wieder genau sieht. Die Autoren stellen diese Sichtweise infrage und führen den Begriff „Mosaikgedächtnis“ ein. Nach diesem Modell kann ein System eine 100‑Wörter‑Passage nicht nur aus exakten Wiederholungen lernen, sondern auch aus vielen fuzzy Duplikaten—Versionen, in denen einzelne Wörter fehlen, verändert oder durcheinandergebracht sind. Um das systematisch zu untersuchen, pflanzen sie künstliche Testphrasen, sogenannte Kanarienvögel, in die Trainingsdaten eines Modells und fügen zahlreiche veränderte Varianten hinzu. Nach dem Training messen sie, wie leicht sich feststellen lässt, ob ein bestimmter Kanarienvogel im Trainingssatz war, mithilfe eines Datenschutztests namens Membership‑Inference‑Attack.

Wie fuzzy Kopien dennoch eine deutliche Spur hinterlassen

Indem sie fuzzy Duplikate mit exakten Wiederholungen vergleichen, definieren die Forschenden ein „exaktes‑Duplikat‑Äquivalent“: wie viel ein fuzzy Exemplar zur Memorierung beiträgt im Vergleich zu einer perfekten Kopie. Sie stellen fest, dass selbst sehr milde Änderungen die Memorierung kaum schwächen. Wenn in jeder Duplikatversion nur etwa 10 % der Wörter zufällig ersetzt werden, trägt eine einzelne fuzzy Kopie immer noch ungefähr 60–65 % so viel bei wie eine exakte Wiederholung. Selbst wenn die Hälfte der Wörter verändert ist, zählt jede veränderte Version weiterhin etwa 15–20 % einer vollen Kopie. Der Effekt ist robust: Das Einfügen zufälliger Füllwörter zwischen Schlüsselphrasen oder das Durcheinanderbringen von Satzabschnitten verringert die Memorierung, beseitigt sie aber nicht. Das Modell scheint in der Lage, Lärm zu überspringen, sich auf überlappende Fragmente zu konzentrieren und diese wieder zusammenzusetzen.

Form statt Bedeutung in dem, was Modelle speichern

Angesichts der Fähigkeit moderner Sprachmodelle, Mathematikaufgaben zu lösen, Anweisungen zu folgen und zwischen Sprachen zu übersetzen, könnte man erwarten, dass ihre Erinnerungen sich auf Bedeutung beziehen. Überraschenderweise findet die Studie das Gegenteil. Wenn die Autoren Wörter durch Alternativen ersetzen, die die Bedeutung des Satzes erhalten, verbessert das die Memorierung nur geringfügig gegenüber dem Ersetzen durch zufällige Wörter. Paraphrasen, die von anderen KI‑Systemen erzeugt wurden—welche dieselbe Idee bewahren, aber viele Oberflächendetails verändern—tragen relativ wenig zur Memorierung bei, es sei denn, sie teilen weiterhin viele kurze Wortfolgen mit der Originalpassage. In einer Reihe von Tests treibt vor allem die Überlappung in den exakten Tokens (den grundlegenden Wortstücken des Modells) das Gedächtnis an, nicht geteilte Ideen. Anders gesagt: Das Mosaikgedächtnis des Modells bezieht sich hauptsächlich auf Form, nicht auf Bedeutung.

Verborgene Duplikate in realen Trainingsdaten

Die Autoren fragen dann, wie häufig fuzzy Duplikate in einem populären, stark bereinigten Webdatensatz sind, der zum Training von Sprachmodellen verwendet wird und als SlimPajama bekannt ist. Obwohl dieser Datensatz bereits nahezu identische Dokumente entfernt hat, finden die Forschenden, dass viele 100‑Token‑Sequenzen, die genau 1.000‑mal vorkommen, auch Tausende von Near‑Miss‑Versionen haben. Bei kleinen Editierabständen—etwa 10 % veränderter Zeichen—gibt es im Mittel etwa viermal so viele fuzzy Duplikate wie exakte, und bei größeren, aber weiterhin einflussreichen Abständen Zehntausende mehr. Wichtig ist: Industriell übliche Deduplikationsverfahren, die typischerweise nur lange exakte Überlappungen entfernen, lassen die meisten dieser fuzzy Kopien unangetastet. Das bedeutet, dass Modelle sensible oder urheberrechtlich geschützte Inhalte trotzdem aus vielen leicht veränderten Quellen zusammensetzen können.

Warum das für Privatsphäre, Fairness und Kontrolle wichtig ist

Diese Ergebnisse haben weitreichende Folgen. Für die Privatsphäre zeigen sie, dass das einfache Entfernen exakter Wiederholungen aus Trainingsdaten nicht ausreicht: Persönliche oder vertrauliche Informationen können über Familien ähnlicher Passagen memoriert werden. Für Urheberrecht und Benchmarking können fuzzy Duplikate dazu führen, dass Modelle geschützten Text reproduzieren oder auf Tests künstlich besser abschneiden, die sie faktisch in verschleierter Form gesehen haben. Für Bemühungen, bestimmte Daten „verlernen“ zu lassen, reicht es nicht aus, ein einzelnes beanstandetes Beispiel zu löschen, wenn viele Varianten verbleiben. Insgesamt offenbart die Studie, dass das Gedächtnis von Sprachmodellen ein komplexes Mosaik aus vielen kleinen Überlappungen ist—eine Herausforderung für heutige Sicherheitstools und ein Aufruf zu intelligenteren, feineren Methoden zur Bereinigung und Prüfung von Trainingsdaten.

Zitation: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Schlüsselwörter: Memorisierung von Sprachmodellen, fuzzy Duplikate, Datenschutz, Deduplikation von Trainingsdaten, Benchmark‑Kontamination