Clear Sky Science · de

Modell‑agnostisches, linear‑speicher‑Online‑Lernen in spikenden neuronalen Netzen

Warum das Training gehirnähnlicher Rechner so schwierig ist

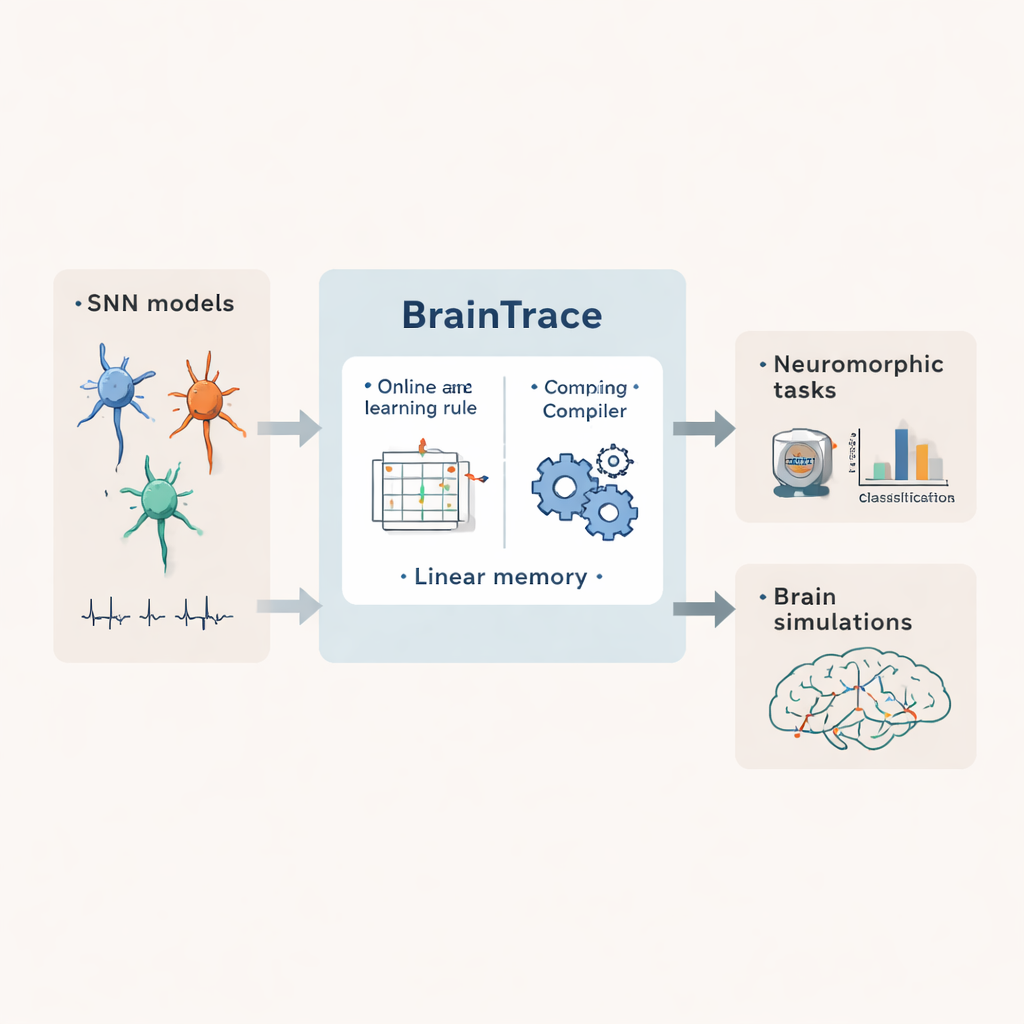

Spikende neuronale Netze sind eine Klasse künstlicher Netze, die sich über kurze elektrische Pulse verständigen – ähnlich wie echte Gehirnzellen. Sie versprechen hocheffiziente, vom Gehirn inspirierte Rechnungen und realistischere Simulationen neuronaler Schaltkreise. Aber diesen Netzen komplexe Aufgaben beizubringen, insbesondere über lange Zeiträume, erfordert meist enorme Mengen an Computerspeicher und viel maßgeschneiderten Code. Dieser Artikel stellt BrainTrace vor, ein System, das das Training spikender Netze praktisch und allgemein nutzbar machen soll.

Netze lehren, die in Echtzeit lernen

Die leistungsfähigsten Trainingsmethoden für gehirnähnliche Netze arbeiten, indem sie eine gesamte Aktivitätssequenz wiederholen und Fehlersignale rückwärts über jeden Zeitschritt propagieren. Dieser Ansatz, bekannt als Backpropagation Through Time, kann sehr genau sein, stößt aber schnell an Grenzen, wenn Sequenzen lang oder Netze groß sind: Jeder Zwischenzustand muss gespeichert werden, sodass der Speicherbedarf mit der Zeit und der Netzgröße wächst. Alternative „Online“-Methoden aktualisieren Verbindungen Schritt für Schritt, während Daten hereinkommen, was den Speicherbedarf stark reduziert. Bestehende Online‑Regeln funktionieren allerdings entweder nur für stark vereinfachte Neuronenmodelle oder verlangen weiterhin Speicher, der quadratisch mit der Netzgröße wächst, was den Einsatz für realistische, gehirnweite Systeme erschwert.

Ein allgemeines Rezept für viele Arten spikender Netze

BrainTrace begegnet dem Problem, indem es spikende Netze zunächst einheitlich beschreibt. Die Autorinnen und Autoren zeigen, dass viele Neuronen‑ und Synapsentypen als zwei miteinander wechselwirkende Teile dargestellt werden können: interne Dynamiken, die beschreiben, wie sich der Zustand jedes Neurons über die Zeit ändert, und Interaktionsdynamiken, die eingehende Spikes in Ströme zwischen Zellen umsetzen. Zudem führen sie zwei Modellierungsansichten ein, genannt AlignPre und AlignPost, die Synapsen entweder um das sendende Neuron oder das empfangende Neuron herum organisieren. Diese Abstraktion erlaubt es, eine große Bandbreite biologischer und technischer Modelle mit derselben mathematischen Mechanik zu behandeln – von einfachen leaky Neuronen bis zu komplexeren Zellen mit adaptiven Schwellen und vielschichtigen Synapsen.

Ein speicherschonender Weg, Ursache und Wirkung nachzuverfolgen

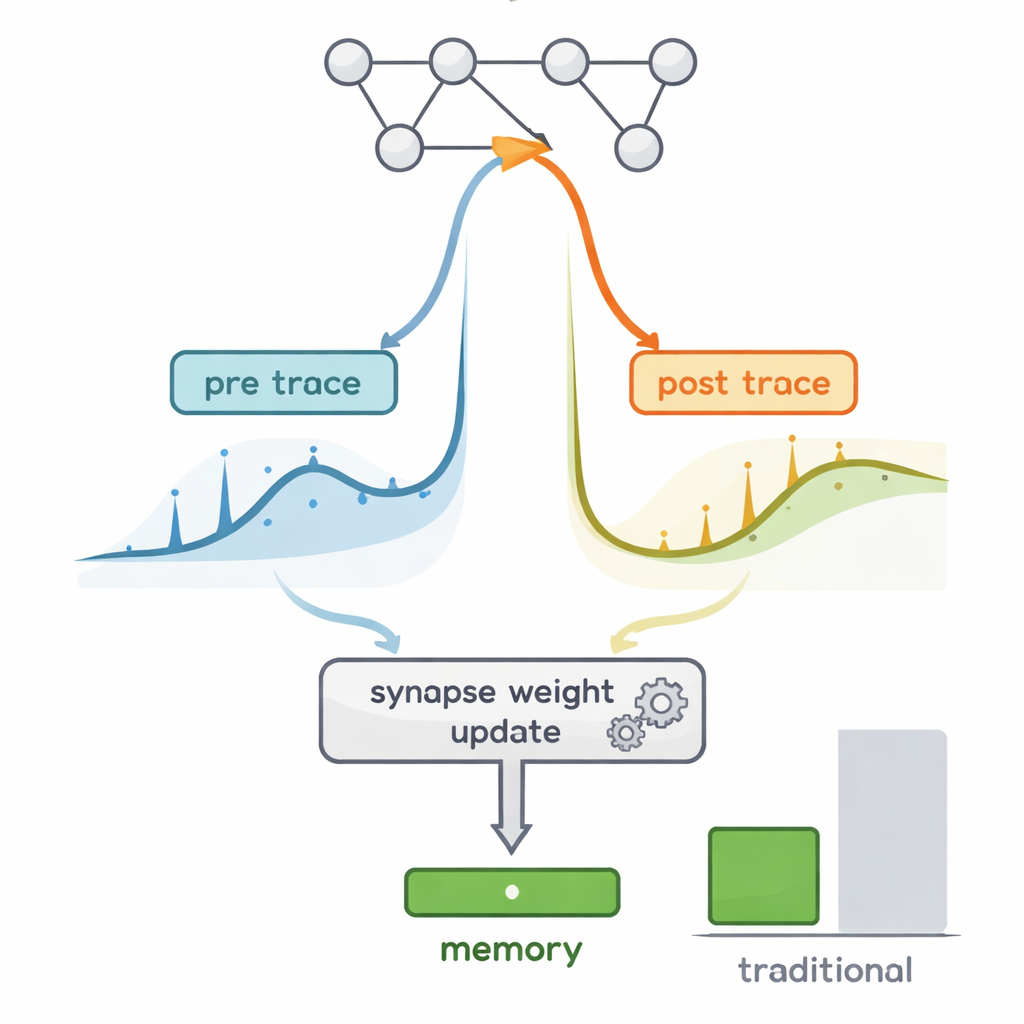

Die zentrale Herausforderung beim Online‑Lernen besteht darin nachzuverfolgen, wie kleine Änderungen an jeder Verbindung sich schließlich auf das Verhalten des Netzes auswirken – eine Größe, die durch sogenannte „Eligibility Traces“ erfasst wird. Prinzipiell erfordert das vollständige Verfolgen dieser Eligibilities das Mitführen riesiger Matrizen, deren Größe mit der dritten Potenz der Neuronenzahl skaliert. BrainTrace nutzt drei Schlüsseleigenschaften spikender Netze: Die meisten Neuronen sind die meiste Zeit stumm; das Leck und Reset eines Neurons dominieren dessen Zustandsänderungen; und Spike‑ sowie synaptische Leitfähigkeiten sind stets positiv. Mithilfe dieser Fakten zeigen die Autorinnen und Autoren, dass die schweren Eligibility‑Matrizen gut durch das Produkt von nur zwei kompakten Spuren pro Synapse angenähert werden können – eine fasst präsynaptische Aktivität zusammen, die andere postsynaptische Aktivität. Diese Prä‑Post‑Propagation‑Regel, pp‑prop genannt, verwendet Speicher, der nur linear mit der Netzgröße wächst, und liefert dennoch Gradienten, die gut mit denen vollständiger Backpropagation übereinstimmen.

Automatische Werkzeuge, die die Mathematik verbergen

Über die Lernregel hinaus stellt BrainTrace einen Compiler bereit, der eine ähnliche Rolle spielt wie automatische Differenzierungsbibliotheken im Deep Learning. Nutzerinnen und Nutzer beschreiben die Dynamik ihres spikenden Modells in einer hochstufigen Sprache. Der BrainTrace‑Compiler analysiert dann, wie Zustände und Parameter verknüpft sind, konstruiert die notwendigen Eligibility‑Spuren und erzeugt optimierten Code, der pp‑prop oder verwandte Algorithmen effizient auf CPUs, GPUs oder spezialisierten Beschleunigern ausführt. Das bedeutet, Modellierende können sich auf wissenschaftliche Fragen konzentrieren, statt empfindlichen Gradienten‑Code per Hand zu schreiben, und profitieren gleichzeitig von online‑fähigem, speichereffizientem Lernen.

Von winzigen Sensoren bis zum ganzen Fliegenhirn

Die Autorinnen und Autoren testen BrainTrace an gängigen neuromorphen Benchmarks, bei denen spikende Netze ereignisbasierte Versionen von Bildern, Geräuschen und Gesten klassifizieren. Über mehrere Datensätze und Architekturen hinweg erreicht pp‑prop die Genauigkeit vollständiger Backpropagation, verwendet dabei aber um viele Größenordnungen weniger Speicher und läuft schneller als andere Online‑Methoden. Entscheidend ist, dass das System auch auf anspruchsvolle neurowissenschaftliche Probleme skaliert. In einem Beispiel lernt ein biologisch detailliertes spikendes Netz mit getrennten exzitatorischen und inhibitorischen Populationen eine Entscheidungsaufgabe zur Evidenzakkumulation und entwickelt Aktivitätsmuster, die denen in der Maus‑Rinde ähneln. In einem anderen Beispiel wird ein spikendes Modell mit mehr als 125.000 Neuronen, verdrahtet nach dem Konnektom der Fruchtfliege, so trainiert, dass es Ruhe‑Aktivität über das gesamte Fliegenhirn reproduziert – eine Aufgabe, die den Speicherbedarf konventionellen Trainings auf einer einzelnen Grafikkarte übersteigt.

Was das für die Zukunft gehirnähnlicher Rechner bedeutet

Für Nicht‑Expertinnen und Nicht‑Experten lautet die Kernbotschaft: BrainTrace macht aus einem einst unpraktischen Traum – das Echtzeit‑Training reichhaltiger, gehirnweiter spikender Netze – eine realistische Möglichkeit. Indem es einen cleveren Weg findet, Ursache und Wirkung mit nur geringem Speicheraufwand nachzuvollziehen, und dies in automatisierte Werkzeuge einbettet, rückt die Arbeit gehirninspirierte Rechner näher an den Alltagsgebrauch in KI und Grundlagenneurowissenschaften. Sie weist einen Pfad zu Maschinen, die mit der Effizienz und zeitlichen Präzision realer Nervensysteme lernen und sich anpassen, ohne Supercomputer‑ähnliche Ressourcen zu verlangen.

Zitation: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Schlüsselwörter: spikende neuronale Netze, Online‑Lernen, neuromorphe Berechnung, Gehirnsimulation, gradientenbasierte Schulung