Clear Sky Science · de

KI‑gestützte Merkmalserkennung von REM‑Profilen beim Deep Reactive Ion Etching basierend auf physik‑beschränktem variationalem Autoencoder

Scharfere Chips durch intelligentere Bildgebung

Jedes Smartphone, jeder Airbag‑Sensor im Auto und jede medizinische Mikronadel hängt von winzigen, dreidimensionalen Strukturen ab, die tief in Silizium eingearbeitet sind. Diese Merkmale sauber, glatt und reproduzierbar herzustellen ist schwierig — und ihre Qualität unter einem Elektronenmikroskop zu prüfen ist noch anspruchsvoller. Dieser Artikel stellt ein neues KI‑Werkzeug vor, das diese mikroskopischen Bilder automatisch und deutlich genauer als Menschen auswerten kann und so schnellere, günstigere und verlässlichere Produktion fortschrittlicher Mikrosysteme verspricht.

Warum das Ätzen tiefer, winziger Rillen so knifflig ist

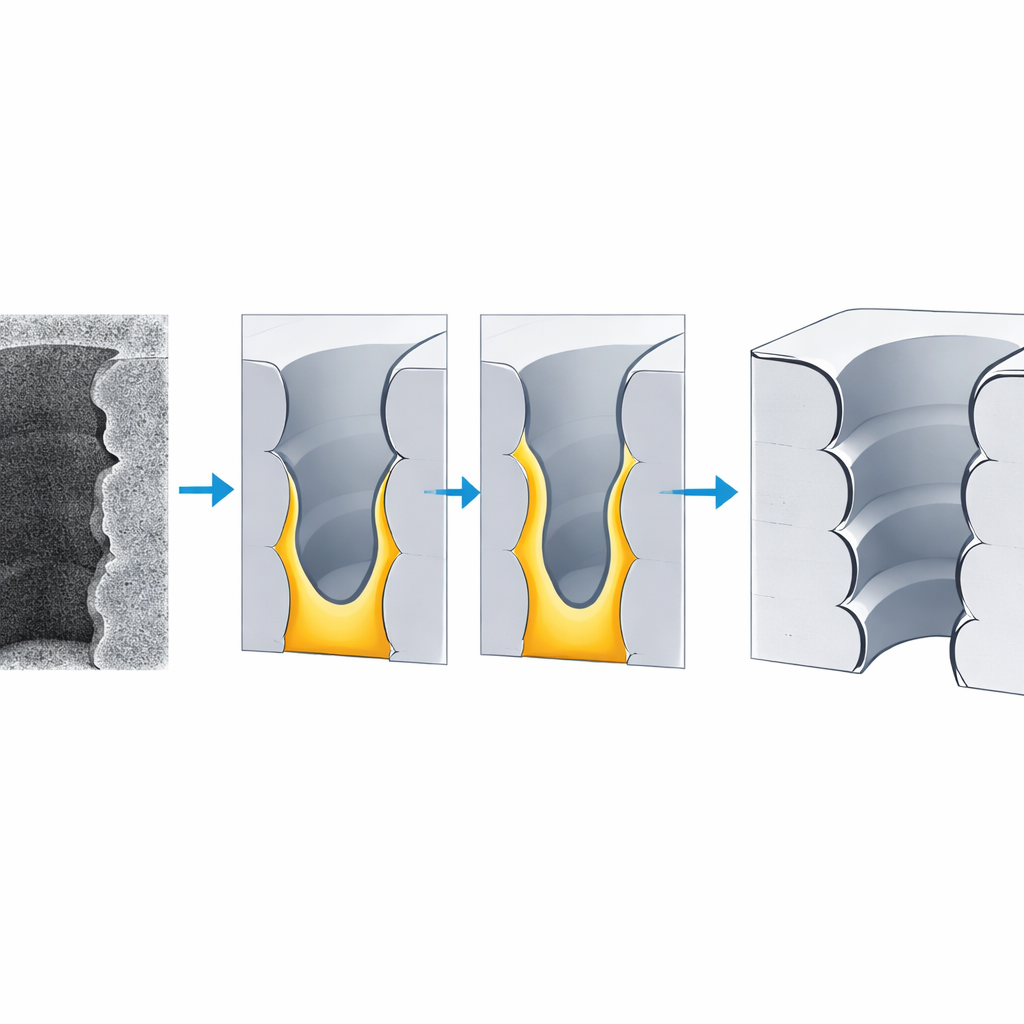

Moderne mikroelektromechanische Systeme (MEMS) basieren auf tiefen, schmalen Gräben, die mithilfe des Verfahrens Deep Reactive Ion Etching in Silizium geätzt werden. Ingenieure wünschen sich annähernd senkrechte, glatte Wände, doch in der Praxis bilden die Seitenwände Wellen, Ausbeulungen und andere Verzerrungen, weil das Plasma zwischen Abtrags‑ und Schutzzyklen wechselt. Kleine Änderungen in Timing, Gasfluss, Temperatur oder im Alter des Werkzeugs können aus einem guten Rezept ein schlechtes machen — diese Änderungen zeigen sich als subtile Unterschiede im Grabenprofil, die nur in REM‑Querschnitten sichtbar sind.

Der Engpass: menschliche Bildauswertung

Heute ist die Bewertung dieser geätzten Strukturen größtenteils Handwerk. Ingenieure schneiden Wafer, machen Hunderte von REM‑Aufnahmen und zeichnen dann mühsam Kanten nach und messen Tiefen und Breiten am Computer. Die Analyse eines Bildes kann eine Stunde oder länger dauern, und verschiedene Personen weichen oft um 15–20 Prozent voneinander ab. Einfache automatische Methoden und frühere Machine‑Learning‑Werkzeuge wie klassische neuronale Netze können beschleunigen, haben aber bei den typischen verrauschten, kontrastarmen Bildern tiefer Gräben Schwierigkeiten und übersehen häufig, wie sich die Struktur mit der Tiefe ändert. Daher ist die Bildanalyse zu einem ernsthaften Flaschenhals für die Massenfertigung und für den Einsatz von KI zur Optimierung des Ätzprozesses geworden.

Eine KI, die die Physik respektiert

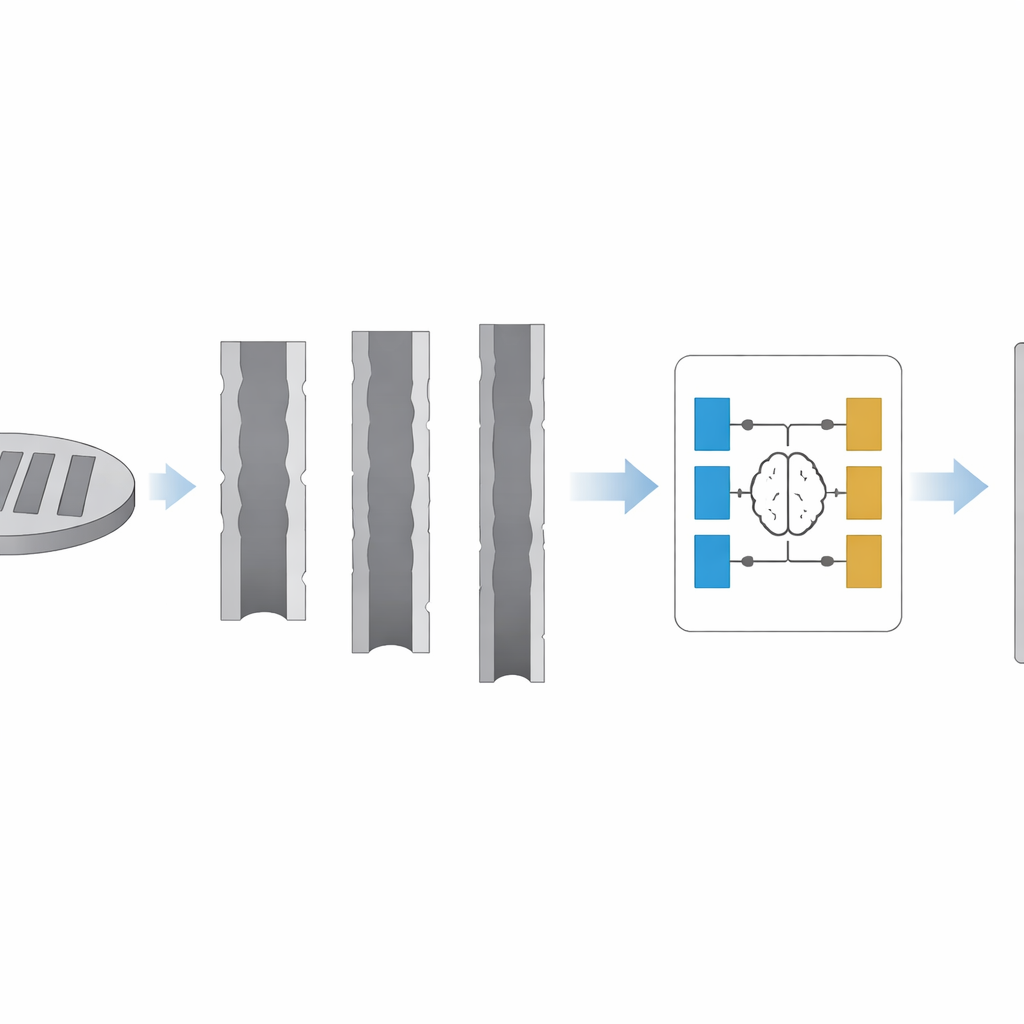

Die Autoren schlagen einen neuen Ansatz vor, genannt physik‑beschränkter variationaler Level‑Set‑Autoencoder, oder VLSet‑AE. Im Kern „komprimiert“ dieses KI‑System ein REM‑Bild in einen kompakten internen Code und „baut“ daraus die Form des Grabens wieder auf. Anstatt die Grabenkante als bloße Ansammlung heller Pixel zu behandeln, modelliert es die Grenzfläche als bewegtes Interface, das nach außen wächst, bis es auf das reale Material trifft — ähnlich einer sich ausdehnenden Blase, die an den Wänden stoppt. Die Bewegung dieses Interfaces wird durch Gleichungen gesteuert, die beschreiben, wie eine geätzte Oberfläche sich tatsächlich im Laufe der Zeit entwickelt, sodass die KI nicht nur von Daten, sondern auch von bekannter Ätzphysik geleitet wird.

Den gesamten Graben in Raum und Zeit sehen

Um das System zu trainieren und zu testen, entwarf das Team eine sorgfältige Reihe von 16 Ätzrezepten, variierte die Schlüsseltaktzeiten, die steuern, wie lange das Plasma abträgt und wie lange es schützt, und sammelte 1.000 REM‑Querschnittsbilder. Jedes Grabenbild wurde entlang seiner Tiefe in viele dünne Schichten unterteilt, die jeweils einen Ätz‑und‑Beschichtungszyklus repräsentieren. VLSet‑AE verfolgt, wie sich die Kontur Schicht für Schicht entwickelt, und fügt diese Scheiben dann wieder zu einer vollständigen dreidimensionalen Ansicht zusammen. Daraus berechnet es automatisch neun entscheidende Messgrößen: Tiefe und Breite der Wellen an der Wand, den lokalen Krümmungsradius, wie senkrecht das Profil ist, die Grabenbreite oben, in der Mitte und unten sowie die Gesamttiefe und das Durchbiegen der Wände.

Schneller, genauer und fabrikbereit

Im Vergleich mit manuellen Messungen und sieben anderen gängigen KI‑Modellen liegt VLSet‑AE vorn. Im Schnitt weicht es von manuellen Messungen nur um etwa 3,7 Prozent ab — besser als die Variation Mensch‑zu‑Mensch — und erreicht eine Gesamterkennungsgenauigkeit von rund 94–96 Prozent. Es ist zudem effizient: Das Training auf dem vollständigen Datensatz dauert im Bereich von einigen Dutzend Sekunden, und die Auswertung eines neuen Bildes nimmt etwa eine Sekunde in Anspruch. Selbst bei weniger Trainingsbildern verschlechtert sich die Genauigkeit nur geringfügig, was zeigt, dass das System mit begrenzten Daten zurechtkommt — eine häufige Situation in der High‑End‑Fertigung.

Was das für Alltags‑Technik bedeutet

Einfach ausgedrückt verwandelt diese Arbeit die REM‑Inspektion von einer handwerklichen in eine industrielle Aufgabe. Indem VLSet‑AE feine Strukturdetails aus verrauschten Mikroskopbildern automatisch und zuverlässig liest, macht es praktikabel, die großen Datenmengen zu sammeln, die nötig sind, damit KI Ätzrezepte in Echtzeit abstimmt und überwacht. Das kann zu glatteren Gräben, präziseren Sensoren und konsistenteren Chips führen — alles mit weniger Versuch‑und‑Irrtum und geringeren Kosten. Die Methode bietet zudem eine allgemeine Blaupause dafür, wie sich Physik und maschinelles Lernen kombinieren lassen, um andere komplexe Fertigungsschritte zu verstehen, und weist auf eine Zukunft hin, in der Mikro‑ und Nano‑Bauteile in eng integrierten, KI‑gesteuerten Fabriken entworfen und perfektioniert werden.

Zitation: Wang, F., Yu, H., Miao, Y. et al. AI-driven feature recognition of SEM profiles in deep reactive ion etching based on physics-constrained variational autoencoder. Microsyst Nanoeng 12, 82 (2026). https://doi.org/10.1038/s41378-025-01105-z

Schlüsselwörter: deep reactive ion etching, rasterelektronenmikroskopie, physik‑informierte KI, variationaler Autoencoder, Mikrofabrikation