Clear Sky Science · de

Doppeltphasige Metaflächen-Operatoren für rein optische Bildverarbeitung

Warum winzige Lichtchips für unsere digitale Welt wichtig sind

Jedes Foto, das wir machen, jedes Video, das wir streamen, oder jede medizinische Aufnahme, die wir analysieren, muss verarbeitet werden – meist von energieintensiven elektronischen Chips. Da unsere Nachfrage nach bildintensiven Aufgaben wächst, von Telefonkameras über selbstfahrende Autos bis hin zu maschinellem Sehen, stoßen traditionelle Elektroniklösungen an Grenzen in Geschwindigkeit und Energieverbrauch. Diese Arbeit zeigt, wie ein ultradünnes optisches „Chip“-Element, eine Metafläche, Bilder allein mit Licht verarbeiten kann und Aufgaben wie Kantenerkennung und Mustenerkennung nahezu sofort ausführt, ganz ohne aufwändige digitale Berechnung.

Licht als Rechner nutzen

Konventionelle Computer verarbeiten Bilder, indem sie Licht in elektronische Signale umwandeln und dann Pixel für Pixel rechnen. Dieser Ablauf verschwendet Zeit und Energie, insbesondere wenn Bilder in Echtzeit analysiert werden müssen. Im Gegensatz dazu tragen Lichtwellen von Natur aus reichhaltige räumliche Informationen, und Linsen können diese Informationen so umordnen, dass sie mathematischen Operationen ähneln. Das Problem war bisher, dass optische Systeme, die ernsthafte Bildverarbeitung leisten, typischerweise sperrig sind – denken Sie an Labortische voller Linsen und Spiegel – und oft nur für eine einzelne Aufgabe ausgelegt sind. Die Autoren gehen dieses Problem an, indem sie den gesamten Prozessor auf eine flache, millimetergroße Fläche aus nanoskaligen Strukturen zusammenschrumpfen, die Licht mit außerordentlicher Präzision lenken können.

Ein flaches Chip, das Bilder umformt

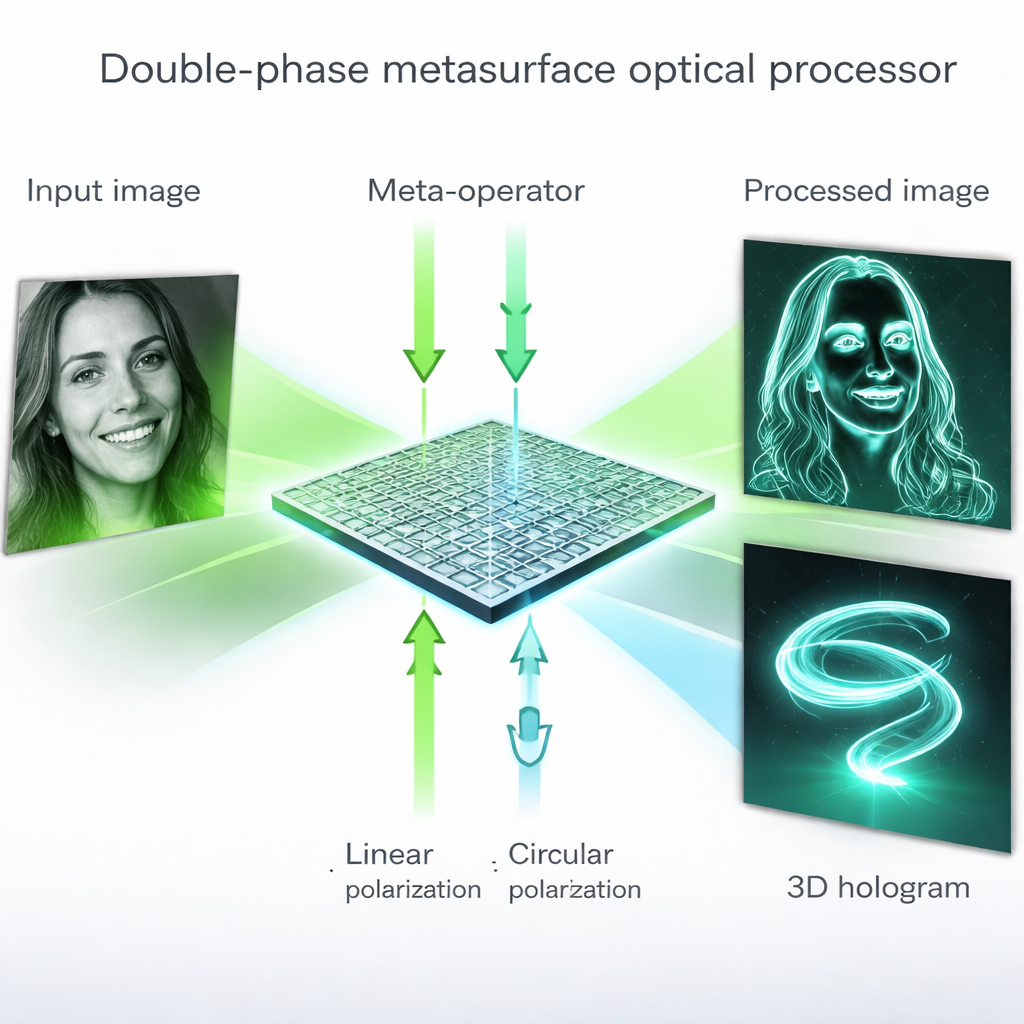

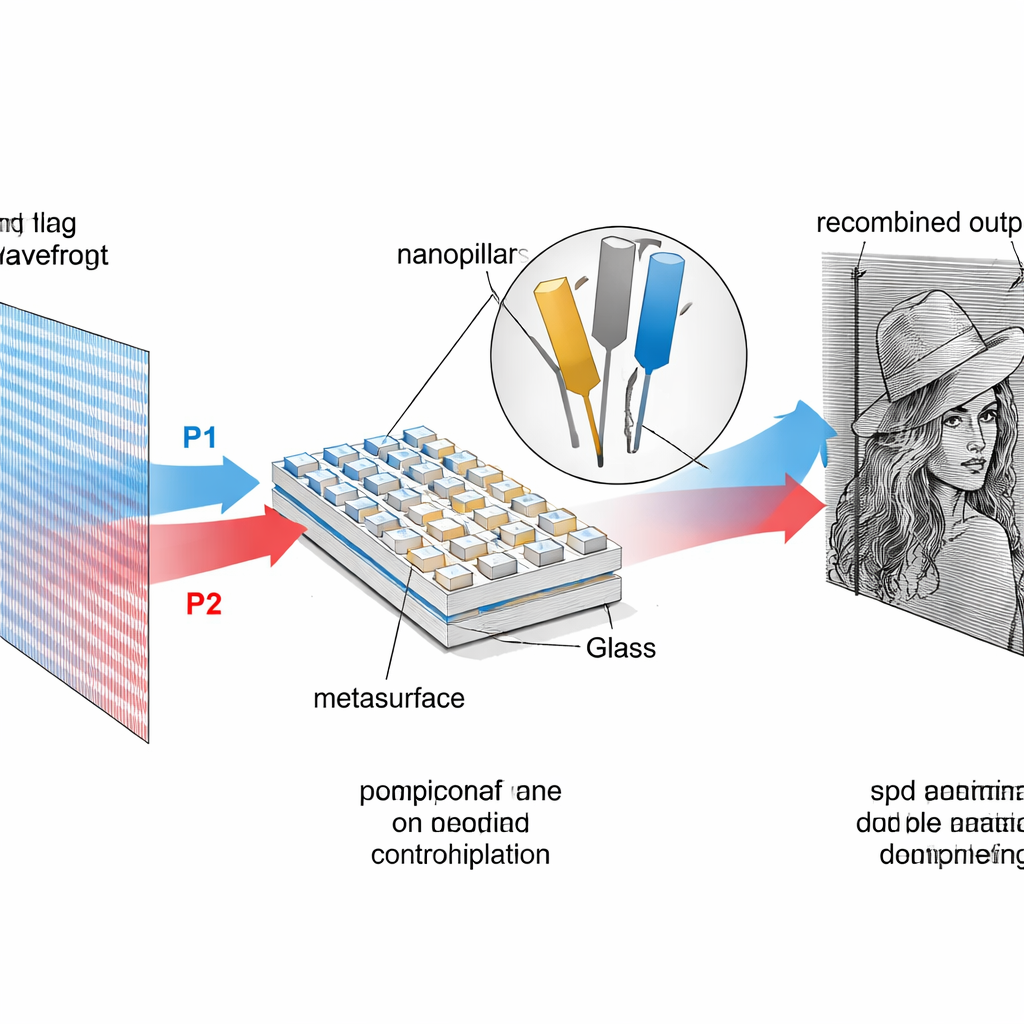

Kern der Arbeit ist ein „Meta-Operator“: eine einlagige Metafläche, die mit Millionen aus Titandioxid gefertigten Nanopfeilern gemustert ist, die jeweils kleiner als die Wellenlänge des sichtbaren Lichts sind. Durch die sorgfältige Wahl von Größe und Orientierung dieser winzigen Pfeiler steuert das Team, wie verschiedene Polarisationszustände des Lichts – im Wesentlichen verschiedene Schwingungsarten des elektrischen Felds – beim Durchgang spezifische Phasenverzögerungen aufnehmen. Sie verwenden eine clevere Strategie namens Doppelphasen-Codierung, bei der eine gewünschte Bildtransformation in zwei rein phasenbasierte Muster zerlegt wird, die zwei Polarisationskanälen zugewiesen werden. Wenn diese Kanäle wieder zusammengeführt werden, rekonstruieren sie die vollständige, komplexe Transformation, die normalerweise sperrige Optiken oder digitale Verarbeitung erfordern würde.

Kanten, Ecken und verborgene Muster mit Licht finden

Mit dieser Plattform zeigen die Forscher experimentell eine Reihe grundlegender Bildverarbeitungsoperationen, die normalerweise in Software ausgeführt werden. Mit einem Polarisationsschema führt die Metafläche eine Differentiation erster Ordnung durch, die Kanten in einer Richtung oder in allen Richtungen hervorhebt und Grenzen in Balken- und Speichenmustern klar herausstellt. Mit weiter entwickelten Designs werden Differentiationen zweiter Ordnung möglich, die Ecken und subtile Krümmungsänderungen erkennen und Details in Mustern wie einem chinesischen Schriftzeichen schärfen. Derselbe Ansatz lässt sich auf Kreuzkorrelation anwenden, ein Werkzeug zur Mustererkennung: Metaflächen, die für die Buchstaben T, A und U entworfen wurden, können ein Eingangsbild mit dem Wort „TAU“ scannen und dafür sorgen, dass nur der passende Buchstabe als helle Stelle aufleuchtet, wodurch das Zielmuster mit Lichtgeschwindigkeit erkannt wird.

Von flachen Chips zu 3D-Hologrammen

Über Bildfilterung hinaus können dieselben Metaflächenprinzipien Licht im dreidimensionalen Raum formen, um komplexe Hologramme zu erzeugen. Die Autoren bauen ein „Meta-Hologram“, das eine Spirale heller Punkte rekonstruiert, die sich über nahezu einen Millimeter Tiefe erstreckt, mit Schichten, die nur wenige Mikrometer auseinanderliegen. Durch die Codierung unterschiedlicher Polarisationszustände mit sorgfältig berechneten Phasenmustern steuert das dünne Bauteil nicht nur, wo Licht in einer Ebene erscheint, sondern wie es in einem kleinen Volumen des Raums verteilt ist. Die Experimente zeigen eine enge Übereinstimmung mit den numerischen Entwürfen und bestätigen, dass diese flachen optischen Chips hochaufgelöste volumetrische Hologramme bei sichtbaren Wellenlängen liefern können.

Was das für die Alltagstechnik bedeutet

Die Studie demonstriert, dass ein einziges, passives, ultradünnes optisches Element mehrere Bildverarbeitungsaufgaben ausführen und komplexe 3D-Hologramme erzeugen kann – alles mithilfe von Licht als Rechenmedium. Für den Laien lautet die Schlussfolgerung, dass künftige Kameras, Mikroskope und Displays solche Metaflächen enthalten könnten, um Bilder vorzubereiten, Merkmale zu erkennen oder tiefenreiche Visualisierungen zu erzeugen, bevor die Daten überhaupt einen elektronischen Chip erreichen. Das könnte schnellere, energieeffizientere Geräte ermöglichen – für Anwendungen von medizinischer Bildgebung und autonomer Navigation bis hin zu holografischen Displays und dichter optischer Datenspeicherung – und ebnet den Weg für intelligentere, lichtbetriebene Prozessoren, die traditionelle Elektronik ergänzen oder entlasten.

Zitation: Yu, L., Singh, H.J., Pietila, J. et al. Double-phase metasurface operators for all-optical image processing. Light Sci Appl 15, 119 (2026). https://doi.org/10.1038/s41377-025-02153-w

Schlüsselwörter: optische Bildverarbeitung, Metaflächen, analoge Berechnung, Holographie, Kantenerkennung