Clear Sky Science · de

3DSynBrush ein hochwertiges 3D-Rekonstruktionsframework für einzelne Dunhuang-Wandmalereien

Antike Kunst trifft moderne Werkzeuge

Die bemalten Höhlen von Dunhuang im Westen Chinas bergen einige der bemerkenswertesten buddhistischen Wandmalereien der Welt. Viele dieser fragilen Werke verblassen jedoch, reißen und blättern ab. Diese Studie stellt eine neue Methode vor, mit der sich aus einem einzigen Foto einer Mural-Detailaufnahme ein lebensechtes dreidimensionales Modell erstellen lässt. Damit können Historiker, Konservatoren und die Öffentlichkeit diese Kunstwerke aus allen Blickwinkeln erkunden, ohne die Originale zu berühren.

Ein Schatz, der vom Verschwinden bedroht ist

Die Mogao-Grotten von Dunhuang werden oft als Bibliothek in Stein bezeichnet; ihre Wandmalereien dokumentieren religiöse Geschichten, Architektur, Kleidung, Musik und Alltagsleben über tausend Jahre. Zeit, Sand, Salz und menschliche Einflüsse haben ihren Tribut gefordert: Pigmente sind verblasst, Putz bröckelt. Traditionelle Konservierung stützt sich auf Fotografien und mühselige physische Reparaturen, kann jedoch weder Tiefe, Farbnuancen noch das räumliche Empfinden der Malereien vollständig einfangen, noch kann sie weiteren Verlust verhindern. Digitale 3D-Modelle hingegen können einen Augenblick konservieren, sodass Kuratoren Details analysieren, Beleuchtung simulieren und die Werke breit zugänglich machen können, ohne die Originale zu gefährden.

Warum aus flachen Bildern 3D zu machen schwierig ist

Ein überzeugendes 3D-Modell erfordert normalerweise viele Fotos aus unterschiedlichen Blickwinkeln um ein Objekt herum. Dunhuang-Wandmalereien sind jedoch flache Gemälde an Höhlenwänden, und oft existiert nur ein einzelnes hochauflösendes Bild einer bestimmten Figur, eines Tieres oder eines architektonischen Motivs. Der Malstil erschwert die Aufgabe zusätzlich: Pinselstriche können zart sein, Farben sind durch Alterung gedämpft, und Formen wie dünne Bänder oder Heiligenscheine sind extrem fein. Bestehende 3D-Algorithmen sind meist auf Fotografien alltäglicher Gegenstände und Gebäude trainiert, weshalb sie diese stilisierten Bilder oft falsch interpretieren, verzerrte Formen erzeugen oder Details hinzuerfinden, die dem Geist der ursprünglichen Kunst widersprechen.

Ein intelligenter, schrittweiser digitaler Pinsel

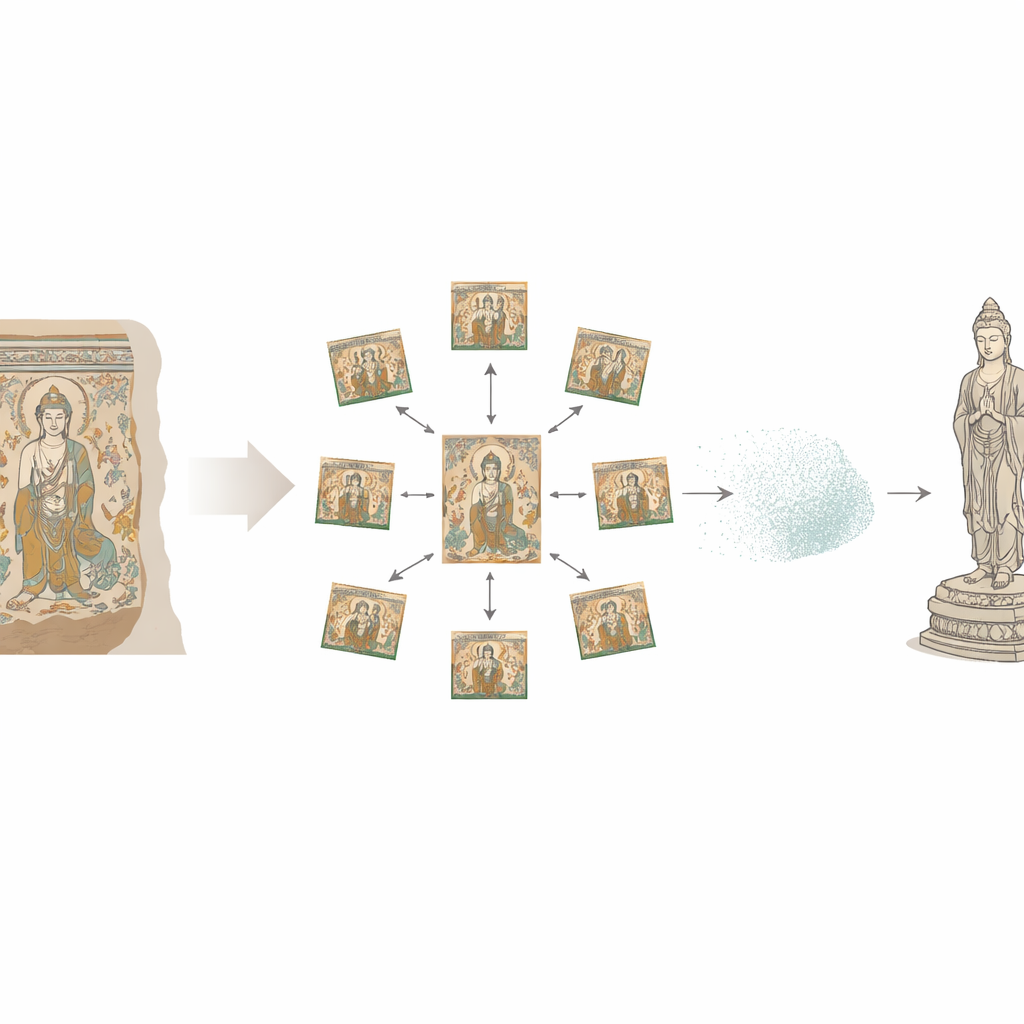

Die Autorinnen und Autoren schlagen ein Framework namens 3DSynBrush vor, das geschickt mehrere fortgeschrittene Bild- und 3D-Techniken aneinanderreiht, wobei jede einen anderen Teil des Problems löst. Zuerst stellen sie ein spezialisiertes Chinese Mural Elements (CME)-Datenset zusammen: Tausende sorgfältig ausgewählte Figuren, Tiere und Pflanzen, aus hochauflösenden Mural-Fotos ausgeschnitten. Ein Segmentierungswerkzeug trennt jedes Element sauber vom komplexen Hintergrund und erhält dabei transparente Konturen, die Kanten und feine Strukturen bewahren. Als Nächstes stellt ein Perspektiv-Synthese-Modul sich vor, wie die einzelne gemalte Figur aus mehreren Standardblickwinkeln aussehen würde, unter Nutzung eines leistungsfähigen Diffusionsmodells, das aus großen Trainingsmengen typische 3D-Beziehungen gelernt hat. Dadurch entsteht ein Ring konsistenter Ansichten um das Element, obwohl nur ein Originalbild vorlag.

Von vorgestellten Ansichten zu festen Formen

Diese synthetisierten Ansichten werden dann an ein neuronales Rendering-System übergeben, das sie zu einem kontinuierlichen 3D-„Lichtfeld“ verknüpft, im Wesentlichen einer mathematischen Beschreibung davon, wie Licht und Farbe an jedem Punkt um das Element herum wirken. Diese Phase ist darauf abgestimmt, die weichen Texturen und den nicht-fotografischen Look von Wandmalereien zu verarbeiten, indem kleine Inkonsistenzen zwischen den generierten Ansichten geglättet werden, ohne künstlerische Merkmale zu verwischen. Schließlich wandelt ein Mesh-Building-Modul dieses unsichtbare Lichtfeld in eine standardisierte 3D-Oberfläche aus Dreiecken um, verfeinert automatisch dichte Bereiche mit Kanten und feinen Details und vereinfacht flachere Regionen, die keine vielen Punkte benötigen. Bemerkenswert ist, dass die resultierenden Modelle nur etwa 40 Prozent der Punkte und Flächen führender Alternativen benötigen, dabei jedoch in Form und Textur näher am Originalbild bleiben.

Entwickelt, um Rauschen, Schatten und Lücken zu widerstehen

Das Team testete 3DSynBrush unter schwierigen Bedingungen, die reale Fotografie nachahmen: körnige Bilder, ungleichmäßige Beleuchtung und Teile des Elements, die durch dunkle Flecken verdeckt sind. Selbst bei zunehmendem Rauschen und Verdeckungen blieb die Haupt-3D-Form stabil, und die Oberflächentexturen blieben erkennbar. Im visuellen und numerischen Vergleich mit mehreren führenden Einzelbild-3D-Methoden lieferte 3DSynBrush sauberere, treuere Rekonstruktionen muraler Motive und vermied typische Fehler wie verzerrte Körper, gebrochene Flächen oder Texturen, die wie fremde Objekte aussehen.

Verlorene Welten wieder zum Leben erwecken

Für Nichtfachleute ist das wichtigste Ergebnis, dass ein einzelnes Foto eines gemalten Hirsches, Tänzers oder Tempels aus Dunhuang nun in ein kompaktes, genaues 3D-Modell verwandelt werden kann, das in Virtual Reality erkundet, in digitalen Ausstellungen verwendet oder als Leitfaden für behutsame Restaurierungsarbeiten dienen kann. Obwohl das System weiterhin von der Qualität des initialen Ausschnitts abhängt und durch aktuelle Bildauflösungen begrenzt ist, bietet es einen praktikablen Weg, das Erscheinungsbild und das räumliche Gefühl fragiler Wandmalereien zu bewahren. Im Kern wirkt 3DSynBrush wie ein digitaler Bildhauer, der den ursprünglichen Stil des Künstlers respektiert und verletzliche Fragmente muraler Kunst in dauerhafte, interaktive „Statuen“ verwandelt, die künftige Generationen studieren und genießen können.

Zitation: Peng, X., Wang, J., Hu, Q. et al. 3DSynBrush a high quality 3D reconstruction framework for single Dunhuang murals. npj Herit. Sci. 14, 154 (2026). https://doi.org/10.1038/s40494-026-02424-8

Schlüsselwörter: Dunhuang-Wandmalereien, Digitalisierung des Kulturerbes, 3D-Rekonstruktion aus Einzelbildern, neuronales Rendering, virtuelle Museumsräume