Clear Sky Science · de

Eine automatische Annotationsmethode für farbige 3D-Dreiecksnetze zur Segmentierung von Kulturgüterschäden

Warum digitale Augen für alte Schätze wichtig sind

In Museen und historischen Stätten reißen, blättern und verblassen Skulpturen, Wandmalereien und geschnitzte Wände allmählich. Restauratorinnen und Restauratoren müssen genau wissen, wo diese Schäden auftreten, um zu entscheiden, was zu reparieren ist und wie dringend, doch das sorgfältige Nachzeichnen jeder beschädigten Stelle in detaillierten 3D-Aufzeichnungen kann Wochen dauern. Dieses Papier stellt ein automatisches Verfahren vor, um Schäden an reichfarbenen 3D-Modellen von Kulturgütern zu markieren und damit eine mühsame, nur Experten vorbehaltene Aufgabe in einen schnellen und präzisen digitalen Prozess zu verwandeln.

Von fragilen Statuen zu detaillierten 3D-Zwillingen

Heute werden viele wichtige Objekte als hochauflösende, farbige 3D-Modelle aus Fotografien erfasst. Diese Modelle halten sowohl Form als auch Oberflächenfarbe fest, ohne das Originalobjekt zu berühren, und Institutionen von den Höhlen von Dunhuang bis zum British Museum nutzen sie. Doch der größte Teil dieses digitalen Reichtums wird nicht ausgeschöpft: Modelle dienen meist nur zur Betrachtung und Archivierung, nicht für tiefgehende Analysen. Für die Konservierung ist eine zentrale Herausforderung, exakt zu erkennen und zu messen, wo Farbe abblättert oder Material über komplexe, gewölbte Flächen Risse zeigt. Das manuelle Arbeiten auf 3D-Modellen ist langsam und ermüdend; auf flachen Fotos geht zudem wichtige Information darüber verloren, wo sich der Schaden am Objekt selbst befindet.

Flache Bilder und 3D-Formen verbinden

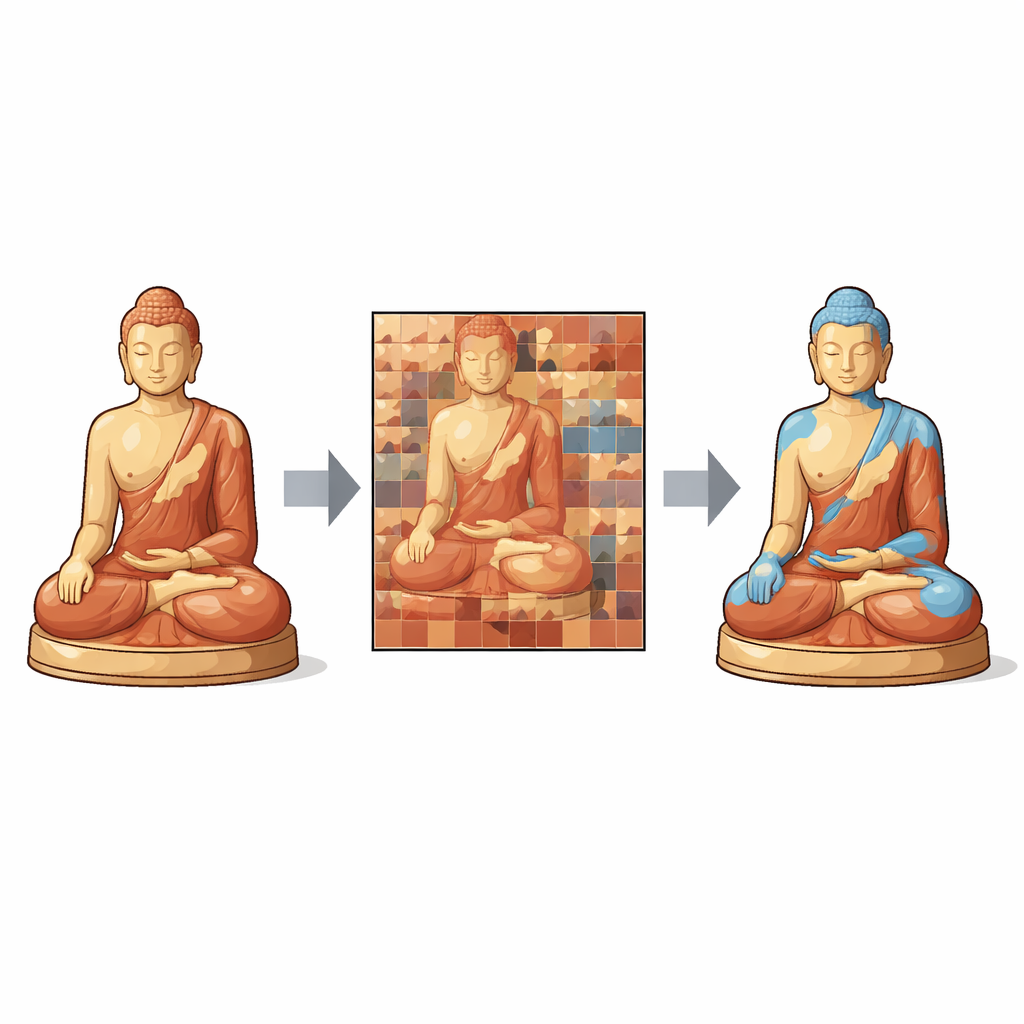

Die Autorinnen und Autoren schlagen ein System vor, das 2D und 3D „miteinander sprechen“ lässt, sodass die Stärken beider zugleich genutzt werden. Zuerst laden Restauratorinnen und Restauratoren ein farbiges 3D-Modell in eine spezielle Plattform und wählen grob per Box einen Bereich, der interessiert, etwa Arm oder Sockel einer Statue. Die Software „faltet“ diesen Teil der Oberfläche mathematisch auf und legt ihn als durchgehendes flaches Texturbild aus — eine Art digitale Haut, die mit minimaler Verzerrung abgezogen und ausgebreitet wird. Jeder Pixel in dieser flachen Karte weiß genau, aus welchem kleinen Dreieck der 3D-Oberfläche er stammt, und umgekehrt. Diese zweiseitige Verbindung erlaubt, dass Markierungen — oder in diesem Fall erkannte Schäden — auf dem flachen Bild zuverlässig auf das gekrümmte 3D-Objekt zurückprojiziert werden können.

Dem Computer beibringen, abblätternde Farbe zu sehen

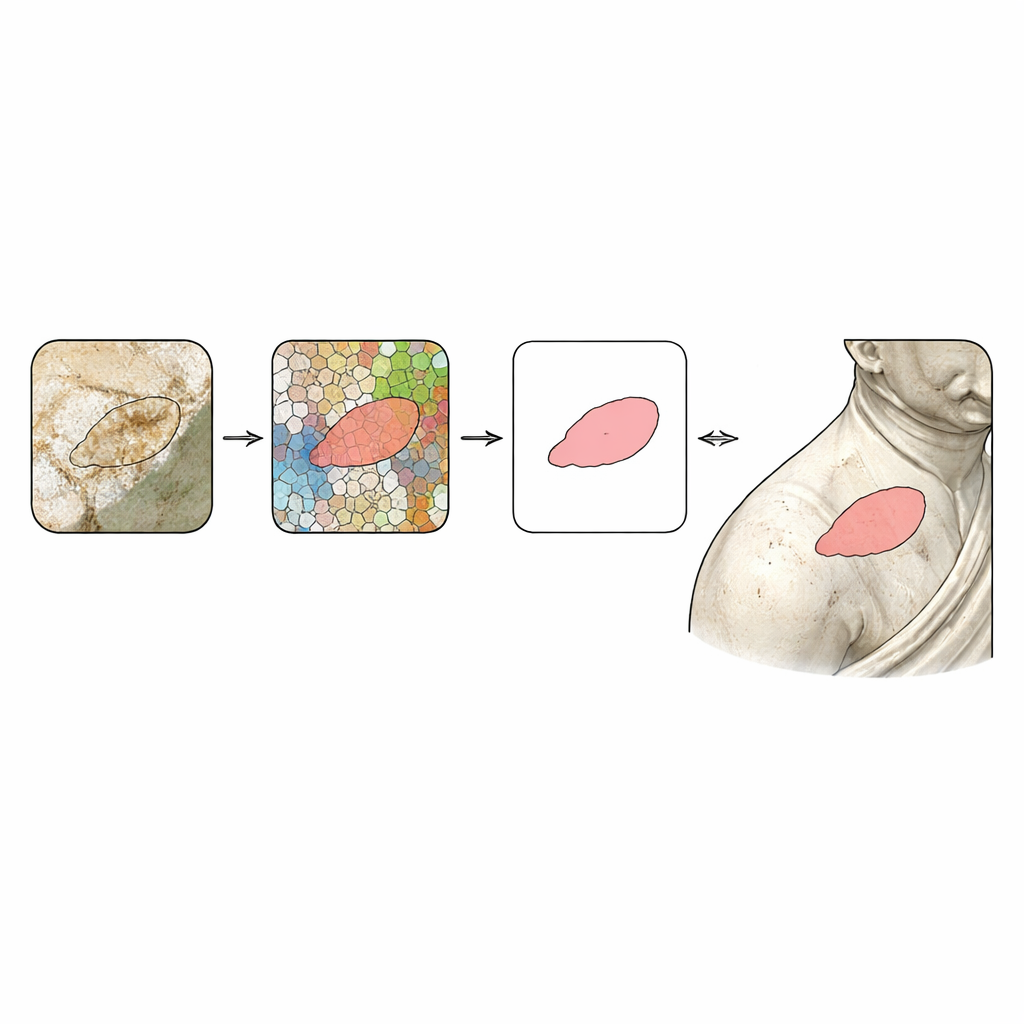

Sobald die Oberfläche in ein klares, zusammenhängendes Bild überführt ist, konzentriert sich das System auf das Finden beschädigter Bereiche, insbesondere Stellen, an denen Farbe abgefallen ist. Statt sich auf grobe Farbschwellen zu verlassen, verwenden die Autorinnen und Autoren eine verbesserte Version einer Methode namens SLIC, die das Bild in viele kleine, einheitliche „Superpixel“ unterteilt. Anzahl und Form dieser Superpixel werden automatisch anhand der visuellen Komplexität des Bildes gewählt, mithilfe eines Maßes für Texturkontrast. Anschließend gruppiert ein Clustering-Schritt die Superpixel in „beschädigt“ und „gesund“. Dieser Ansatz folgt den unregelmäßigen Rändern abblätternder Farbe enger und reduziert Rauschen im Vergleich zu anderen gängigen Segmentierungstechniken. Das Ergebnis ist eine präzise Schadensmaske auf Pixelebene in der 2D-Texturkarte.

Den Schaden zurück auf das 3D-Objekt projizieren

Mit Hilfe der zuvor beschriebenen 2D–3D-Verknüpfung verfolgt die Software jeden beschädigten Pixel zurück zu der exakten Stelle im 3D-Mesh, zu der er gehört. Mittels einfacher geometrischer Transformationen wandelt sie 2D-Koordinaten in vollständige 3D-Positionen um, die der Krümmung des Objekts folgen. Diese Punkte werden dann zu einer sauberen, farbigen „Hülle“ des Zerfalls kombiniert, die am ursprünglichen 3D-Modell anliegt. An einer bemalten Holzstatue der Guanyin aus der Song-Dynastie zeigen die Autorinnen und Autoren, dass ihre automatischen Masken eng mit mühsam von Hand erstellten Markierungen in professioneller Modellierungssoftware übereinstimmen, selbst an stark gekrümmten oder sehr detaillierten Stellen. Zusätzlich bereichern sie die Daten, indem sie diese 2D- und 3D-Schadensmuster digital kopieren und transformieren, um viele realistische Trainingsbeispiele für künftige Deep-Learning-Systeme zu erzeugen.

Was das für die Bewahrung der Vergangenheit bedeutet

Die Studie zeigt, dass eine sorgfältige Koordination zwischen flachen Bildern und 3D-Geometrie rohe digitale Replikate von Artefakten in praktische Werkzeuge für die Konservierung verwandeln kann. Ihre Plattform reduziert den Arbeitsaufwand und die Subjektivität manueller Kennzeichnung, erzeugt konsistente, hochpräzise Schadenskarten und unterstützt die Stapelverarbeitung großer Sammlungen. Einfach gesagt gibt sie Restauratorinnen und Restauratoren einen verlässlichen, halbautomatischen „Textmarker“ für Zerfallsstellen an komplexen Objekten und produziert die zahlreichen, gut annotierten 3D-Daten, die moderne KI-Methoden benötigen. Zwar hängt der Ansatz weiterhin von qualitativ hochwertigen Texturen und einem klugen Aufrollen ab, um Verzerrungen zu vermeiden, doch er ist ein starker Schritt hin zu skalierbarer, datengetriebener Pflege des weltweiten Kulturerbes.

Zitation: Hu, C., Xie, Y., Xia, G. et al. An automatic annotation method for colored 3D triangular meshes oriented to cultural relic deterioration segmentation. npj Herit. Sci. 14, 150 (2026). https://doi.org/10.1038/s40494-026-02421-x

Schlüsselwörter: Erhaltung des kulturellen Erbes, 3D-Digitalisierung, automatische Schadensdetektion, Texturabbildung, Deep-Learning-Datensätze