Clear Sky Science · de

Forschung zur Mustererkennung auf kupfernen Spiegeln der Song-Dynastie basierend auf MOEAD

Warum antike Spiegel auf moderne Maschinen treffen

Stellen Sie sich vor, Ihre Handykamera könnte sofort sagen, welche mythischen Kreaturen auf einem tausend Jahre alten Bronzespiegel eingeprägt sind. Diese Studie rückt diese Vision näher an die Realität. Die Autorinnen und Autoren kombinieren fortgeschrittene Bilderkennungssoftware mit einer intelligenten Optimierungsstrategie, um Tiermotive auf Spiegeln der Song‑Dynastie automatisch zu identifizieren und so Kuratorinnen und Kuratoren, Archäologinnen und Archäologen sowie der Öffentlichkeit zu ermöglichen, kulturelle Schätze schneller und genauer zu erschließen.

Ein Licht auf bronzene Spiegel der Song‑Zeit werfen

Bronzespiegel waren alltägliche Gebrauchsgegenstände im alten China, trugen aber zugleich tiefgehende soziale und spirituelle Bedeutungen. Zur Zeit der Song‑Dynastie waren ihre Rückseiten mit komplexen Szenen verziert: Drachen und Phönixe, Kraniche und Schildkröten, Löwen und Hirsche — jeweils aufgeladen mit Symbolik zu Macht, Glück und Glauben. Viele dieser Spiegel wurden ausgegraben, doch die Bestimmung ihrer feinen Muster beruhte lange auf Expertinnen‑ und Expertenblicken – ein Verfahren, das langsam, subjektiv und schwer skalierbar ist. Die Autorinnen und Autoren argumentieren, dass verlässliche Computererkennung dieser Motive eine konsistentere Katalogisierung, digitale Bewahrung und neue Formen kultureller Analyse ermöglichen würde.

Motive in für den Computer lesbare Daten verwandeln

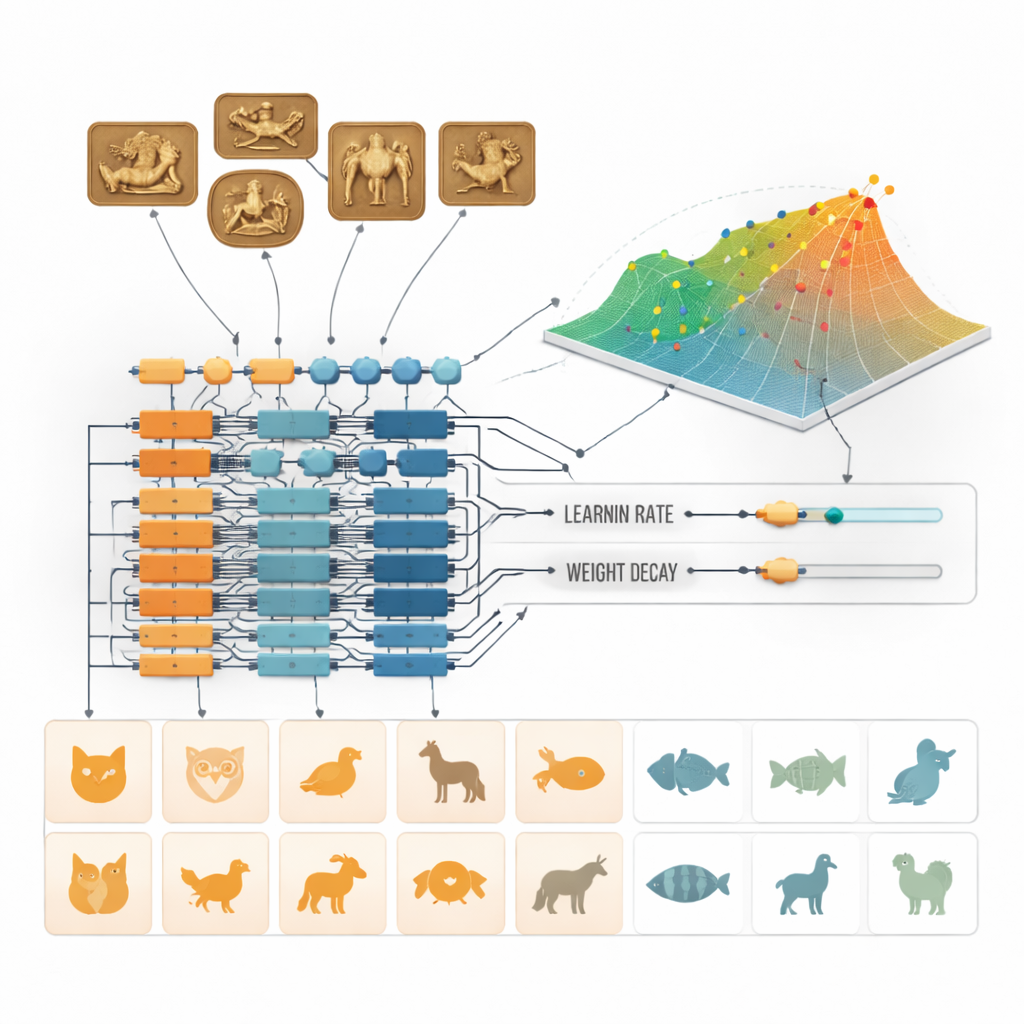

Um einem Computer „beizubringen“, diese Designs zu «sehen», stellte das Team zunächst eine spezielle Bildsammlung von 140 Bronzespiegeln der Song‑Dynastie zusammen, die 14 Tierarten abdecken – von Drachen und Phönixen bis zu Fischen, Tigern und Mandarinenten. Jedes Bild wurde sorgfältig nach Motiv beschriftet und dann in Trainings-, Validierungs- und Testsets aufgeteilt. Weil der Datensatz klein ist und einige Tiere selten vorkommen, erweiterten die Forschenden das Trainingsmaterial durch systematische Transformationen — Zuschneiden, Spiegeln, Drehen, Farb‑ und Helligkeitsänderungen und sogar das Entfernen kleiner Bildbereiche. Diese Variationen ahmen nach, wie reale Artefakte unter unterschiedlichen Lichtbedingungen, Kamerawinkeln oder Abnutzung aussehen können, und helfen dem Modell, das Wesentliche jedes Motivs zu lernen statt nur einige wenige makellose Beispiele auswendig zu behalten.

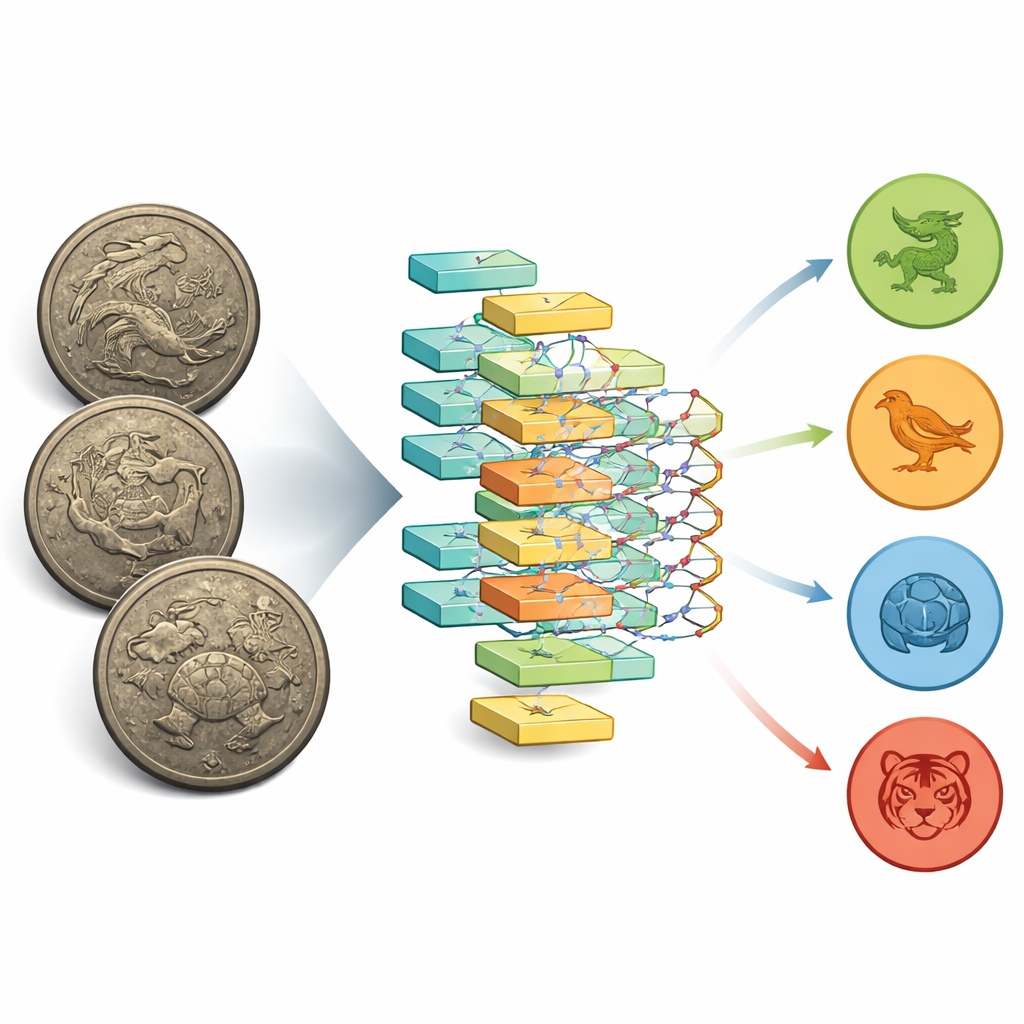

So arbeitet das intelligente Erkennungssystem

Im Kern des Systems steht ein Tiefenlernmodell namens ResNet50, eine Art digitales Auge, das lernt, visuelle Muster aus Bildern zu extrahieren. Sein Aufbau umfasst «Shortcut»-Verbindungen, die den Informationsfluss durch viele Schichten erleichtern, sodass sowohl feine Oberflächendetails als auch höhere Formen erfasst werden können. Darauf aufbauend führen die Autorinnen und Autoren eine Strategie aus der evolutionären Berechnung ein, bekannt als MOEA/D. Anstatt Trainingsparameter per Hand zu raten, lassen sie eine virtuelle Population von Kandidateneinstellungen über viele Runden «evolvieren». Jeder Kandidat wird nach mehreren Zielen gleichzeitig bewertet: geringe Vorhersagefehler, hohe Genauigkeit über die Labels hinweg und stabile Verhaltensweisen. Im Laufe der Zeit konvergiert der Algorithmus zu Kombinationen aus Lernrate und Regularisierungsstärke, die den besten Kompromiss zwischen Genauigkeit und Zuverlässigkeit liefern.

Das System auf die Probe stellen

Die Forschenden verglichen ihr optimiertes Modell mit drei verbreiteten Alternativen: VGG16, EfficientNet‑B0 und einer nicht optimierten Variante von ResNet50. Alle Modelle wurden mit denselben Spiegelbildern trainiert und an ungesehenen Beispielen getestet. Das optimierte System stach hervor. Es erreichte eine Hamming‑Genauigkeit — ein Maß dafür, wie konsistent jedes Label vorhergesagt wird — von mehr als 94 % im Validierungsset und über 91 % im Testset und übertraf damit die anderen Netze. Außerdem zeigte es gleichmäßigere Leistungen über die Kategorien hinweg und vermied das Muster, dass einige Tiere nahezu perfekt erkannt werden, während andere völlig übersehen werden. Zusätzliche Experimente, einschließlich statistischer Tests und Occlusion‑Studien, die Teile des Bildes verdecken, deuten darauf hin, dass die Verbesserungen kein Zufall sind: Das Modell fokussiert tatsächlich die Motivregionen und tut dies reproduzierbar, selbst bei einigen der selteneren Tiere.

Welche Bedeutung das für das Kulturerbe hat

Für Nichtfachleute lautet die Quintessenz einfach: Die Studie zeigt, dass sorgfältig abgestimmte künstliche Intelligenz Tiere auf jahrhundertealten Bronzespiegeln zuverlässig erkennen kann, mit geringem zusätzlichem Rechenaufwand und weniger ausschließlicher Abhängigkeit von Expertenurteilen. Zwar tut sich das Modell weiterhin bei sehr seltenen oder visuell ähnlichen Motiven schwer, doch bietet es bereits ein praktisches Werkzeug für Museen und Forschende, um die Katalogisierung zu beschleunigen und digitale Archive zu unterstützen. Wenn größere Bildsammlungen verfügbar werden und die Methode weiter verfeinert wird — möglicherweise mit leistungsfähigeren Datenaugmentationen und erklärbaren Visualisierungen — könnten ähnliche Ansätze auf andere Artefaktklassen ausgeweitet werden, von gemeißeltem Stein bis zu bemalten Textilien, und damit die unsichtbaren Strukturen unserer materiellen Vergangenheit sowohl für Wissenschaftlerinnen und Wissenschaftler als auch für die breite Öffentlichkeit sichtbar machen.

Zitation: Feng, Q., Yu, K., Li, Y. et al. Research on Song dynasty copper mirror pattern recognition based on MOEAD. npj Herit. Sci. 14, 158 (2026). https://doi.org/10.1038/s40494-026-02413-x

Schlüsselwörter: Bronzespiegel der Song-Dynastie, Kulturerbe KI, Bildmustererkennung, Tiefenlernoptimierung, Kunstgegenstand-Motivklassifikation