Clear Sky Science · de

Forschung zur Erkennung von Batikmusterbildern basierend auf verbessertem YOLOv11

Alte Stoffe treffen auf modernen Code

Batikstoffe der chinesischen Miao-Gemeinschaften sind mehr als Dekoration: Ihre Schmetterlinge, Drachen, Vögel und Blumen dokumentieren still Geschichte, Glauben und Alltagsleben, wo es keine Schrifttradition gab. Während diese Textilien altern und jüngere Generationen sich immer weniger mit traditionellen Handwerken beschäftigen, drohen wichtige kulturelle Informationen in Stapeln ungekennzeichneter Fotos und ausbleichenden Stoffen verloren zu gehen. Diese Studie zeigt, wie fortschrittliche Bilderkennungssoftware winzige, überlappende Motive in komplexen Batikbildern automatisch finden und identifizieren kann und so eine neue Möglichkeit bietet, diese lebendige Kunstform großflächig zu bewahren und zu erforschen.

Warum diese Muster bedeutend sind

Chinesischer Batik ist eine Handfärbetechnik, die seit mehr als zwei Jahrtausenden gedeiht, besonders bei den Miao im Gebiet der Provinz Guizhou. Da diese Gemeinschaft historisch keine Schriftsprache nutzte, wurden Batikmotive zu einem visuellen Archiv von Mythen, Ritualen, Ästhetik und sozialen Gebräuchen. Wissenschaftler haben begonnen, diese Muster zu digitalisieren und mit Instrumenten aus Mathematik, Design und künstlicher Intelligenz zu analysieren. Frühere Arbeiten konnten isolierte Motive recht gut klassifizieren, erforderten aber häufig, die Motive aus dem Originaltuch herauszuschneiden und damit die Verbindung zwischen dem einzelnen Symbol und der größeren Komposition zu zerstören. Dadurch war es schwierig zu verstehen, wie Motive auf einem Kleidungsstück oder Textil zusammenspielen, um vielschichtige Bedeutungen zu vermitteln.

Von einfachen Labels zur intelligenten Erkennung

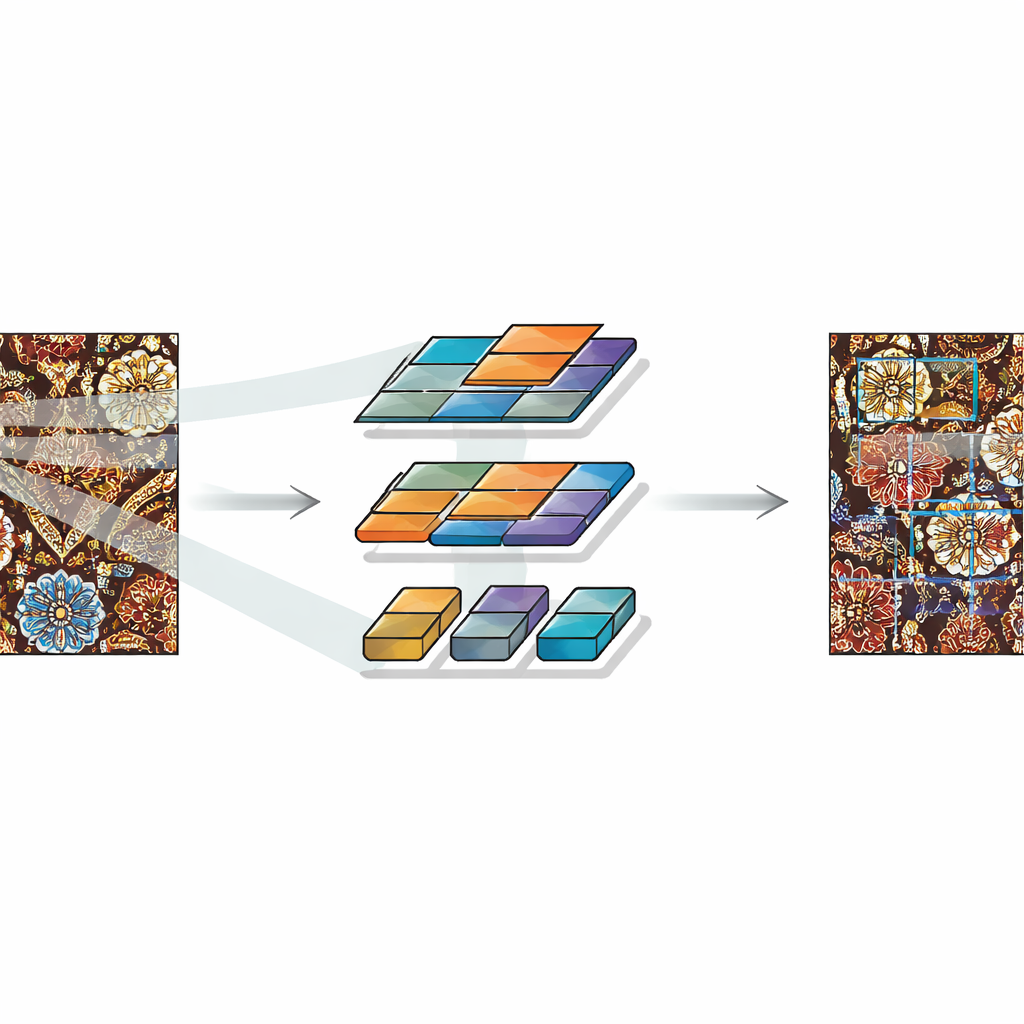

Die Autoren argumentieren, dass nicht nur Klassifikation, sondern vollständige Objekterkennung nötig ist: jedes Motiv in einem vollständigen Foto lokalisieren und seinen Typ benennen. Das ist ein schwieriges Problem bei realen Batikbildern, in denen Designs eng beieinander liegen, stark in der Größe variieren und oft verblasst, rissig oder teilweise verdeckt sind. Standarderkennungssysteme, einschließlich früherer Versionen der populären YOLO („You Only Look Once“)-Familie, hatten mit diesen Bedingungen zu kämpfen. Sie übersehen häufig sehr kleine Symbole, werden durch komplexe Hintergründe verwirrt oder versagen bei ungleichmäßiger Beleuchtung und Bildqualität — genau die Art von Bildern, die Kuratoren und Feldforscher am häufigsten sammeln.

Ein neuronales Netz beibringen, Stoff zu lesen

Um diese Herausforderungen anzugehen, erstellte das Team zunächst den derzeit größten chinesischen Batik-Erkennungsdatensatz: 861 hochauflösende Bilder, annotiert mit 9933 Begrenzungsrahmen über sieben Motivkategorien (Schmetterling, Fisch, Drache, Vogel, Trommel, Blume und Frucht). Sie balancierten Bildgröße und -qualität sorgfältig aus und erweiterten die begrenzten Daten durch kontrolliertes Verwischen, Farbveränderungen, Spiegelungen, Mosaike und andere Transformationen, damit das Modell die Trainingsbeispiele nicht einfach nur auswendig lernt. Auf diesem Datensatz bauten sie eine verbesserte Version von YOLOv11 auf, ein modernes Objekterkennungsframework, das wegen seiner Geschwindigkeit und kompakten Größe gewählt wurde — wichtige Eigenschaften, wenn das Werkzeug auf Alltagscomputern in Museen und Kulturzentren laufen soll.

Weiter sehen und klarer erkennen

Das verbesserte Modell fügt zwei zentrale Ideen hinzu. Erstens erlaubt eine Komponente, die vom VOLO „vision outlooker“-Mechanismus inspiriert ist, dem Netzwerk, über entfernte Bildbereiche gleichzeitig hinweg zu schauen, statt nur in kleinen lokalen Nachbarschaften. Das hilft ihm zu erkennen, dass zwei winzige Formen, die weit auseinander liegen, zum gleichen bedeutungsvollen Muster gehören können, und dass die Rolle eines Motivs von seinen Nachbarn abhängt. Zweitens überarbeitete das Team die Art und Weise, wie das Netzwerk Bildmerkmale verarbeitet, mithilfe einer Struktur namens Fused-MBConv. Dieses Redesign hält die Berechnungen effizient und schärft gleichzeitig die Fähigkeit des Modells, subtile Details aus verrauschten, gealterten Stoffen herauszuarbeiten. In Tests und sorgfältigen Ablationsstudien erzielte ihr finales Design höhere mittlere Erkennungsgenauigkeit als das Basis-YOLOv11 und mehrere andere leichte Detektoren, während es immer noch schnell genug für Echtzeit- oder nahezu Echtzeitanwendungen lief.

Von automatischen Tags zu kulturellen Geschichten

Über rohe Detektionswerte hinaus verbanden die Forschenden ihr Modell mit einem Batik-Wissensgraphen, der jeden Motivtyp mit Geschichten über Herkunft, symbolische Bedeutungen und verwandte Beispiele verknüpft. In einem Prototyp-Softwaresystem kann ein Nutzer ein Foto eines Stoffs hochladen, die erkannten Motive hervorgehoben sehen und dann durchklicken, um deren kulturellen Hintergrund zu erkunden. Für Archivare bedeutet das schnellere, konsistentere Katalogisierung großer Bestände. Für Lehrende und Besucher wird Mustererkennung zu einem Einstiegspunkt, um über Miao-Glauben, Rituale und Ästhetik zu lernen. Obwohl das aktuelle System nur auf chinesischem Batik trainiert ist, sehen die Autoren darin eine Blaupause für kulturübergreifende Werkzeuge, die eines Tages Textiltraditionen von Indonesien bis Indien schützen könnten, sodass die Muster auf Stoffen weiter „sprechen“, selbst wenn die Gewebe selbst altern und verblassen.

Zitation: Li, Y., Quan, H., Li, Q. et al. Research on batik image pattern detection based on improved YOLOv11. npj Herit. Sci. 14, 143 (2026). https://doi.org/10.1038/s40494-026-02404-y

Schlüsselwörter: Erkennung von Batikmustern, immaterielles Kulturerbe, Computer Vision, YOLO-Objekterkennung, Miao-Textilkunst