Clear Sky Science · de

Adaptive Mehrfachmerkmal-Fusion zur Registrierung sichtbarer und infraroter Bilder und Zeichenverbesserung von Bambusstreifen

Antike Texte, die im Verborgenen liegen

Mehr als zwei Jahrtausende lang wurden Regierungsakten, medizinische Notizen und Alltagsaufschreibungen in China auf schmale Bambus- und Holzstreifen geschrieben. Viele dieser fragilen Streifen haben im Boden überdauert, doch die Tinte ist so stark verblasst, dass ein Großteil der Schrift kaum noch sichtbar ist. Diese Studie stellt eine neue Bildgebungsmethode vor, die gewöhnliche Fotografien mit Infrarotaufnahmen derselben Streifen präzise ausrichtet und dann die verlorenen Zeichen digital rekonstruiert – wodurch beschädigte Texte wieder lesbar werden und ein klareres Fenster zur antiken Geschichte entsteht.

Warum alte Bambusaufzeichnungen so schwer zu lesen sind

Ausgegrabene Bambus- und Holzstreifen sind unschätzbar wertvolle historische Dokumente, doch Jahrhunderte im Erdreich hinterlassen Risse, Flecken und Abnutzung. Im sichtbaren Licht überlagern Holzmaserung, Schmutz und Verfärbungen oft die schwache Tinte, sodass Zeichen in den Hintergrund verschwimmen oder ganz verschwinden. Infrarotkameras können Tintenreste sichtbar machen, die im sichtbaren Licht nicht mehr erscheinen, weil Tinte und Holz im Infrarot unterschiedlich reflektieren. Allerdings fehlen Infrarotbildern häufig die reichen Farb- und Oberflächendetails, die Kuratoren und Historiker benötigen, um Herstellungsweisen zu untersuchen oder Fragmente zusammenzufügen. Forscher wechseln heute oft zwischen sichtbaren und infraroten Bildern desselben Streifens hin und her und versuchen, mental zu kombinieren, was jede Ansicht zeigt – ein langsamer, ermüdender Prozess, der viele Zeichen unsicher lässt.

Zwei Arten der Wahrnehmung scharfstellen

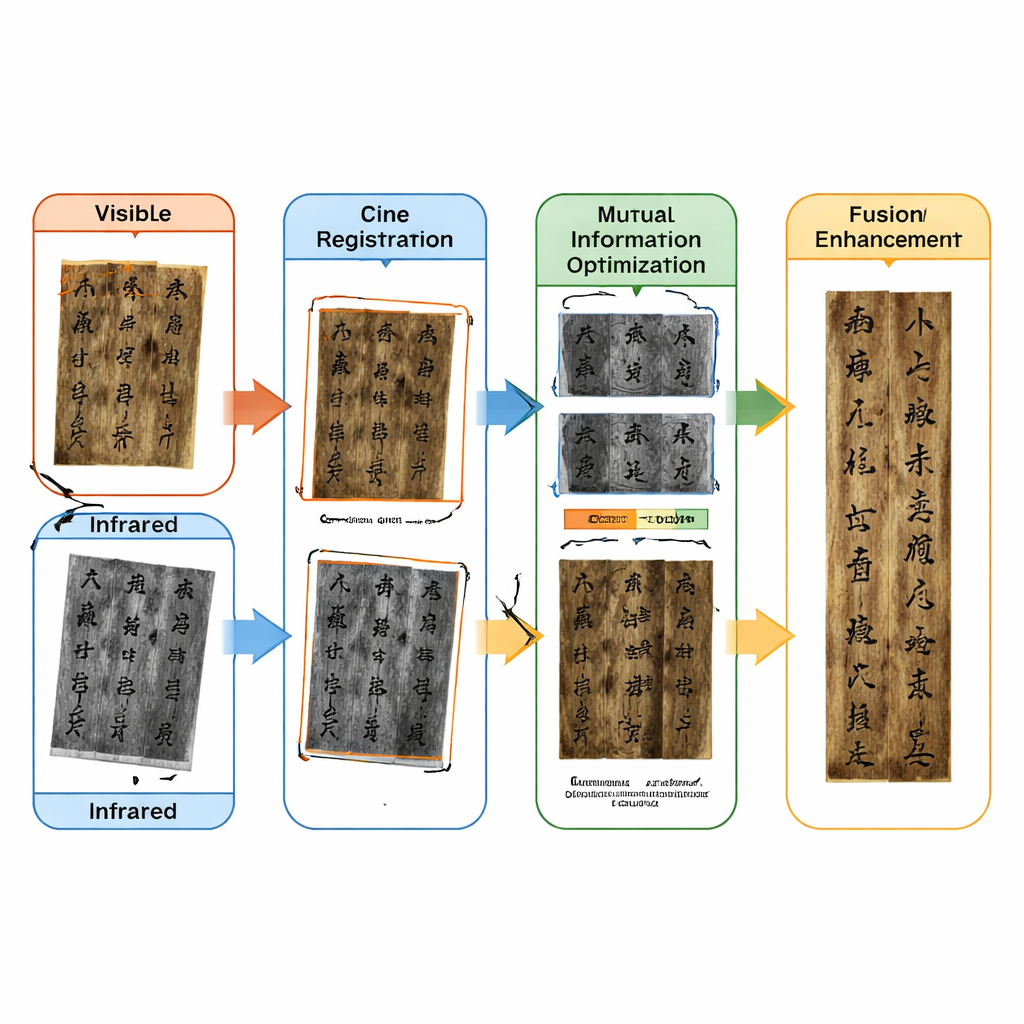

Das Team löst dieses Problem, indem es sichtbare und infrarote Bilder jedes Bambusstreifens präzise ausrichtet oder „registriert“, sodass sie zu einem verbesserten Bild verschmolzen werden können. Das ist alles andere als trivial: Da die beiden Kameras und Lichtbedingungen verschieden sind, können die Bilder verschoben, gedreht, leicht skaliert und sogar verzerrt zueinander liegen. Hinzu kommt, dass die Streifen eine schwache Textur aufweisen – wenige scharfe Ecken oder Muster –, was es Standard-Werkzeugen der Computer Vision schwer macht, passende Punkte zwischen den Ansichten zu finden. Die Autoren entwerfen eine mehrstufige Registrierungs-Pipeline, die eine Eigenschaft nutzt, die über Wellenlängen hinweg stabil bleibt: die Außenkontur jedes Streifens.

Von grober Ausrichtung zu pixelgenauer Übereinstimmung

Die Methode beginnt mit einer groben Ausrichtungsphase, in der beide Bilder verkleinert werden, um ablenkende Details zu unterdrücken, und dann die langen Außenkanten der Streifen sowie eine moderate Anzahl eckenähnlicher Punkte erkannt werden. Da sich die Kontur eines Bambusstreifens zwischen sichtbaren und infraroten Bildern kaum ändert, erhalten diese Kanten hohe Gewichtung bei der Schätzung, wie ein Bild gedreht, verschoben und skaliert werden muss, um mit dem anderen übereinzustimmen. Es folgt eine Feinausrichtungsphase, die in voller Auflösung arbeitet. Hier verfeinert der Algorithmus wiederholt die Anpassung unter Nutzung sowohl der Kantkonturen als auch der Zeichen-Ecken, allerdings mit einem Kniff: anfänglich werden die großräumigen Kanten stärker vertraut; sobald die Übereinstimmung sich verbessert, erhöht die Methode allmählich das Gewicht der präzisen Eckpunkte, die um einzelne Strichzüge herum verfolgt werden. Dieser adaptive Wechsel von „Umriss zuerst“ zu „Details zuerst“ hilft, in einer schlechten Lösung nicht stecken zu bleiben und gleichzeitig eine sehr enge Ausrichtung zu erreichen.

Informationsgehalt leitet den letzten Feinschliff

Selbst bei guter geometrischer Anpassung können sich die Helligkeitsmuster in sichtbaren und infraroten Bildern stark unterscheiden. Um die Arbeit abzuschließen, fügen die Forschenden einen Optimierungsschritt auf Basis der „gegenseitigen Information“ hinzu, einem statistischen Maß dafür, wie gut ein Bild die Graustufen des anderen vorhersagt. Der Algorithmus nimmt viele kleine Testanpassungen an der Transformation zwischen den beiden Ansichten vor und behält jene Änderung, die diese gemeinsame Information am stärksten erhöht. Eine hybride Suchstrategie – die eine globale Erkundungsmethode, bekannt als simulierter Temperungsprozess (simulated annealing), mit klassischer, gradientenbasierter Verfeinerung kombiniert – erlaubt es dem System, eine Transformation zu finden, die sowohl geometrisch plausibel als auch informationsreich ist, selbst wenn die Bilder verrauscht oder teilweise beschädigt sind.

Verschollene Zeichen wieder zum Leben erwecken

Sind sichtbare und infrarote Bilder einmal miteinander verbunden, konzentriert sich der zweite Teil des Frameworks auf die Zeichen selbst. Das Infrarotbild wird so verarbeitet, dass die Tinte gegenüber dem Hintergrund hervorgehoben und dann durch Schwellenwertsetzung Strichregionen isoliert werden. Nach Bereinigung von Rauschen und Lücken wird die extrahierte Schrift in eine transparente „Tintenschablone“ umgewandelt. Anstatt diese Schablone einfach aufzulegen, verwendet die Methode eine form der differenzbasierten Fusion: Im Grunde wird das Tintenmuster vom Hintergrund subtrahiert, wodurch Bereiche, in denen das sichtbare Bild einst Schrift trug – jetzt aber nur noch blankes Holz zeigt – wieder dunkel erscheinen. Schließlich stellen Farbkorrekturen die natürlichen Bambustöne in den Bereichen wieder her, in denen die ursprünglichen sichtbaren Zeichen bereits klar waren. Das Ergebnis ist ein einziges Bild, das das realistische Aussehen, die Farbe und Textur des Streifens bewahrt und gleichzeitig sowohl schwache als auch unsichtbare Striche deutlich hervorhebt.

Scharfere Ansichten für Historiker und Denkmalpflege

Tests an mehr als 800 Bildpaaren von Bambusstreifen, darunter viele mit stark beschädigter Schrift, zeigen, dass die neue Methode eine Reihe bestehender Registrierungsverfahren übertrifft, von klassischem Feature-Matching bis zu modernen Deep-Learning-Ansätzen. Quantitative Kennzahlen bestätigen, dass die ausgerichteten Bilder mehr Informationen teilen und Strukturen besser übereinstimmen, während visuelle Überlagerungen eine nahezu perfekte Deckung zwischen sichtbarem und infrarotem Inhalt zeigen. Für Historiker und Restauratoren bedeutet das, dass sie schwierige Texte aus einem einzigen verbesserten Bild lesen und interpretieren können, was die Transkription beschleunigt und hilft, verstreute Fragmente wieder zusammenzufügen. Allgemeiner zeigt die Arbeit, wie die Kombination mehrerer Bildgebungsarten mit intelligenter Ausrichtung und Fusion fragile Schriften vor der Unleserlichkeit bewahren kann und damit die digitalen Bemühungen zur Erhaltung und Erforschung des weltweiten dokumentarischen Erbes stärkt.

Zitation: Wan, T., Qi, F., Yang, Y. et al. Adaptive multi-feature fusion for visible-infrared image registration and character enhancement of bamboo slips. npj Herit. Sci. 14, 96 (2026). https://doi.org/10.1038/s40494-026-02368-z

Schlüsselwörter: Bambusstreifen, Infrarotbildgebung, Bildregistrierung, Textwiederherstellung, kulturerbe