Clear Sky Science · de

Hochwertige 3D‑Rekonstruktion von Kulturerbe mittels Super‑Resolution und progressivem Gaussian Splatting

Warum klarere digitale Relikte wichtig sind

Museen und Archäologinnen und Archäologen weltweit ringen darum, getreue 3D‑Kopien zerbrechlicher Artefakte zu erstellen, von Porzellanvasen bis zu Tempelportalen. Diese digitalen Stellvertreter ermöglichen es, kulturelle Schätze zu untersuchen, zu teilen und zu bewahren, ohne die Originale zu berühren. In der Praxis sind Fotos von Kulturgütern jedoch oft dunkel, unscharf oder aus ungünstigen Blickwinkeln aufgenommen, was dazu führt, dass heutige 3D‑Rekonstruktionsmethoden verzerrte oder unvollständige Modelle erzeugen. Dieses Paper stellt einen neuen Ansatz vor, der dieses Problem direkt angeht, indem er sowohl die Eingabefotos bereinigt als auch den 3D‑Modellierungsprozess stabilisiert.

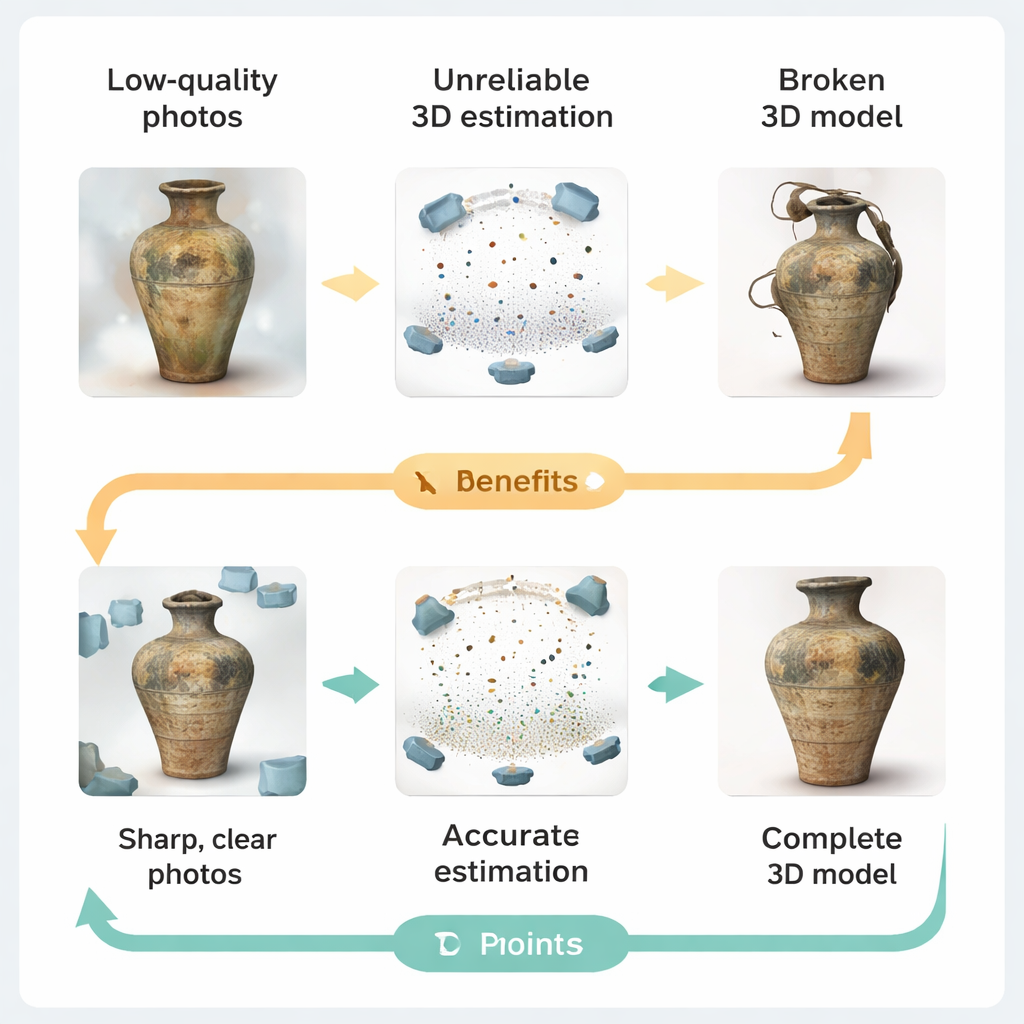

Wenn schlechte Bilder 3D‑Modelle zerstören

Aktuelle 3D‑Erfassungs‑Pipelines folgen meist einer einfachen Idee: viele Fotos aufnehmen, die Lage jeder Kamera schätzen, die Form des Objekts ableiten und schließlich ein 3D‑Modell rendern. In der Realität bieten Fundstätten und Museen selten Studio‑Bedingungen. Schwaches Licht, abgenutzte oder ungleichmäßige Oberflächen, Reflexionen aus Vitrinen und Beschränkungen bei der Kameraposition verschlechtern die Bilder. Die Autoren zeigen, wie sich diese Mängel durch die Pipeline fortpflanzen. Verschwommene oder niedrig aufgelöste Fotos erschweren das Auffinden übereinstimmender Merkmale zwischen Ansichten, was zu Fehlern in den Kameraposen und lückenhaften Tiefenschätzungen führt. Wenn diese unzuverlässigen Messungen in moderne Gaussian‑Splatting‑Renderer eingespeist werden—Systeme, die Szenen aus Tausenden kleiner farbiger Klumpen aufbauen—kann das zu instabiler Optimierung, redundanten Klumpen und sichtbar verzerrter Geometrie führen.

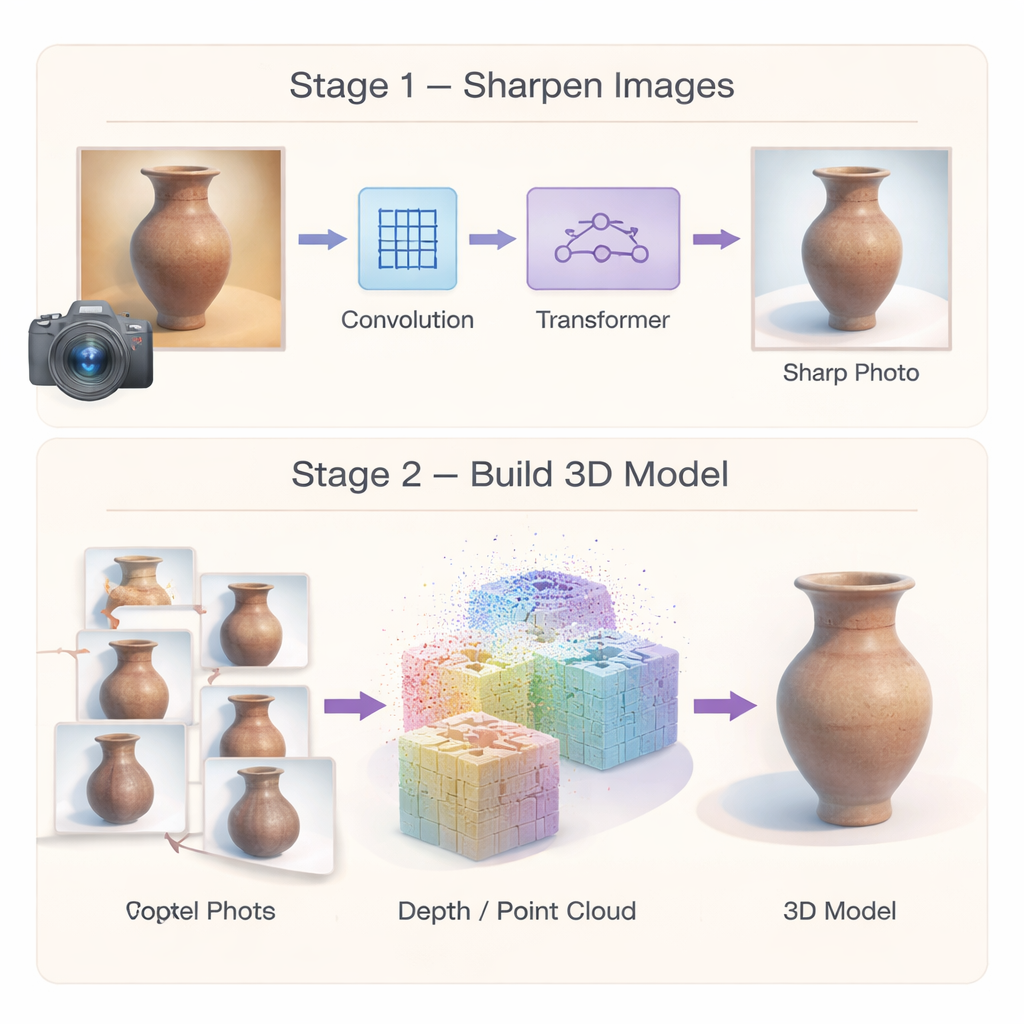

Fotos schärfen mit intelligenter Bildverbesserung

Um Fehler an der Quelle zu stoppen, entwickeln die Autoren zunächst ein spezialisiertes Super‑Resolution‑Netzwerk, das niedrigqualitative Kulturbilder in schärfere, detailreichere Aufnahmen verwandelt. Anstatt sich auf eine einzige Verarbeitungsart zu stützen, kombiniert das Netzwerk zwei Stärken. Ein Multi‑Scale‑Faltungsmodul konzentriert sich auf lokale Details—wie Risse, Pinselstriche oder gefräste Linien—indem es das Bild gleichzeitig in mehreren Nachbarschaftsgrößen betrachtet. Ein effizienter Transformer‑Modul erfasst dann größere Muster, etwa wiederkehrende Motive oder lange Kurven, die sich über ein Objekt ziehen. Eine dritte Komponente verstärkt gezielt wirklich ähnliche Regionen im Bild und unterdrückt dabei Rauschen, sodass schwache Texturen geklärt statt verwischt werden. Zusammen erzeugen diese Elemente hochaufgelöste Bilder, die sowohl feine Ornamentik als auch die Gesamtstruktur bewahren und den späteren 3D‑Schritten einen deutlich besseren Ausgangspunkt geben.

Stabilere 3D‑Formen aus vielen Blickwinkeln erstellen

Verbesserte Bilder allein reichen nicht aus; auch die 3D‑Rekonstruktion selbst muss robust sein. Der zweite Teil des Frameworks überdenkt, wie das 3D‑Modell initialisiert und optimiert wird. Anstatt sich auf eine dünne Menge übereinstimmender Punkte zu verlassen, verwenden die Autoren eine "dichte" Matching‑Methode, die von Anfang an reichhaltige Punktwolken und zuverlässigere Kameraposen produziert. Diese dichten Punkte fungieren als starkes geometrisches Skelett der Szene. Darauf aufbauend führen sie eine hybride Repräsentation ein: der Raum um das Artefakt wird in grobe 3D‑Zellen unterteilt, und ein gemeinsamer Decoder sagt die detaillierte Farbe und Form vieler kleiner Klumpen innerhalb jeder Zelle voraus. Weil Parameter größtenteils geteilt statt dupliziert werden, reduziert die Methode den Speicherbedarf und fördert glatte, kohärente Oberflächen, wodurch das finale Modell weniger anfällig für zufällige Beulen und Löcher ist.

In sanften Schritten trainieren statt auf einmal

Die Autoren ändern auch, wie das System trainiert wird. Anstatt das Modell von Beginn an dazu zu zwingen, gleichzeitig Erscheinungsbild und Geometrie zu erfüllen—ein Rezept dafür, in schlechten Lösungen stecken zu bleiben—verfolgen sie eine dreistufige Strategie. Zuerst lernt das System ausschließlich, die Farben der Eingabefotos zu reproduzieren und damit die globale visuelle Konsistenz sicherzustellen. Anschließend werden schrittweise Tiefeninformationen aus den dichten Punktwolken hinzugefügt, die das Modell in Richtung plausibler Oberflächen lenken. In der letzten Phase verfeinert es feinmaßstäbliche Details, indem es Konsistenz über sich überlappende Bildausschnitte aus verschiedenen Blickwinkeln erzwingt. Getestet an einem neuen Cultural‑Relics‑Datensatz mit Porzellan, Möbeln, Handwerksarbeiten und Textilien sowie an einem Standard‑Benchmark komplexer Außenszenen verbessert dieser gestufte Ansatz nicht nur die visuelle Qualität, sondern verkürzt auch Trainingszeit und Speicherverbrauch im Vergleich zu führenden Alternativen.

Was das für die Bewahrung der Vergangenheit bedeutet

Für Nicht‑Spezialistinnen und Nicht‑Spezialisten ist die Kernbotschaft klar: Dieses Framework hilft dabei, unvollkommene Museums‑ oder Feldfotos in sauberere, genauere 3D‑Repliken von Kulturgut zu verwandeln, ohne das Objekt physisch zu berühren. Durch das Schärfen von Bildern geringer Qualität, den Start von einem stabileren geometrischen Gerüst und das Training des 3D‑Modells in sorgfältig kontrollierten Stufen erzeugt die Methode digitale Artefakte, die feine Verzierung und Gesamtform besser einfangen und dabei weniger Rechenressourcen benötigen. Praktisch erleichtert dies Museen, Restauratorinnen und Restauratoren sowie Forschenden den Aufbau vertrauenswürdiger virtueller Sammlungen aus gewöhnlichen Fotoshootings, trägt zur Sicherung empfindlicher Objekte bei und ermöglicht eine breitere Zugänglichkeit für Wissenschaft und Öffentlichkeit.

Zitation: Jia, Q., He, J. High-fidelity 3D reconstruction of cultural heritage via super-resolution and progressive Gaussian splatting. npj Herit. Sci. 14, 84 (2026). https://doi.org/10.1038/s40494-026-02355-4

Schlüsselwörter: Digitalisierung des Kulturerbes, 3D‑Rekonstruktion, Bild‑Super‑Auflösung, Gaussian Splatting, digitale Bewahrung