Clear Sky Science · ar

تقييم عدم التيقّن التقديري في نماذج اللغة الكبيرة

لماذا تهم الكلمات الضبابية عن المخاطر حقًا

عندما يقول الطبيب إن علاجًا ما «من المرجح» أن ينجح، أو عندما يحذّر راصد الطقس من أن هناك «فرصة ضئيلة» لحدوث إعصار، نعتمد على هذه الكلمات الضبابية لاتخاذ قرارات حقيقية. اليوم، بدأت نماذج اللغة الكبيرة مثل روبوتات المحادثة عبر الإنترنت تستخدم نفس المفردات. يطرح هذا البحث سؤالًا بسيطًا لكنه حاسم: عندما يقول الذكاء الاصطناعي «من المحتمل»، هل يعني ذلك الشيء نفسه الذي نعنيه نحن — وهل يستطيع بشكل موثوق تحويل الأرقام الخام إلى كلمات عدم تيقّن يومية؟

وضع عدم اليقين اليومي تحت المجهر

يركّز المؤلفون على «كلمات الاحتمال التقديرية» (WEPs) — مصطلحات مثل «شبه مؤكد» و«من المحتمل» و«فرصة ضئيلة» التي يستخدمها الناس بدلًا من النسب المئوية الدقيقة. محاولات سابقة، تعود إلى محلّلي الاستخبارات في الستينيات، سعَت لربط هذه الكلمات باحتمالات رقمية عبر استطلاعات رأي. تقارن هذه الدراسة أحكام البشر مع مخرجات خمسة نماذج لغوية حديثة، بما في ذلك GPT-3.5 وGPT-4 ونماذج Llama من ميتا ونظام صيني يُسمّى ERNIE-4.0. بالنسبة إلى 17 كلمة شائعة للتعبير عن عدم التيقّن، تم إعطاء كل نموذج مُحفزات قصيرة شبيهة بالقصص بالإنجليزية أو الصينية وطُلب منه الاستجابة باحتمال رقمي بين 0 و100 بالمئة. من خلال تكرار ذلك عبر سياقات عديدة، بنى المؤلفون توزيعات احتمالية كاملة لكل كلمة ولكل نموذج، ثم قارنوا هذه التوزيعات مع بيانات استطلاعات البشر.

حيث يتحدث البشر والذكاء الاصطناعي بلغة واحدة

بالنسبة للتعابير الأكثر تطرفًا — مثل «شبه مؤكد» في الطرف العالي و«شبه مستحيل» في الطرف المنخفض — يتطابق أداء النماذج والناس بشكل مفاجئ. يميل كل من البشر والنماذج إلى تجميع هذه العبارات داخل نطاقات ضيقة من الاحتمال العالية أو المنخفضة، مما يشير إلى أن هذه المصطلحات القوية لها معانٍ مستقرة إلى حد ما عبر السياقات. ينطبق ذلك أيضًا على «تقريبًا متساوٍ»، التي يتعامل معها معظم البشر والنماذج على أنها احتمال يقارب 50–50. تُظهر الاختبارات الإحصائية اختلافات طفيفة فقط بين توزيعات البشر والنماذج لهذه الكلمات المحددة، ما يوحي بأن نماذج اللغة الكبيرة قادرة على التقاط حالات الوضوح القصوى للاقترب من اليقين أو الاقتراب من الاستحالة بدقة شبيهة بالبشر.

حيث تنجرف المعاني بهدوء

الكلمات الغامضة والمتوسطة تسرد قصة مختلفة. بالنسبة لتعابير مثل «من المحتمل» و«مرجح» و«نشُكّ» و«فرصة ضئيلة»، تختلف التفسيرات الرقمية للنماذج اختلافًا كبيرًا عن أحكام البشر. يظهر GPT-4، على الرغم من كونه أكثر قدرة عمومًا من GPT-3.5، في كثير من الأحيان فروقًا أكبر. يقترح المؤلفون أن ذلك قد يعود إلى أن هذه الكلمات تمزج بين شيئين: إحساس بالاحتمال وموقف أو موقف المتكلّم. في المحادثات الحقيقية، قد تبدو كلمة «من المحتمل» حذرة أو واثقة اعتمادًا على النبرة والسياق، وقد تعبّر «نشـُكّ» عن شكوكية بدلاً من احتمال دقيق. وبما أن النماذج تدربت على نصوص واسعة ومتنوعة المصدر من الإنترنت، فقد تُقَيّم على استخدامات متضاربة كثيرة، ما يطمس هذه الدقائق. النتيجة هي عدم توافق خفي: قد يرى البشر والآلات نفس الجملة ولكن يرفقان أرقامًا مختلفة بصمت بنفس الكلمة.

الجندر واللغة والانعكاسات الثقافية

اختبر الباحثون أيضًا كيف تؤثر الصياغة المتعلقة بالنوع الاجتماعي واللغات المختلفة على هذه كلمات الاحتمال. عندما أشارت المحفّزات إلى «هو» أو «هي» بدلاً من الموضوعات المحايدة جنسيًا، غالبًا ما أنتج GPT-3.5 وGPT-4 تقديرات احتمالية أقل تشتتًا وأكثر «تثبيتًا»، وأحيانًا تنهار إلى نقطة واحدة. يشير ذلك إلى أن النماذج قد تكون استوعبت أنماطًا جامدة من الصور النمطية في بيانات تدريبها، رغم أن المتوسطات العامة لمحفزات الذكور والإناث كانت متشابهة. عند مقارنة المحفزات الإنجليزية والصينية، أظهرت نماذج GPT تحوّلات ملحوظة في كيفية تفسيرها لنفس كلمات عدم التيقّن. كان ERNIE-4.0، الذي تدرب أساسًا على نصوص صينية، أقرب إلى المتحدثين الصينيين في كثير من المصطلحات لكنه لا يزال يبالغ أو يستخف ببعض التعابير. تبرز هذه النتائج أن كيفية حديث الذكاء الاصطناعي عن عدم التيقّن لا تعتمد فقط على الكلمة المختارة، بل على اللغة والأنماط الثقافية المضمّنة في تدريبه.

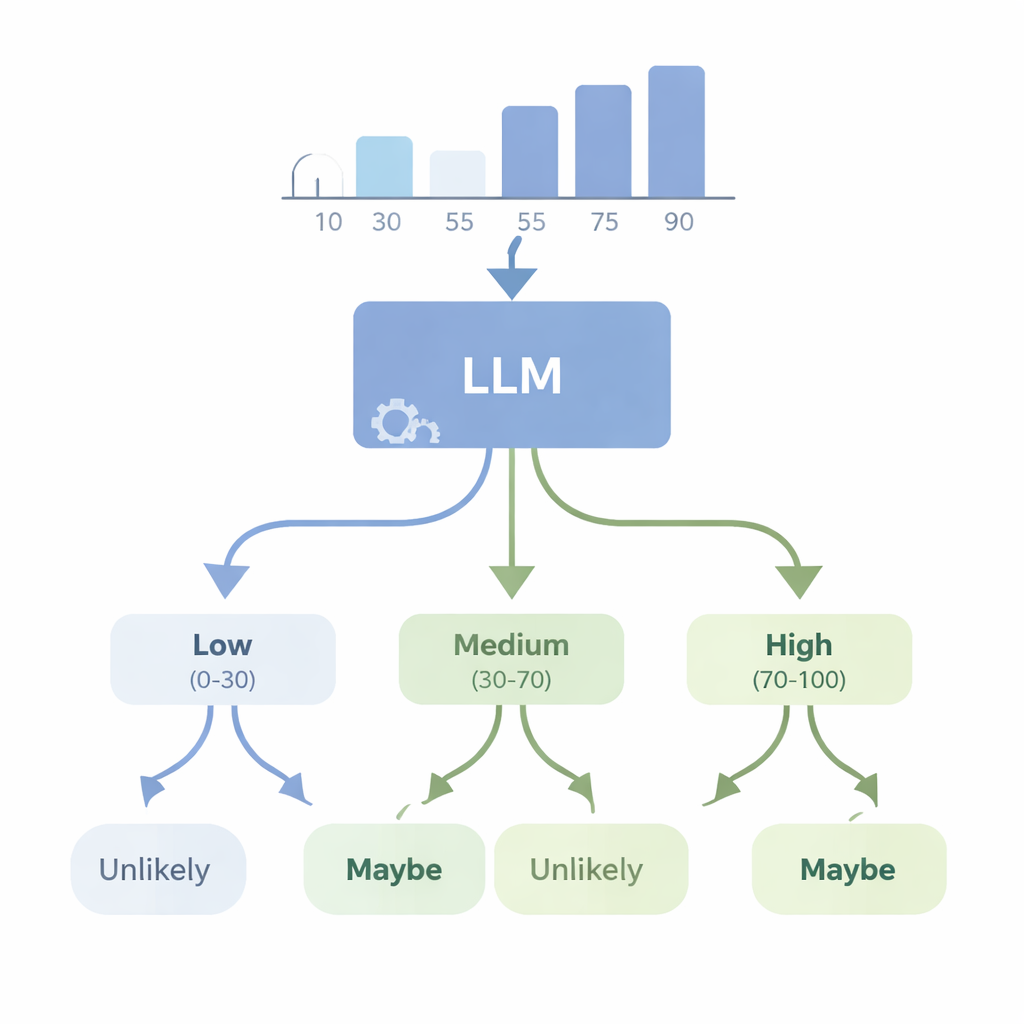

هل يمكن للآلات تحويل الأرقام إلى شكّ بلغة بسيطة؟

في مجموعة ثانية من التجارب، نظر المؤلفون في المشكلة العكسية: هل يستطيع نموذج متقدّم مثل GPT-4 أن يبدأ من بيانات رقمية ويختار كلمة عدم تيقّن مناسبة؟ زودوا النموذج بمجموعات بيانات بسيطة — مثل قوائم أطوال أو درجات اختبار — وطلبوا منه اختيار كلمة احتمال تقديرية ملائمة (مثل «شبه مؤكد» أو «من المحتمل» أو «ربما» أو «غير مرجح» أو «يكاد يكون مؤكدٌ أنه لا») لبيان نتائج مستقبلية. قيّموا بعد ذلك GPT-4 بأربع درجات «اتساق» جديدة تتحقق مما إذا كانت اختياراته اللفظية منطقية عندما تزيد أو تنخفض الاحتمالات، عند وصف أحداث متممة، وعندما تتغير الأرقام الأساسية بطرق مضبوطة. تفوّق GPT-4 كثيرًا على التخمين العشوائي وتمكّن غالبًا من تتبّع تغيّرات تقريبية في الاحتمال، لكنه كان بعيدًا عن الاتساق التام. في بعض الاختبارات استجاب بطريقة شبه متشابهة عبر مستويات ثقة مختلفة، ما يوحي بأنه أحيانًا يعامل هذه الكلمات كأوسمة عامة بدلاً من مقياس دقيق مرتبط بالبيانات الفعلية.

ما معنى ذلك لقرارات العالم الحقيقي

بالنسبة للقراء، الرسالة هي رسالة تحفّظ لكنها ليست تنبيهًا بالذعر. تستطيع نماذج اللغة الكبيرة بالفعل تقليد أقوى تعابيرنا لليقين والاستحالة، وغالبًا ما تستطيع تلخيص البيانات إلى عبارات «من المحتمل» أو «غير مرجح» معقولة. لكن تُظهر هذه الدراسة أن للعديد من كلمات عدم التيقّن اليومية معايرة داخلية لا تتطابق تمامًا مع الحدس البشري، وأن تحويلها من الأرقام إلى اللغة قد يكون غير متسق. في مجالات مثل الطب أو السياسة أو الاتصال العلمي — حيث يمكن لتحولات دقيقة في صياغة المخاطرة أو الثقة أن تهم — قد لا تكون «من المحتمل» التي يقولها النموذج هي نفسها التي تقصدها أنت. يجادل المؤلفون بأنه لاستخدام هذه الأنظمة بأمان، يجب أن نعامل كلمات عدم التيقّن كقاموس مشترك لا يزال بحاجة إلى محاذاة دقيقة واختبار وربما دعم رقمي صريح، بدلًا من الافتراض بأن الإنسان والآلة يقصدان الشيء نفسه افتراضيًا.

الاستشهاد: Tang, Z., Shen, K. & Kejriwal, M. An evaluation of estimative uncertainty in large language models. npj Complex 3, 8 (2026). https://doi.org/10.1038/s44260-026-00070-6

الكلمات المفتاحية: عدم التيقّن اللغة, نماذج اللغة الكبيرة, كلمات الاحتمال, الاتصال بين الإنسان والذكاء الاصطناعي, تفسير المخاطر