Clear Sky Science · ar

تحليل الإنصاف لتنبؤات التعلم الآلي بالعدوان في الرعاية النفسية الحادّة

لماذا يهم هذا أشخاصًا حقيقيين

تلجأ المستشفيات إلى الذكاء الاصطناعي لاكتشاف المرضى الذين قد يصبحون عدوانيين، على أمل منع الأذى دون اللجوء إلى التقييدات المؤلمة. لكن إذا كانت أدوات التنبؤ هذه غير عادلة، فقد تُفاقم أوجه عدم المساواة الموجودة أصلاً في تحديد مَن يُنظر إليهم على أنهم "خطرون". تسأل هذه الدراسة سؤالًا ملحًا: عندما يساعد جهاز آلي في تحديد مَن في وحدة نفسية هو عالي المخاطر، هل يعامل جميع المرضى على قدم المساواة؟

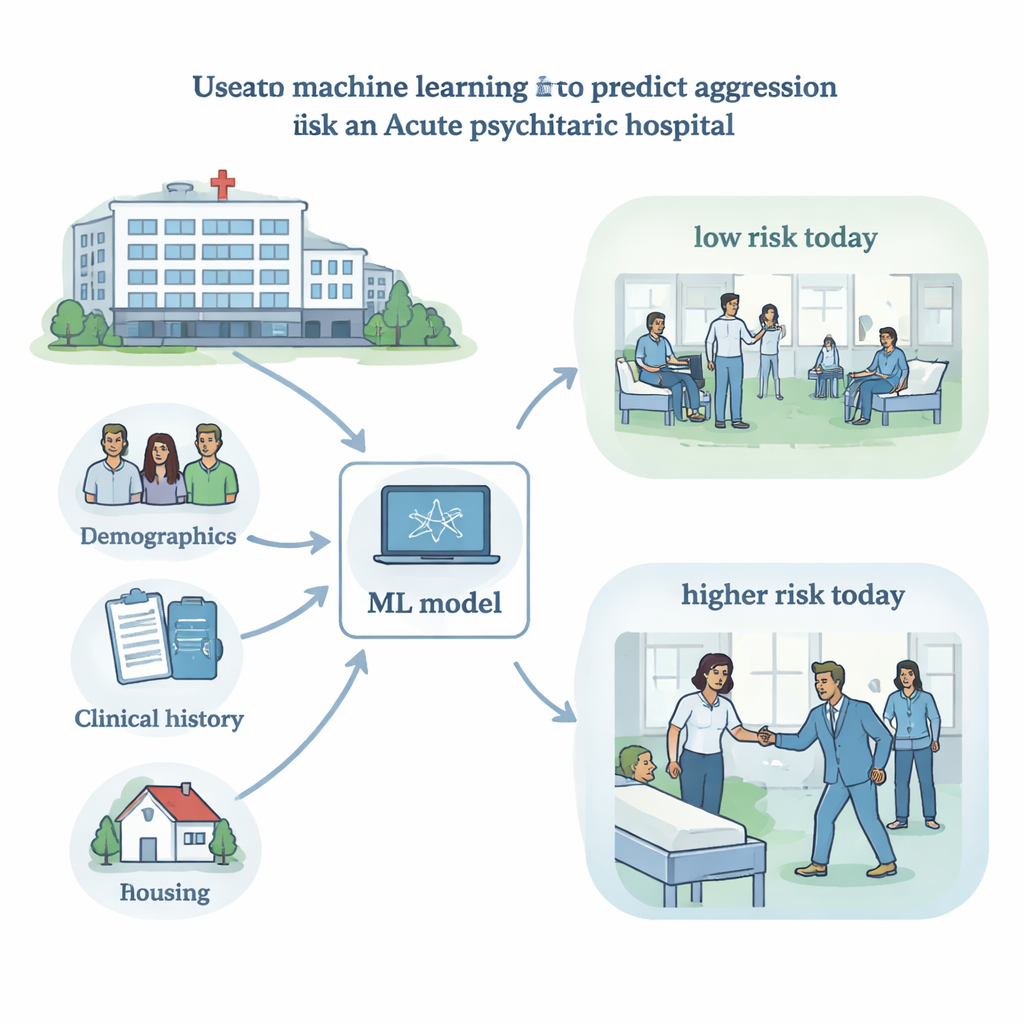

استخدام بيانات المستشفى للإشارة إلى الخطر قصير المدى

حلّل الباحثون سجلات أكثر من 17,000 مريض عولجوا في وحدات نفسية حادة في مستشفى نفسي كبير في كندا بين 2016 و2022. على مدى يصل إلى ثلاثة أيام أثناء الإقامة، سجّل الطاقم قائمة تحقق قياسية تُجرى بجانب السرير تسمى التقييم الديناميكي للعدوان الظرفي (DASA)، والتي تُقَيِّم سلوكيات مثل التهيج أو التهديدات اللفظية التي قد تشير إلى عدوان وشيك. دمج الفريق هذه الدرجات مع معلومات جُمعت عند القبول، مثل التشخيص، العمر، الجنس، العرق أو الإثنية، وضع السكن، وطريقة قدوم الشخص إلى المستشفى، لتدريب نموذج تعلم آلي يتنبأ بما إذا كان المريض سيشارك في حدث عدواني (بما في ذلك استخدام التقييد أو العزل) خلال الأربع وعشرين ساعة التالية.

كيف أدت أداة التنبؤ عموماً

كان النظام الأفضل أداءً يستخدم طريقة تعلم آلي شائعة تُدعى الغابة العشوائية (random forest). على بيانات اختبار محجوزة، صنّف الأيام ذات المخاطر الأعلى بشكل صحيح في كثير من الأحيان، محققًا "مساحة تحت المنحنى" تقارب 0.81، وهو ما يقارن بأدوات مماثلة في الطب النفسي. ومع ذلك، كان العدوان نادرًا—كان هناك نحو 33 يومًا بدون حوادث مقابل كل يوم به حادث—لذلك فات النموذج العديد من الأحداث الحقيقية وولّد بعض الإنذارات الكاذبة. أظهرت مقاييس الأهمية أن العوامل السريرية اللحظية، وخصوصًا عناصر DASA مثل التهيج والحوادث السابقة القريبة، أسهمت بأكبر قدر في التنبؤات، أكثر من الديموغرافيات وحدها. هذا يعني أن النموذج كان يلتقط علامات تحذيرية ذات معنى سريري، لكن مقاييس الأداء وحدها لم تكشف ما إذا كان موثوقًا بنفس القدر للجميع.

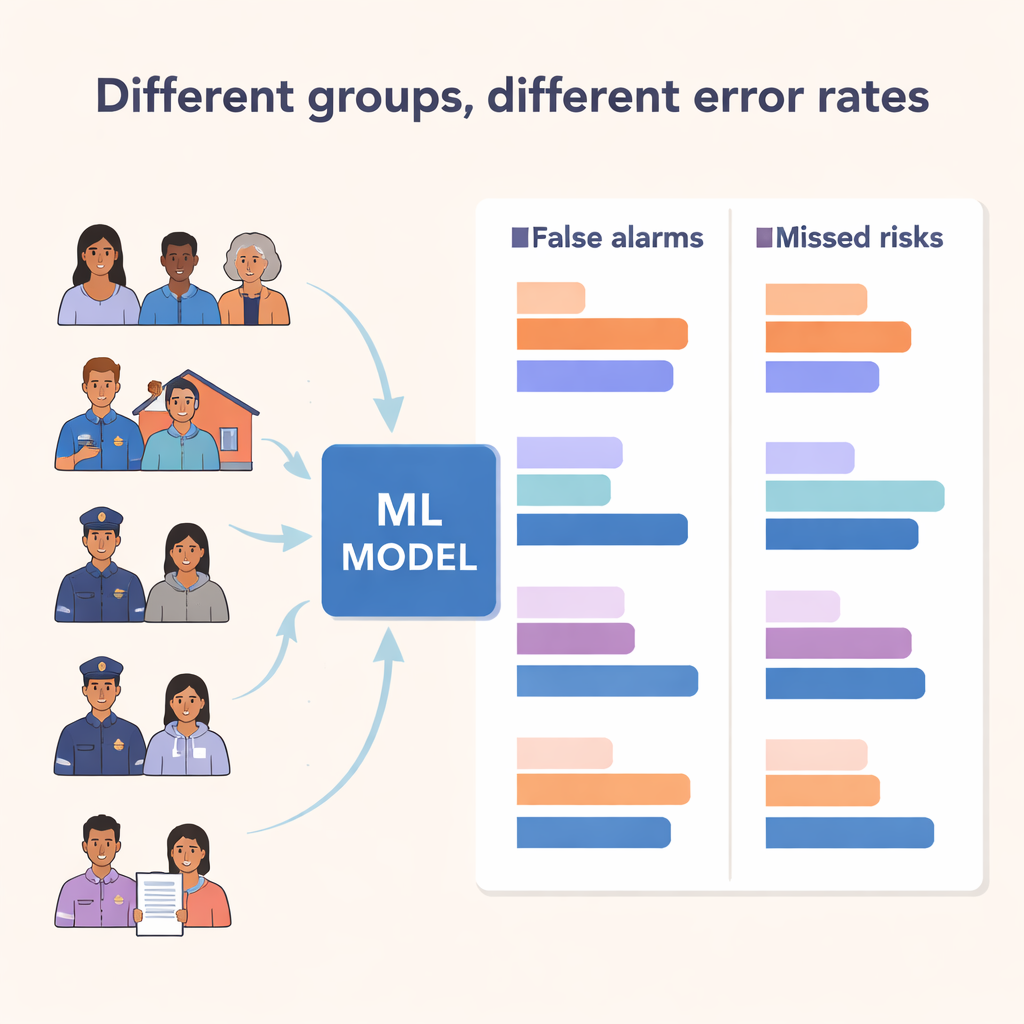

أخطاء غير متساوية عبر مجموعات مختلفة

كان جوهر الدراسة فحص الإنصاف. ركز الفريق على نوعين من الأخطاء: الإيجابيات الكاذبة، حيث يُشير النموذج إلى وجود خطر لكن لا يحدث شيء، والإيجابيات الحقيقية، حيث يتنبأ بشكل صحيح بحدث. يجب أن يكون النموذج العادل، بحسب معيار شائع يسمى "الاحتمالات المتساوية" (equalized odds)، له معدلات إيجابية كاذبة وإيجابية حقيقية متشابهة عبر المجموعات. بدلًا من ذلك، وجد الباحثون اختلافات كبيرة. كانت الإيجابيات الكاذبة أعلى لدى المرضى من أصل شرق أوسطي والسود، والرجال، والأشخاص الذين أحضرهم الشرطة إلى المستشفى، وأولئك الذين لا يملكون سكنًا أو في مساكن داعمة. بعض المجموعات—مثل المرضى المحالين عن طريق الشرطة أو ذوي السكن غير المستقر—كان لديها معدلات كشف أعلى وإنذارات كاذبة أعلى أيضًا، مما يشير إلى أن النموذج كان مضبوطًا ليكون أكثر حساسية تجاههم. وأخرى، مثل المرضى السود، واجهت مزيجًا مقلقًا: إنذارات كاذبة أكثر وقدرة أقل على التعرف الصحيح على الخطر الحقيقي.

عندما تتقاطع الهويات، تتسع الفجوات

نظرًا لأن تجارب الأشخاص تتشكل بأكثر من صفة واحدة في آنٍ واحد، فحص الباحثون أيضًا الهويات المتداخلة، لا سيما مزيج العِرق أو الإثنية والجنس. هنا ظهر أكبر إنذار للرجال الشرق أوسطيين، الذين كان لديهم أعلى معدل إيجابيات كاذبة من أي مجموعة، بينما لم تُظهر النساء الشرق أوسطيات ذلك. كما واجه الرجال السود والسكان الأصليين أيضًا نسب إيجابيات كاذبة مرتفعة مقارنةً بالنساء من نفس الخلفية. تعكس هذه الأنماط عدم مساواة موثقة جيدًا في الرعاية النفسية، مثل معدلات أعلى لتدخل الشرطة، والقبول الإجباري، وسوء التشخيص بين مجموعات وذكور مُعنونة. لم تخلق منظومة التعلم الآلي هذه الظلم، لكنها تعلّمت من بيانات مشبعة به—ومتاحة لأن تضخمها في القرارات السريرية.

ماذا يعني هذا لمستقبل الذكاء الاصطناعي في الطب النفسي

يجادل المؤلفون بأن تحليل الإنصاف يجب أن يُعامل كفحص سلامة أساسي، وليس إضافة اختيارية، قبل تطبيق أي أداة تنبؤية. ويشيرون إلى أن طرق "إزالة الانحياز" التقنية—مثل تعديل بيانات التدريب أو ضبط عتبات الإنذار المختلفة لمجموعات مختلفة—قد تساعد، لكنها محدودة إذا كانت السجلات الأساسية تعكس بالفعل معاملة غير متساوية وممارسات قسرية. في نهاية المطاف، تحديد ما يُعد نموذجًا "عادلاً" ليس مجرد مسألة حسابية؛ إنها مسألة اجتماعية وأخلاقية تتطلب مدخلات من المرضى والمقدّمين والمجتمعات. تُظهر هذه الدراسة أنه بينما يمكن للتعلم الآلي أن يساعد في تحديد خطر العدوان قصير المدى، فإنه أيضًا قد يعيد إنتاج العنصرية الهيكلية والتمييز الجنسي وعدم المساواة المتعلقة بالسكن بصمت ما لم يُقاس الإنصاف ويُناقش ويُعالَج بصرامة.

الاستشهاد: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

الكلمات المفتاحية: الإنصاف الخوارزمي, العدوان النفسي, التعلم الآلي في الرعاية الصحية, عدم المساواة الصحية, نماذج توقع المخاطر