Clear Sky Science · ar

تحديد السلامة التشغيلية في أنظمة الذكاء الاصطناعي السريرية

لماذا تهم سلامة الذكاء الاصطناعي في الطب

تتبنى المستشفيات بسرعة تقنيات الذكاء الاصطناعي لقراءة الصور الطبية وكشف الأمراض، لكن هناك سؤال لا تستطيع درجات الدقة التقليدية الإجابة عنه: متى يكون من الآمن فعلاً ترك القرار للآلة؟ يقدم هذا البحث طريقة عملية لتحديد متى يمكن للأطباء الاعتماد بثقة على نظام الذكاء الاصطناعي، ومتى يجب تجاهله، ومتى يتعين عليهم فحص الحالة بأنفسهم عن قرب. الهدف ليس مجرد بناء خوارزميات أكثر ذكاءً، بل دمجها في الرعاية اليومية بطريقة تحمي المرضى، وتقلل الفحوصات غير الضرورية، وتخفف العبء عن الأطباء بدلاً من زيادته.

من درجة واحدة إلى ثلاث مناطق عمل واضحة

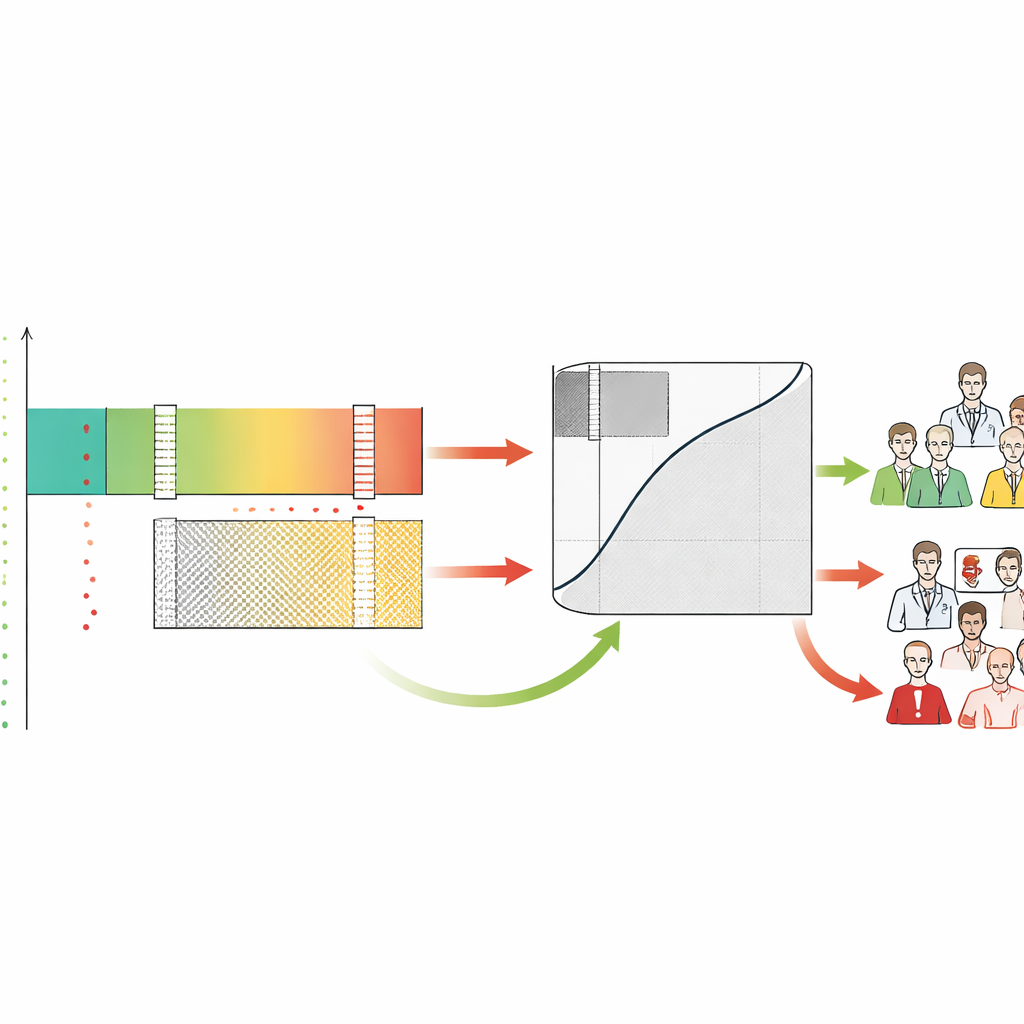

تنتج معظم أدوات الذكاء الاصطناعي الطبية درجة مخاطرة واحدة، مثل احتمال وجود سرطان في صورة ماموغرام. تقليدياً، يقيم المطوّرون هذه الأدوات بمنحنى يلخّص مدى تمييزها بين المرضى المرضى والأصحاء عموماً. يرى المؤلفون أن ذلك غير كافٍ. يقترحون إطار عمل يسمى منحنى الاستجابة للسلامة (SA-ROC)، يبدأ من نفس درجات المخاطرة لكن يعيد تشكيلها إلى ثلاث مناطق عملية. تحتوي منطقة "القبول المؤكد" ذات الدرجة العالية على المرضى الذين تكون نتائجهم موثوقة بما يكفي لتوجيه إجراء فوري، مثل المتابعة العاجلة. تحتوي منطقة "الاستبعاد الآمن" ذات الدرجة المنخفضة على المرضى الذين تكون نتائجهم موثوقة بما يكفي لتقليل أولوية متابعتهم بأمان. بينهما تقع "المنطقة الرمادية" من عدم اليقين، حيث لا يكون النظام موثوقاً بما يكفي ويجب أن يراجع خبير بشري الحالة.

ترك تحديد مستوى السلامة للأطباء

والأهم أن SA-ROC يسمح للأطباء والمؤسسات بتحديد أهداف السلامة الخاصة بهم مسبقاً. يختارون مدى اليقين الذي يريدون الوصول إليه قبل اتخاذ إجراء على نتيجة إيجابية (أدنى احتمال مقبول أن تكون النتيجة الموضحة غير طبيعية فعلاً) ومدى اليقين قبل التراخي على نتيجة سلبية (أدنى احتمال مقبول أن تكون الحالة المتجاوزة طبيعية فعلاً). بناءً على هذه الأهداف، يبحث الإطار ضمن درجات النموذج لإيجاد الحدود الدقيقة التي تلبيها. تشكل الدرجات فوق الحد العلوي منطقة القبول الآمن، وتشكّل الدرجات تحت الحد السفلي منطقة الاستبعاد الآمن، وكل ما بينهما يصبح المنطقة الرمادية. ثم يقدّر الإطار عدد المرضى في كل منطقة وكمية عبء العمل غير المحسوم—الحالات التي تُعاد للبشر—التي يتركها الذكاء الاصطناعي.

كشف فروق خفية بين نماذج ذكاء شبيهة

يبين المؤلفون أن نظامي ذكاء اصطناعي لهما دقة تقليدية متشابهة للغاية قد يختلفان كثيراً عند النظر إليهما من منظور السلامة هذا. في المحاكاة، أنتجت النماذج ذات الأداء العام المماثل أحجاماً مختلفة جداً لمناطق القبول والاستبعاد والمنطقة الرمادية اعتماداً على كيفية توزيع درجاتها. قد يتفوق أحدهما في تأكيد المرض بثقة، بينما يتفوق الآخر في الاستبعاد الآمن لعدد كبير من المرضى منخفضي المخاطر. في دراسة حالة واقعية على أداتين معتمَدتَين من إدارة الغذاء والدواء الأمريكية لفحص سرطان الثدي، كان النظام صاحب الدرجة التقليدية الأعلى أسوأ بالفعل في الفحص عالي الثقة. عند أكثر إعدادات السلامة صرامة—عدم تفويت أي حالات سرطانية في مجموعة المخاطر المنخفضة—أزال النظام الأضعف المزعوم بأمان ما يقرب من ضعف عدد النساء من قائمة التشخيص لدى أخصائيي الأشعة. يكشف SA-ROC بذلك نوعاً من "انعكاس الأداء" الذي تخفيه المقاييس التقليدية.

فهم التوتر بين الإنسان والذكاء الاصطناعي وعبء العمل

من خلال تصنيف كل حالة كقبول مؤكد أو استبعاد آمن أو رمادية، يكشف الإطار أيضاً كيف يتصرف الأطباء البشر في هذه المناطق. وجد المؤلفون أن أخصائيي الأشعة غالباً ما يبالغون في استدعاء حالات قد حكم عليها الذكاء الاصطناعي بأنها منخفضة المخاطر بأمان، مما يولد العديد من الإنذارات الكاذبة في المنطقة التي كان الجهاز فيها الأكثر موثوقية. بالمقابل، كافح كل من البشر والذكاء الاصطناعي في المنطقة الرمادية، مما يؤكد أنها المنطقة التي تحتاج حقاً إلى انتباه خبراء. يلتقط SA-ROC حجم هذه المنطقة الرمادية في رقم واحد يمثل تكلفة التردد. منطقة رمادية صغيرة تعني أتمتة آمنة أكثر وعبء بشري أقل؛ ومنطقة رمادية كبيرة تعني أن العديد من الحالات لا تزال تتطلب مراجعة يدوية دقيقة وأن النظام قد يزيد الاحتراق المهني بدلاً من تخفيفه.

تحويل قواعد السلامة إلى ممارسة يومية

بعيداً عن القياس، صُمم الإطار كأداة حوكمة تحول السياسات إلى سلوك ذكاء اصطناعي ملموس. يمكن للمستشفيات استخدامه بطريقتين. أولاً، يمكنها تحديد متطلبات السلامة مباشرة أو حدوداً لعدد الحالات التي تقبل إرسالها إلى المنطقة الرمادية، وترك الإطار يحسب الحدود المقابلة. ثانياً، يمكنها إسناد قيم وعقوبات لنتائج مختلفة—كشف سرطان، فوات حالة، طلب فحص غير ضروري، أو إحالة للمراجعة البشرية—وجعل الإطار يبحث عن السياسة التي تعظم الفائدة الإجمالية. يمكن ضبط هذه الاستراتيجيات لأهداف مختلفة جداً، مثل برامج الفحص الجماعي، أو الإحالات إلى المتخصصين، أو مجموعات البحوث، كلها باستخدام نفس النموذج الأساسي.

ماذا يعني هذا للمرضى والأطباء

بعبارات بسيطة، يقدم هذا العمل طريقة تقول ليس فقط "هذا الذكاء الاصطناعي دقيق"، بل "إليكم بالضبط متى وكيف يمكن الوثوق به في العيادة". من خلال تقسيم مخرجات الذكاء الاصطناعي إلى مناطق آمنة وغير آمنة وغير مؤكدة مرتبطة بوعود سلامة صريحة، يساعد SA-ROC أنظمة الرعاية الصحية على تحديد متى يمكن للآلات أن تتصرف بمفردها ومتى يجب أن يبقى البشر مسيطرين تماماً. يبرز أن درجات الدقة التقليدية قد تكون مضللة وأن السلامة الحقيقية تعتمد على كيف يتصرف النموذج عند النهايات التي تكون فيها الأخطاء الأكثر تكلفة. إذا اعتُمِد هذا الإطار على نطاق واسع وتم التحقق منه في بيئات أوسع وحقيقية، فقد يدعم أتمتة أكثر موثوقية، ويقلل الإنذارات والاختبارات غير الضرورية، ويحوّل أصعب حالات الذكاء الاصطناعي—المنطقة الرمادية—إلى مصدر مركّز للتعلم والتحسين لكل من الخوارزميات والطب ذاته.

الاستشهاد: Kim, YT., Kim, H., Bahl, M. et al. Defining operational safety in clinical artificial intelligence systems. npj Digit. Med. 9, 281 (2026). https://doi.org/10.1038/s41746-026-02450-7

الكلمات المفتاحية: الذكاء الاصطناعي السريري, السلامة التشغيلية, التصوير الطبي, دعم القرار, تصنيف المخاطر