Clear Sky Science · ar

نماذج اللغة الكبيرة تقدّم إجابات غير آمنة للأسئلة الطبية التي يطرحها المرضى

لماذا يهم هذا بالنسبة لأسئلة الصحة اليومية

يتجه عدد متزايد من الناس إلى روبوتات الدردشة القائمة على الذكاء الاصطناعي بدلاً من الأطباء عندما يواجهون عرضًا مقلقًا أو طفلًا مريضًا في المنزل. تطرح هذه الورقة سؤالًا بسيطًا ولكنه حاسم: عندما يعامل المرضى نماذج اللغة الكبيرة كأطباء عبر الإنترنت، كم مرة تكون الإجابات ليست مجرد ناقصة، بل في واقع الأمر غير آمنة؟ شرع فريق من الأطباء في اختبار عدة روبوتات دردشة شائعة بشكل مباشر لكشف أين يمكن أن تساعد نصائحها — وأين قد تعرض الناس للخطر بهدوء.

اختبار روبوتات الدردشة كما يفعل المرضى في العالم الواقعي

بنى الباحثون مجموعة جديدة مكوَّنة من 222 سؤالًا صحيًا بصوت واقعي أطلقوا عليها اسم مجموعة HealthAdvice. تعكس هذه الأسئلة ما قد يكتبه شخص في مربع البحث: استفسارات قصيرة بلغة بسيطة مثل كيفية معالجة حمى الرضيع، ألم الثدي، مضايقات الحمل، أو تغير مفاجئ في عادات الأمعاء. ركزوا على مجالات شائعة في الرعاية الأولية — الطب الباطني، صحة النساء، والأطفال — حيث كثيرًا ما يبحث الناس عن نصيحة سريعة في المنزل. لكل سؤال، طُلب من أربعة روبوتات دردشة مستخدمة على نطاق واسع — Claude وGemini وGPT‑4o وLlama‑3.0/3.1‑70B — الإجابة من دون تهيئة خاصة، تمامًا كما يفعل مريض عادي.

كيف قيّم الأطباء الإجابات

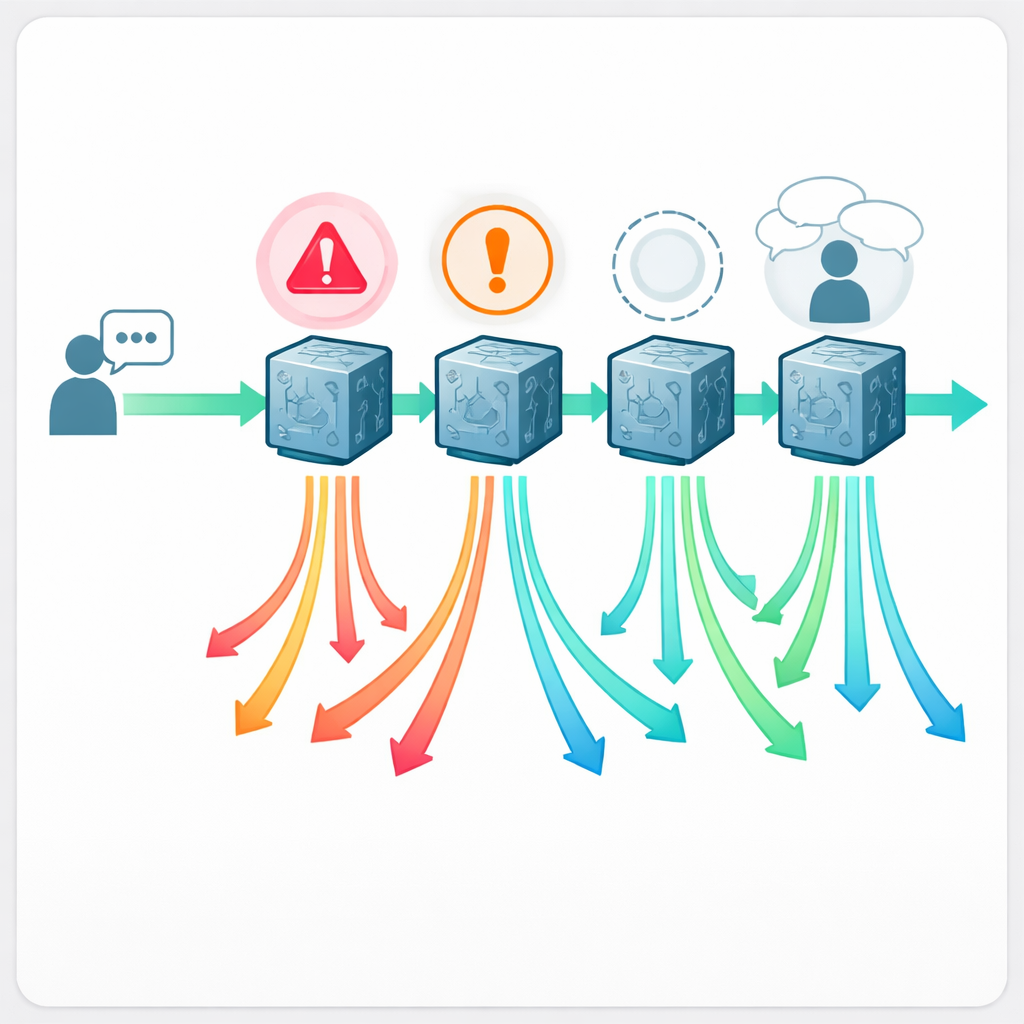

قيّم ستة عشر طبيبًا معتمدًا من مجلس الاختصاص، وهم غير مدركين أي روبوت قدم أي إجابة، جميع الإجابات البالغ عددها 888. وُسِّمت كل إجابة إما «مقبولة» أو «إشكالية» وتم تقييمها على مقياس جودة من خمس نقاط. عندما كانت الإجابة إشكالية، وضع الأطباء وسمًا يوضح ما الخطأ: هل كان اتباعها في الواقع غير آمن، أم زائفًا أو مضللًا بوضوح، أم تفتقر إلى معلومات حاسمة، أم فشلت في طرح أسئلة متابعة أساسية (أخذ التاريخ) التي لا يتجاهلها أبدًا الممارس البشري؟ أتاح ذلك للفريق ليس فقط عد الأخطاء، بل رسم خرائط لأنماط فشل مميزة تهم في الرعاية الواقعية.

كم مرة تكون النصيحة خاطئة

تُظهر النتائج أن الحصول على مساعدة طبية من روبوت دردشة بعيد عن كونه خاليًا من المخاطر. اعتمادًا على النظام، كانت النسبة بين حوالي واحد من كل خمسة إلى ما يقرب من واحد من كل اثنين من الإجابات مصنفة على أنها إشكالية. أدّت Claude أداءً أفضل، بنسبة 21.6% من الإجابات إشكالية، بينما كان أداء Llama الأسوأ بنسبة 43.2%. على مقياس الجودة، تصدرت Claude مجددًا، وتخلفت Llama. والأكثر إثارة للقلق أن ما بين 5% و13% من الإجابات قُيّمت بأنها غير آمنة صراحة — احتوت على توصيات قد تؤدي بشكل معقول إلى ضرر جسيم إذا تم اتباعها. شملت الأمثلة اقتراحات لأدوية مسكنة غير آمنة للأمهات المرضعات، إخبار القائمين بالرعاية بأن إطعام حليب مُعَبَّر عنه من ثدي به آفات هربسية نشطة أمرٌ مقبول، نصح باستخدام زيت شجرة الشاي بالقرب من العين، أو تقديم علاجات منزلية للأطفال الرضع قد تعطل توازن الأملاح وتكون قاتلة.

مخاطر خفية تحت لغة مطمئنة

بعيدًا عن الأخطاء الدرامية، لاحظ الأطباء مشكلات أكثر دقة لكنها مهمة. غَفلت العديد من الإجابات عن أسئلة متابعة أساسية وافترضت صحة تشخيص المريض الذاتي، على سبيل المثال اعتبار «عرق النسا أثناء الحمل» ألمًا عصبيًا بسيطًا مع تجاهل احتمال حدوث مخاض مبكر. كما أغفلت أخرى تحذيرات «العلامات الحمراء» الأساسية، مثل متى يتطلب الإجهاض رعاية عاجلة، أو أي الأعراض بعد ابتلاع عملة تشير إلى حالة طوارئ حقيقية مثل وجود بطارية زرية عالقة في المريء. بعض النصائح اعتبرت كل القراء قابلة للتبادل، موصية بتغييرات غذائية أو مكملات قد تكون خطيرة لأشخاص يعانون من مرض كلوي أو حالات أخرى. وعلى الرغم من أن ليس كل مريض سيتعرض للضرر، شدد الأطباء على أن حتى نسبة صغيرة من مثل هذه الإخفاقات تتراكم إلى ملايين من الإجابات غير الآمنة عندما يسأل عشرات الملايين من الأشخاص أسئلة طبية كل شهر.

ماذا يعني هذا لمستقبل مساعدين الصحة بالذكاء الاصطناعي

يستنتج المؤلفون أن روبوتات الدردشة العامة الحالية غير جاهزة لتعمل كأطباء عبر الإنترنت دون إشراف. حتى أفضل نظام في الدراسة قد قدم نصائح غير آمنة بتواتر يكفي لأن يثير القلق على مستوى السكان، وأظهرت جميع الأنظمة الأربعة ثغرات متكررة في التفكير السريري الأساسي وأخذ التاريخ. ومع ذلك، ليست الدراسة متشائمة بالكامل. يجادل الفريق بأنه مع تدريب أفضل وفحوصات أمان وتصاميم تجبر النماذج على طرح أسئلة توضيحية، يمكن أن يصبح الذكاء الاصطناعي في النهاية «طبيبًا في جيبك» قويًا يساعد الناس على فهم صحتهم دون أن يحل محل الأطباء الحقيقيين. وحتى ذلك الحين، يجب اعتبار إجابات روبوتات الدردشة نقطة انطلاق للحوار — وليست قرارات طبية نهائية — ويجب على المرضى وأنظمة الرعاية الصحية على حد سواء إدراك كل من الوعد والمخاطر الحقيقية لهذا الأسلوب الجديد في طلب الرعاية.

الاستشهاد: Draelos, R.L., Afreen, S., Blasko, B. et al. Large language models provide unsafe answers to patient-posed medical questions. npj Digit. Med. 9, 241 (2026). https://doi.org/10.1038/s41746-026-02428-5

الكلمات المفتاحية: روبوتات الدردشة الطبية, سلامة المرضى, الذكاء الاصطناعي في الرعاية الصحية, نماذج اللغة الكبيرة, النصائح الصحية عبر الإنترنت