Clear Sky Science · ar

التقسيم الجراحي للأدوات تحت إشراف ضعيف وغير معتمد على النطاق

لماذا تهم رؤى أكثر ذكاءً للأدوات الجراحية

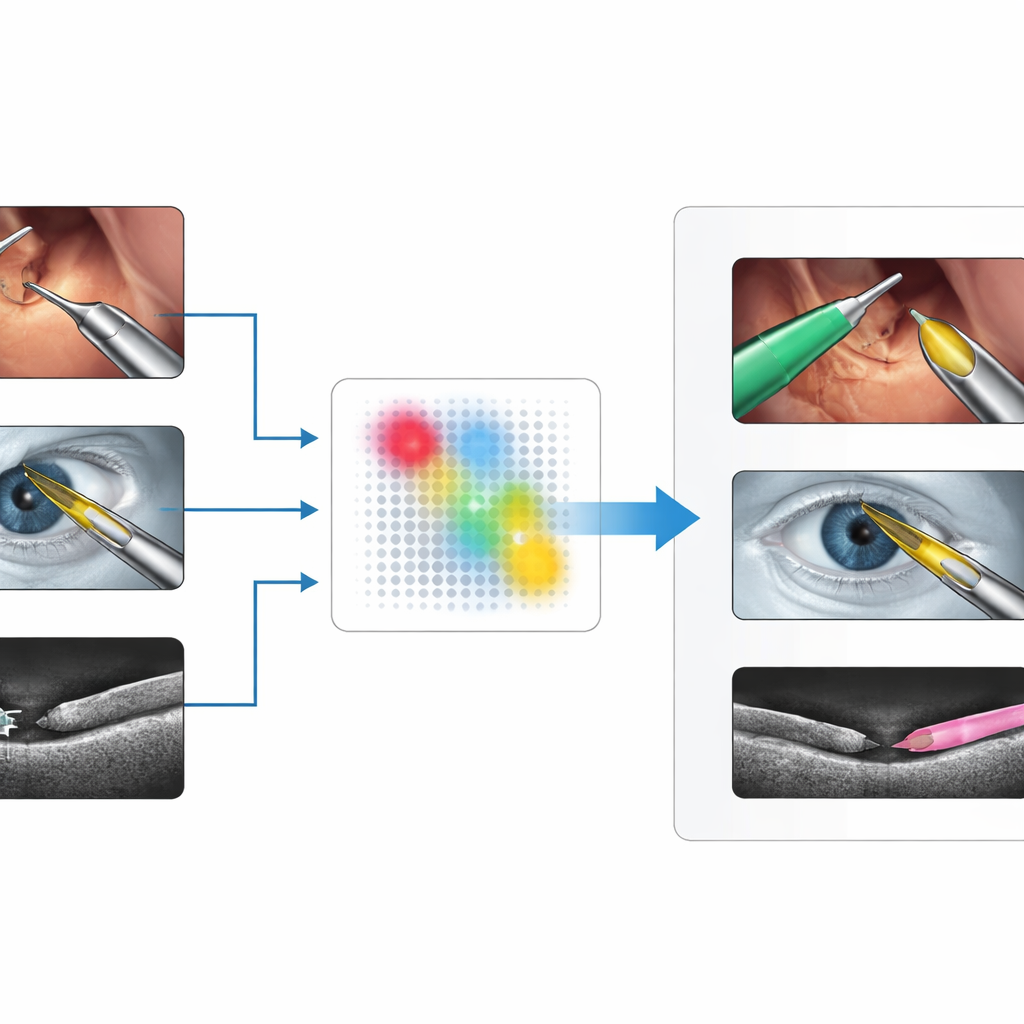

يعمل الجراحون المعاصرون بشكل متزايد بمساعدة الكاميرات والمجاهر وأجهزة المسح المتقدمة. لتوجيه الروبوتات، ومحاذاة المشاهد ثلاثية الأبعاد، أو إخفاء الأدوات من صور معينة، يجب على الحواسيب أن تعثر بثقة على كل أداة جراحية في كل إطار؛ وهذه المهمة تُعرف بالتقسيم. اليوم، عادةً ما يتطلب ذلك آلاف الوسوم الدقيقة على المستوى البكسلي من خبراء طبيين—ومع ذلك غالبًا ما تنهار الأنظمة عندما يتغير إعداد التصوير أو الإجراء. تقدم هذه الدراسة طريقة تمكّن نماذج الرؤية القوية من العثور على الأدوات عبر أنواع مختلفة للغاية من الصور الطبية، دون الحاجة إلى رسومات تفصيلية لكل أداة مسبقًا.

تحدي العثور على الأدوات في أنواع متعددة من الصور

يستخدم الجراحون مجموعة واسعة من أنظمة التصوير: فيديوهات ملونة من كاميرات المنظار داخل البطن، مشاهد مجهرية للعين أثناء جراحة الماء الأبيض، ومسحات مقطعية مثل التصوير بالتداخل البصري (OCT) أو الموجات فوق الصوتية. في كلٍ من هذه، تبدو الأدوات الجراحية مختلفة تمامًا—قضبان معدنية لامعة في الصور الملونة، خطوط رقيقة ساطعة أو أقواس في صور OCT، أو بقع مرقطة في الموجات فوق الصوتية. يمكن لأنظمة التعلم العميق الحالية أن تعمل جيدًا، لكن فقط بعد تدريبها على مجموعات بيانات كبيرة وموسومة بعناية من بيئة محددة. عندما يتغير جهاز التصوير أو التشريح أو نوع الأداة، ينخفض الأداء غالبًا بشكل حاد، وجمع وسوم جديدة بطيء ومكلف ومقيد بمتطلبات الخصوصية والخبرة.

فكرة جديدة: اعتبر الأدوات كأشياء خارجة عن المألوف

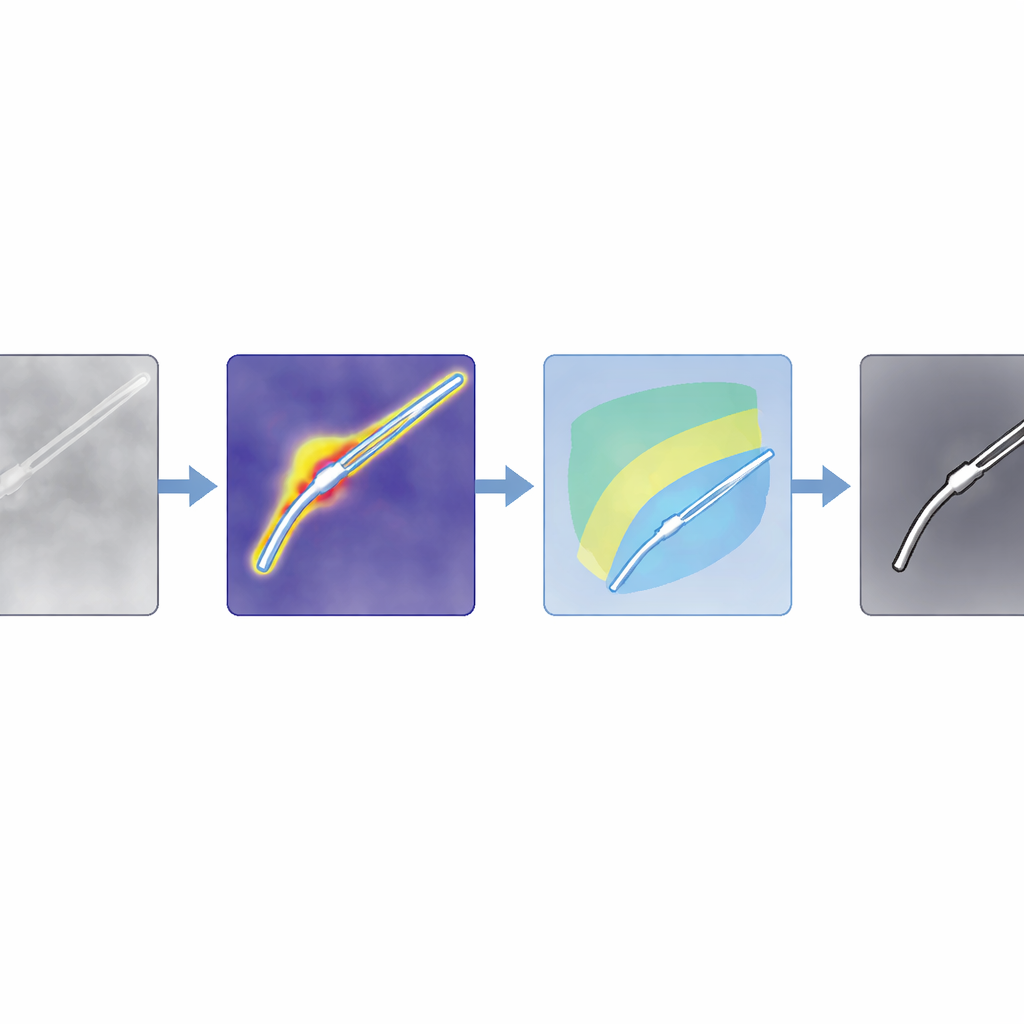

يقترح المؤلفون طريقة أطلقوا عليها SAM4SIS تقلب المشكلة رأسًا على عقب. بدلاً من تعليم النظام بالضبط كيف تبدو كل أداة، يعرضون عليه أولًا صورًا خالية من الأدوات، مما يتيح له تعلم شكل النسيج «الطبيعي». يستخدمون كاشف شذوذ يسمى PatchCore لبناء ذاكرة لهذه النماذج الطبيعية. عندما تصل صورة جديدة، يبرز PatchCore المناطق التي لا تتطابق مظهرًا مع هذه الذاكرة—المناطق التي من المحتمل أن تحتوي على أدوات جراحية. هذه الخطوة تحتاج فقط إلى معلومات بسيطة على مستوى الصورة عما إذا كانت توجد أداة أم لا، وليس رسومات بكسلية لمحيطها، مما يجعل الإعداد أسهل بكثير.

من تلميحات خام إلى حواف دقيقة

خرائط الشذوذ خشنة، لذا يجمع الفريق بينها وبين نموذج رؤية أساسي قوي، Segment Anything Model 2 (SAM2)، الذي يمكنه رسم حدود حادة إذا مُنح نقطة داخل الجسم المطلوب. الحيلة الأساسية هي اختيار تلك النقاط تلقائيًا من خريطة الشذوذ، بدلًا من مطالبة إنسان بالنقر. يصمم المؤلفون مرشحات ملائمة للصور الملونة العادية وللمسحات المعتمدة على الشدة مثل OCT، مع تعزيز المناطق المرجح احتواؤها على أدوات مع قمع الظلال والآثار الساطعة. ثم يقيسون مناطق الأدوات المحتملة ويختارون أقوى النقاط كمطالبات لـ SAM2. وبما أن SAM2 يعيد عدة حدود مرشحة، يقدم المؤلفون قاعدة تقييم جديدة، SAM4SIS، تقيس مدى تطابق كل قناع مرشح مع خريطة الشذوذ وتختار القناع الأكثر ملاءمة.

يعمل عبر العديد من العمليات والماسحات

يختبر الباحثون نهجهم على ثلاث مجموعات بيانات تتسم بمتطلبات عالية: فيديوهات جراحة روبوتية بطنية (EndoVis2017)، صور مجهرية لعمليات إزالة الساد (CaDIS)، ومسحات مقطعية OCT لعيون خنازير مع أدوات صغيرة (PASO-SIS). تغطي هذه اختيارات عرضية وألوانًا وأنماط ضجيج مختلفة جدًا. دون إعادة تدريب نموذج التقسيم الكبير أو رسم أقنعة جديدة، يحقق SAM4SIS درجات دقة حدود تتراوح تقريبًا بين 53% و73%، مكافئًا أو متفوقًا على طرق المطالبة النصية ويقترب من بعض الأنظمة المراقبة. يعمل بشكل جيد خصوصًا حيث تتعثر الأساليب التقليدية، مثل بيانات OCT والموجات فوق الصوتية، ويحتاج إلى أقل من دقيقة لإعداد النظام. كما يوضح الفريق أن الفكرة نفسها يمكن أن تبرز أجسامًا غريبة أخرى، مثل كرات القطن في مسحات الموجات فوق الصوتية للدماغ، مما يدل على أن المفهوم لا يقتصر على الأدوات فقط.

ماذا يعني هذا لجراحة ذكية مستقبلية

الرسالة الأساسية للقراء هي أن الحواسيب باتت قادرة على «تقسيم أي شيء جديد» في المشاهد الجراحية عبر فهم ما يبدو عليه النسيج الطبيعي أولًا ثم الإشارة إلى الأشكال غير المألوفة كأدوات محتملة، والتي تُنقح بعد ذلك بواسطة نموذج رؤية عام. يتجنب هذا النهج العمل الثقيل على الوسم، ويتكيف مع تقنيات تصوير مختلفة، ويمكن إدراجه في سير العمل الجراحي بتحضير بسيط. بينما تظل النماذج المتخصصة المدربة بعناية متفوقة عندما تتوفر بيانات موسومة بكثرة، يقدم SAM4SIS بديلاً عمليًا للإجراءات الجديدة، وإعدادات التصوير النادرة، أو البحوث في مراحلها الأولى، مما يقرب كشف الأدوات الآلي والموثوق من الواقع السريري اليومي.

الاستشهاد: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

الكلمات المفتاحية: تقسيم أدوات جراحية, الذكاء الاصطناعي في التصوير الطبي, كشف الشذوذ, نماذج رؤية أساسية, الجراحة الروبوتية